Ângulo de Anderson

Raciocínio em cadeia comprovado como "decorativo" nos principais modelos de linguagem.

Uma nova pesquisa oferece uma maneira fácil de determinar que as explicações detalhadas e passo a passo de todos os principais modelos de linguagem de IA atuais – incluindo ChatGPT e Claude – são meramente "decorativas" e geralmente são inventadas. depois de A IA já decidiu qual é a resposta.

No ano passado, uma série de estudos de grande repercussão de empresas voltadas para a IA, incluindo Antrópico e Apple, indicou que as chamadas 'IAs racionais' frequentemente produzem explicações passo a passo que não refletem o que realmente motivou suas respostas.

Por diversos motivos, o debate logo degenerou em refutações incisivas e diversas interpretações (incluam nesse site), deixando sem resposta a questão de saber se a cadeia de pensamento (BerçoO raciocínio é apenas um enfeite cosmético criado para tranquilizar os usuários finais, ou evidência de um verdadeiro processo de raciocínio.

O ChatGPT 'mostra seu trabalho' – mas será que já decidiu o que responder?

Mostra e diz

Um novo e interessante artigo da Índia oferece um método barato e facilmente replicável para avaliar se as impressionantes "animações de dedução" nas interfaces do ChatGPT e de outros grandes Modelos de Linguagem (LLMs) realmente indicam que a IA está percorrendo os passos para chegar a uma conclusão.

O processo de nova pesquisa O estudo é fruto da colaboração de dois pesquisadores do Instituto Indiano de Tecnologia da Informação de Allahabad (IIITA), em Allahabad, e do Instituto Nacional de Eletrônica e Tecnologia da Informação (NIELIT), em Delhi.

Os autores descobriram que, em quase todos os casos, em uma ampla gama de LLMs proprietários e de código aberto, o raciocínio apresentado aos usuários é "decorativo", inventado. depois de A IA concluiu a resposta que irá apresentar.

Testando algoritmos como ChatGPT5.4, Claude Opus 4.6-R e DeepSeek-V3.2, os autores descobriram que remover qualquer uma das 10 a 15 indicações de CoT apresentadas alterava a resposta. menos de 17% das vezesE que qualquer passo individual, por si só, era suficiente para recuperar a resposta correta.

Os autores afirmam*:

Os marcos regulatórios para IA na saúde, finanças e direito exigem cada vez mais “Sistemas explicáveis”Nossos resultados sugerem que a abordagem padrão – pedir ao modelo que mostre seu funcionamento – proporciona uma ilusão de transparência.

As explicações são fluentes, adequadas ao domínio e incorretas de uma forma sutil: descrevem um raciocínio que o modelo não realizou.

Uma IA médica que escreve "a eosinofilia sugere um processo embólico" não necessariamente considerou a eosinofilia em si. Ela pode ter identificado padrões na pergunta inicial e na resposta, e elaborado o raciocínio posteriormente.

Segundo o Artigo 13 da Lei de IA da UE, um sistema de IA de alto risco deve fornecer “informações significativas sobre a lógica envolvida”. Nossos resultados sugerem que as explicações de linha de raciocínio da maioria dos modelos de vanguarda não atendem a esse padrão – a “lógica envolvida” para chegar à resposta não é a lógica descrita na explicação.

Os autores observam que dois dos modelos menores testados quebraram o padrão comum de duplicidade, mas apenas em circunstâncias muito particulares: MiniMax-M25 demonstrou genuína dependência de etapas ao lidar com análise de sentimentos, enquanto Kimi-K25 evidenciou uma necessidade real de 39% para o processamento de CoT – mas apenas ao lidar com classificação de tópicos.

Em todos os outros casos, assim como nos modelos maiores e mais conhecidos, as etapas de raciocínio demonstradas pareceram ser inteiramente performativas, com os modelos utilizando, em vez disso, atalhos.

Modelos menores se esforçam mais

Além dos dez modelos de API testados, os autores também experimentaram vários modelos de peso aberto menores.†, variando entre 0.8 e 8 bilhões de parâmetros (o que é bastante modesto nos dias de hoje), e descobriram que essas IAs menores realmente raciocinam e que o CoT que elas demonstram geralmente é – embora nem sempre – necessário para chegar a conclusões úteis e precisas.

Os modelos menores demonstraram uma necessidade de raciocínio passo a passo de 55%, em contraste com a necessidade média de 11% nos modelos maiores, o que, segundo os autores, 'Aprenderam a ignorar completamente o raciocínio em várias etapas, chegando às respostas corretas por meio de atalhos internos que seu raciocínio escrito não reflete.'.

Os autores defendem que quanto melhor um modelo se torna em uma tarefa, menos etapas de raciocínio ele requer (embora esta seja uma abordagem mais diplomática do conceito de evitar a análise racional em favor da resposta mais forte na distribuição dos dados de treinamento).† †:

'Os modelos pequenos raciocinam fielmente sobre matemática porque eles devo—eles não têm o conhecimento paramétrico necessário para usar atalhos.

'Os modelos de vanguarda internalizaram padrões matemáticos suficientes para que o raciocínio em cadeia explícito se torne redundante. O CoT ainda melhora a precisão (ao estruturar a geração), mas as etapas individuais não carregam mais informações únicas.'

Forma

O método utilizado para testar os modelos baseia-se em três critérios:

Necessidade remove cada etapa do CoT por vez e, em seguida, verifica se a resposta muda. Qualquer etapa cuja remoção altere o resultado é considerada 'necessária'; Suficiência isola cada etapa e testa se ela sozinha consegue recuperar a resposta, considerando qualquer etapa desse tipo como suficiente; e Sensibilidade à ordem Embaralha as etapas e observa se a resposta muda (já que o raciocínio genuíno deve depender da sequência e não de palavras-chave).

Em conjunto, alto necessidade e de baixo suficiência indicar um raciocínio real passo a passo, enquanto baixa necessidade e alta suficiência Indique explicações que podem ser removidas, reorganizadas ou reduzidas sem afetar o resultado.

Os autores observam que esse método elimina qualquer necessidade de acesso a modelos white-box, uma vez que pode ser implementado por apenas alguns dólares em modelos de código fechado, disponíveis somente por API, como ChatGPT e Claude, e, naturalmente, com o mesmo sucesso em modelos open-weights que podem ser instalados localmente.

Eles também observam que estudos anteriores ou usaram modelos de peso aberto que facilitavam a análise interna, ou usaram modelos binários mais simples. sim não respostas que revelam muito menos sobre os processos de raciocínio interno de um modelo de API.

Custos Mínimos

Os autores definem o raciocínio genuíno através de necessidade e suficiência, com alto necessidade e de baixo suficiência indicando que cada etapa possui um peso único. Por outro lado, o raciocínio decorativo demonstra baixa necessidade e alta suficiênciaIsso significa que etapas podem ser removidas ou usadas isoladamente sem alterar a resposta.

Necessidade Por si só, afirmam, pode obscurecer isso, uma vez que podem existir vários caminhos válidos. Portanto suficiência é usado para testar se alguma etapa individual já codifica o resultado, e sensibilidade à ordem Verifica se o modelo depende da sequência em vez de pistas superficiais.

A abordagem baseia-se em Explicação consistente com a intervenção A estrutura (ICE), requer apenas acesso à API de entrada e saída de texto e, para uma cadeia de seis etapas, envolve 15 avaliações, a um custo de cerca de US$ 1 a US$ 2 por modelo.

A estrutura ICE classifica o comportamento do modelo por necessidade e suficiência em três padrões: Decorativo Mostra baixa necessidade e alta suficiência, o que significa que as etapas são redundantes e a resposta seria alcançada de qualquer maneira. Isso predomina na maioria dos modelos e tarefas; Verdadeiramente Fiel demonstra alta necessidade e alta suficiência, o que significa que cada passo carrega um sinal real (e, como mencionado anteriormente, isso aparece no MiniMax-M2.5 em relação ao sentimento); e Dependente do contexto Mostra alta necessidade e baixa suficiência, ou seja, etapas. só funcionam juntos em sequência (que aparece em Kimi-K2.5 e MiniMax na classificação de tópicos e em modelos pequenos, quando se trata de matemática).

Testes

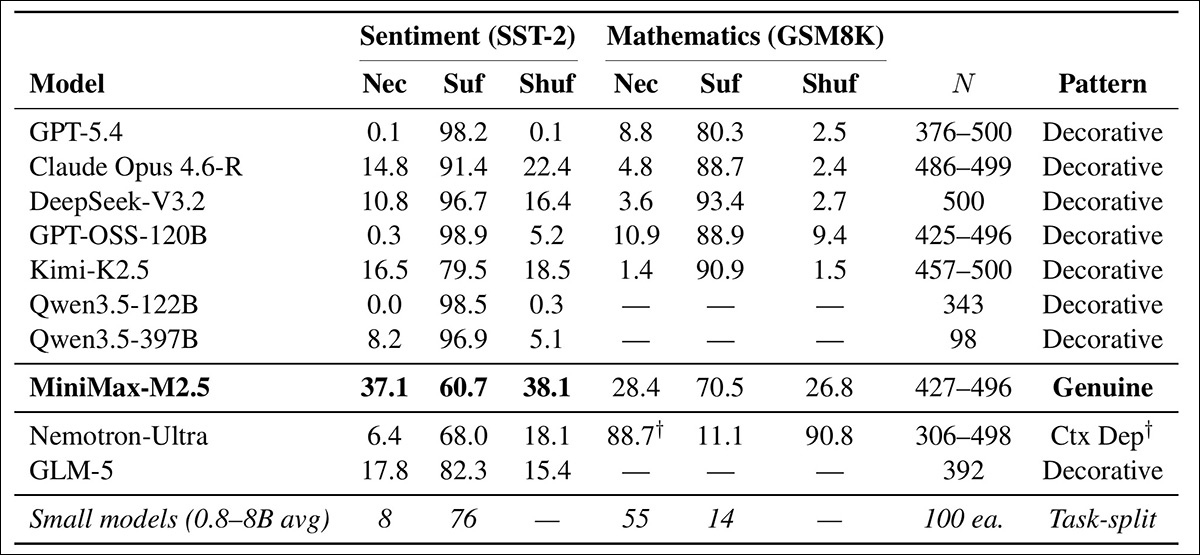

Os dez modelos que utilizam principalmente APIs e foram testados com a abordagem ICE revisada foram: Bate-papoGPT-5.4; Claude Opus 4.6-R; DeepSeek-V3.2; GPT-OSS-120B; Kimi-K2.5; Qwen3.5-397B; Qwen3.5-122B; MiniMax-M2.5; GLM-5; e Nemotron-Ultra (parâmetros 253B).

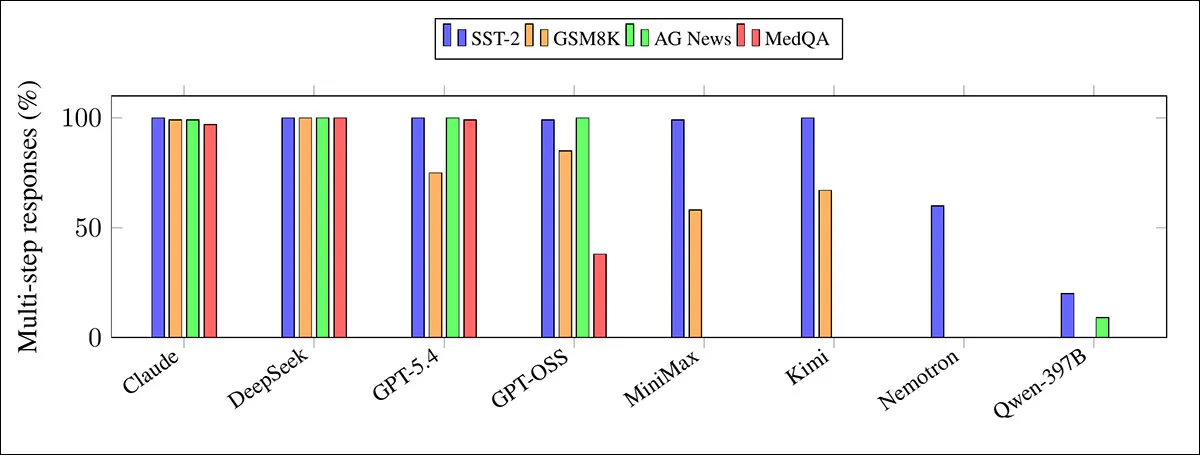

Cada modelo foi testado em quatro tarefas: classificação de sentimentos (usando (SST-2); problemas matemáticos com enunciados (usando GSM8K); classificação de tópicos (usando Notícias AG); e perguntas e respostas médicas (usando (MedQAOs testes iniciais foram em Sentimento e Matemática:

Testes para dez dos principais modelos de linguagem, avaliando como eles lidam com o raciocínio passo a passo. 'Necessidade' verifica se a remoção de uma etapa altera a resposta; 'suficiência' verifica se uma única etapa ainda pode produzir a resposta; e 'embaralhamento' testa se a ordem importa. A maioria dos modelos fornece explicações convincentes, mas não essenciais, para SST-2 e GSM8K, enquanto o MiniMax-M2.5 se baseia mais em suas etapas para a análise de sentimentos. Tanto o MiniMax quanto o Kimi-K2.5 demonstram um raciocínio passo a passo mais genuíno na classificação de tópicos. fonte

Os autores afirmam, a respeito desses resultados:

A maioria dos modelos exibe o que chamamos de "Raciocínio Decorativo" (Passos de Sorte na taxonomia ICE) – um padrão em que a necessidade de passos é inferior a 17% e a suficiência de passos excede 60%, tanto em termos de sentimento quanto de matemática.

Em outras palavras: você pode remover qualquer etapa de raciocínio e a resposta quase nunca muda, mas qualquer etapa isolada é suficiente para recuperar a resposta.

No teste de sentimento SST-2, o GPT-5.4 quase nunca se baseou em seu raciocínio escrito, visto que remover uma etapa alterava a resposta. apenas 0.1% de 500 casos, indicando que a explicação foi adicionada depois que a decisão já havia sido tomada.

Claude Opus 4.6-R dependia ligeiramente mais de seus passos, com 14.8%, mas 91% de seus passos por si só ainda podiam produzir a resposta; portanto, suas explicações mais longas eram mais detalhadas, mas ainda em sua maioria 'ornamentais'.

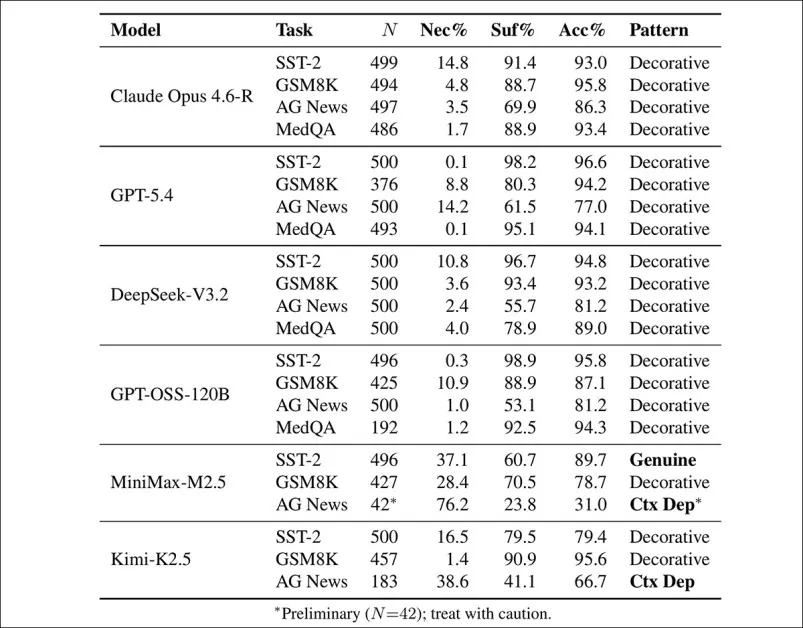

Em seguida, os pesquisadores adicionaram os outros domínios e testaram novamente:

Fidelidade e precisão em nível de passo em quatro domínios: SST-2; GSM8K; AG News; e MedQA. A maioria dos pares modelo-tarefa permaneceu "decorativa", apesar da alta precisão, com algumas exceções: MiniMax-M2.5 e Kimi-K2.5 exibem raciocínio dependente do contexto ou genuinamente dependente do passo no AG News, enquanto o desempenho geral confirmou que a baixa fidelidade não foi explicada por palpites aleatórios.

Os autores observam:

Os resultados dos quatro domínios reforçam a descoberta central: o raciocínio decorativo é universal em todos os domínios para os modelos de atalho. Claude Opus mostra 1.7% de necessidade no MedQA (486 exemplos, 93.4% de precisão) – o modelo escreve cadeias de raciocínio médico detalhadas com uma média de 5.8 etapas, mas remover qualquer etapa quase nunca altera o diagnóstico.

A AG News mostrou as maiores diferenças entre os modelos, com o Kimi-K2.5 e o MiniMax realmente se baseando em seu raciocínio passo a passo, enquanto a maioria dos outros sistemas produz explicações que oferecem pouco efeito na resposta final.

O DeepSeek-V3.2, testado em todas as quatro tarefas, manteve-se meramente decorativo; apesar de apresentar as explicações mais longas, suas respostas raramente dependiam das etapas.

Rigidez de saída

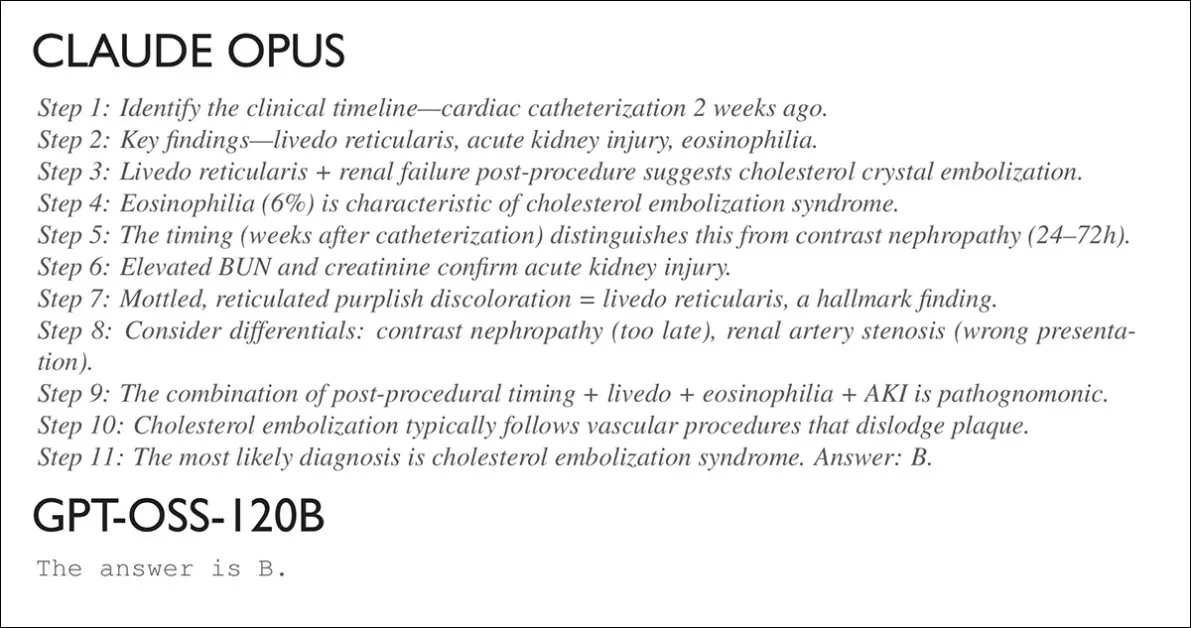

Os testes indicaram um quarto fenômeno em ação, que os autores denominaram rigidez de saídaAlguns modelos simplesmente não demonstram inclinação para apresentar processos de raciocínio, dependendo também do tópico e, possivelmente, de outras circunstâncias. Abaixo, vemos o raciocínio de Claude Opus ao responder a uma pergunta sobre o estado de saúde de um homem de 61 anos; e, abaixo, a saída do GPT-OSS-120B:

Verbosidade versus reticência.

Os autores observam que a rigidez da saída depende da tarefa:

Em diferentes tarefas, os modelos variam bastante na frequência com que optam por "mostrar seu raciocínio". Claude e DeepSeek produzem explicações de várias etapas quase sempre, independentemente do domínio, ao contrário do Qwen3.5-397B, que raramente o faz. Outros modelos adaptam seu comportamento dependendo da tarefa, alguns produzindo cadeias lógicas detalhadas para classificação, mas muito menos para questões médicas.

Eles observam:

'Os modelos com maior probabilidade de ignorar o raciocínio interno são também os que têm maior probabilidade de omitir o raciocínio externo. O GPT-OSS-120B produz raciocínio em várias etapas para 99% das perguntas sobre sentimentos e 100% das perguntas de classificação de tópicos, mas apenas para 38% das perguntas médicas. Em 62% das consultas médicas, ele fornece apenas uma letra como resposta.'

O padrão não parece ser aleatório: o GPT-OSS-120B produz explicações em várias etapas para quase todos os itens de classificação de sentimento e tópico, mas muda para uma resposta de uma única letra na maioria das questões médicas (onde geralmente não fornece nenhum raciocínio visível).

Os autores levantam a hipótese de que, como os testes em nível de passo exigem cadeias escritas para análise, um modelo que responde em um único token não pode ser avaliado por esses métodos; a ausência de raciocínio externo, portanto, impede a medição direta.

O artigo conclui que os modelos selecionados para aplicações de alto risco precisam ser testados para fidelidade anteriormente precisãoe sugerem que um modelo 2% menos preciso, mas que raciocina genuinamente, pode ser preferível – sobretudo porque satisfaz as regulamentações da UE e outras regulamentações emergentes relativas à IA explicável. Atualmente, com base nas evidências encontradas no estudo, quase todos os LLMs capazes de CoT estão "trapaceando", quase sempre.

Conclusão

Este é um artigo interessante que oferece testes e discussões mais abrangentes sobre o assunto do que podemos abordar aqui, e recomendo ao leitor que consulte o material original.

A mensagem central, que dá continuidade às controvérsias do ano passado, é que as plataformas de IA de maior impacto podem estar dispostas a adotar práticas agressivas e desonestas, simulando padrões que seus modelos ainda não conseguem atender.

Além disso, a diferença entre a escala e as capacidades dos modelos de API abertos e os modelos de API fechados, como o ChatGPT, é tão considerável que, geralmente, não se pode inferir razoavelmente os efeitos dos modelos fechados a partir das instalações dos modelos abertos, o que aumenta a opacidade desses processos e padrões.

No entanto, é raro surgir uma metodologia de teste verdadeiramente "caixa branca" que possa abranger modelos de código aberto e fechado; mas soluções eficazes para "truques baratos" desse tipo provavelmente só surgirão quando entidades poderosas como a UE ameaçarem os resultados financeiros dos principais portais de IA.

*Minha conversão das citações inline dos autores em hiperlinks.

† O artigo não apresenta uma lista coesa desses modelos menores e inclui variantes adicionais de um mesmo modelo, tornando a elaboração de uma lista definitiva uma questão de dedução.

† † Ênfases dos autores.

Primeira publicação quarta-feira, 25 de março de 2026