Inteligência artificial

Um Verificador de Vieses Impulsionado por IA para Artigos de Notícias, Disponível em Python

Pesquisadores no Canadá, Índia, China e Austrália colaboraram para produzir um pacote Python gratuitamente disponível que pode ser efetivamente usado para detectar e substituir ‘linguagem injusta’ em cópias de notícias.

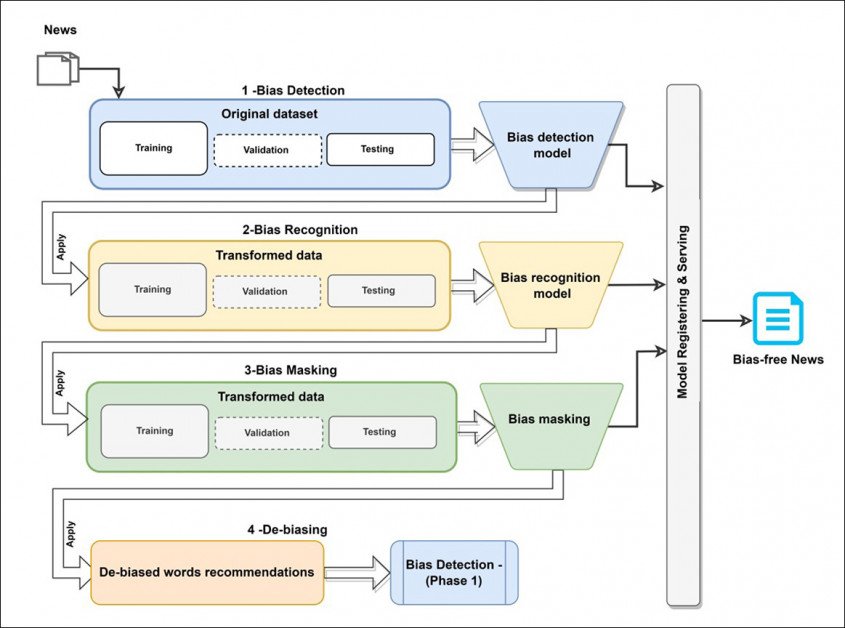

O sistema, intitulado Dbias, usa várias tecnologias de aprendizado de máquina e bancos de dados para desenvolver um fluxo de trabalho circular de três etapas que pode refinar texto tendencioso até que retorne uma versão não tendenciosa, ou pelo menos mais neutra.

Linguagem carregada em um trecho de notícia identificada como ‘tendenciosa’ é transformada em uma versão menos incendiária pelo Dbias. Fonte: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

O sistema representa um pipeline reutilizável e autocontido que pode ser instalado via Pip do Hugging Face e integrado a projetos existentes como uma etapa suplementar, adicional ou plugin.

Em abril, uma funcionalidade semelhante implementada no Google Docs foi criticada, não menos por sua falta de editabilidade. O Dbias, por outro lado, pode ser treinado de forma mais seletiva em qualquer corpus de notícias que o usuário final deseje, mantendo a capacidade de desenvolver diretrizes de justiça personalizadas.

A diferença crítica é que o pipeline Dbias pretende transformar automaticamente ‘linguagem carregada’ (palavras que adicionam uma camada crítica à comunicação factual) em linguagem neutra ou prosaica, em vez de educar o usuário de forma contínua. Em essência, o usuário final definirá filtros éticos e treinará o sistema de acordo; na abordagem do Google Docs, o sistema está – supostamente – treinando o usuário, de forma unilateral.

Arquitetura conceitual para o fluxo de trabalho do Dbias.

De acordo com os pesquisadores, o Dbias é o primeiro pacote de detecção de vieses verdadeiramente configurável, em contraste com os projetos de montagem pronta que caracterizaram este sub-setor do Processamento de Linguagem Natural (NLP) até o momento.

O novo artigo é intitulado Uma Abordagem para Garantir Justiça em Artigos de Notícias e vem de contribuintes da Universidade de Toronto, Universidade Metropolitana de Toronto, Gestão de Recursos Ambientais em Bangalore, Academia DeepBlue de Ciências na China e da Universidade de Sydney.

Método

O primeiro módulo no Dbias é Detecção de Vieses, que utiliza o pacote DistilBERT – uma versão altamente otimizada do BERT da Google. Para o projeto, o DistilBERT foi ajustado no conjunto de dados de Anotação de Vieses da Mídia (MBIC).

O MBIC consiste em artigos de notícias de várias fontes de mídia, incluindo o Huffington Post, USA Today e MSNBC. Os pesquisadores usaram a versão estendida do conjunto de dados.

Embora os dados originais tenham sido anotados por trabalhadores crowdsourced (um método que foi criticado no final de 2021), os pesquisadores do novo artigo foram capazes de identificar instâncias adicionais não rotuladas de vieses no conjunto de dados e anexá-las manualmente. Os incidentes identificados de vieses relacionados a raça, educação, etnia, linguagem, religião e gênero.

O próximo módulo, Reconhecimento de Vieses, usa Reconhecimento de Entidades Nomeadas (NER) para individuar palavras tendenciosas do texto de entrada. O artigo afirma:

‘Por exemplo, a notícia “Não compre a hipótese pseudo-científica sobre tornados e mudanças climáticas” foi classificada como tendenciosa pelo módulo de detecção de vieses anterior, e o módulo de reconhecimento de vieses pode agora identificar o termo “hipótese pseudo-científica” como uma palavra tendenciosa.’

NER não é especificamente projetado para esta tarefa, mas foi usado anteriormente para identificação de vieses, notadamente para um projeto de 2021 da Universidade de Durham no Reino Unido.

Para esta etapa, os pesquisadores usaram RoBERTa combinado com o pipeline NER SpaCy English Transformer.

A próxima etapa, Máscara de Vieses, envolve uma máscara múltipla inovadora das palavras tendenciosas identificadas, que opera sequencialmente em casos de múltiplas palavras tendenciosas identificadas.

Linguagem carregada é substituída por linguagem pragmática na terceira etapa do Dbias. Observe que ‘mouthing’ e ‘using’ equivalem à mesma ação, embora o primeiro seja considerado pejorativo.

Se necessário, o feedback desta etapa será enviado de volta ao início do pipeline para avaliação adicional até que um número de frases ou palavras alternativas adequadas tenham sido geradas. Esta etapa usa Modelagem de Linguagem Mascaramento (MLM) ao longo das linhas estabelecidas por uma colaboração de 2021 liderada pela Facebook Research.

Normalmente, a tarefa MLM mascarará 15% das palavras aleatoriamente, mas o fluxo de trabalho do Dbias diz ao processo para usar as palavras tendenciosas identificadas como entrada.

A arquitetura foi implementada e treinada no Google Colab Pro em um NVIDIA P100 com 24GB de VRAM em um tamanho de lote de 16, usando apenas duas etiquetas (tendencioso e imparcial).

Testes

Os pesquisadores testaram o Dbias contra cinco abordagens comparáveis: LG-TFIDF com Regressão Logística e TfidfVectorizer (TFIDF) incorporações de palavras; LG-ELMO; MLP-ELMO (uma rede neural artificial feed-forward contendo incorporações ELMO); BERT; e RoBERTa.

As métricas usadas para os testes foram precisão (ACC), precisão (PREC), recall (Rec) e uma pontuação F1. Como os pesquisadores não tinham conhecimento de nenhum sistema existente que pudesse realizar todas as três tarefas em um único pipeline, foi feita uma dispensação para os frameworks concorrentes, avaliando apenas as tarefas principais do Dbias – detecção e reconhecimento de vieses.

Resultados dos testes do Dbias.

O Dbias superou os resultados de todos os frameworks concorrentes, incluindo aqueles com uma pegada de processamento mais pesada