Liderzy opinii

Co każdy naukowiec danych powinien wiedzieć o Graph Transformers i ich wpływie na dane strukturalne

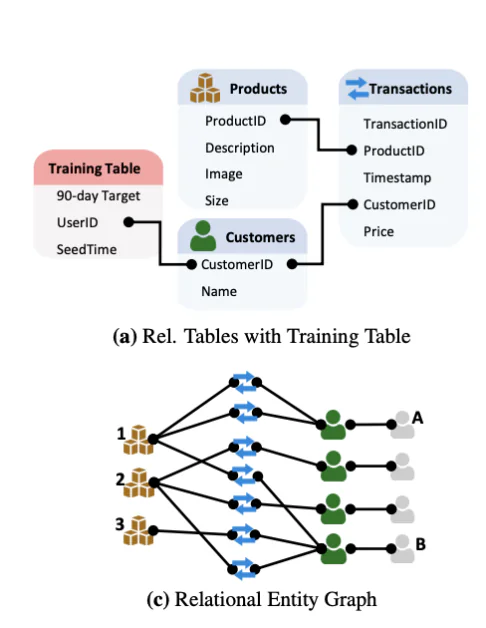

Współtworzyłem Graph Neural Networks podczas mojego pobytu na Stanford. Zrozumiałem wcześnie, że ta technologia jest niesamowicie potężna. Każdy punkt danych, każda obserwacja, każdy kawałek wiedzy nie istnieje w izolacji; jest częścią grafu połączonego z innymi kawałkami wiedzy. Co więcej, większość cennych danych biznesowych, często przechowywanych w postaci tabel w bazach danych i magazynach danych, może być naturalnie reprezentowana jako graf. Wykorzystanie tej relacyjnej struktury jest kluczem do budowy dokładnych i niehalucynujących modeli AI.

Sieci neuronowe grafów (GNN) wprowadziły architektury przekazywania wiadomości, które mogły rozumować nad grafami, przechwytując połączenia między kawałkami wiedzy. Ale tak jak Transformers przekształcili zrozumienie języka, nowa klasa modeli, Graph Transformers, przynosi podobne korzyści danych opartym na grafach. Te modele łączą elastyczność mechanizmów uwagi z strukturalnymi a priori grafu, aby modelować złożone relacje bardziej efektywnie niż ich poprzednicy GNN.

Dlaczego grafy potrzebują więcej niż przekazywanie wiadomości

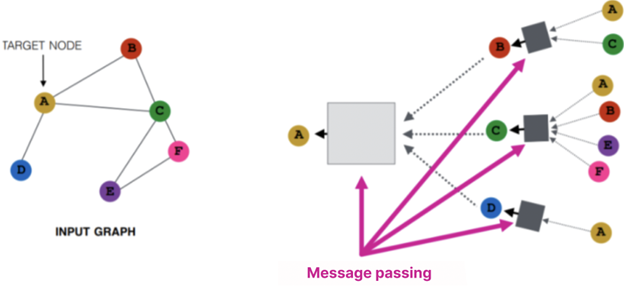

Tradycyjne sieci neuronowe grafów (GNN) opierają się na przekazywaniu wiadomości, procesie, w którym każdy węzeł aktualizuje swój stan wewnętrzny, agregując informacje od swoich sąsiadów. Wyobraź sobie to jako każdy węzeł wymieniający podsumowania z pobliskimi węzłami, a następnie używający tych podsumowań do udoskonalenia swojego własnego zrozumienia. Przez wiele warstw pozwala to na propagację informacji przez graf.

Chociaż potężne w nauce lokalnych wzorców, przekazywanie wiadomości ma ważne ograniczenia:

- Przesadne ściskanie: Podczas gdy informacje są agregowane przez wiele skoków, mogą one stać się ściśnięte, tracąc znaczące szczegóły. Jest to szczególnie problematyczne w głębokich GNN.

- Ograniczony kontekst: Standardowe przekazywanie wiadomości nie może łatwo przechwycić dalekosiężne zależności bez wielu warstw, co zwiększa złożoność i hałas.

- Ekspresywność: Wiele struktur grafu nie może być różnicowanych przy użyciu tylko informacji o sąsiedztwie, ograniczając wydajność modelu w zadaniach wymagających drobnych strukturalnych różnic.

To tutaj Graph Transformers wkraczają. Poprzez zastąpienie lub uzupełnienie przekazywania wiadomości mechanizmami uwagi, pozwalają każdemu węzłowi bezpośrednio zwrócić uwagę na inny (nawet odległy) na podstawie nauczonej ważności. Wynikiem są bogatsze reprezentacje, lepsza skalowalność i możliwość rozumowania nad złożonymi strukturami w bardziej elastyczny sposób.

Od GNN do Graph Transformers

Oryginalny model Transformer, wprowadzony w ikonicznym artykule, Attention Is All You Need, został zaprojektowany do modelowania relacji między tokenami w sekwencji. Jego sukces leży w self-uwadze, mechanizmie, który pozwala każdemu wejściu rozważyć każde inne wejście, ważone przez nauczoną istotność.

Graph Transformers adaptują ten paradygmat, pozwalając węzłom zwrócić uwagę nie tylko na swoich sąsiadów, ale na każdy węzeł w grafie, albo przez w pełni połączone uwagi, albo hybrydowy podejście, które balansuje globalne i lokalne sygnały. Wyzwaniem jest wprowadzenie pojęcia struktury do modelu zaprojektowanego dla nieustrukturyzowanych sekwencji.

Specyficzne dla grafu kodowania pozycyjnego

W przeciwieństwie do tekstu, grafy nie mają wewnętrznej kolejności, co sprawia, że kodowanie pozycyjne, które odnosi się do technik wstrzykiwania strukturalnej lub lokalizacyjnej informacji do modelu, jest nie trywialne. Graph Transformers rozwiązują to za pomocą różnych metod:

- Laplacian Eigenvectors: Pochodzące z macierzy Laplacian grafu, zapewniają one widmowe osadzanie, które przechwytuje globalną strukturę.

- Losowe spacery: Przechwytują one prawdopodobieństwo przejścia z jednego węzła do innego w ciągu wielu skoków.

- Kodowania strukturalne: Obejmują one miary odległości, stopnie węzłów lub typy krawędzi.

Te kodowania pozycyjne, czy to spektralne, prawdopodobne, czy strukturalne, dają Graph Transformers sposób zrozumienia, gdzie każdy węzeł znajduje się w ramach szerszego grafu. To świadomość strukturalna jest niezbędna do umożliwienia mechanizmom uwagi działania w sposób znaczący na nieregularnych, nieuporządkowanych danych, ostatecznie pozwalając modelowi przechwycić relacje, które byłyby niewidoczne dla prostszych, czysto lokalnych metod.

Wdrożenia w świecie rzeczywistym i przypadki użycia

Wprowadzenie Graph Transformers do produkcji wymaga infrastruktury, która może skalować się do rozmiarów danych w świecie rzeczywistym. Biblioteki takie jak PyTorch Geometric (PyG) czynią to możliwe. Zbudowany na PyTorch, PyG zapewnia modułowy framework do wdrażania GNN i Graph Transformers w różnych aplikacjach, od modelowania molekuł do systemów rekomendacji. Obsługuje szkolenie mini-batch na wielu małych grafach i jednym dużym grafie, z obsługą wielu procesorów graficznych i torch.compile, co sprawia, że jest on odpowiedni zarówno dla badań, jak i przepływów pracy przedsiębiorstw.

Te narzędzia już teraz napędzają szeroki zakres aplikacji w świecie rzeczywistym. W odkryciu leków Graph Transformers pomagają przewidywać właściwości molekuł, modelując interakcje atomowe jako grafy. W logistyce i optymalizacji łańcucha dostaw mogą one reprezentować i rozumować nad dynamicznymi sieciami wysyłek, magazynów i tras. Firmy e-commerce używają ich do poprawy rekomendacji, rozumiejąc współzakup i zachowania przeglądania jako relacyjne grafy. A w cyberbezpieczeństwie modele oparte na grafach są używane do wykrywania anomalii, analizując wzorce dostępu, topologię sieci i sekwencje zdarzeń.

W każdym z tych ustawień zdolność do uczenia się z złożonych, połączonych struktur, bez polegania wyłącznie na ręcznie wytworzonych funkcjach, okazuje się być znaczącą zaletą.

Uwagi techniczne

Pomimo ich potencjału, Graph Transformers wiążą się z prawdziwymi kompromisami inżynieryjnymi. Pełna uwaga self skali się kwadratowo z liczbą węzłów, co sprawia, że wydajność pamięci i obliczeniowa jest najwyższym priorytetem, szczególnie dla dużych lub gęstych grafów. Wiele grafów w świecie rzeczywistym ma również kierunkowe krawędzie, wprowadzając asymetrie, które utrudniają, w jaki sposób informacja strukturalna jest zakodowana. A w praktycznych wdrożeniach dane wejściowe rzadko są jednolite: łączenie danych o strukturze grafu z tekstem, szeregiem czasowym lub obrazami wymaga starannych wyborów architektonicznych i solidnej przetwarzania danych.

Te wyzwania nie są niepokonalne, ale wymagają przemyślanego projektowania systemu, szczególnie podczas przechodzenia od prototypów badawczych do modeli gotowych do produkcji.

Co dalej: LLM spotyka się z grafami

Głównym kierunkiem badań jest integracja dużych modeli językowych (LLM) z strukturami grafu. Te hybrydowe systemy używają LLM do kodowania kontekstu tekstowego lub wyodrębniania encji, a następnie umieszczają tę informację w grafie do celów rozumowania i podejmowania decyzji.

W biologii to napędzało narzędzia takie jak AlphaFold. W przedsięwzięciu AI umożliwia systemy wsparcia klienta, które łączą dokumentację i grafy zachowań. Graph Transformers odgrywają również coraz większą rolę w umożliwianiu agentom AI podejmowaniu bardziej inteligentnych, aktywnych decyzji, pozwalając im rozumować nad reprezentacjami stanu strukturalnego i priorytetem interakcji dynamicznie. To połączenie pomaga agentom lepiej zrozumieć hierarchiczne relacje, śledzić zależności w czasie i dostosowywać swoje zachowanie w złożonych środowiskach.

Dziedzina jest nadal w powijakach, ale potencjał jest znaczący.

Podsumowanie

Graph Transformers nie są po prostu następną iteracją GNN; reprezentują one konwergencję uwagi, struktury i skalowalności. Niezależnie od tego, czy pracujesz w finansach, naukach o życiu, czy systemach rekomendacji, wiadomość jest jasna: Twoje dane tworzą graf, więc Twoje modele również powinny.