Sztuczna inteligencja

Supercharging Graph Neural Networks with Large Language Models: The Ultimate Guide

Grafy są strukturami danych, które reprezentują złożone relacje w szerokim zakresie dziedzin, w tym sieci społeczne, bazy wiedzy, systemy biologiczne i wiele innych. W tych grafach, jednostki są reprezentowane jako węzły, a ich relacje są przedstawiane jako krawędzie.

Zdolność do skutecznego reprezentowania i rozumienia tych złożonych struktur relacyjnych jest kluczowa dla umożliwienia postępów w dziedzinach takich jak nauka o sieciach, chemia informacyjna i systemy rekomendacyjne.

Sieci neuronowe grafowe (GNN) wyłoniły się jako potężna ramy głębokiego uczenia się dla zadań uczenia maszynowego grafów. Poprzez włączenie topologii grafu do architektury sieci neuronowej za pomocą agregacji sąsiedztwa lub konwolucji grafowych, GNN mogą uczyć niskowymiarowych wektorowych reprezentacji, które kodują zarówno cechy węzłów, jak i ich role strukturalne. To pozwala GNN osiągać wyniki na poziomie stanu sztuki w zadaniach takich jak klasyfikacja węzłów, predykcja połączeń i klasyfikacja grafów w różnych dziedzinach aplikacji.

Podczas gdy GNN przyniosły znaczny postęp, niektóre kluczowe wyzwania pozostają. Uzyskanie wysokiej jakości danych etykietowanych do szkolenia nadzorowanego modelu GNN może być kosztowne i czasochłonne. Dodatkowo, GNN mogą mieć trudności z heterogenicznymi strukturami grafów i sytuacjami, w których dystrybucja grafu w czasie testowym znacznie różni się od danych szkoleniowych (uogólnienie poza dystrybucją).

Równolegle, duże modele językowe (LLM) takie jak GPT-4 i LLaMA wstrząsnęły światem swoimi niesamowitymi zdolnościami zrozumienia i generowania języka naturalnego. Szkolone na ogromnych korpusach tekstowych z miliardami parametrów, LLM wykazują zdumiewające zdolności uczenia się w kilku przypadkach, uogólniania na zadania i umiejętności rozumowania zdroworozsądkowego, które wcześniej uważano za niezwykle trudne dla systemów AI.

Olbrzymi sukces LLM wywołał poszukiwania wykorzystania ich mocy dla zadań uczenia maszynowego grafów. Z jednej strony, wiedza i zdolności rozumowania LLM prezentują możliwości poprawy tradycyjnych modeli GNN. Odwrotnie, ustrukturyzowane reprezentacje i wiedza faktograficzna wewnętrzna w grafach mogą być instrumentalne w rozwiązywaniu niektórych kluczowych ograniczeń LLM, takich jak halucynacje i brak interpretowalności.

Sieci Neuronowe Grafowe i Samonadzorowane Uczenie

Aby zapewnić niezbędny kontekst, najpierw krótko przypomnimy podstawowe pojęcia i metody w sieciach neuronowych grafowych i samonadzorowanym uczeniu reprezentacji grafów.

Architektury Sieci Neuronowych Grafowych

Architektura Sieci Neuronowej Grafowej – źródło

Kluczowa różnica między tradycyjnymi głębokimi sieciami neuronowymi a GNN polega na ich zdolności do działania bezpośrednio na strukturalnych danych grafowych. GNN stosują schemat agregacji sąsiedztwa, gdzie każdy węzeł agreguje wektory cech z sąsiednich węzłów, aby obliczyć swoją własną reprezentację.

Wiele architektur GNN zostało zaproponowanych z różnymi wariantami funkcji wiadomości i aktualizacji, takimi jak Graph Convolutional Networks (GCNs), GraphSAGE, Graph Attention Networks (GATs) i Graph Isomorphism Networks (GINs) wśród innych.

Niedawno graficzne transformatory zyskały na popularności, dostosowując mechanizm self-uwagi z transformatorów języka naturalnego do działania na strukturalnych danych grafowych. Przykłady obejmują GraphormerTransformer i GraphFormers. Te modele są w stanie uchwycić dalekosiężne zależności w całym grafie lepiej niż czysto oparte na sąsiedztwie GNN.

Samonadzorowane Uczenie na Grafach

Podczas gdy GNN są potężnymi modelami reprezentacyjnymi, ich wydajność jest często ograniczona przez brak dużych zestawów danych etykietowanych wymaganych do nadzorowanego szkolenia. Samonadzorowane uczenie wyłoniło się jako obiecująca para dyga do wstępnego szkolenia GNN na nieetykietowanych danych grafowych, wykorzystując zadania pretekstowe, które wymagają tylko wewnętrznej struktury grafu i cech węzłów.

Samonadzorowane Grafy – źródło

Niektóre powszechne zadania pretekstowe używane do samonadzorowanego wstępnego szkolenia GNN obejmują:

- Predykcja Właściwości Węzłów: Losowe maskowanie lub uszkadzanie części atrybutów węzłów i zlecanie GNN ich odtworzenie.

- Predykcja Krawędzi/Połączeń: Uczenie się, aby przewidzieć, czy krawędź istnieje między parą węzłów, często na podstawie losowego maskowania krawędzi.

- Uczenie Kontrastowe: Maksymalizacja podobieństw między widokami tego samego grafu, a jednocześnie oddalanie widoków z różnych grafów.

- Maksymalizacja Wzajemnej Informacji: Maksymalizacja wzajemnej informacji między lokalnymi reprezentacjami węzłów a docelową reprezentacją, taką jak globalna reprezentacja grafu.

Zadania pretekstowe takie jak te pozwalają GNN wydobywać znaczące strukturalne i semantyczne wzorce z nieetykietowanych danych grafowych podczas wstępnego szkolenia. Wstępnie wytrenowany GNN może następnie zostać dostrojony na stosunkowo małych etykietowanych podzbiorach, aby wyróżniać się w różnych zadaniach podrzędnych, takich jak klasyfikacja węzłów, predykcja połączeń i klasyfikacja grafów.

Poprzez wykorzystanie samonadzorowania, GNN wstępnie wytrenowane na dużych nieetykietowanych zestawach danych wykazują lepszą uogólnialność, wytrzymałość na przesunięcia dystrybucji i wydajność w porównaniu z treningiem od podstaw. Jednak niektóre kluczowe ograniczenia tradycyjnych metod samonadzorowanych GNN pozostają, które będziemy wykorzystywać do wykorzystania LLM w celu ich rozwiązania.

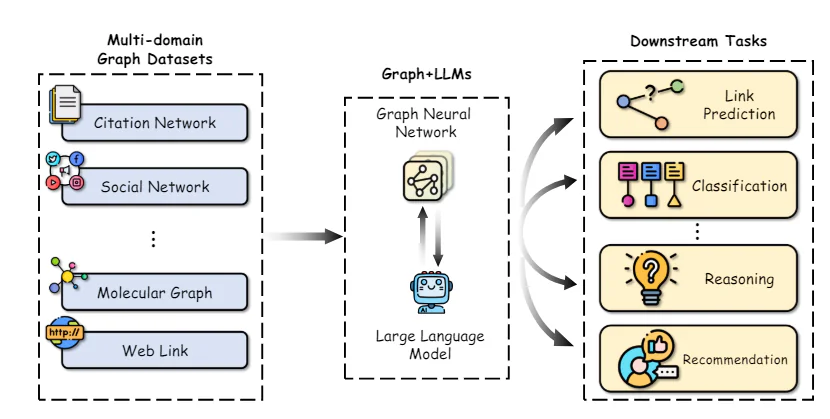

Wzmacnianie Uczenia Maszynowego Grafów z Dużymi Modelami Językowymi

Integracja Grafów i LLM – źródło

Znaczne zdolności LLM w zrozumieniu języka naturalnego, rozumowaniu i uczeniu się w kilku przypadkach prezentują możliwości poprawy wielu aspektów potoków uczenia maszynowego grafów. Eksplorujemy niektóre kluczowe kierunki badań w tym obszarze:

Kluczowym wyzwaniem w stosowaniu GNN jest uzyskanie wysokiej jakości reprezentacji cech dla węzłów i krawędzi, zwłaszcza gdy zawierają one bogate atrybuty tekstowe, takie jak opisy, tytuły lub abstrakty. Tradycyjnie proste worki słów lub wstępnie wytrenowane modele osadzania słów były używane, które często nie są w stanie uchwycić nuansów semantyki.

Niedawne prace wykazały potęgę wykorzystania dużych modeli językowych jako kodera tekstowego do konstrukcji lepszych reprezentacji cech węzłów/ krawędzi przed przekazaniem ich do GNN. Na przykład, Chen et al. wykorzystują LLM takie jak GPT-3 do kodowania atrybutów tekstowych węzłów, pokazując znaczne zyski wydajności w porównaniu z tradycyjnymi osadzaniem słów w zadaniach klasyfikacji węzłów.

Poza lepszymi kodowaniem tekstowym, LLM mogą być używane do generowania uzupełnionych informacji z oryginalnych atrybutów tekstowych w półnadzorowanym sposób. TAPE generuje potencjalne etykiety/wyjaśnienia dla węzłów za pomocą LLM i używa ich jako dodatkowych uzupełnionych cech. KEA wydobywa terminy z atrybutów tekstowych za pomocą LLM i uzyskuje szczegółowe opisy tych terminów, aby uzupełnić cechy.

Poprzez poprawę jakości i wyrażalności wejściowych cech, LLM mogą przekazać swoje wyższe zdolności zrozumienia języka naturalnego do GNN, zwiększając wydajność w zadaniach podrzędnych.