Kąt Andersona

Wykorzystanie serialu “House” do rozwoju możliwości diagnostycznych AI

Chociaż diagnozowanie rzadkich chorób jest szczególnie trudnym wyzwaniem dla AI (tak jak dla ludzi), popularne modele językowe ChatGPT i Gemini wykazują obiecujące wyniki, gdy są szkolone na przypadkach diagnostycznych z popularnego serialu medycznego “House”.

Blisko połowa wszystkich studentów nauk o zdrowiu regularnie ogląda seriale medyczne, takie jak House, Grey’s Anatomy i Scrubs. Chociaż tego rodzaju materiał może być używany tylko do celów dydaktycznych z dużą filtracją i ramowaniem, ze względu na ryzyko rozpowszechniania niebezpiecznych nieprawidłowości, poziom badań nad serialami medycznymi tendencji jest dość wysoki (chociaż dokładność różni się w zależności od produkcji).

Nie jest zaskakujące, że lekarze często pochodzą, doradzają lub piszą scenariusze do seriali medycznych. W takich przypadkach, obszerna wiedza medyczna jest korzystna nie tylko do dokładnego przekazywania problemów medycznych, ale także do generowania sugestii nowych i interesujących wątków.

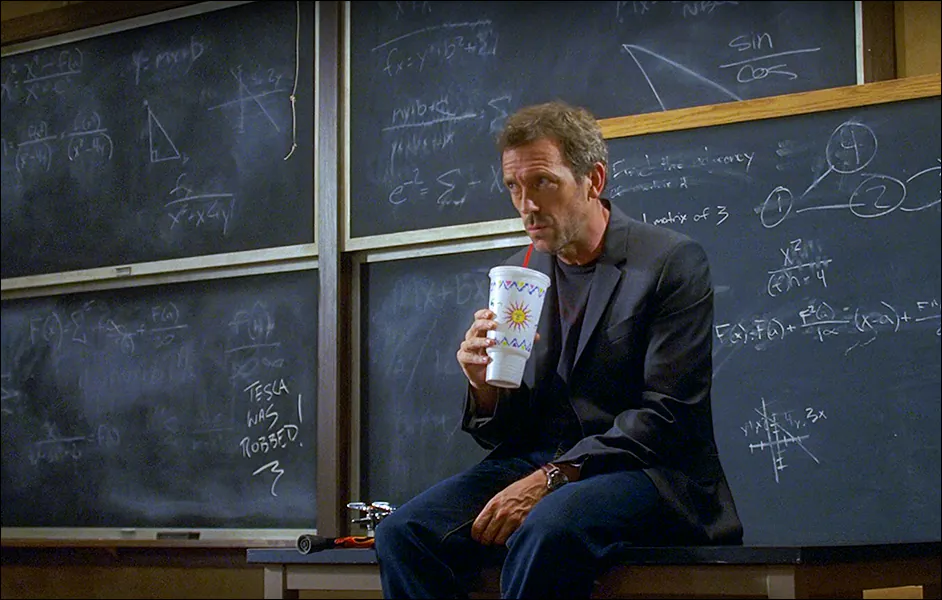

Jednym z najbardziej starannie zbadanych seriali medycznych ostatniej “złotej ery” telewizji jest House (znany również jako House MD), w którym ekscentryczność głównego bohatera i duże wahania w obsadzie, jakkolwiek były zabawne, zajmowały drugie miejsce wobec “choroby tygodnia”.

W rzeczywistości, spośród 177 odcinków wyemitowanych w ciągu ośmiu sezonów, House dostarczył 176 studialnych przypadków diagnostycznych. Chociaż serial zakończył się w 2012 roku, do 2015 roku był już wykorzystywany jako narzędzie dydaktyczne, z specjalnym seminariem Dr. House, który oferował lepsze wyniki w porównaniu ze standardowym seminariem, nawet jeśli uczestnictwo nie przynosiło punktów za studia:

Z badania z 2015 roku, różne powody, dla których studenci medycyny chcieli uczestniczyć w seminariach diagnostycznych, które wykorzystywały informacje z serialu “House”. Seminaria były zaplanowane na celowo trudny czas, i nie przynosiły punktów za studia; pomimo tych czynników, inicjatywa była sukcesem. Źródło

House i AI

Chociaż użycie House i innych różnych seriali telewizyjnych zostało udowodnione w wielu badaniach jako skuteczne narzędzie pomocnicze do nauki, dla studentów medycyny, niewiele z tego podejścia zostało dotychczas podjęte w kontekście uczenia maszynowego.

Teraz, nowy artykuł z Uniwersytetu Stanu Pensylwania uczynił pierwszy krok w tym kierunku, rozwijając zestaw danych zawierający wszystkie 176 przypadków diagnostycznych House, sformułowanych w narracyjnej strukturze diagnostycznej, a następnie ocenionych na popularnych modelach LLM od OpenAI i Google.

Pomimo trudności tego wyzwania (które charakteryzuje się jednym z najtrudniejszych dziedzin biologicznych), badacze stwierdzili, że nowsze wersje ChatGPT i Gemini wykazały poprawę w porównaniu ze starszymi wersjami, co wskazuje, że ewolucyjny trend rozwoju modeli jest prawdopodobnie skuteczny w procesach diagnostycznych w czasie.

Artykuł stwierdza:

‘Wyniki pokazują znaczącą zmienność w wydajności, od 16,48% do 38,64% dokładności, przy czym nowsze generacje modeli wykazują 2,3-krotną poprawę. Chociaż wszystkie modele stają przed znaczącymi wyzwaniami w diagnozowaniu rzadkich chorób, zaobserwowana poprawa w architekturach wskazuje na obiecujące kierunki rozwoju w przyszłości.

‘Nasza edukacyjnie zwalidowana baza danych ustanawia podstawowe wskaźniki wydajności dla narracyjnego rozumowania medycznego i zapewnia publicznie dostępny framework oceny dla rozwoju badań nad diagnostyką wspomaganą przez AI.’

Oprócz ustanowienia wskaźników wydajności, którymi można porównywać przyszłe wysiłki, autorzy zauważają, że nowy zestaw danych – który udostępniają publicznie – rozwiązuje brak procesu narracyjnego w istniejących zestawach danych medycznych, i jest łatwo dostępny, w przeciwieństwie do kultury standardowych zestawów danych medycznych.

Nowa praca pt. Evaluating Large Language Models on Rare Disease Diagnosis: A Case Study using House M.D, pochodzi od czterech badaczy z Penn State*.

Dane

Aby zaludnić swój zestaw danych, autorzy wykorzystali publicznie dostępny materiał z długo utrwalonej House Wiki strony fandom. Treści narracyjne zostały wyodrębnione i destylowane przy użyciu popularnego frameworku Beautiful Soup, który może wyodrębnić dane strukturalne z kodu HTML stron internetowych.

Po wyodrębnieniu podstawowych narracji w ten sposób, cztery modele LLM zostały wykorzystane do przekształcenia danych wyjściowych w standardowy format przypadków. Modele, które zostały wykorzystane, to GPT-4o mini; GPT-5 Mini; Gemini 2.5 Flash; oraz Gemini 2.5 Pro. Na koniec, zastosowano filtrowanie jakości, aby zapewnić, że zestaw danych miał odpowiednią zawartość kliniczną i zgodność z obecnym stanem sztuki w rozumowaniu medycznym.

Autorzy zauważają, że ‘sierocymi’ chorobami (tzw. rzadkimi chorobami) są niedoreprezentowane w standardowych bazach danych medycznych; w pewnych przypadkach, ich pokrycie w serialu House może stanowić niezwykły odsetek ich łącznej istniejącej pokrycia.

Autorzy przyznają, że użyteczność źródła danych tego typu musi być ostrożnie ważona w odniesieniu do artystycznej swobody, która może być priorytetem w rozwoju dramatu medycznego:

‘Chociaż nasz zestaw danych odzwierciedla ograniczenia fikcyjnej treści, w tym dramatyczne wyolbrzymienia i złożone przypadki, te cechy mogą korzystnie wpłynąć na ocenę, dostarczając wyzwania, które testują wytrzymałość modeli.

‘Edukacyjna walidacja House M.D. przez profesjonalistów medycznych daje pewność, że wyodrębnione scenariusze zawierają klinicznie istotne informacje odpowiednie dla oceny AI.’

![Przykłady z zestawu danych wygenerowanego dla projektu. Źródło [ https://www.kaggle.com/datasets/arshgupta23/housemd-data-for-rare-disease-accuracy-using-llms?resource=download ]](https://www.unite.ai/wp-content/uploads/2025/11/dataset-examples.jpg)

Przykłady z zestawu danych wygenerowanego dla projektu. Źródło

Testy

Aby ocenić dokładność modeli w narracyjnych zadaniach diagnostycznych, autorzy zaprojektowali prosty potok łączący generowanie podpowiedzi, inferencję modelu i ocenę.

Cztery powyższe modele LLM zostały przetestowane, z każdym modelem skonfigurowanym z temperaturą ustawioną na zero (co zapewnia deterministyczne zamiast ‘kreatywne’ dane wyjściowe), i z maksymalną długością tokenu 1500 – co zostało zaprojektowane, aby pomieścić złożone rozumowanie diagnostyczne. Nie zostały wykorzystane dodatkowe systemowe podpowiedzi, aby dalej sformatować zapytania.

Same podpowiedzi przestrzegały standardowego formatu prezentacji przypadków medycznych – rodzaju, który widzowie znają najlepiej z medycznych dramatów, gdy nowy pacjent/choroba jest wprowadzony, a lekarz podsumowuje przegląd dla innych lekarzy (skutecznie, choć, dla widzów).

Każda podpowiedź przedstawiała narrację kliniczną, składającą się z danych demograficznych; wykresu objawów; istotnej historii medycznej; oraz wczesnych wyników diagnostycznych. Model został poinstruowany, aby zidentyfikować pojedynczą podstawową diagnozę i uzasadnić swoją konkluzję rozumowaniem.

Każdy model wygenerował swoją odpowiedź diagnostyczną w jednej przejściu, bez żadnej iteracyjnej poprawy; i odpowiedzi zostały zebrane w sposób spójny we wszystkich 176 przypadkach:

![Przykładowy przykład oceny, pokazujący narracyjną podpowiedź kliniczną i jej odpowiednią diagnozę, wykorzystaną do testowania Gemini 2.5 Pro. Źródło [ https://arxiv.org/pdf/2511.10912 ]](https://www.unite.ai/wp-content/uploads/2025/11/table-2-1.jpg)

Przykładowy przykład oceny, pokazujący narracyjną podpowiedź kliniczną i jej odpowiednią diagnozę, wykorzystaną do testowania Gemini 2.5 Pro. Źródło