Kąt Andersona

Totalna Odporność: Grupy Traktujące Sztuczną Inteligencję Jako Nieznośną Zanieczyszczenie

‘Zero-tolerance’ wobec treści generowanych przez sztuczną inteligencję staje się coraz bardziej atrakcyjną opcją w obliczu rosnących problemów prawnych, etycznych i związanych z użytkownikami wokół sztucznej inteligencji; ale czy tego rodzaju ‘wycofanie’ jest praktyczną propozycją?

Opinia Każdy, kto używa mediów społecznościowych i innych rodzajów internetowych forów dyskusyjnych, mógł zauważyć, że w ostatnim czasie coraz więcej społeczności, forów i organizacji zawodowych całkowicie zakazuje używania generatywnej sztucznej inteligencji, gdyż ekonomiczny wpływ tej technologii rozprzestrzenia się poza artystami i pisarzami, których protesty zapoczątkowały obecne obawy w 2023 roku.

Z powodu niepewnych konsekwencji prawnych i ekonomicznych rewolucji sztucznej inteligencji wciąż niepewnych, organizacje zmuszone są do podejmowania decyzji politycznych przed wyjaśnieniem pełnego obrazu – sytuacja skomplikowana przez pojawiające się przekonanie, że opóźniona adopcja może pozostawić je w niekorzystnej pozycji konkurencyjnej.

Sztuczna Inteligencja Jako Zanieczyszczenie

Decyzja o zakazie jest polityczna, z konsekwencjami; możliwość zakazu obejmuje jednak zarówno polityczne, jak i praktyczne pułapki, ponieważ historia zakazu rzeczy, których ludzie naprawdę chcą, jest najlepsze sprawdzona; a nawet likwidacja rzeczy, których nikt nie chce wymaga długoterminowych, ciągłych wysiłków.

W ten sposób, nawiedzony przez bardzo niezrozumianą historię luddystów, te społeczności i podmioty traktujące każdy ślad sztucznej inteligencji jako całkowicie nieznośny często przyjmują obronny ton, gdy ogłaszają lub dyskutują o zakazie sztucznej inteligencji.

Jak Amiszowie odkryli przez ostatnie stulecia, wycofanie się z technologi może być trudne do utrzymania; ściśle mówiąc, na przykład, ci, którzy przestrzegają zasad wegetarianizmu, nie mogą oglądać filmów zarejestrowanych na tradycyjnej błonie, lub nawet mieć rentgen. Podobnie, rezygnacja z fluoryzacji w krajach lub miastach, które ją przyjmują może być trudna.

Skutecznie, powszechna i popularna technologia jest zjawiskiem “atmosferycznym”, które nie łatwo pozwala na granice ustalone przez rosnącą liczbę grup i organizacji.

Środki Przedprawne

Jak wcześniej wspomniano, pierwsze bitwy przeciwko sztucznej inteligencji były toczone w najmniej deterministycznym i najbardziej interpretatywnym sektorze generatywnej sztucznej inteligencji – rozrywce. Kiedy Amerykańska Gildia Aktorów Ekranu – Amerykańska Federacja Artystów Radiowych i Telewizyjnych (SAG-AFTRA) walczyła o ochronę praw swoich członków w 2023 roku, ostatecznie udało im się wygrać kilka godnych uwagi ustępstw.

Od tego czasu nie było wielu tak zdecydowanych zwycięstw w odniesieniu do sztucznej inteligencji – a walka o klarowność prawną w różnych sektorach dopiero się zaczyna. Na przykład, większość nowej legislacji dotyczącej głębokich fałszerstw, szczególnie z Wielkiej Brytanii i USA, obejmuje sztuczną inteligencję tylko w szerszej kategorii przestępstw (takich jak niezgodne z prawem obrazy, prawdziwe lub fałszywe).

Wkrótce po zwycięstwie SAG-AFTRA, seria pozwów dotyczących wykorzystania prac innych rodzajów artystów zawsze jest w toku. Tymczasem wiele dotkniętych grup oczekuje na zatwierdzenie prawnego z lokalnymi przepisami.

Przed dalszym rozważaniem logiki i ograniczeń “całkowicie nieznośnego” podejścia do sztucznej inteligencji, przyjrzyjmy się kilku przypadkom, w których tego rodzaju polityka jest wprowadzana w życie.

Zakazy Sztucznej Inteligencji o Zero Tolerancji

Uwaga o Niezgodzie

Tylko w tym miesiącu, Bandcamp stał się pierwszą dużą platformą muzyczną online, która całkowicie zakazała treści sztucznej inteligencji. Zakaz został ogłoszony w oświadczeniu, które również stwierdziło ‘Muzyka i dźwięk generowany w całości lub w znacznej części przez sztuczną inteligencję nie są dozwolone na Bandcamp’.

Ten zakaz, jak w niemal wszystkich przypadkach, jest zmuszony do ograniczenia się trochę ze względu na wymieniony wcześniej “miasmatyczny” efekt sztucznej inteligencji. W innym miejscu oświadczenia stwierdza się, że muzyka, która ‘wygląda na całkowicie lub w dużej mierze wykonaną przy użyciu generatywnej sztucznej inteligencji’ jest objęta zakazem – pragmatyczne ograniczenie, ponieważ w większości dziedzin co najmniej niektóre treści sztucznej inteligencji są w stanie wyglądać całkowicie wykonane przez człowieka, zarówno dla ludzi, jak i dla stale ewoluującego sektora wykrywania sztucznej inteligencji.

Skutecznie, jest to szablon dla większości nowych polityk “zero tolerancji”, które wchodzą w życie: że nieznajomość sztucznej inteligencji jest usprawiedliwieniem w tych trudnych okolicznościach.

Po incydencie, w którym utwór muzyczny stworzony przez sztuczną inteligencję zdobył szwedzkie listy przebojów, IFPI Szwecja, szwedzka organizacja przemysłu muzycznego, zakazała muzyki generowanej przez sztuczną inteligencję z uwzględnieniem w listach – choć z charakterystycznym zastrzeżeniem, stwierdzającym* ‘Nasza zasada brzmi: jeśli jest to piosenka, która jest głównie generowana przez sztuczną inteligencję, nie ma prawa do miejsca na liście’.

Znowu, życzenie całkowitego zakazu sztucznej inteligencji jest tu uznane za niewykonalne; zakaz jest tajny i całkowity, ale wdrożenie jest skutecznie niemożliwe.

Efekt Komediowy

Fala prohibicji wobec treści generowanych przez sztuczną inteligencję przeszła przez scenę konwentów komiksowych w USA i poza nimi, w ciągu ostatniego roku. San Diego Comic-Con, który w 2024 roku nałożył ograniczenia handlowe na sztukę wytworzoną przez sztuczną inteligencję, ogłosił w tym miesiącu, że zakazuje treści sztucznej inteligencji, rzekomo w odpowiedzi na protest artystów.

Podobnie, we wrześniu ubiegłego roku New York Comic-Con wprowadził całkowity zakaz sprzedaży produktów lub treści generowanych przez sztuczną inteligencję, z oficjalną stroną stwierdzającą:

‘Produkt, materiał lub treść stworzona w całości lub w znacznej części przy użyciu generatywnych narzędzi lub algorytmów sztucznej inteligencji (“AI-Generated”) lub zawierająca elementy AI-Generated, w tym ale nie ograniczając się do sztuki wizualnej, obrazów lub grafik, animacji i/lub materiałów, są zabronione do sprzedaży na New York Comic Con.’

Znowu widzimy, że w “znacznej części” sformułowanie musi uznać trudność w identyfikowaniu całkowitej twórczej proweniencji jakiegokolwiek dzieła, co odzwierciedla wcześniejszy zakaz San Diego komercjalizacji wyjścia sztucznej inteligencji, a nie późniejszy całkowity zakaz treści sztucznej inteligencji. To powiedziawszy, ten approach jest dość skutecznym “deplatformingiem” treści sztucznej inteligencji w większości przypadków (choć takie prace mogłyby być nadal wykorzystywane jako karmienie komercyjnych platform).

Dalej, FanX Salt Lake comic convention wprowadził bardziej zdecydowany zakaz treści sztucznej inteligencji we wrześniu ubiegłego roku, z założycielem i producentem Danem Farrem, który skomentował:

‘Jeśli klienci przyjdą i kupią dzieło sztuki, a nie zdają sobie sprawy, że sztuczna inteligencja została użyta do jej stworzenia, mogą zapłacić dużo pieniędzy za to, nie zdając sobie sprawy, że to coś nie do końca cennego.’

Antyspołeczny

Wiele społeczności internetowych również przyjęło zero tolerancję wobec treści generowanych przez sztuczną inteligencję. W istocie, jest to jeden z najbardziej publicznych aspektów nietolerancji sztucznej inteligencji, i to rosnąca częstotliwość takich zakazów, która zwróciła moją uwagę na ten temat:

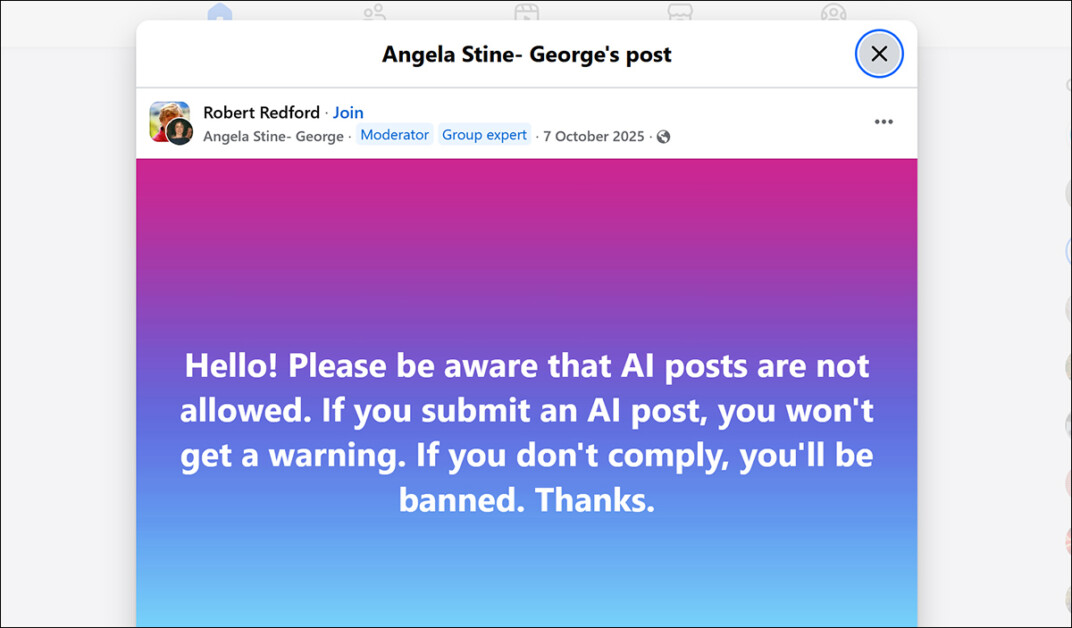

Typowy anty-sztuczna inteligencja edykt z Facebooka. Źródło

Reddit został szczególnie dotknięty, z moderatorami różnych dużych subredditów, którzy często zakazują wszystkich obrazów, sztuki lub tekstowych form (takich jak fikcja i programowanie) wytworzonych przez sztuczną inteligencję, gdy tylko takie posty zaczęły zalewać ich fora i obciążać ograniczone zasoby moderacji ludzkiej.

Bardzo wczesny przykład, z 2022 roku, był subreddit r/Dune, gdzie około 250 000 fanów zagłosowało, aby całkowicie zakazać sztuki generowanej przez sztuczną inteligencję, po tym, jak zostali zalani sztuką stworzoną przez sztuczną inteligencję. Moderatorzy podali wtedy:

‘Uznajemy, że wiele z tych dzieł jest interesujących do oglądania, a technologia jest naprawdę fascynująca, ale technicznie kwalifikuje się jako treść o niskim wysiłku – szczególnie w porównaniu z oryginalną, “ludzką” sztuką, którą chcielibyśmy priorytetowo traktować w przyszłości.’

Od tego czasu wiele subredditów (od r/lego do r/DataHoarder) podobnie ogłosiło, że każda treść nawet częściowo stworzona przez sztuczną inteligencję zostanie usunięta z widoku – przynajmniej, jak zawsze, tam, gdzie rozpoznawalna.

Podobne zakazy pojawiają się często na Facebooku. Jednakże, ponieważ Meta, firma macierzysta Facebooka, jest jednym z wiodących deweloperów sztucznej inteligencji na świecie, podczas gdy Reddit jest zamiast tego gorąco kontestowanym i poszukiwanym źródłem danych ludzkich, te zakazy tendencję do powodowania mniejszej kontrowersji.

Zakazy ChatGPT

Jedna szczególna kategoria “absolutnych” zakazów sztucznej inteligencji to częsty zakaz używania ChatGPT w środowiskach korporacyjnych lub wrażliwych (i w tym sensie, podobnie jak każdy model językowy oparty na chmurze, taki jak Claude lub Gemini).

Jednak te zakazy są zwykle inspirowane nie przez liberalne obawy wokół eksploatacji danych szkoleniowych, ale przez obawy, że OpenAI może ostatecznie przechowywać, przetwarzać lub nawet eksploatować wrażliwe dane przedsiębiorstwa ujawnione podczas rozmów z klientami.

Chociaż departamenty prawne mogą wspierać lub nawet inicjować zakazy korporacyjne na platformy ChatGPT, są one również prawdopodobnie rozważać, czy użycie danych z sieci do szkolenia systemów komercyjnych może narazić firmę lub jej klientów na przyszłe zobowiązania – szczególnie, jeśli trwające procesy przeciwko OpenAI lub podobnym podmiotom mogą skutkować znaczącymi wyrokami.

Przykłady zakazów ChatGPT† obejmują falę reakcyjnych zakazów w 2023 roku z Apple, Amazon, Spotify i Wells Fargo, wśród wielu innych. W tym samym roku badanie Cisco wykazało, że 27% organizacji, które wzięły udział w badaniu, wprowadziło podobne zakazy – nie na ChatGPT specyficznie, ale na użycie sztucznej inteligencji w ogóle.

W 2024 roku inne badanie wykazało, że 65% z pierwszych 20 firm farmaceutycznych zakazało pracownikom używanie ChatGPT.

Jest jasne, że wiele, jeśli nie wszystkie z wymienionych tu firm, prawdopodobnie będzie starało się skorzystać z sztucznej inteligencji w sposób, który lepiej odpowiada ich interesom; i że wiele z nich będzie utrzymywało lub rozwijało inne produkty sztucznej inteligencji do użytku wewnętrznego – lub nawet komercyjnych produktów API z lepszą ochroną własności intelektualnej niż może zaoferować OpenAI.

Wiele rządów, które są głównymi zwolennikami sztucznej inteligencji również zakazuje ChatGPT. Chociaż niektóre z nich, takie jak Kuba i Korea Północna, są oczywistymi kandydatami do tego rodzaju prohibicji, Chiny, obecnie uważane za wiodącego światła rewolucji sztucznej inteligencji, zakazują ChatGPT na poziomie rządowym – prawdopodobnie na rzecz rodzimych alternatyw.

Wnioski: O Zero Tolerancji

Jednym z problemów związanych z trendem w kierunku “absolutnych” zakazów sztucznej inteligencji (poza wyzwaniem identyfikacji treści sztucznej inteligencji) jest to, czy nieustępliwy zakaz jest naprawdę skuteczny. W rzeczywistości, łatwo jest niezrozumieć, co “zero tolerancji” tak naprawdę jest; co może osiągnąć; i jakie są dość ograniczone okoliczności, w których może osiągnąć swoje cele.

Na przykład, Nowy Jork, być może najbardziej związany z terminem “zero tolerancji”, był w stanie wstać z jego kryminalnego dna w latach 70. i 80. dzięki stopniowemu i ciągłemu zastosowaniu teorii “łamanych okien“, która stwierdza, że niezależnie od tego, jak biedny lub zamożny jest okolic, obecność jednego łamanego okna będzie skłaniać do dalszych łamanych okien – i ostatecznego eskalowania innych, poważniejszych przestępstw, ponieważ ciągła obecność początkowego łamanego okna sugeruje, że władze albo nie obserwują, albo nie dbają.

Dlatego “zero tolerancji” wobec “zarodkowego” przestępstwa łamania okna uważa się za mające korzyści na górze, ponieważ ten “przestępczy entropia” nigdy nie może uzyskać przyczółku; w ten sposób, poprzez zajmowanie się małymi rzeczami (takimi jak śmieci i łamane okna, które nie są drogimi problemami do rozwiązania), większe rzeczy (które kosztowałyby więcej do rozwiązania) zajmują się samymi sobą.

Przeprowadzony, jednak ten teoria (czasami krytykowany jako rasistowski) może brzmieć jak skrajny autorytaryzm, lub nawet faszyzm:

Kliknij, aby odtworzyć. Od jedynego filmu szkoleniowego, jaki kiedykolwiek zrobił John Ford, ‘OSS – Undercover Training’, przykład pozornie obsesji zero tolerancji w kontekście fałszywej kultury osi II wojny światowej. Źródło

Zamiast tego, “zero tolerancji” jest często utożsamiane w umysłach publicznych z “surowym, ale koniecznym” działaniem, takim jak nieustępliwe prawa, które większość krajów ma w odniesieniu do kar za krzywdzenie nieletnich – czyli jasne reguły dla dobra publicznego, skonkretyzowane w karne prawa, które inspirują niewiele debat lub kompromisów.

W rzeczywistości, ZT został zaprojektowany, aby osiągnąć odnowę miejską w budżecie, sugerując większe zasoby w publicznej arenie, niż tak naprawdę istnieją za kulisami; nie jest to szczególnie odpowiedni przypadek użycia do wkroczenia sztucznej inteligencji z powrotem do butelki.

I w praktyce, generatywna sztuczna inteligencja już jest tak powszechna, że twoje pozornie wolne od sztucznej inteligencji dane mogą już zawdzięczać coś sztucznej inteligencji – nawet jeśli jest to kodowanie wzmocnione sztuczną inteligencją w (nie fałszywym) filmie, który wykonałeś, przesłałeś do YouTube i opublikowałeś na swojej ulubionej platformie społecznościowej. Jeśli sztuczna inteligencja naprawdę staje się jak “kulturowy gaz”, wydaje się, że będzie się opierać wyraźnym granicom lub binarnym rozwiązaniom, takim jak “zakaz sztucznej inteligencji”.

* Mój nacisk.

† Który możemy uznać za reprezentatywny dla tej klasy LLM, a nie wyłącznego produktu, w tym sensie.