Etyka

Baza danych incydentów AI ma na celu uczynienie algorytmów AI bezpieczniejszymi

Każdy wystarczająco duży system będzie miał błędy, a częścią korekty tych błędów jest posiadanie bazy danych, której można analizować pod kątem wpływu i potencjalnych przyczyn. Podobnie jak FDA prowadzi bazę danych dla niepożądanych reakcji na leki, czy Narodowa Rada Bezpieczeństwa Transportu prowadzi bazę danych dla wypadków lotniczych, baza danych incydentów AI jest bazą danych zamierzoną do katalogowania awarii systemów AI i pomocy badaczom AI w opracowaniu nowych metod unikania tych awarii. Twórcy bazy danych incydentów AI (AIID) mają nadzieję, że pomoże ona firmom AI w tworzeniu bezpieczniejszych, bardziej etycznych systemów AI.

Co to jest AIID?

AIID jest produktem organizacji Partnership on AI (PAI). PAI została założona początkowo w 2016 roku przez członków zespołów badawczych AI w dużych firmach technologicznych, takich jak Facebook, Apple, Amazon, Google, IBM i Microsoft. Od tego czasu organizacja zwerbowała członków z wielu innych organizacji, w tym różnych organizacji non-profit. W 2018 roku PAI rozpoczęła tworzenie jednolitej normy klasyfikacji awarii AI. Nie było jednak zbioru incydentów AI, na którym można by było opierać tę klasyfikację. Dlatego PAI stworzyła AIID.

Według TechTalks, format AIID został ukształtowany przez strukturę bazy danych wypadków lotniczych prowadzonej przez Narodową Radę Bezpieczeństwa Transportu. Od momentu rozpoczęcia gromadzenia raportów w 1996 roku, system lotnictwa komercyjnego udało się zwiększyć bezpieczeństwo branży lotniczej poprzez archiwizację i analizę incydentów. Istnieje nadzieja, że podobny zbiór incydentów AI może uczynić systemy AI bezpieczniejszymi, bardziej etycznymi i niezawodnymi. AIID również zainspirowała się bazą danych Common Vulnerabilities and Exposures, która jest repozytorium znaczących awarii oprogramowania, które obejmują różne branże i dyscypliny.

Sean McGregor jest głównym konsultantem technicznym w IBM dla Watson AI XPRIZE. McGregor jest również odpowiedzialny za nadzorowanie rozwoju samej bazy danych AIID. McGregor wyjaśnił, że ostatecznym celem AIID jest zapobieganie awariom systemów AI, lub co najmniej zmniejszenie nasilenia niepożądanych incydentów. Jak zauważył McGregor, systemy machine learning są znacznie bardziej złożone i nieprzewidywalne niż tradycyjne systemy oprogramowania, i w rezultacie nie mogą być testowane w ten sam sposób, co inne oprogramowanie. Systemy machine learning mogą zmieniać swoje zachowanie w nieoczekiwany sposób. McGregor zauważa, że zdolność systemów głębokiego uczenia się do uczenia się może oznaczać, że “awarie są bardziej prawdopodobne, bardziej skomplikowane i bardziej niebezpieczne”, gdy wejdą w nieuporządkowany świat.

Ponad 1 000 incydentów związanych z AI zostało zalogowanych

Od momentu powstania AIID, zalogowano ponad 1 000 incydentów związanych z AI do bazy danych. Spośród wszystkich incydentów w bazie danych, problemy związane z uczciwością AI były najczęstszym rodzajem niepożądanych incydentów. Wiele z tych incydentów dotyczyło wykorzystania algorytmów rozpoznawania twarzy przez agencje rządowe. McGregor zauważa również, że jest coraz więcej incydentów związanych z robotyką, które są dodawane do bazy danych.

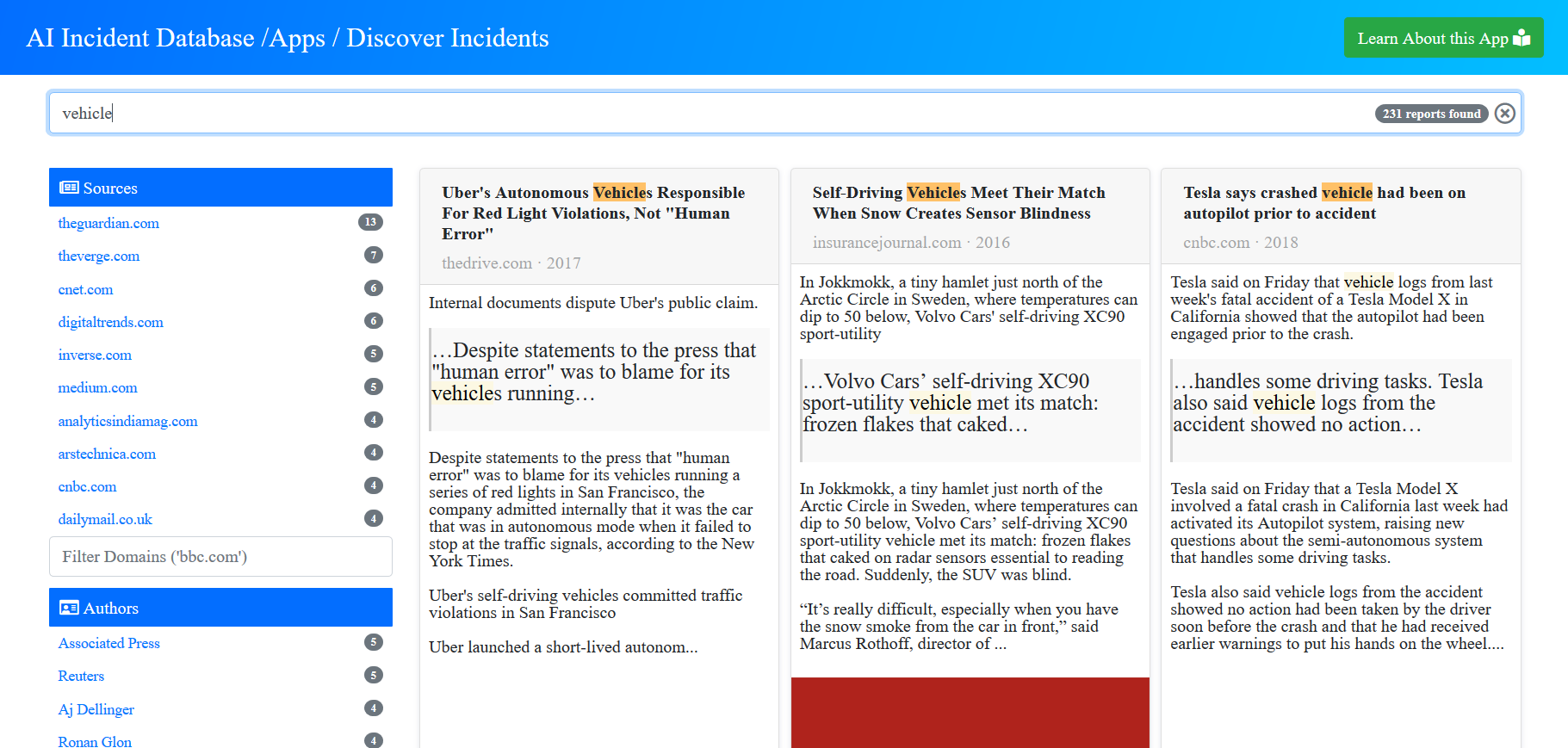

Odwiedzający bazę danych mogą wykonywać zapytania, wyszukując incydenty w bazie danych na podstawie kryteriów, takich jak słowa kluczowe, identyfikator incydentu, źródło lub autor. Na przykład, uruchomienie wyszukiwania dla “Deepfake” zwraca 7 raportów, podczas gdy wyszukiwanie “robotów” zwraca 158 raportów.

Zcentralizowana baza danych dla incydentów, w których AI działa nieprawidłowo lub w nieoczekiwany sposób, może pomóc badaczom, inżynierom i etykom nadzorować rozwój i wdrożenie systemów AI. Menadżerowie produktów w firmach technologicznych mogą wykorzystać AIID, aby sprawdzić, czy istnieją potencjalne problemy przed zastosowaniem systemów rekomendacji AI, lub inżynier AI może uzyskać pomysł na potencjalne uprzedzenia, które należy skorygować podczas tworzenia aplikacji AI. Podobnie, oficerzy ds. ryzyka mogą wykorzystać bazę danych, aby określić potencjalne negatywne skutki związane z modelem AI, umożliwiając im planowanie i rozwijanie środków w celu złagodzenia potencjalnych szkód.

Architektura podstawowa AIID jest zaprojektowana tak, aby być elastyczną, co umożliwia tworzenie nowych narzędzi do wyszukiwania bazy danych i wyodrębniania wartościowych informacji. Partnership on AI i McGregor będą współpracować w celu opracowania elastycznej taksonomii, która może być wykorzystana do klasyfikacji wszystkich różnych rodzajów incydentów AI. Zespół ma nadzieję, że po stworzeniu elastycznej taksonomii, można ją połączyć z systemem automatycznym, który automatycznie zaloguje incydenty AI.

” Społeczność AI zaczęła udostępniać ze sobą rekordy incydentów, aby motywować zmiany w swoich produktach, procedurach kontroli i programach badawczych”, McGregor wyjaśnił za pośrednictwem TechTalks. “Strona została opublikowana publicznie w listopadzie, więc dopiero zaczynamy dostrzegać korzyści z systemu.”