Sztuczna inteligencja

ST-NeRF: Kompozycja i edycja dla syntezy wideo

Chiński konsorcjum badawcze rozwinęło techniki, które umożliwiają edycję i kompozycję w jednym z najgorętszych sektorów badań nad syntezą obrazu w ubiegłym roku – Neural Radiance Fields (NeRF). System nosi nazwę ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field).

Co wydaje się być ruchem kamery fizycznej na poniższym obrazie, jest tak naprawdę tylko użytkownikiem “przewijającym” przez punkty widzenia na zawartości wideo, która istnieje w 4-wymiarowej przestrzeni. POV nie jest zablokowany do wykonania ludzi przedstawionych w filmie, których ruchy można obejrzeć z dowolnej części 180-stopniowego promienia.

Każdy aspekt wideo jest dyskretnie przechwytywanym elementem, składanym w spójną scenę, która może być dynamicznie eksplorowana.

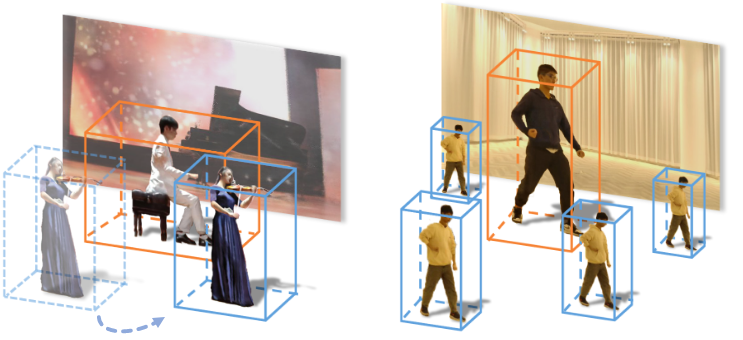

Aspekty można swobodnie powielać w scenie lub zmieniać ich rozmiar:

Ponadto, zachowanie czasowe każdego aspektu można łatwo zmienić, spowolnić, odtworzyć wstecz lub manipulować w dowolny sposób, otwierając drogę do architektur filtrów i ekstremalnie wysokiego poziomu interpretowalności.

Dwa oddzielne aspekty NeRF działające z różnymi prędkościami w tej samej scenie. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Nie ma potrzeby rotoskopowania wykonawców lub środowisk, ani wykonawców wykonujących swoje ruchy ślepo i poza kontekstem zamierzonej sceny. Zamiast tego, nagrania są przechwytywane naturalnie za pomocą tablicy 16 kamer wideo pokrywających 180 stopni:

Trzy elementy przedstawione powyżej, dwie osoby i środowisko, są oddzielnymi elementami i zaznaczone tylko do celów ilustracyjnych. Każdy z nich można wymienić i każdy może być wstawiony do sceny w dowolnym momencie ich indywidualnego czasu przechwytywania.

ST-NeRF jest innowacją w badaniach nad Neural Radiance Fields (NeRF), frameworkiem machine learning, w którym wiele punktów widzenia jest syntetyzowanych w nawigowalnej przestrzeni wirtualnej przez obszerny trening (chociaż pojedynczy punkt widzenia jest również podsektorem badań NeRF).

Neural Radiance Fields działają poprzez łączenie wielu punktów widzenia w jedną spójną i nawigowalną 3D przestrzeń, z lukami między pokryciem oszacowanymi i renderowanymi przez sieć neuronową. Gdzie używa się wideo (zamiast obrazów statycznych), potrzebne są często znaczne zasoby renderowania. Source: https://www.matthewtancik.com/nerf

Zainteresowanie NeRF stało się intensywne w ciągu ostatnich dziewięciu miesięcy, a lista utrzymana przez Reddit listy pochodnych lub eksploracyjnych prac NeRF obecnie wymienia sześćdziesiąt projektów.

Tylko kilka z wielu odnóg oryginalnego artykułu NeRF. Source: https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

Przystępne szkolenie

Artykuł jest współpracą między badaczami z Shanghai Tech University i DGene Digital Technology, i został przyjęty z entuzjazmem w Open Review.

ST-NeRF oferuje wiele innowacji w porównaniu z poprzednimi inicjatywami w ML-pochodzących nawigowalnych przestrzeniach wideo. Nie mniej, osiąga wysoki poziom realizmu z tylko 16 kamerami. Chociaż Facebook’s DyNeRF używa tylko dwóch kamer więcej niż to, oferuje znacznie bardziej ograniczony łuk nawigowalny.

Przykład środowiska Facebook’s DyNeRF, z bardziej ograniczonym polem ruchu, i więcej kamer na metr kwadratowy potrzebnych do odtworzenia sceny. Source: https://neural-3d-video.github.io

Ponadto, brakuje mu możliwości edycji i kompozycji poszczególnych aspektów, DyNeRF jest szczególnie drogi w zakresie zasobów obliczeniowych. W przeciwieństwie do tego, chińscy badacze stwierdzają, że koszt szkolenia ich danych wynosi gdzieś między $900-$3,000, w porównaniu z $30,000 dla modelu generacji wideo DVDGAN, i intensywnych systemów takich jak DyNeRF.

Recenzenci zauważyli również, że ST-NeRF wprowadza znaczącą innowację w oddzieleniu procesu uczenia się ruchu od procesu syntezy obrazu. To rozdzielenie umożliwia edycję i kompozycję, z poprzednimi podejściami ograniczonymi i liniowymi w porównaniu.

Chociaż 16 kamer jest bardzo ograniczoną tablicą dla tak pełnego półkola widoku, badacze mają nadzieję, że w późniejszych pracach będą mogli zmniejszyć tę liczbę za pomocą proxy pre-skanowanych tłów statycznych i bardziej opartych na danych podejść do modelowania sceny. Chcą również uwzględnić możliwości ponownego oświetlenia, niedawną innowację w badaniach NeRF.

Uwzględnienie ograniczeń ST-NeRF

W kontekście akademickich artykułów CS, które mają tendencję do zniszczenia rzeczywistej użyteczności nowego systemu w końcowym akapicie, nawet ograniczenia, które badacze uznają za ST-NeRF, są niezwykłe.

Zauważają, że system nie może obecnie indywidualizować i oddzielnie renderować poszczególnych obiektów w scenie, ponieważ ludzie w nagraniu są podzieleni na poszczególne jednostki za pomocą systemu zaprojektowanego do rozpoznawania ludzi, a nie obiektów – problem, który wydaje się łatwo rozwiązywalny z YOLO i podobnymi frameworkami, z trudniejszą pracą wyciągania ludzkich wideo już wykonaną.

Chociaż badacze zauważają, że nie jest możliwe wygenerowanie slow-motion, wydaje się, że nie ma nic, co mogłoby uniemożliwić wdrożenie tego za pomocą istniejących innowacji w interpolacji klatek, takich jak DAIN i RIFE.

Jak we wszystkich implementacjach NeRF, i w wielu innych sektorach badań nad widzeniem komputerowym, ST-NeRF może zawieść w przypadku ciężkich zakryć, gdzie przedmiot jest tymczasowo zasłonięty przez inną osobę lub obiekt, i może być trudny do ciągłego śledzenia lub dokładnego ponownego uzyskania. Jak gdzie indziej, ta trudność może musieć czekać na rozwiązania w górę strumienia. Tymczasem badacze przyznają, że interwencja ręczna jest konieczna w tych zakrytych klatkach.

Wreszcie, badacze zauważają, że procedury segmentacji ludzi obecnie opierają się na różnicach kolorystycznych, co może prowadzić do niezamierzonego połączenia dwóch osób w jeden blok segmentacji – przeszkodę, która nie jest ograniczona do ST-NeRF, ale wewnętrzna dla używanej biblioteki, i która może być rozwiązana za pomocą analizy optycznego przepływu i innych pojawiających się technik.

Pierwotnie opublikowane 7 maja 2021.