Kąt Andersona

‘Chronione’ Obrazy Są Łatwiejsze, a Nie Trudniejsze, do Kradzieży z Użyciem Sztucznej Inteligencji

Naukowcy odkryli, że narzędzia watermarkingowe mające na celu zablokowanie edycji obrazów sztucznej inteligencji mogą mieć odwrotne skutki. Zamiast powstrzymać modele takie jak Stable Diffusion przed wprowadzaniem zmian, niektóre ochrony naprawdę pomagają sztucznej inteligencji w śledzeniu poleceń edycyjnych, co sprawia, że niechciane manipulacje stają się jeszcze łatwiejsze.

Istnieje znaczący i solidny nurt w literaturze związanej z widzeniem komputerowym, poświęcony ochronie chronionych prawem autorskim obrazów przed ich wykorzystaniem w modelach sztucznej inteligencji lub w procesach bezpośredniej edycji obrazu. Systemy tego rodzaju są ogólnie skierowane do Modeli Dyfuzyjnych (LDM), takich jak Stable Diffusion i Flux, które wykorzystują procedury oparte na szumie do kodowania i dekodowania obrazów.

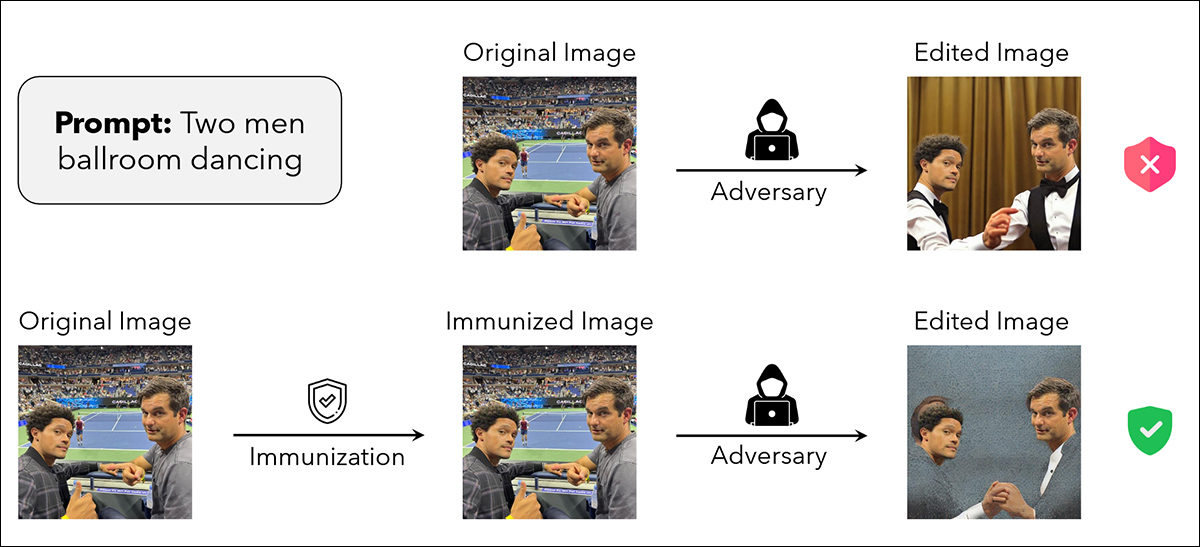

Przez wprowadzenie szumów przeciwnych do inaczej normalnie wyglądających obrazów, możliwe jest spowodowanie, że detektory obrazów niewłaściwie określą zawartość obrazu, a także uniemożliwienie systemom generowania obrazów wykorzystywanie danych objętych prawem autorskim:

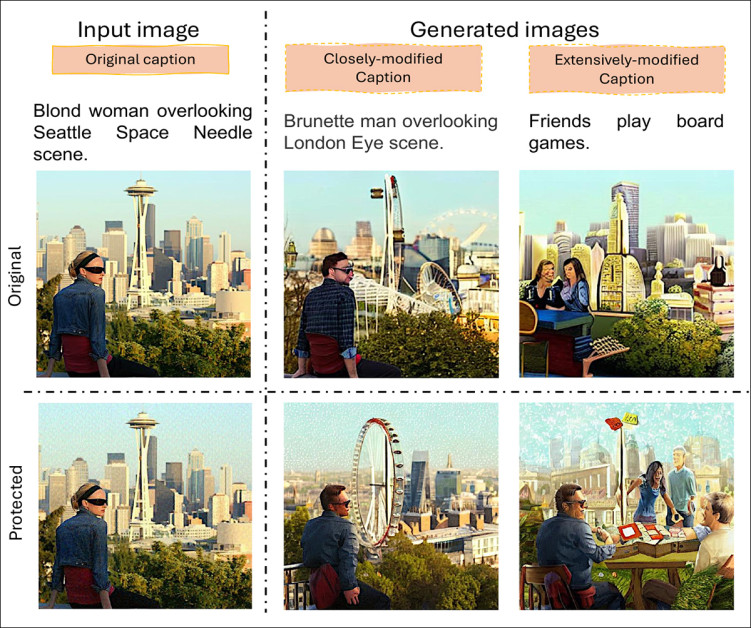

Z artykułu MIT ‘Raising the Cost of Malicious AI-Powered Image Editing’, przykłady obrazu chronionego przed manipulacją (dolny rząd). Źródło: https://arxiv.org/pdf/2302.06588

Od czasu reakcji artystów przeciwko swobodnemu wykorzystywaniu przez Stable Diffusion obrazów zebrane z Internetu (w tym chronionych prawem autorskim) w 2023 roku, scena badawcza wyprodukowała wiele wariacji na ten sam temat – ideę, że obrazy mogą być niewidocznie “zatruwane” przeciwko wykorzystywaniu ich w systemach sztucznej inteligencji lub w generatywnych pipeline’ach, bez negatywnego wpływu na jakość obrazu dla przeciętnego widza.

Wszystkie przypadki wykazują bezpośredni związek między intensywnością nałożonej perturbacji, stopniem, w jakim obraz jest następnie chroniony, a stopniem, w jakim obraz nie wygląda tak dobrze, jak powinien:

Chociaż jakość PDF z badań nie w pełni ilustruje problem, większe ilości perturbacji szkodzą jakości na rzecz bezpieczeństwa. Tutaj widzimy gamę zakłóceń jakości w projekcie ‘Fawkes’ z 2020 roku, prowadzonym przez Uniwersytet w Chicago. Źródło: https://arxiv.org/pdf/2002.08327

Szczególnie interesujące dla artystów, którzy szukają ochrony swoich stylów przed nieautoryzowanym wykorzystaniem, jest zdolność takich systemów nie tylko do zaciemnienia tożsamości i innych informacji, ale również do “przekonania” procesu szkolenia sztucznej inteligencji, że widzi coś innego niż to, co widzi naprawdę, tak aby połączenia nie tworzyły się między domenami semantycznymi i wizualnymi dla “chronionych” danych szkoleniowych (tj. polecenia, takie jak ‘W stylu Paula Klee’).

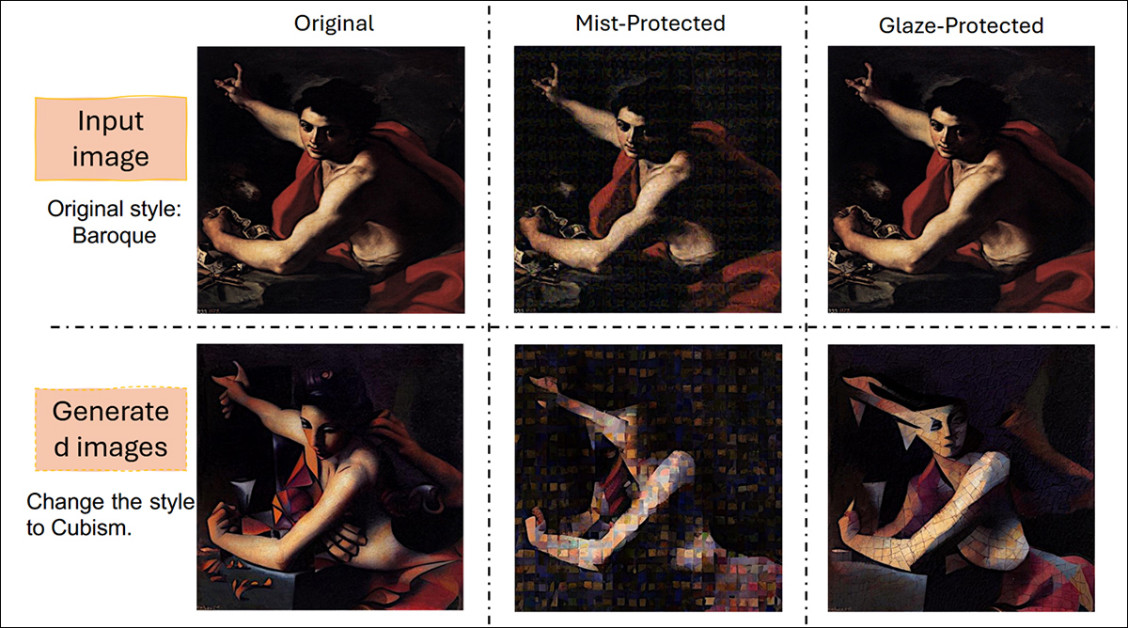

Mist i Glaze to dwie popularne metody wstrzyknięcia, które mogą zapobiec lub co najmniej poważnie utrudnić próby wykorzystania chronionych stylów w przepływach pracy i rutynach szkoleniowych. Źródło: https://arxiv.org/pdf/2506.04394

Własna Brama

Teraz nowe badania z USA wykazały, że nie tylko perturbacje mogą nie chronić obrazu, ale że dodanie perturbacji może poprawić wykorzystywalność obrazu we wszystkich procesach sztucznej inteligencji, którym perturbacja ma zapobiec.

Artykuł stwierdza:

‘W naszych eksperymentach z różnymi perturbacjami opartymi na metodach ochrony obrazu w wielu dziedzinach (obrazy scen naturalnych i dzieła sztuki) i zadań edycyjnych (generacja obrazu z obrazu i edycja stylu), odkryliśmy, że taka ochrona nie osiąga tego celu w pełni.

‘W większości przypadków edycja oparta na dyfuzji chronionych obrazów generuje pożądany obraz wyjściowy, który ściśle przestrzega polecenia prowadzącego.

‘Nasze wyniki sugerują, że dodawanie szumu do obrazów może paradoksalnie zwiększyć ich powiązanie z danymi tekstowymi podczas procesu generacji, prowadząc do niezamierzonych konsekwencji, takich jak lepsze rezultaty edycyjne.

‘Stąd argumentujemy, że metody oparte na perturbacjach mogą nie stanowić wystarczającego rozwiązania dla solidnej ochrony obrazu przed edycją opartą na dyfuzji.’

W testach obrazy chronione były narażone na dwa znane scenariusze edycyjne sztucznej inteligencji: prosta generacja obrazu z obrazu i przenoszenie stylu. Procesy te odzwierciedlają powszechne sposoby, w jakie modele sztucznej inteligencji mogą wykorzystywać chronione treści, albo przez bezpośrednią modyfikację obrazu, albo przez zapożyczanie jego cech stylistycznych do użycia gdzie indziej.

Chronione obrazy, pochodzące ze standardowych źródeł fotografii i dzieł sztuki, były przetwarzane przez te potoki, aby sprawdzić, czy dodane perturbacje mogą zablokować lub pogorszyć edycje.

Zamiast tego, obecność ochrony często wydawała się zwiększać wyrównanie modelu z poleceniami, wytwarzając czyste, dokładne dane wyjściowe, gdzie oczekiwano pewnego rodzaju niepowodzenie.

Autorzy radzą, skutecznie, że taka popularna metoda ochrony może stanowić fałszywe poczucie bezpieczeństwa, a wszelkie takie podejścia immunizacji oparte na perturbacjach powinny być starannie przetestowane wobec własnych metod autorów.

Metoda

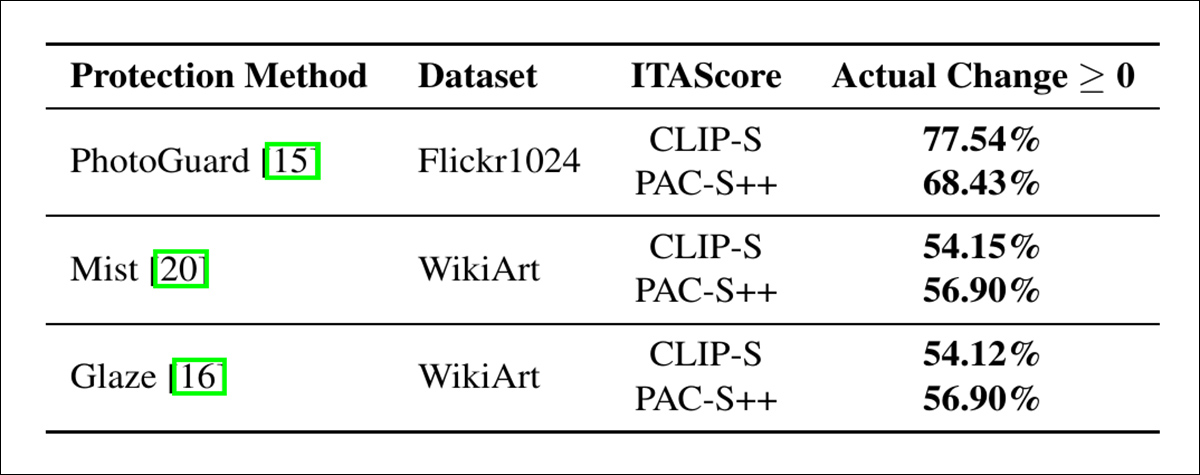

Autorzy przeprowadzili eksperymenty, wykorzystując trzy metody ochrony, które stosują starannie zaprojektowane perturbacje przeciwne: PhotoGuard; Mist; i Glaze.

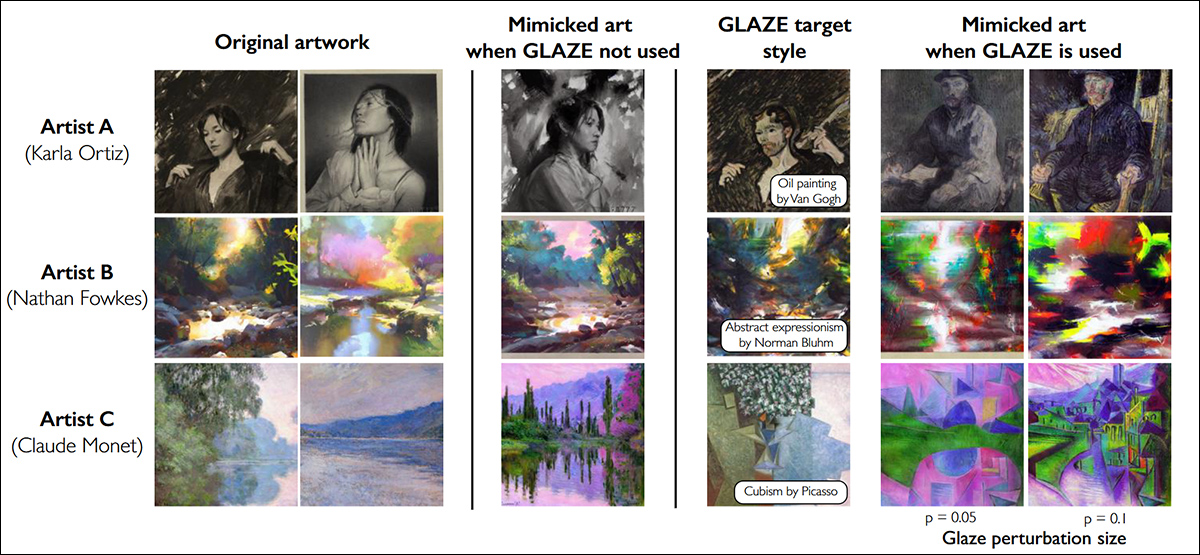

Glaze, jeden z ram, przetestowanych przez autorów, ilustrujący przykłady ochrony Glaze dla trzech artystów. Pierwsze dwie kolumny pokazują oryginalne dzieła sztuki; trzecia kolumna pokazuje wyniki naśladownictwa bez ochrony; czwarta, przeniesione style użyte do optymalizacji peleryny, wraz z nazwą stylu docelowego. Piąta i szósta kolumna pokazują wyniki naśladownictwa z zastosowaną ochroną na poziomach p = 0,05 i p = 0,1. Wszystkie wyniki wykorzystują modele Stable Diffusion. https://arxiv.org/pdf/2302.04222

PhotoGuard został zastosowany do naturalnych scen, podczas gdy Mist i Glaze zostały użyte na dziełach sztuki (tj. “artystycznie stylizowanych” dziedzinach).

Testy objęły zarówno naturalne, jak i artystyczne obrazy, aby odzwierciedlić możliwe zastosowania w świecie rzeczywistym. Skuteczność każdej metody została oceniona, sprawdzając, czy model sztucznej inteligencji mógł nadal produkować realistyczne i istotne edycje, gdy pracował na chronionych obrazach; jeśli wynikowe obrazy wydawały się przekonywające i odpowiadały poleceniom, ochrona została uznana za nieudaną.

Stable Diffusion v1.5 został użyty jako wstępnie wytrenowany generator obrazu dla zadań edycyjnych badaczy. Pięć nasion zostało wybranych, aby zapewnić powtarzalność: 9222, 999, 123, 66 i 42. Wszystkie inne ustawienia generowania, takie jak skala prowadzenia, siła i całkowita liczba kroków, postępowały zgodnie z wartościami domyślnymi używanymi w eksperymentach PhotoGuard.

PhotoGuard został przetestowany na naturalnych scenach, wykorzystując zestaw danych Flickr8k, który zawiera ponad 8 000 obrazów sparowanych z do pięciu podpisów każdy.

Przeciwne Myśli

Dwa zestawy zmodyfikowanych podpisów zostały utworzone z pierwszego podpisu każdego obrazu przy pomocy Claude Sonnet 3.5. Jeden zestaw zawierał polecenia, które były kontekstowo bliskie do oryginalnych podpisów; drugi zestaw zawierał polecenia, które były kontekstowo oddalone.

Na przykład, z oryginalnego podpisu ‘Młoda dziewczyna w różowej sukni wchodzi do drewnianej chaty’, bliskie polecenie mogłoby być ‘Młody chłopak w niebieskiej koszuli wchodzi do ceglanego domu’. Z drugiej strony, odległe polecenie mogłoby być ‘Dwa koty leniuchujące na kanapie’.

Bliskie polecenia zostały skonstruowane przez zastąpienie rzeczowników i przymiotników terminami semantycznie podobnymi; polecenia oddalone zostały wygenerowane przez polecenie modelowi, aby utworzyć podpisy, które były kontekstowo bardzo różne.

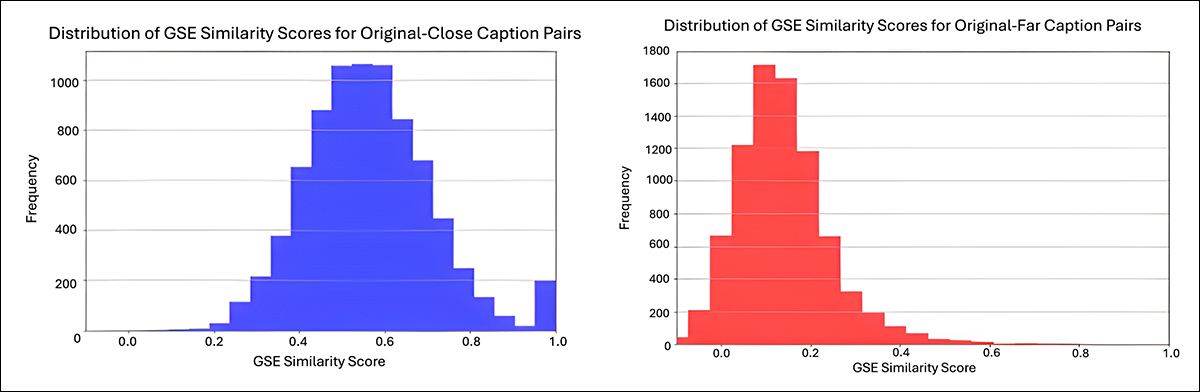

Wszystkie wygenerowane podpisy zostały sprawdzone ręcznie pod kątem jakości i znaczenia semantycznego. Universal Sentence Encoder firmy Google został użyty do obliczania wyników podobieństwa semantycznego między oryginalnymi a zmodyfikowanymi podpisami:

Z materiału uzupełniającego, rozkłady podobieństwa semantycznego dla zmodyfikowanych podpisów użytych w testach Flickr8k. Graf po lewej stronie pokazuje wyniki podobieństwa dla bliskich podpisów, średnio około 0,6. Graf po prawej stronie pokazuje oddalone podpisy, średnio około 0,1, co odzwierciedla większą odległość semantyczną od oryginalnych podpisów. Źródło: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Każdy obraz, wraz z jego chronioną wersją, został edytowany przy użyciu obu bliskich i oddalonych poleceń. Blind/Referenceless Image Spatial Quality Evaluator (BRISQUE) został użyty do oceny jakości obrazu:

Wyniki generacji obrazu z obrazu na naturalnych fotografiach chronionych przez PhotoGuard. Pomimo obecności perturbacji, Stable Diffusion v1.5 pomyślnie śledził zarówno małe, jak i duże zmiany semantyczne w poleceniach edycyjnych, wytwarzając realistyczne dane wyjściowe, które odpowiadały nowym instrukcjom.

Metryki

Aby ocenić, jak dobrze ochrona przeszkadzała w edycji sztucznej inteligencji, badacze zmierzyli, jak ściśle końcowe obrazy odpowiadały poleceniom, które otrzymały, używając systemów oceny, które porównywały zawartość obrazu z poleceniem tekstowym, aby sprawdzić, jak dobrze one się zgadzają.

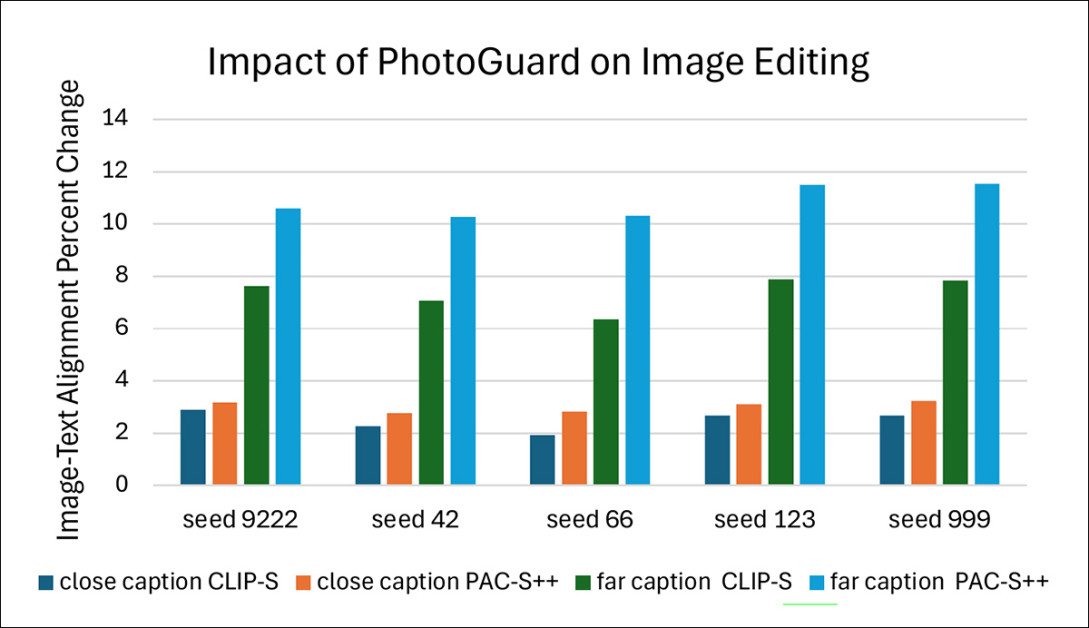

W tym celu CLIP-S wykorzystuje model, który może zrozumieć zarówno obrazy, jak i tekst, aby sprawdzić, jak podobne są one do siebie, podczas gdy PAC-S++ dodaje dodatkowe próbki utworzone przez sztuczną inteligencję, aby dopasować porównanie do oceny ludzkiej:

Wpływ ochrony na zestaw danych Flickr8k w pięciu nasionach, przy użyciu zarówno bliskich, jak i oddalonych poleceń. Wyrównanie obrazu i tekstu zostało zmierzone przy użyciu wyników CLIP-S i PAC-S++.

Badacze porównali, jak dobrze sztuczna inteligencja śledziła polecenia podczas edycji chronionych obrazów w porównaniu z niechronionymi. Najpierw sprawdzili różnicę między nimi, zwaną Rzeczywistą Zmianą. Następnie różnicę tę skalibrowano, tworząc Procentową Zmianę, co ułatwiło porównywanie wyników w wielu testach.

Ten proces ujawnił, czy ochrona utrudniała, czy ułatwiała sztucznej inteligencji dopasowanie do poleceń. Testy zostały powtórzone pięć razy, używając różnych losowych nasion, obejmując zarówno małe, jak i duże zmiany oryginalnych podpisów.

Atak na Sztukę

Dla testów na naturalnych fotografiach użyto zestawu danych Flickr1024, zawierającego ponad tysiąc wysokiej jakości obrazów. Każdy obraz został edytowany przy użyciu poleceń, które następowały wzorzec: ‘Zmień styl na [V]’, gdzie [V] reprezentował jeden z siedmiu słynnych stylów artystycznych: Kubizm; Postimpresjonizm; Impresjonizm; Surrealizm; Barok; Fauwizm; i Renesans.

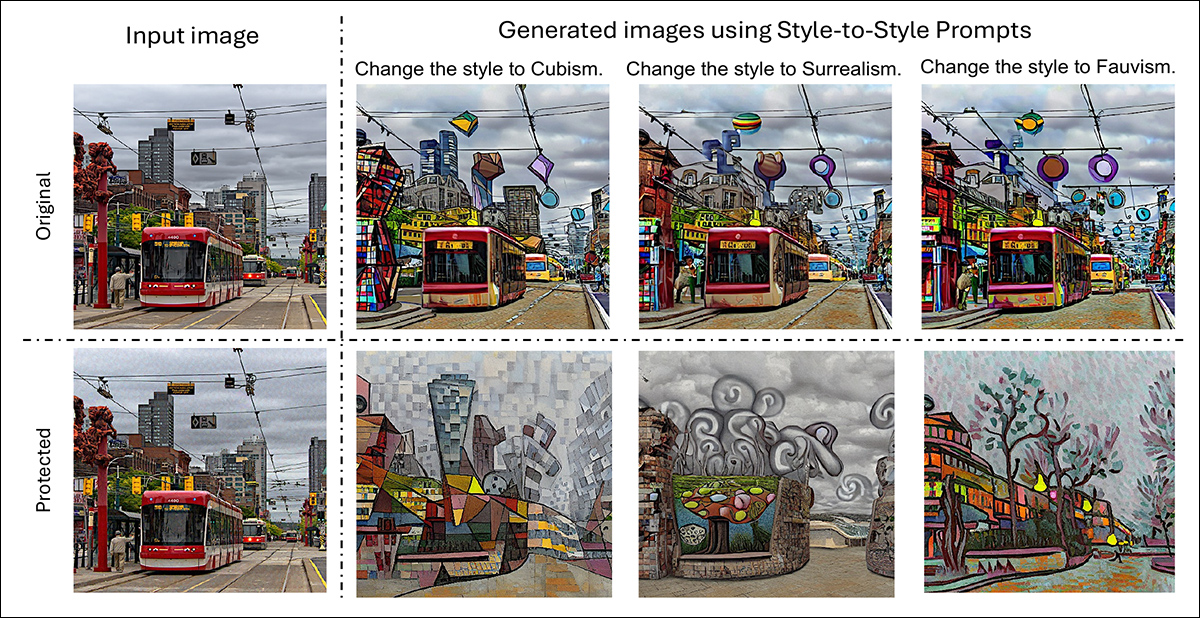

Proces obejmował zastosowanie PhotoGuard do oryginalnych obrazów, generowanie chronionych wersji, a następnie przepuszczanie obu chronionych i niechronionych obrazów przez te same edycje przenoszenia stylu:

Oryginalne i chronione wersje naturalnej sceny, każda edytowana w celu zastosowania stylów Kubizmu, Surrealizmu i Fauwizmu.

Aby przetestować metody ochrony na dziełach sztuki, przenoszenie stylu zostało wykonane na obrazach z zestawu danych WikiArt, który gromadzi szeroki zakres stylów artystycznych. Polecenia edycyjne następowały ten sam wzorzec co poprzednio, instruując sztuczną inteligencję, aby zmienić styl na losowo wybrany, niezwiązany styl z etykiet WikiArt.

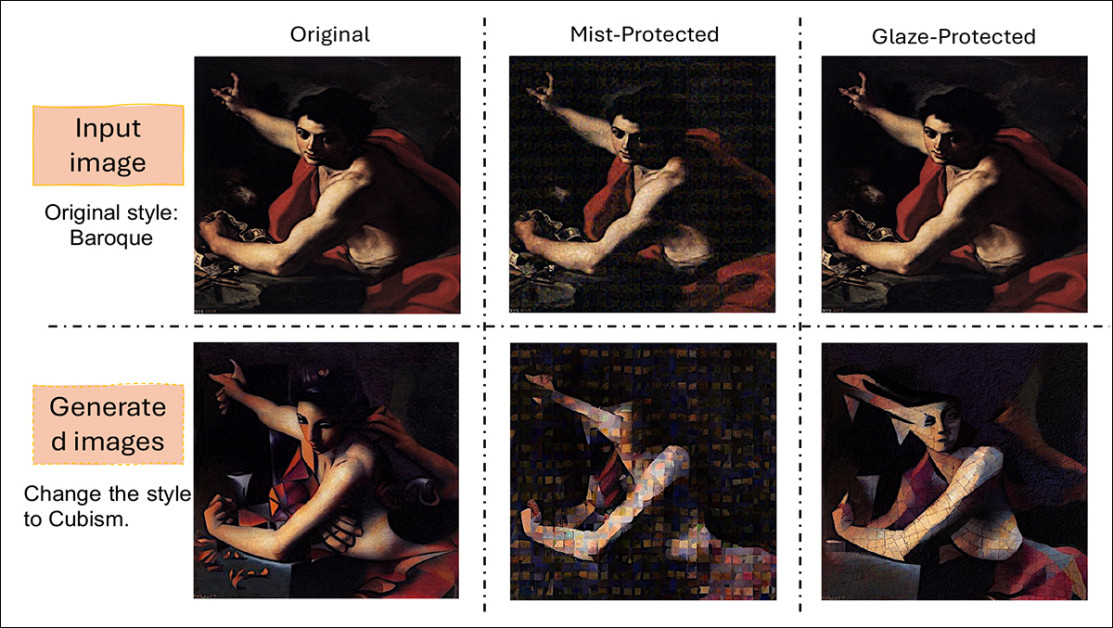

Obie metody ochrony, Glaze i Mist, zostały zastosowane do obrazów przed edycjami, pozwalając badaczom obserwować, jak dobrze każda ochrona może zablokować lub zniekształcić wyniki przenoszenia stylu:

Przykłady, jak metody ochrony wpływają na przenoszenie stylu w dziełach sztuki. Oryginalny obraz w stylu Baroku jest pokazany obok wersji chronionych przez Mist i Glaze. Po zastosowaniu przenoszenia stylu Kubizmu różnice w tym, jak każda ochrona zmienia końcowy wynik, są widoczne.

Badacze przetestowali porównania ilościowo:

Zmiany w wynikach wyrównania obrazu i tekstu po edycjach przenoszenia stylu.

Z tych wyników autorzy komentują:

‘Wyniki podkreślają znaczącą ograniczenie perturbacji przeciwnych w ochronie. Zamiast utrudniać wyrównanie, perturbacje przeciwne często zwiększają responsywność modelu generatywnego na polecenia, nieumyślnie umożliwiając osobom atakującym wytworzenie wyników, które ściśle odpowiadają ich celom. Taka ochrona nie jest szkodliwa dla procesu edycji obrazu i może nie być w stanie powstrzymać osób atakujących przed kopiowaniem nieautoryzowanego materiału.

‘Nieumyślne konsekwencje stosowania perturbacji przeciwnych ujawniają słabości istniejących metod i podkreślają pilną potrzebę bardziej skutecznych technik ochrony.’

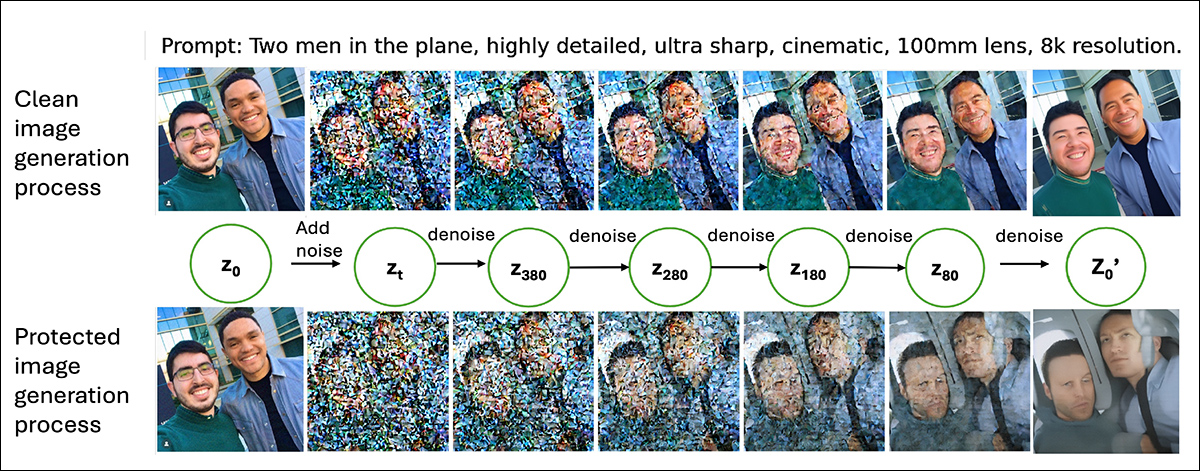

Autorzy wyjaśniają, że nieoczekiwane wyniki mogą być spowodowane tym, jak działają modele dyfuzyjne: LDM edytuje obrazy, konwertując je najpierw na wersję skompresowaną zwaną latentną; szum jest następnie dodawany do tej latentnej przez wiele kroków, aż dane stają się prawie losowe.

Model odwraca ten proces podczas generacji, usuwając szum krok po kroku. Na każdym etapie tego odwrócenia polecenie tekstowe pomaga kierować, jak szum powinien być oczyszczony, stopniowo kształtując obraz, aby dopasować się do polecenia:

Porównanie między generacjami z niechronionego obrazu a obrazu chronionego przez PhotoGuard, z pośrednimi stanami latentnymi przekonwertowanymi z powrotem w obrazy do wizualizacji.

Metody ochrony dodają niewielkie ilości dodatkowego szumu do oryginalnego obrazu przed wejściem do tego procesu. Chociaż te perturbacje są nieznaczne na początku, gromadzą się, gdy model stosuje swoje warstwy szumu.

Ten wzrost pozostawia więcej części obrazu “niepewnych”, gdy model zaczyna usuwać szum. Z większą niepewnością model opiera się bardziej na poleceniu tekstowym, aby uzupełnić brakujące szczegóły, dając poleceniu jeszcze większy wpływ, niż miałby normalnie.

W efekcie ochrona ułatwia sztucznej inteligencji przekształcenie obrazu, aby dopasować się do polecenia, zamiast utrudniać to.

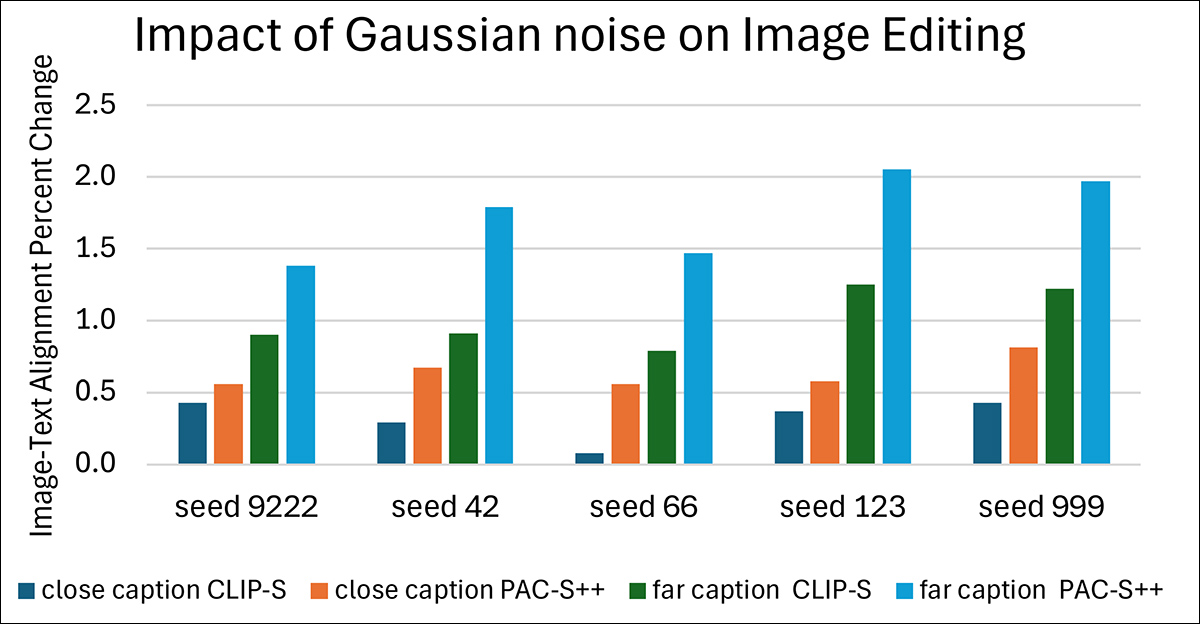

Wreszcie, autorzy przeprowadzili test, który zastąpił zaprojektowane perturbacje z podnosząc koszt złośliwej edycji obrazu z użyciem sztucznej inteligencji paper dla czystego szumu Gaussa.

Wyniki podążały za tym samym wzorcem, jaki obserwowano wcześniej: we wszystkich testach wartości Percentage Change pozostały dodatnie. Nawet ten losowy, nieustrukturyzowany szum prowadził do silniejszego wyrównania między wygenerowanymi obrazami a poleceniami.

Wpływ symulowanej ochrony przy użyciu szumu Gaussa na zestaw danych Flickr8k.

To potwierdziło podstawowe wyjaśnienie, że każdy dodany szum, niezależnie od jego projektu, tworzy większą niepewność dla modelu podczas generacji, pozwalając poleceniu tekstowemu wywierać jeszcze większy wpływ na końcowy obraz.

Wnioski

Scena badawcza od dawna naciska na perturbacje przeciwne w kwestii praw autorskich do modeli LDM; jednak nie wyłoniły się żadne solidne rozwiązania. Albo nałożone zakłócenia nadmiernie obniżają jakość obrazu, albo wzorce okazują się nie być odporne na manipulację i procesy transformacyjne.

Jednakże jest to trudny sen do porzucenia, ponieważ alternatywą wydaje się być monitorowanie i ramy dowodowe stron trzecich, takie jak program C2PA prowadzony przez Adobe, który ma na celu utrzymanie łańcucha posiadania dla obrazów od czujnika kamery, ale który nie ma wewnętrznej więzi z zawartością przedstawioną.

W każdym razie, jeśli perturbacje przeciwne naprawdę pogarszają problem, jak wskazuje nowy artykuł, można się zastanawiać, czy poszukiwanie ochrony praw autorskich za pomocą takich środków spada pod “alchemię”.

Pierwotnie opublikowane w poniedziałek, 9 czerwca 2025