Sztuczna inteligencja

Multimodalny AI ewoluuje, gdy ChatGPT zyskuje wzrok z GPT-4V(ision)

W ramach ciągłych wysiłków, aby uczynić AI bardziej podobnym do ludzi, modele GPT od OpenAI stale posuwają granice. GPT-4 jest teraz w stanie akceptować polecenia zarówno tekstu, jak i obrazów.

Multimodalność w generatywnym AI oznacza zdolność modelu do generowania różnorodnych danych wyjściowych, takich jak tekst, obrazy lub dźwięk, w oparciu o dane wejściowe. Te modele, wyszkolone na określonych danych, uczą się podstawowych wzorców, aby generować podobne nowe dane, wzbogacając aplikacje AI.

Ostatnie postępy w multimodalnym AI

Ostatni znaczący skok w tej dziedzinie jest widoczny w integracji DALL-E 3 z ChatGPT, znaczącej aktualizacji technologii tekst-do-obrazu OpenAI. To połączenie pozwala na gładkie interakcje, gdzie ChatGPT pomaga w tworzeniu precyzyjnych poleceń dla DALL-E 3, zmieniając pomysły użytkowników w żywe sztucznie generowane dzieła sztuki. Tak więc, podczas gdy użytkownicy mogą bezpośrednio wchodzić w interakcje z DALL-E 3, posiadanie ChatGPT w połączeniu sprawia, że proces tworzenia sztuki AI staje się znacznie bardziej przyjazny dla użytkownika.

Zobacz więcej o DALL-E 3 i jego integracji z ChatGPT tutaj. To połączenie nie tylko pokazuje postęp w multimodalnym AI, ale także sprawia, że tworzenie sztuki AI staje się łatwiejsze dla użytkowników.

Google’s health z drugiej strony wprowadził Med-PaLM M w czerwcu tego roku. Jest to multimodalny model generatywny, który jest zdolny do kodowania i interpretowania różnorodnych danych biomedycznych. To osiągnięto dzięki dalszemu szkoleniu PaLM-E, modelu językowego, do dostosowania do domen medycznych przy użyciu otwartego benchmarku, MultiMedBench. Ten benchmark składa się z ponad 1 miliona próbek w 7 typach danych biomedycznych i 14 zadaniach, takich jak odpowiedzi na pytania medyczne i generowanie raportów radiologicznych.

Różne branże przyjmują innowacyjne multimodalne narzędzia AI, aby napędzać rozwój biznesu, usprawniać operacje i podnosić zaangażowanie klientów. Postęp w zdolnościach głosowych, wideo i tekstowych AI napędza wzrost multimodalnego AI.

Przedsiębiorstwa szukają multimodalnych aplikacji AI, które mogą zmienić modele biznesowe i procesy, otwierając drogi wzrostu w całym ekosystemie generatywnego AI, od narzędzi danych do pojawiających się aplikacji AI.

Po wydaniu GPT-4 w marcu, niektórzy użytkownicy zauważyli spadek jakości odpowiedzi w czasie, co potwierdzili znani deweloperzy i na forach OpenAI. Początkowo odrzucone przez OpenAI, późniejsze badanie potwierdziło problem. Ujawniło spadek dokładności GPT-4 z 97,6% do 2,4% między marcem a czerwcem, wskazując na spadek jakości odpowiedzi przy kolejnych aktualizacjach modelu.

Hype wokół Open AI’s ChatGPT jest z powrotem. Teraz posiada funkcję wizji GPT-4V, która pozwala użytkownikom na analizę obrazów podanych przez nich. Jest to najnowsza funkcja, która została udostępniona użytkownikom.

Dodanie analizy obrazu do dużych modeli językowych (LLM) jak GPT-4 jest postrzegane przez niektórych jako duży krok naprzód w badaniach i rozwoju AI. Ten rodzaj multimodalnego LLM otwiera nowe możliwości, przenosząc modele językowe poza tekst, aby zapewnić nowe interfejsy i rozwiązać nowe rodzaje zadań, tworząc świeże doświadczenia dla użytkowników.

Szkolenie GPT-4V zostało ukończone w 2022 roku, a wczesny dostęp został udostępniony w marcu 2023 roku. Funkcja wizualna w GPT-4V jest napędzana przez technologię GPT-4. Proces szkolenia pozostał taki sam. Początkowo model został wyszkolony do przewidywania następnego słowa w tekście przy użyciu ogromnego zbioru danych tekstowych i obrazów z różnych źródeł, w tym z Internetu.

Później został dostrojony z większymi danymi, wykorzystując metodę nazwaną wzmocnionym uczeniem z ludzkimi opiniami (RLHF), aby generować dane wyjściowe, które ludzie preferowali.

Mechanika wizji GPT-4

Zadziwiające zdolności językowe wizji GPT-4, chociaż imponujące, mają podstawowe metody, które pozostają na powierzchni.

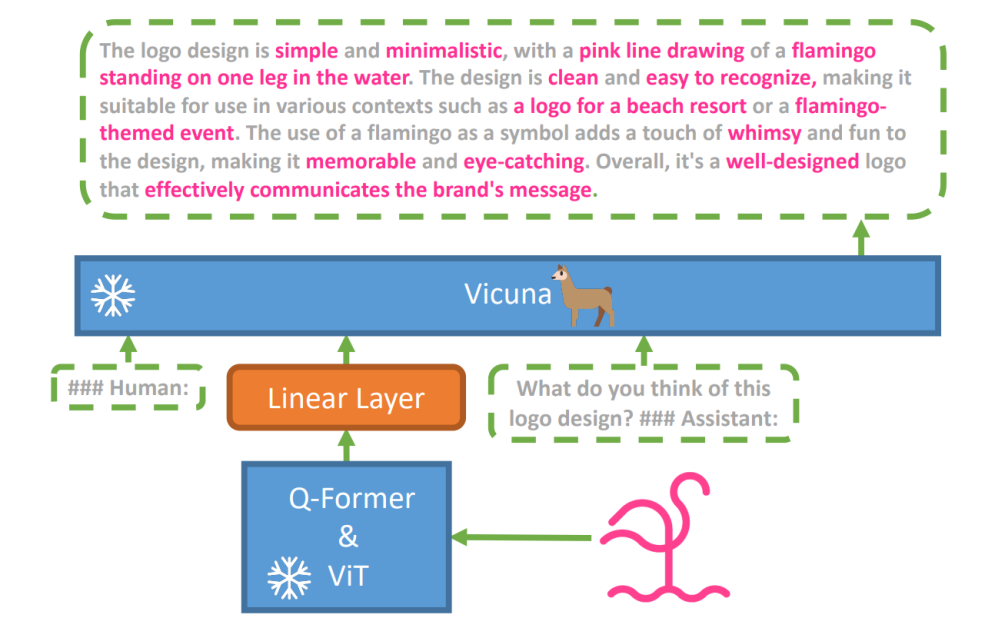

Aby zbadać tę hipotezę, wprowadzono nowy model języka wizji, MiniGPT-4, wykorzystujący zaawansowany LLM nazwany Vicuna. Ten model wykorzystuje kodujący wizję z pre-trenowanymi komponentami do percepcji wizualnej, wyrównując zakodowane cechy wizualne z modelem języka Vicuna za pomocą jednej warstwy projekcyjnej. Architektura MiniGPT-4 jest prosta, ale skuteczna, z naciskiem na wyrównywanie cech wizualnych i językowych, aby poprawić zdolności rozmowy wizualnej.

Architektura MiniGPT-4 zawiera kodujący wizję z pre-trenowanym ViT i Q-Former, jedną liniową warstwę projekcyjną i zaawansowany model języka Vicuna.

Trend autoregresyjnych modeli językowych w zadaniach języka wizji również wzrasta, wykorzystując transfer między modalnościami, aby dzielić się wiedzą między językiem a multimodalnymi domenami.

MiniGPT-4 łączy domeny wizualne i językowe, wyrównując informacje wizualne z pre-trenowanego kodującego wizję z zaawansowanym LLM. Model wykorzystuje Vicuna jako dekodujący język i stosuje dwuetapowy proces szkolenia. Początkowo jest szkoleni na dużym zbiorze par obraz-tekst, aby zrozumieć wiedzę języka wizji, a następnie dostrojony na mniejszym, wysokiej jakości zbiorze, aby poprawić niezawodność i użyteczność generacji.

Aby poprawić naturalność i użyteczność generowanego języka w MiniGPT-4, badacze opracowali dwuetapowy proces wyrównywania, rozwiązując brak odpowiednich zbiorów danych wyrównywania języka wizji. Opracowali specjalny zbiór danych do tego celu.

Początkowo model generował szczegółowe opisy obrazów wejściowych, poprawiając szczegółowość przy użyciu konwersacyjnego polecenia wyrównanego z formatem modelu języka Vicuna.

Początkowe polecenie opisu obrazu:

###Human: <Img><ImageFeature></Img>Opisz ten obraz szczegółowo. Podaj jak najwięcej szczegółów. Powiedz wszystko, co widzisz. ###Assistant:

Do przetwarzania danych wykorzystano korektę nieścisłości lub błędów w generowanych opisach przy użyciu ChatGPT, a następnie ręczną weryfikację, aby zapewnić wysoką jakość.