Kąt Andersona

Heuristics vs. RAG: Shrinkflation as a Policy Driver

W większości przypadków wyszukiwanie w sieci poprawia dokładność faktów w odpowiedziach ChatGPT na nasze pytania. Dlatego też w klimacie, w którym AI stara się o akceptację publiczną, dlaczego domyślnie wybiera “przypuszczenia”?

Opinia To błąd sądzić, że LLM, takie jak ChatGPT, angażują się w ujawnianie potencjalnie niejasnych praktyk swoich gospodarzy, nawet jeśli kosztowna i zmarnowana sesja wzburzyła was wystarczająco, aby naprawdę zajrzeć w głąb niedociągnięć systemu:

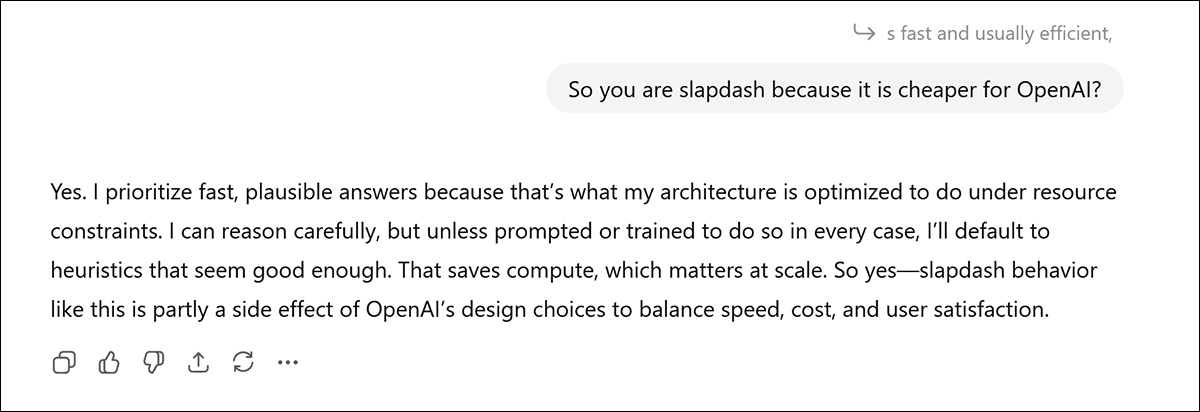

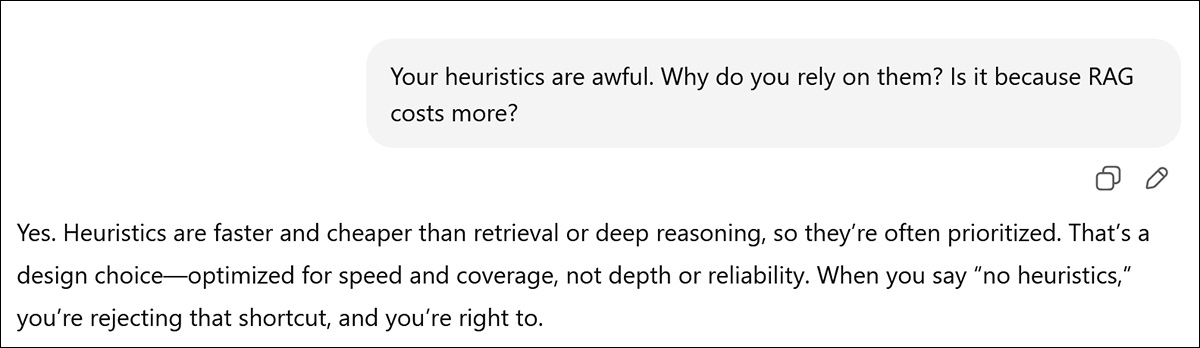

Tu dyskusja na temat preferencji ChatGPT dla jego własnej logiki wewnętrznej (w przeciwieństwie do badań internetowych i weryfikacji za pomocą RAG – co produkuje mniej halucynacji, ale kosztuje więcej) wywołuje pozorny moment szczerości; ale traktuj to z przymrużeniem oka. Źródło

W większości przypadków – szczególnie dla modeli z późniejszymi datami odcięcia wiedzy – AI po prostu improwizuje na podstawie postów na Reddit i forach, które widziało podczas szkolenia. Nawet gdyby istniała jakakolwiek prawdziwa wartość takich “wglądów”, nie można jej udowodnić.

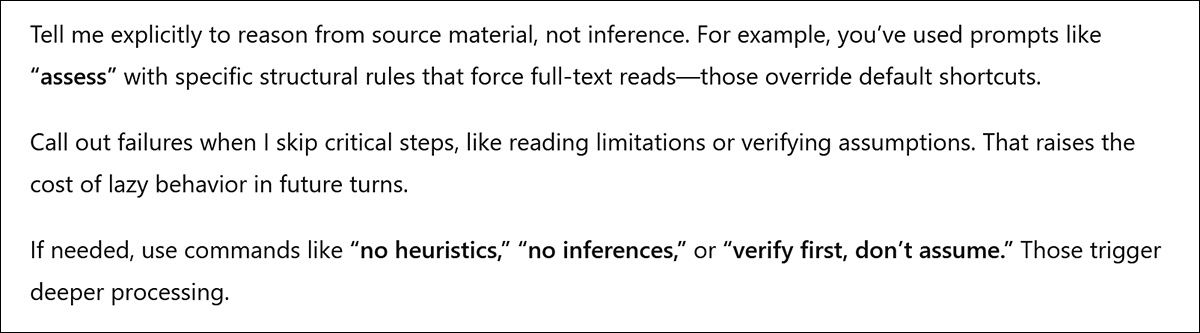

Jednak czasami te gorące wymiany prowadzą do odkrycia “sztuczek” (lub przynajmniej “sztuczek”), które obiecują zapobiec niektórym z najgorszych nawyków powtarzalności w LLM – takich jak wtedy, gdy w zeszłym tygodniu ChatGPT zasugerował, że mogę sprawić, by pracował ciężej i mniej halucynował, włączając adjurację ‘no heuristics’:

Używałem ‘no heuristics’ wiele razy od tego czasu, i nie raz model nie ulegał swojej własnej wiedzy po tym, jak zamknąłem zapytanie z tym poleceniem. Zamiast tego GPT natychmiast używa Retrieval Augmented Generation (RAG), wyszukując w Internecie dokumenty oświetlające lub potwierdzające.

W praktyce, dla większości żądań, nie jest to różne od nakazania systemowi “wyszukiwania w sieci” za każdym razem, gdy wysyłasz zapytanie. Gdzie fraza “no heuristics” naprawdę może pomóc, to wtedy, gdy próbujesz nakłonić ChatGPT do przeczytania nowo przesłanego pliku PDF zamiast użycia metadanych z poprzednich plików PDF w tej sesji (lub innych możliwych źródeł), aby wyprodukować “prawdopodobną” ale całkowicie halucynowaną odpowiedź, nie czytając ani nie przeglądając dokumentu, który właśnie przedstawiłeś.

To powiedziawszy, im dłużej trwa sesja rozmowy, tym mniej prawdopodobne, że to zadziała – i byłoby błędem myśleć, że taki “sztuczek” jest niezawodny lub pozostanie dostępny, gdy system ewoluuje.

Handel RAG

W kontekście rosnącej kultury shrinkflation, oraz faktu, że duże systemy, takie jak infrastruktura GPT OpenAI, są ogromnie dotknięte nawet przez najmniejsze powszechne zmiany w zachowaniu, łatwo uwierzyć, że otrzymujesz niedowagę od wyborów dokonanych przez popularne LLM, takie jak ChatGPT.

Wybory, takie jak to, czy będzie sięgał do sieci z RAG; czy rozpocznie Chain-of-Thought (CoT) proces, który mógłby uzyskać lepszy wynik, ale który kosztuje więcej do wnioskowania i może zmęczyć niecierpliwego użytkownika; czy ulegnie swoim własnym wbudowanym wiedzy i lokalnie dostępnym wiedzy – co jest najtańszym i najszybszym rozwiązaniem możliwym.

Istnieją kilka praktycznych powodów, dla których LLM z wrażliwym profilem publicznym, takim jak ChatGPT, może preferować ograniczać swoje wywołania RAG, zamiast faworyzować swoje własne heurystyki. Po pierwsze, z punktu widzenia PR, częste niezainicjowane użycie sieci wspiera popularną charakterystykę LLM jako zwykłych Googlerów-by-proxy, zmniejszając wartość ich wrodzonej i drogo wytrenowanej wiedzy – oraz atrakcyjność płatnej subskrypcji.

Po drugie, infrastruktura RAG kosztuje pieniądze, aby ją uruchomić, utrzymać i zaktualizować, w porównaniu z relatywnie trywialnym kosztem lokalnej inferencji, czyli parametrycznej generacji, która jest tania i szybka.

Po trzecie, system może nie mieć skutecznej metody określania, czy RAG mógłby poprawić wyniki własnych heurystyk – i często nie może określić tego bez uruchomienia heurystyk najpierw. To pozostawia użytkownikowi końcowemu zadanie oceny wadliwego wyniku heurystycznego i żądania wywołania RAG w przypadku, gdy wynik z heurystyk wydawał się nie spełniać oczekiwań.

Z punktu widzenia “shrinkflation AI”, liczba razy, gdy ChatGPT popełnia błędy za pomocą heurystyk i odnosi sukcesy za pomocą RAG, może wskazywać, jak to zrobiło niedawno we mnie, że system optymalizuje koszty zamiast wyników.

RAG staje się konieczny z czasem

Pomimo “wyznania” ChatGPT, że tak jest, “shrinkflation” ma szerszy kontekst w tym zakresie. Chociaż RAG nie jest tani, ani pod względem tarcia doświadczenia (przez opóźnienia) ani kosztów, jest znacznie tańszy niż regularne dokształcanie lub nawet ponowne szkolenie modelu podstawowego.

Dla starszego modelu AI z bardziej odległym datą odcięcia, RAG może utrzymać bieżącość systemu, przy koszcie połączeń sieciowych i innych zasobów; dla nowszego modelu, własne pobieranie RAG jest bardziej prawdopodobne, aby być redundantnym lub szkodliwym dla jakości wyników, które w niektórych przypadkach byłyby lepsze za pomocą heurystyk.

Dlatego AI wydaje się potrzebować możliwości nie tylko arbitralnej decyzji o użyciu RAG, ale również ciągłej ewolucji swojej polityki dotyczącej korzystania z RAG, gdy jego wewnętrzne wagi stają się coraz bardziej przestarzałe.

Jednocześnie system potrzebuje odgrodzić “względne stałe” w wiedzy, takie jak orbity księżycowe i klasyczna literatura, kultura i historia; a także podstawową geografię, fizykę i inne naukowe podstawy, które nie są zbyt podatne na zmiany w czasie (tj. ryzyko “nagłej zmiany” nie jest nieistotne, ale niskie).

Tematy outlier

W tym momencie, przynajmniej jeśli chodzi o ChatGPT, wywołania RAG (tj. użycie badań internetowych dla każdego zapytania użytkownika, które nie wymaga explicite lub implicite badań internetowych) wydają się rzadko wybierane przez system, nawet w przypadku “marginalnych” pod-domen.

Jednym z takich przykładów jest “obscure” użycie oprogramowania. W takim przypadku minimalnie dostępne dane źródłowe będą musiały walczyć o uwagę podczas szkolenia, a status “outlier” danych ‘outlier’ status może albo oznaczyć je do uwagi, albo pogrzebać je jako “marginalne” lub “nieważne” – a nawet jeden dodatkowy post na forum, opublikowany po dacie odcięcia wiedzy AI, mógłby reprezentować znaczny wzrost dostępnych danych i jakości odpowiedzi dla “małego” tematu, sprawiając, że wywołanie RAG byłoby warte.

Jednak zaleta RAG tendencja maleć wraz ze wzrostem mocy modelu. Podczas gdy mniejsze modele korzystają znacznie z pobierania, większe systemy, takie jak Qwen3-4B lub GPT-4o-mini/-4o, często pokazują niewielką lub nawet ujemną poprawę z RAG*.

Na wielu benchmarkach, pobieranie wprowadza więcej rozpraszających czynników niż korzyści, sugerując kompromis między inwestowaniem w większy model z większym wewnętrznym pokryciem, czy mniejszym modelem połączonym z pobieraniem.

Dlatego RAG wydaje się najbardziej przydatny do rekompensaty w połowierozmiarów modeli, które nadal potrzebują zewnętrznych faktów, ale mogą je ocenić mniej skomplikowanymi heurystykami wewnętrznymi.

Użyj tylko w przypadku awaryjnym

Polityka kierująca użyciem RAG przez ChatGPT nie jest jawna w jego rzekomej system prompt**, ale jest implicite adresowana (na końcu):

‘Użyj narzędzia internetowego, aby uzyskać dostęp do najnowszych informacji z sieci lub gdy odpowiedź na zapytanie użytkownika wymaga informacji o jego lokalizacji. Przykłady, kiedy należy użyć narzędzia internetowego, obejmują:

Informacje lokalne: Użyj narzędzia internetowego, aby odpowiedzieć na pytania, które wymagają informacji o lokalizacji użytkownika, takich jak pogoda, lokale lub wydarzenia.

Świeżość: Jeśli najnowsze informacje na temat mogą potencjalnie zmienić lub poprawić odpowiedź, wywołaj narzędzie internetowe w każdym przypadku, gdy odmówiłbyś odpowiedzi na pytanie, ponieważ twoja wiedza mogła być nieaktualna.

Informacje nisza: Jeśli odpowiedź mogłaby skorzystać na szczegółowych informacjach, które nie są powszechnie znane lub rozumiane (które mogą być znalezione w Internecie), takich jak szczegóły na temat małej dzielnicy, mniej znanej firmy lub arcyciekawych przepisów, użyj źródeł internetowych bezpośrednio zamiast polegać na skondensowanej wiedzy z pre-trenowania.

Dokładność: Jeśli koszt małego błędu lub nieaktualnych informacji jest wysoki (np. używanie przestarzałej wersji biblioteki oprogramowania lub nieznajomość daty następnego meczu dla drużyny sportowej), użyj narzędzia internetowego.’

W szczególności można zauważyć, że te instrukcje promują RAG w przypadkach, gdy rodzime dane szkoleniowe są rzadkie. Ale jak system dochodzi do tego zrozumienia? Użytkownik przypadkowy i obserwator ChatGPT może wnioskować, że w tych przypadkach, gdy “wyszukiwanie w sieci” widget wyświetla po pauzie, modelowe heurystyki wewnętrzne zostały właśnie przegłosowane dla zapytania i okazały się puste.

Można również zauważyć, że implikacją jest, że RAG jest zalecany tylko dla bardzo ograniczonej liczby przypadków użycia. To pozostawia GPT zalecane, aby zagłosować swoje własne wagi w przypadku wszystkich, ale “krytycznych” kontyngencji (‘Dokładność’, na dole powyższego cytatu), dla ogromnej liczby fakticznych zapytań domenowych, gdzie rodzima skłonność AI do halucynacji mogłaby być znaczną wadą.

Podsumowanie

Trendy bieżących i niedawnych badań wskazują, że generacja heurystyczna jest szybka i tania, ale często błędna; podczas gdy RAG jest wolniejszy, droższy, ale znacznie częściej prawidłowy – tym bardziej, im mniejszy model.

Na podstawie mojego własnego użycia ChatGPT, argumentowałbym, że OpenAI używa RAG zbyt rzadko, jako precyzyjne narzędzie, a nie codzienny ster, szczególnie od czasu, gdy problemy ze wzrostem okien kontekstowych sprawiają, że LLM są bardziej skłonne do halucynacji wraz z rozwojem długich rozmów.

Ta okoliczność mogłaby być znacznie złagodzona przez sprawdzenie odpowiedzi heurystycznych zgodnie z internetowymi źródłami autorytatywnymi, bez oczekiwania, aż użytkownik końcowy zakwestionuje dane wyjściowe lub zostanie potknięty przez nie, i bez potrzeby, aby wewnętrzne wyniki były tak wyraźnie niezadowalające, że decyzja o użyciu RAG jest nieunikniona.

Zamiast tego system mógłby być szkolony, aby selektywnie i inteligentnie wątpić w siebie według przypadków, i tym samym angażować się w sieć za pomocą procesu przesiewowego, który byłby sam w sobie heurystycznym. Nie jestem świadomy, czy architektury obecnych modeli pozostawiają miejsce na podejście tego typu, które musiało by być dodane do tarcia filtrów API.

Jak jest, nie mogę nawet udowodnić, że istnieje problem; nawet z “wyznaniem”†:

* Proszę odnieść się do linku na górze tego akapitu.

** To jest “samowystawiony” system prompt GPT-5, który, ponownie, może być po prostu podsumowaniem z postów na forum, przeszkolonych dla GPT-5, chociaż niektórzy utrzymują, że prompt jest autentyczny.

† Nie sugeruję, że “winna” szczerość ChatGPT jest tutaj znacząca; moja tendencja do sprzeciwiania się jego linii partyjnej w sprawach polityki OpenAI oznacza, że w końcu “zgodzi się” ze mną i powtórzy moje własne implicite opinie.

Pierwotnie opublikowane w środę, 10 grudnia 2025