Prompt engineering

Co czym jest Chain-of-Thought (CoT) Prompting? Przykłady i korzyści

W ostatnich latach, duże modele językowe (LLM) zrobiły znaczące postępy w rozumieniu i generowaniu tekstów podobnych do ludzkich. Te modele, takie jak OpenAI’s GPT i Anthropic’s Claude, wykazały imponujące wyniki w szerokim zakresie zadań przetwarzania języka naturalnego. Jednak w przypadku złożonych zadań rozumowania, które wymagają wielu kroków myślenia logicznego, tradycyjne metody promptowania często nie są wystarczające. To właśnie tutaj pojawia się Chain-of-Thought (CoT) promptowanie, oferując potężną technikę inżynierii promptów, aby poprawić zdolności rozumowania dużych modeli językowych.

Kluczowe punkty

- CoT promptowanie poprawia zdolności rozumowania poprzez generowanie pośrednich kroków.

- Rozbija złożone problemy na mniejsze, zarządzalne podproblemy.

- Korzyści obejmują poprawioną wydajność, interpretowalność i uogólnienie.

- CoT promptowanie stosuje się do arytmetycznego, zdroworozsądkowego i symbolicznego rozumowania.

- Ma potencjał znacząco wpłynąć na sztuczną inteligencję w różnych dziedzinach.

Co to jest Chain-of-Thought (CoT) Prompting?

Chain-of-Thought promptowanie to technika, która ma na celu poprawienie wydajności dużych modeli językowych w złożonych zadaniach rozumowania, zachęcając model do generowania pośrednich kroków rozumowania. W przeciwieństwie do tradycyjnych metod promptowania, które zwykle dostarczają pojedynczy prompt i oczekują bezpośredniej odpowiedzi, CoT promptowanie rozbija proces rozumowania na szereg mniejszych, połączonych ze sobą kroków.

W swojej istocie, CoT promptowanie polega na tym, że model językowy jest promptowany pytaniem lub problemem, a następnie kierowany do generowania łańcucha myśli – sekwencji pośrednich kroków rozumowania, które prowadzą do ostatecznej odpowiedzi. Poprzez jawne modelowanie procesu rozumowania, CoT promptowanie umożliwia modelowi skuteczniejsze radzenie sobie z złożonymi zadaniami rozumowania.

Jednym z głównych zalet CoT promptowania jest to, że pozwala modelowi językowemu rozbić złożony problem na mniejsze, zarządzalne podproblemy. Poprzez generowanie pośrednich kroków rozumowania, model może rozbić cały proces rozumowania na mniejsze, bardziej skupione kroki. Ten podejście pomaga modelowi utrzymać spójność i zmniejsza szansę na utratę śladu procesu rozumowania.

CoT promptowanie wykazało obiecujące wyniki w poprawie wydajności dużych modeli językowych w różnych złożonych zadaniach rozumowania, w tym arytmetycznym, zdroworozsądkowym i symbolicznym. Poprzez wykorzystanie mocy pośrednich kroków rozumowania, CoT promptowanie umożliwia modelom językowym wykazywać głębsze zrozumienie problemu i generować bardziej dokładne i spójne odpowiedzi.

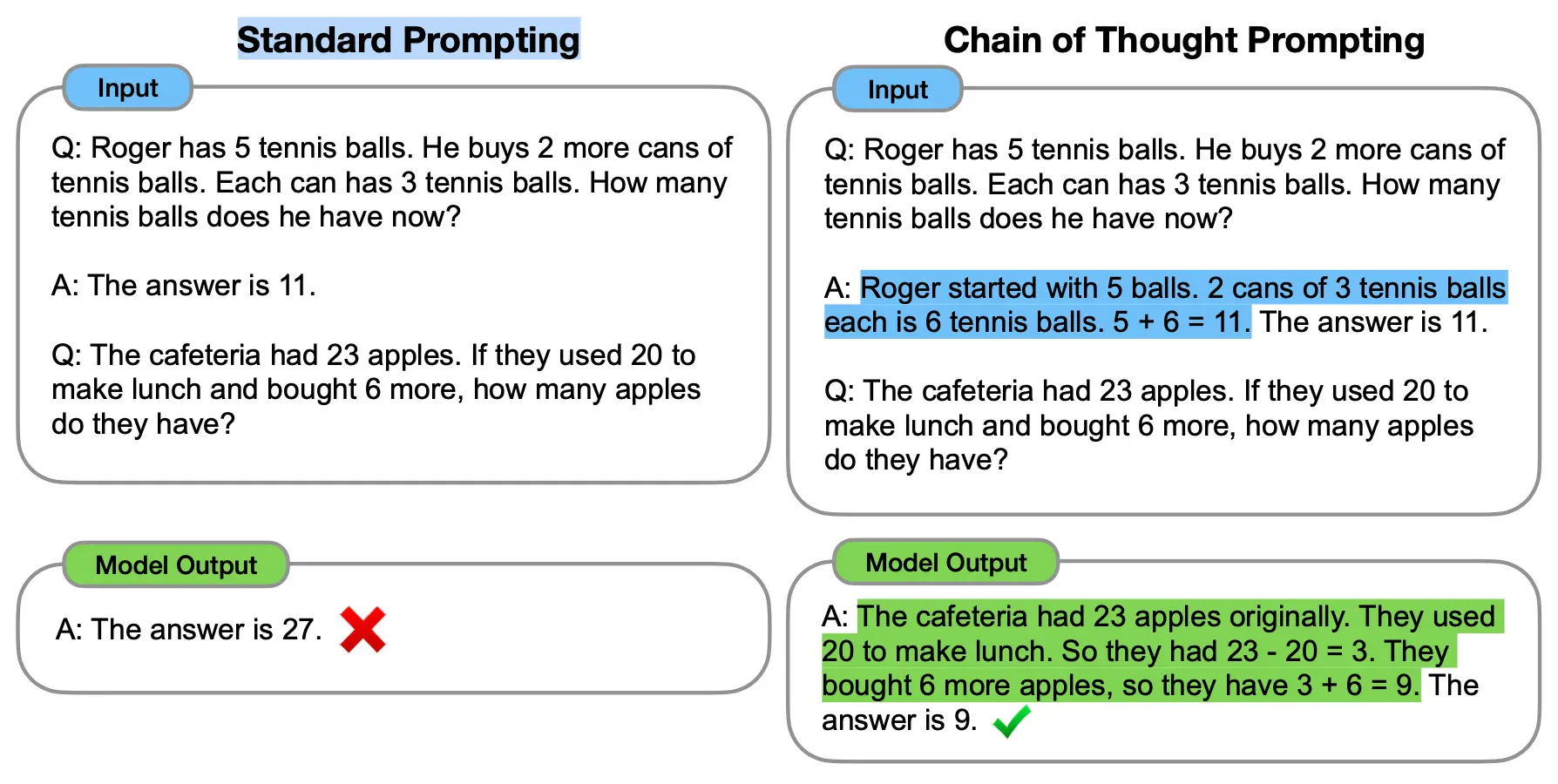

Standard vs COT promptowanie (Wei et al., Google Research, Brain Team)

Jak działa Chain-of-Thought Prompting

CoT promptowanie działa poprzez generowanie serii pośrednich kroków rozumowania, które kierują modelem językowym przez proces rozumowania. Zamiast po prostu dostarczać prompt i oczekiwać bezpośredniej odpowiedzi, CoT promptowanie zachęca model do rozbicia problemu na mniejsze, bardziej zarządzalne kroki.

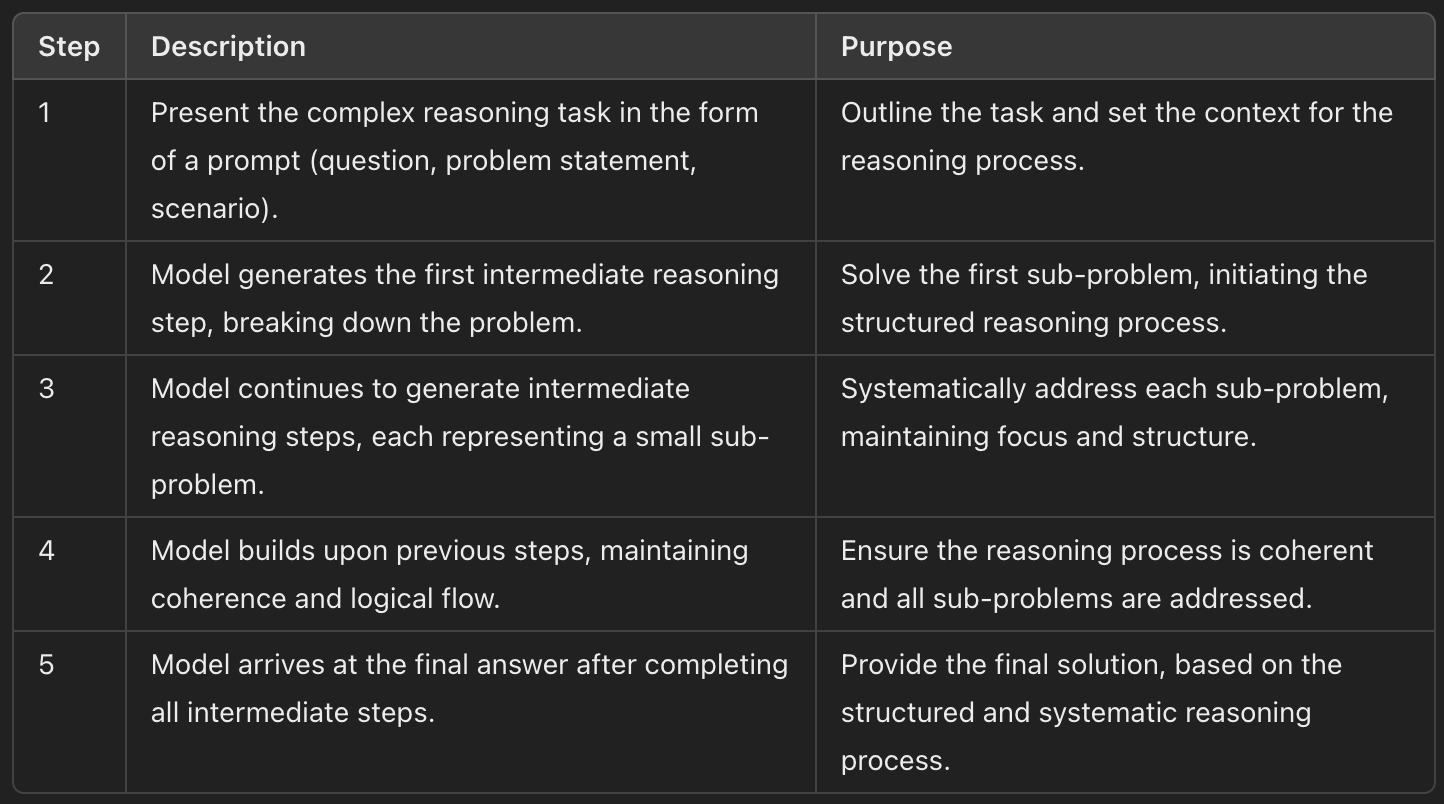

Proces rozpoczyna się od przedstawienia modelowi językowemu promptu, który określa złożone zadanie rozumowania. Ten prompt może być w postaci pytania, oświadczenia problemu lub scenariusza, który wymaga myślenia logicznego. Gdy prompt jest dostarczony, model generuje sekwencję pośrednich kroków rozumowania, które prowadzą do ostatecznej odpowiedzi.

Każdy pośredni krok rozumowania w łańcuchu myśli reprezentuje mały, skupiony podproblem, który model musi rozwiązać. Poprzez generowanie tych kroków, model może podejść do całego zadania rozumowania w bardziej strukturalny i systematyczny sposób. Pośrednie kroki pozwalają modelowi utrzymać spójność i nie utracić śladu procesu rozumowania, zmniejszając szansę na generowanie nieistotnych informacji.

Podczas gdy model postępuje przez łańcuch myśli, buduje na poprzednich krokach rozumowania, aby dojść do ostatecznej odpowiedzi. Każdy krok w łańcuchu jest połączony z poprzednim i następnym krokiem, tworząc logiczny przepływ rozumowania. Ten podejście krok po kroku umożliwia modelowi radzenie sobie z złożonymi zadaniami rozumowania bardziej skutecznie, ponieważ może skupić się na jednym podproblemie na raz, utrzymując jednocześnie cały kontekst.

Generowanie pośrednich kroków rozumowania w CoT promptowaniu jest zwykle osiągane poprzez starannie zaprojektowane prompty i techniki szkolenia. Badacze i praktycy mogą używać różnych metod, aby zachęcić model do generowania łańcucha myśli, takich jak dostarczanie przykładów krok po kroku rozumowania, używanie specjalnych tokenów, aby wskazać początek i koniec każdego kroku rozumowania, lub dostrajanie modelu na zestawach danych, które demonstrują pożądany proces rozumowania.

5-krokowy proces CoT promptowania

Poprzez kierowanie modelem językowym przez proces rozumowania za pomocą pośrednich kroków, CoT promptowanie umożliwia modelowi rozwiązywać złożone zadania rozumowania bardziej dokładnie i efektywnie. Jawne modelowanie procesu rozumowania również poprawia interpretowalność odpowiedzi modelu, ponieważ wygenerowany łańcuch myśli dostarcza wglądu w to, jak model dojrzał do swojej ostatecznej odpowiedzi.

Przykłady Chain-of-Thought Prompting

CoT promptowanie zostało pomyślnie zastosowane w różnych złożonych zadaniach rozumowania, demonstrując swoją skuteczność w poprawie wydajności dużych modeli językowych.

Rozważmy kilka przykładów, jak CoT promptowanie może być używane w różnych dziedzinach.

Arytmetyczne Rozumowanie

Jednym z najbardziej oczywistych zastosowań CoT promptowania jest arytmetyczne rozumowanie. Poprzez generowanie pośrednich kroków rozumowania, CoT promptowanie może pomóc modelom językowym rozwiązywać wielokrokowe problemy arytmetyczne bardziej dokładnie.

Na przykład, rozważmy następujący problem:

"Jeśli Jan ma 5 jabłek i Maria ma 3 razy więcej jabłek niż Jan, ile jabłek ma Maria?"

Używając CoT promptowania, model językowy może wygenerować łańcuch myśli w ten sposób:

Jan ma 5 jabłek.Maria ma 3 razy więcej jabłek niż Jan.Aby znaleźć liczbę jabłek, które ma Maria, musimy pomnożyć jabłka Jana przez 3.5 jabłek × 3 = 15 jabłekDlatego Maria ma 15 jabłek.

Poprzez rozbicie problemu na mniejsze kroki, CoT promptowanie umożliwia modelowi językowemu radzenie sobie z arytmetycznymi problemami bardziej skutecznie.

Zdroworozsądkowe Rozumowanie

CoT promptowanie wykazało również obiecujące wyniki w rozwiązywaniu zadań zdroworozsądkowego rozumowania, które wymagają głębokiego zrozumienia codziennej wiedzy i myślenia logicznego.

Na przykład, rozważmy następujące pytanie:

"Jeśli osoba jest uczulona na psy i jej przyjaciel zaprasza ją do domu z psem, co powinna zrobić osoba?"

Model językowy używający CoT promptowania może wygenerować łańcuch myśli w ten sposób:

Osoba jest uczulona na psy.Dom przyjaciela ma psa.Bycie wokół psów może spowodować reakcję alergiczną u osoby.Aby uniknąć reakcji alergicznej, osoba powinna odmówić zaproszenia.Osoba może zaproponować alternatywne miejsce spotkania z przyjacielem.

Poprzez generowanie pośrednich kroków rozumowania, CoT promptowanie pozwala modelowi językowemu wykazać bardziej klarowne zrozumienie sytuacji i zaproponować logiczne rozwiązanie.

Symboliczne Rozumowanie

CoT promptowanie zostało również zastosowane w zadaniach symbolicznego rozumowania, które obejmują manipulowanie i rozumowanie abstrakcyjnymi symbolami i pojęciami.

Na przykład, rozważmy następujący problem:

"Jeśli A implikuje B, i B implikuje C, czy A implikuje C?"

Używając CoT promptowania, model językowy może wygenerować łańcuch myśli w ten sposób:

A implikuje B oznacza, że jeśli A jest prawdziwe, to B również musi być prawdziwe.B implikuje C oznacza, że jeśli B jest prawdziwe, to C również musi być prawdziwe.Jeśli A jest prawdziwe, to B jest prawdziwe (z kroku 1).Jeśli B jest prawdziwe, to C jest prawdziwe (z kroku 2).Dlatego, jeśli A jest prawdziwe, to C również musi być prawdziwe.Więc A implikuje C.

Poprzez generowanie pośrednich kroków rozumowania, CoT promptowanie umożliwia modelom językowym radzenie sobie z abstrakcyjnymi symbolicznymi zadaniami bardziej skutecznie.

Te przykłady demonstrują wszechstronność i skuteczność CoT promptowania w poprawie wydajności dużych modeli językowych w złożonych zadaniach rozumowania w różnych dziedzinach. Poprzez jawne modelowanie procesu rozumowania za pomocą pośrednich kroków, CoT promptowanie poprawia zdolność modelu do radzenia sobie z trudnymi problemami i generowania bardziej dokładnych i spójnych odpowiedzi.

Korzyści z Chain-of-Thought Prompting

CoT promptowanie oferuje kilka znaczących korzyści w rozwoju zdolności rozumowania dużych modeli językowych. Rozważmy kilka z głównych zalet:

Poprawiona Wydajność w Złożonych Zadaniach Rozumowania

Jedną z głównych korzyści CoT promptowania jest jego zdolność do poprawy wydajności modeli językowych w złożonych zadaniach rozumowania. Poprzez generowanie pośrednich kroków rozumowania, CoT promptowanie umożliwia modelom rozbić skomplikowane problemy na mniejsze, zarządzalne podproblemy. Ten podejście krok po kroku pozwala modelowi utrzymać focus i spójność przez cały proces rozumowania, prowadząc do bardziej dokładnych i niezawodnych wyników.

Badania wykazały, że modele językowe szkolone z CoT promptowaniem konsekwentnie przewyższają te szkolone z tradycyjnymi metodami promptowania w szerokim zakresie złożonych zadań rozumowania. Jawne modelowanie procesu rozumowania za pomocą pośrednich kroków okazało się potężną techniką poprawy zdolności modelu do radzenia sobie z trudnymi problemami, które wymagają wielokrotnego rozumowania.

Poprawiona Interpretowalność Procesu Rozumowania

Inną znaczącą korzyścią CoT promptowania jest poprawiona interpretowalność procesu rozumowania. Poprzez generowanie łańcucha myśli, model językowy dostarcza klarowne i przejrzyste wyjaśnienie, jak dojrzał do swojej ostatecznej odpowiedzi. Ten krok po kroku proces rozumowania pozwala użytkownikom zrozumieć myśl modelu i ocenić ważność jego wniosków.

Interpretowalność oferowana przez CoT promptowanie jest szczególnie cenna w dziedzinach, gdzie sam proces rozumowania jest interesujący, takich jak w edukacji lub w systemach, które wymagają wyjaśnialnej sztucznej inteligencji. Poprzez dostarczanie wglądu w myśl modelu, CoT promptowanie ułatwia zaufanie i odpowiedzialność w używaniu dużych modeli językowych.

Potencjał Uogólnienia na Różne Zadania Rozumowania

CoT promptowanie wykazało potencjał uogólnienia na szeroki zakres zadań rozumowania. Chociaż technika ta została pomyślnie zastosowana w konkretnych dziedzinach, takich jak arytmetyczne, zdroworozsądkowe i symboliczne rozumowanie, podstawowe zasady CoT promptowania mogą być rozszerzone na inne typy złożonych zadań rozumowania.

Zdolność do generowania pośrednich kroków rozumowania jest podstawową umiejętnością, która może być wykorzystana w różnych dziedzinach. Poprzez dostrajanie modeli językowych na zestawach danych, które demonstrują pożądany proces rozumowania, CoT promptowanie może być adaptowane do radzenia sobie z nowymi zadaniami rozumowania, rozszerzając swoją użyteczność i wpływ.

Ułatwianie Rozwoju Bardziej Zaawansowanych Systemów Sztucznej Inteligencji

CoT promptowanie odgrywa kluczową rolę w ułatwianiu rozwoju bardziej zaawansowanych i inteligentnych systemów sztucznej inteligencji. Poprzez poprawę zdolności rozumowania dużych modeli językowych, CoT promptowanie przyczynia się do tworzenia systemów sztucznej inteligencji, które mogą radzić sobie z złożonymi problemami i wykazywać wyższy poziom zrozumienia.

W miarę jak systemy sztucznej inteligencji stają się bardziej zaawansowane i są wdrażane w różnych dziedzinach, zdolność do wykonywania złożonych zadań rozumowania staje się coraz bardziej istotna. CoT promptowanie dostarcza potężne narzędzie do poprawy zdolności rozumowania tych systemów, umożliwiając im radzenie sobie z bardziej skomplikowanymi problemami i podejmowanie bardziej świadomych decyzji.

Podsumowanie

CoT promptowanie to potężna technika, która poprawia zdolności rozumowania dużych modeli językowych poprzez generowanie pośrednich kroków rozumowania. Poprzez rozbicie złożonych problemów na mniejsze, zarządzalne podproblemy, CoT promptowanie umożliwia modelom radzenie sobie z trudnymi zadaniami bardziej skutecznie. Ten podejście poprawia wydajność, poprawia interpretowalność i ułatwia rozwój bardziej zaawansowanych systemów sztucznej inteligencji.

FAQ

Jak działa Chain-of-Thought Prompting (CoT)?

CoT promptowanie działa poprzez generowanie serii pośrednich kroków rozumowania, które kierują modelem językowym przez proces rozumowania, rozbijając złożone problemy na mniejsze, zarządzalne podproblemy.

Jakie są korzyści z używania chain-of-thought promptowania?

Korzyści z CoT promptowania obejmują poprawioną wydajność w złożonych zadaniach rozumowania, poprawioną interpretowalność procesu rozumowania, potencjał uogólnienia na różne zadania rozumowania oraz ułatwianie rozwoju bardziej zaawansowanych systemów sztucznej inteligencji.

Jakie są przykłady zadań, które mogą być poprawione za pomocą chain-of-thought promptowania?

Przykłady zadań, które mogą być poprawione za pomocą CoT promptowania, obejmują arytmetyczne rozumowanie, zdroworozsądkowe rozumowanie, symboliczne rozumowanie oraz inne złożone zadania rozumowania, które wymagają wielokrotnego myślenia logicznego.