Artificial Intelligence

GOTCHA – system CAPTCHA dla Deepfakes na żywo

Nowe badanie przeprowadzone na Uniwersytecie Nowojorskim zwiększa liczbę przesłanek wskazujących, że wkrótce być może będziemy musieli poddać się fałszywemu odpowiednikowi „testu na obecność alkoholu” w celu uwierzytelnienia się przed rozpoczęciem poufnej rozmowy wideo – takiej jak wideokonferencja związana z pracą lub jakakolwiek inna rozmowa. inny drażliwy scenariusz, który może przyciągnąć oszustów wykorzystujących deepfake w czasie rzeczywistym oprogramowanie do transmisji strumieniowej.

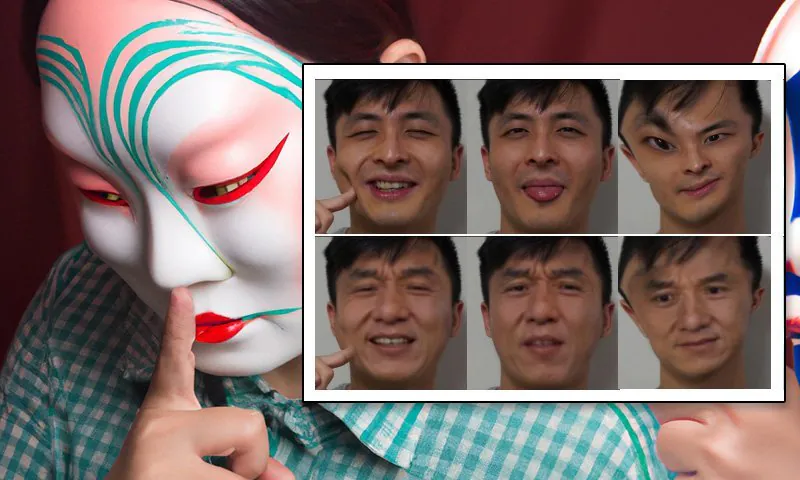

Niektóre aktywne i pasywne wyzwania zastosowane w scenariuszach rozmów wideo w GOTCHA. Użytkownik musi podporządkować się wyzwaniom i je zaliczyć, przy czym stosowane są dodatkowe metody „pasywne” (takie jak próba przeciążenia potencjalnego systemu deepfake), na które uczestnik nie ma wpływu. Źródło: http://export.arxiv.org/pdf/2210.06186

Proponowany system nosi tytuł GOTCHA – w hołdzie systemom CAPTCHA, które w ciągu ostatnich 10-15 lat stały się coraz większą przeszkodą w przeglądaniu stron internetowych, w których zautomatyzowane systemy wymagają od użytkownika wykonywania zadań, z którymi maszyny sobie nie radzą, np. identyfikacji zwierząt lub rozszyfrowanie zniekształconego tekstu (i, jak na ironię, te wyzwania często zwracają użytkownika w darmową AMTzewnętrzny komentator w stylu).

Zasadniczo GOTCHA przedłuża sierpień 2022 r DF-Captcha artykuł z Uniwersytetu Ben Guriona, który jako pierwszy zaproponował, aby osoba po drugiej stronie połączenia przeskoczyła kilka wizualnie semantycznych kółek, aby udowodnić swoją autentyczność.

W artykule z sierpnia 2022 r. Uniwersytetu Ben Guriona po raz pierwszy zaproponowano szereg interaktywnych testów dla użytkownika, w tym zasłanianie twarzy, a nawet uciskanie skóry – zadań, których nawet dobrze wyszkolone systemy deepfake na żywo mogły nie przewidzieć lub nie były w stanie sobie z nimi poradzić fotorealistycznie. . Źródło: https://arxiv.org/pdf/2208.08524.pdf

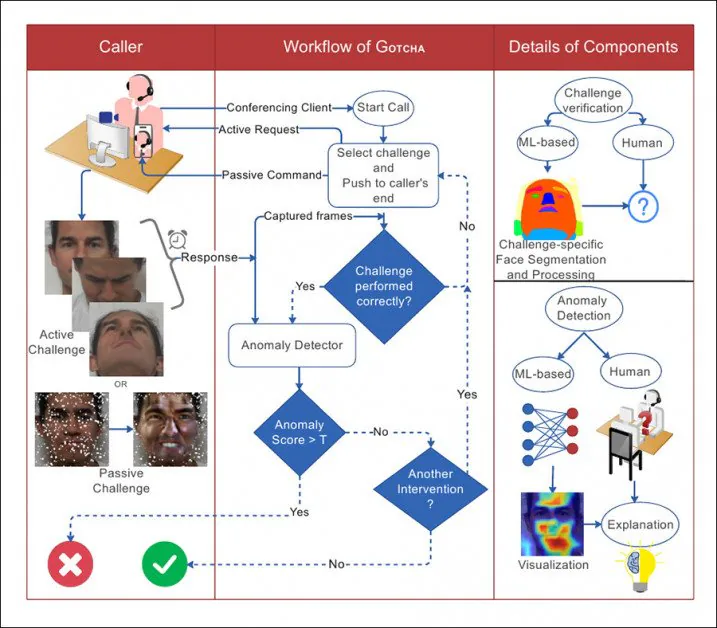

W szczególności GOTCHA dodaje „pasywne” metodologie do „kaskady” proponowanych testów, w tym automatyczne nakładanie nierealnych elementów na twarz użytkownika i „przeciążanie” klatek przechodzących przez system źródłowy. Jednak tylko zadania reagujące na użytkownika mogą być oceniane bez specjalnych uprawnień dostępu do lokalnego systemu użytkownika – które prawdopodobnie będą dostępne w postaci lokalnych modułów lub dodatków do popularnych systemów, takich jak Skype i Zoom, a nawet w formie dedykowanego, zastrzeżonego oprogramowania, którego zadaniem jest eliminowanie oszustów.

Z artykułu ilustracja interakcji pomiędzy rozmówcą a systemem w GOTCHA, liniami przerywanymi przedstawiającymi przebieg decyzji.

Naukowcy zweryfikowali system na nowym zbiorze danych zawierającym ponad 2.5 miliona klatek wideo od 47 uczestników, z których każdy wykonywał 13 wyzwań z GOTCHA. Twierdzą, że framework powoduje „konsekwentną i wymierną” redukcję jakości treści deepfake dla nieuczciwych użytkowników, obciążając system lokalny do czasu, aż widoczne artefakty sprawią, że oszustwo będzie widoczne gołym ludzkim okiem (chociaż GOTCHA zawiera również kilka bardziej subtelnych metod analizy algorytmicznej).

nowy papier jest zatytułowany Gotcha: system reakcji na wyzwanie do wykrywania deepfake'ów w czasie rzeczywistym (nazwa systemu jest pisana wielką literą w treści, ale nie w tytule publikacji, choć nie jest to akronim).

Szereg wyzwań

Zasadniczo, zgodnie z artykułem Ben Guriona, rzeczywiste wyzwania stojące przed użytkownikiem są podzielone na kilka rodzajów zadań.

Dla litu szacuje się okluzja, użytkownik musi zasłonić twarz dłonią lub innymi przedmiotami albo ustawić twarz pod kątem, który prawdopodobnie nie został wytrenowany w modelu deepfake (zwykle z powodu braku danych szkoleniowych dla „ dziwne” pozy – zobacz zakres obrazów na pierwszej ilustracji powyżej).

Oprócz czynności, które użytkownik może wykonać samodzielnie zgodnie z instrukcjami, GOTCHA może nakładać losowe wycięcia twarzy, naklejki i filtry rzeczywistości rozszerzonej, aby „uszkodzić” strumień twarzy, którego może oczekiwać lokalnie wyszkolony model deepfake, powodując jego awarię . Jak wskazano wcześniej, chociaż jest to proces „pasywny” dla użytkownika, jest to proces inwazyjny dla oprogramowania, które musi mieć możliwość bezpośredniej interwencji w strumieniu korespondenta końcowego.

Następnie użytkownik może zostać poproszony o przyjęcie nietypowego wyrazu twarzy, którego prawdopodobnie nie będzie lub będzie niedostatecznie reprezentowany w jakimkolwiek zbiorze danych szkoleniowych, co spowoduje obniżenie jakości sfałszowanych wyników (obrazek „b”, druga kolumna od lewej na pierwszej ilustracji powyżej).

W ramach tej części testów użytkownik może zostać poproszony o odczytanie tekstu lub prowadzenie rozmowy, której celem jest zakwestionowanie lokalnego systemu deepfakingu na żywo, który mógł nie przeszkolić odpowiedniego zakresu fonemów lub innych typów danych z jamy ustnej do poziomu gdzie może zrekonstruować dokładny ruch warg pod taką kontrolą.

Wreszcie (i to zdaje się rzucać wyzwanie talentom aktorskim korespondenta końcowego) w tej kategorii użytkownik może zostać poproszony o wykonanie mikroekspresji – krótkiego i mimowolnego wyrazu twarzy, który zaprzecza emocjom. Gazeta podaje, że o tym „[to] trwa zwykle 0.5–4.0 sekundy i trudno je sfałszować”.

Chociaż w artykule nie opisano, jak wyodrębnić mikroekspresję, logika sugeruje, że jedynym sposobem, aby to zrobić, jest wywołanie odpowiednich emocji u użytkownika końcowego, być może poprzez zaprezentowanie mu jakiejś zaskakującej treści w ramach procedury testu .

Zniekształcenie twarzy, oświetlenie i Niespodziewani goście

Dodatkowo, zgodnie z sugestiami z sierpniowego artykułu, w nowej pracy zaproponowano poproszenie użytkownika końcowego o wykonanie nietypowych zniekształceń i manipulacji twarzy, takich jak przyciśnięcie palca do policzka, interakcja z twarzą i/lub włosami oraz wykonywanie innych wnioski, z którymi prawdopodobnie nie poradzi sobie żaden obecny system deepfake na żywo, ponieważ są to działania marginalne – nawet gdyby były obecne w zbiorze danych szkoleniowych, ich odtworzenie byłoby prawdopodobnie niskiej jakości, zgodnie z innymi danymi „odstającymi”.

Uśmiech, ale ta „przygnębiona twarz” nie jest dobrze tłumaczona przez lokalny system deepfake na żywo.

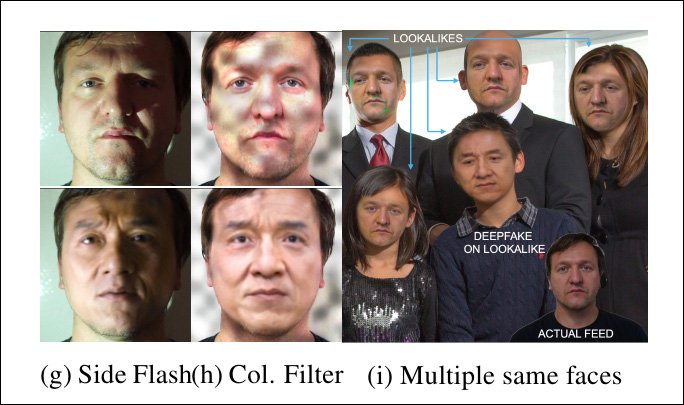

Dodatkowym wyzwaniem jest zmiana warunków oświetleniowych, w jakich znajduje się użytkownik końcowy, ponieważ możliwe jest, że uczenie modelu deepfake zostało zoptymalizowane pod kątem standardowych warunków oświetleniowych podczas wideokonferencji, a nawet dokładnych warunków oświetleniowych, w jakich odbywa się rozmowa .

W ten sposób użytkownik może zostać poproszony o świecenie latarką w telefonie komórkowym na twarz lub w inny sposób zmianę oświetlenia (warto zauważyć, że ten takt jest główną propozycją kolejny dokument dotyczący wykrywania deepfake’ów na żywo który ukazał się tego lata).

Wyzwaniem dla systemów deepfake na żywo jest nieoczekiwane oświetlenie, a nawet obecność wielu osób w strumieniu, podczas gdy oczekiwano tylko jednej osoby.

W przypadku proponowanego systemu mającego możliwość wtrącania się w lokalny strumień użytkowników (który jest podejrzany o ukrywanie pośrednika typu deepfake), dodanie nieoczekiwanych wzorców (patrz środkowa kolumna na obrazku powyżej) może zagrozić zdolności algorytmu deepfake do utrzymania symulacji .

Dodatkowo, chociaż nieuzasadnione jest oczekiwanie, że korespondent będzie miał pod ręką dodatkowe osoby, które pomogą w jego uwierzytelnieniu, system może wtrącić dodatkowe twarze (zdjęcie po prawej stronie powyżej) i sprawdzić, czy jakiś lokalny system deepfake nie popełni błędu polegającego na przewróceniu uwagi – lub nawet próbując deepfake je wszystkie (systemy deepfake z autokoderem nie mają możliwości „rozpoznawania tożsamości”, które w tym scenariuszu mogłyby skupić uwagę na jednej osobie).

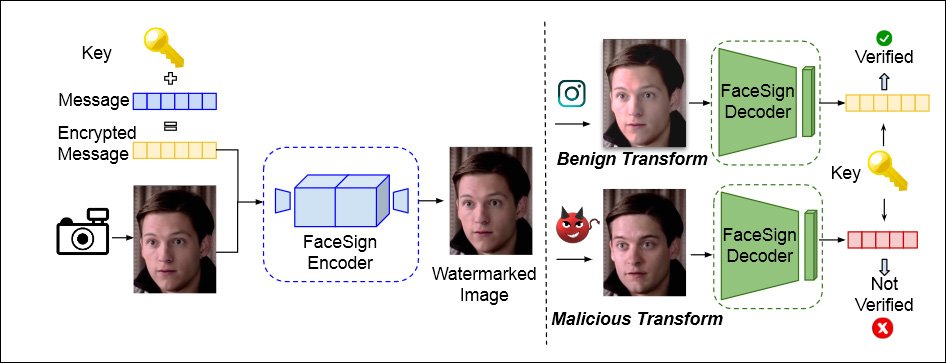

Steganografia i przeciążenie

GOTCHA obejmuje również podejście pierwszy zaproponowany przez Uniwersytet Kalifornijski w San Diego w kwietniu tego roku i który wykorzystuje steganografię do szyfrowania wiadomości w lokalnym strumieniu wideo użytkownika. Procedury Deepfake całkowicie zniszczą tę wiadomość, co doprowadzi do niepowodzenia uwierzytelnienia.

Z artykułu opublikowanego w kwietniu 2022 r. na Uniwersytecie Kalifornijskim w San Diego i Uniwersytecie Stanowym w San Diego opisano metodę określania autentycznej tożsamości poprzez sprawdzenie, czy sygnał steganograficzny wysyłany do strumienia wideo użytkownika przetrwa w nienaruszonym stanie pętlę lokalną – jeśli tak się nie stanie, oznacza to głębokie oszustwo może być pod ręką. Źródło: https://arxiv.org/pdf/2204.01960.pdf

Dodatkowo GOTCHA może przeciążać system lokalny (przy dostępie i pozwoleniu), duplikując strumień i prezentując „nadmierne” dane dowolnemu systemowi lokalnemu, mające na celu spowodowanie awarii replikacji w lokalnym systemie deepfake.

System zawiera dalsze testy (szczegóły w artykule), w tym wyzwanie, w przypadku korespondenta korzystającego ze smartfona, polegające na odwróceniu telefonu do góry nogami, co zniekształci lokalny system deepfake:

Ponownie, tego rodzaju rozwiązanie sprawdziłoby się tylko w przekonującym przypadku użycia, w którym użytkownik jest zmuszony przyznać lokalny dostęp do strumienia i nie można tego wdrożyć poprzez prostą pasywną ocenę wideo użytkownika, w przeciwieństwie do testów interaktywnych (takich jak naciśnięcie palec w twarz).

Praktyczność

W artykule pokrótce poruszono kwestię, w jakim stopniu testy tego typu mogą denerwować użytkownika końcowego lub w jakiś sposób mu przeszkadzać – na przykład wymagając od użytkownika posiadania pod ręką szeregu przedmiotów, które mogą być potrzebne do przeprowadzenia testów, takie jak okulary przeciwsłoneczne.

Przyznaje również, że nakłonienie wpływowych korespondentów do przestrzegania procedur testowych może być trudne. Odnosząc się do przypadku wideorozmowy z Prezesem, autorzy stwierdzają:

„Przydatność może być tutaj kluczowa, więc nieformalne lub niepoważne wyzwania (takie jak zniekształcenie lub wyraz twarzy) mogą być nieodpowiednie. Wyzwania z użyciem zewnętrznych przedmiotów fizycznych mogą nie być pożądane. Kontekst jest tu odpowiednio modyfikowany, a GOTCHA odpowiednio dostosowuje swój zestaw wyzwań.

Dane i testy

GOTCHA została przetestowana na czterech odmianach lokalnego systemu deepfake na żywo, w tym na dwóch odmianach bardzo popularnego kreatora deepfakes z autoenkoderem GłębokaTwarzLab („DFL”, choć, co zaskakujące, gazeta nie wspomina DeepFace na żywo, co było, od sierpnia 2021 r, „na żywo” implementacja DeepFaceLab i wydaje się najbardziej prawdopodobnym początkowym źródłem potencjalnego oszusta).

Cztery systemy zostały „lekko” przeszkolone przez DFL na niesławnej osobie uczestniczącej w testach i parze celebrytów; DFL trenował pełniej, do ponad 2 milionów iteracji lub kroków, przy czym można by oczekiwać znacznie wydajniejszego modelu; Animator obrazu ukrytego (LIA); I Generatywna sieć przeciwników z zamianą twarzy (FSGAN).

Na potrzeby danych badacze przechwycili i wyselekcjonowali wyżej wymienione klipy wideo, na których 47 użytkowników wykonywało 13 aktywnych wyzwań, a każdy z nich generował około 5–6 minut wideo w rozdzielczości 1080p przy 60 klatkach na sekundę. Autorzy stwierdzają również, że dane te zostaną ostatecznie upublicznione.

Wykrywanie anomalii może być wykonywane przez obserwatora lub algorytmicznie. W przypadku tej drugiej opcji system został przeszkolony na 600 twarzach z Zbiór danych FaceForensics. Funkcją utraty regresji była potężna funkcja wyuczonego podobieństwa plam obrazu percepcyjnego (LPIPS), podczas gdy do uczenia klasyfikatora wykorzystano binarną entropię krzyżową. Kamera własna wykorzystano do wizualizacji ciężarów detektora.

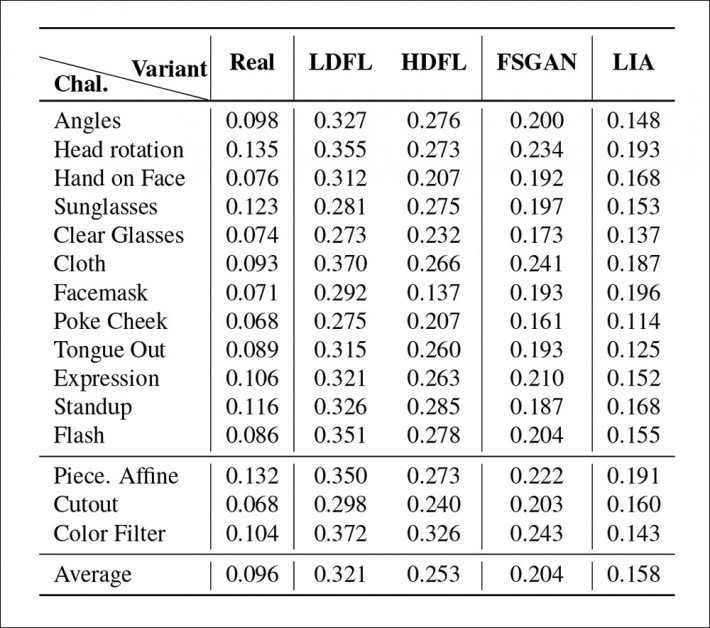

Podstawowe wyniki testów dla GOTCHA.

Badacze odkryli, że w przypadku pełnej kaskady testów w czterech systemach najmniejszą liczbę i najcięższą anomalię (tj. artefakty, które ujawniałyby obecność fałszywego systemu) uzyskano w przypadku lepiej wyszkolonej dystrybucji DFL. Mniej wyszkolona wersja miała szczególne trudności z odtworzeniem skomplikowanych ruchów warg (które zajmują bardzo mało kadru, ale przyciągały dużą uwagę człowieka), podczas gdy FSGAN zajmował środek pomiędzy dwiema wersjami DFL, a LIA okazała się całkowicie nieadekwatna do tego zadania , a naukowcy wyrazili opinię, że rozwiązanie LIA nie powiedzie się w rzeczywistym wdrożeniu.

Opublikowano po raz pierwszy 17 października 2022 r.