Sztuczna inteligencja

Oferuje Google LipSync3D Ulepszoną Synchronizację Ruchu Warg ‘Deepfaked’

Współpraca pomiędzy badaczami z Google AI a Indian Institute of Technology Kharagpur oferuje nowy framework do syntezy nagłówków rozmawiających z treści audio. Projekt ma na celu wyprodukowanie zoptymalizowanych i rozsądnie zasobowych sposobów tworzenia treści wideo “nagłówków rozmawiających” z audio, w celu synchronizacji ruchu warg z dubbingowanym lub tłumaczonym maszynowo audio, oraz do użycia w awatarach, w aplikacjach interaktywnych i w innych środowiskach w czasie rzeczywistym.

Źródło: https://www.youtube.com/watch?v=L1StbX9OznY

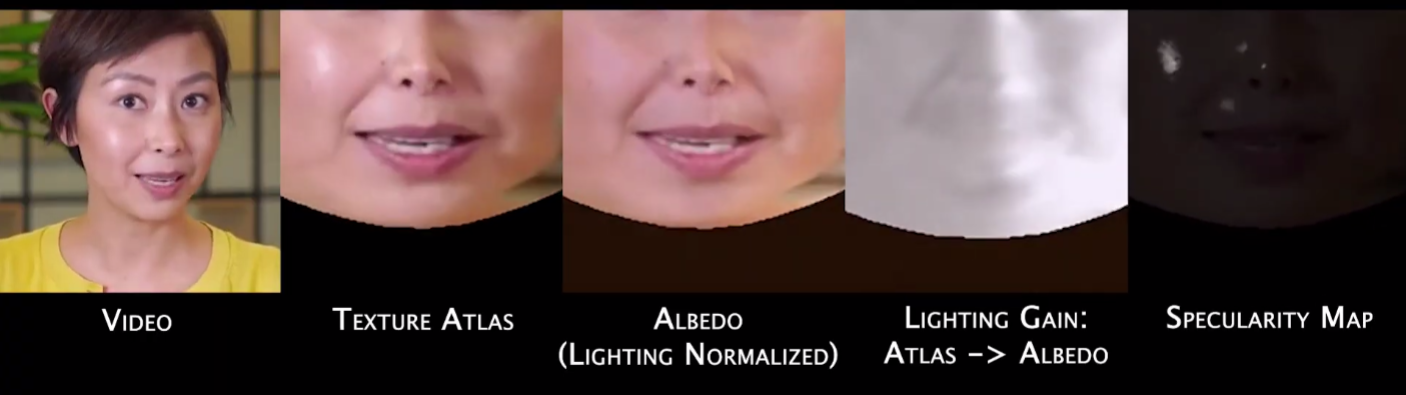

Modele uczenia maszynowego wytrenowane w tym procesie – zwane LipSync3D – wymagają tylko jednego wideo twarzy docelowej jako danych wejściowych. Potok przygotowania danych oddziela ekstrakcję geometrii twarzy od oceny oświetlenia i innych aspektów wideo wejściowego, co pozwala na bardziej ekonomiczne i ukierunkowane szkolenie.

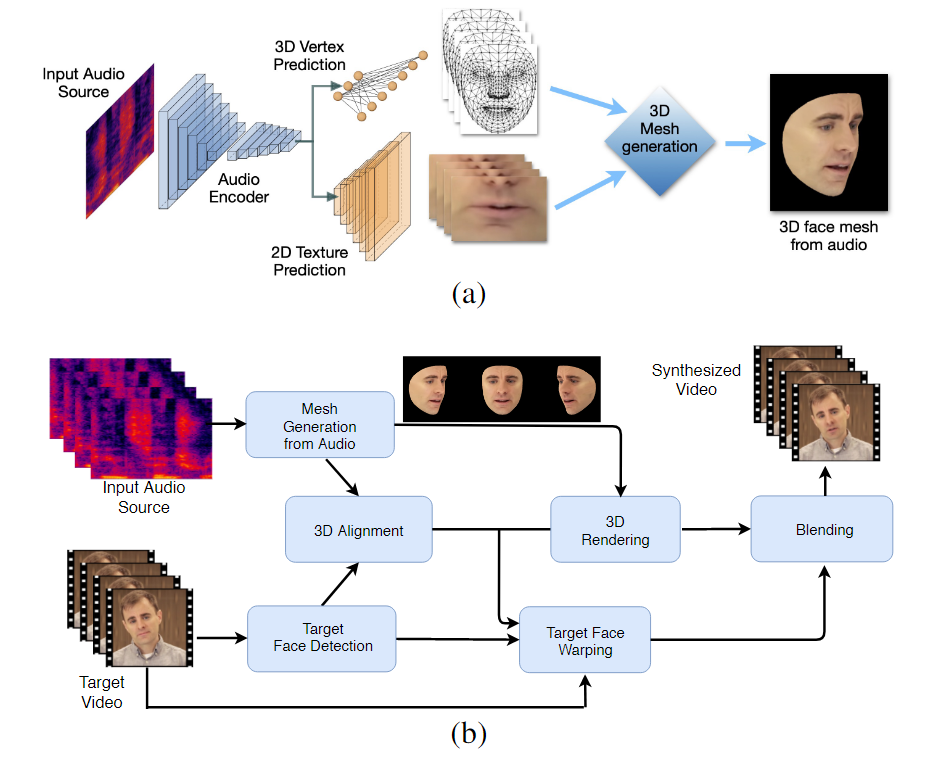

Dwustopniowy przepływ pracy LipSync3D. Powyżej, generowanie dynamicznie teksturoowanej twarzy 3D z ‘docelowego’ audio; poniżej, wstawienie wygenerowanej siatki do wideo docelowego.

W rzeczywistości, najbardziej godny uwagi wkład LipSync3D w badania w tej dziedzinie może być jego algorytm normalizacji oświetlenia, który rozdziela szkolenie i inferencję oświetlenia.

Rozdzielanie danych oświetlenia od ogólnej geometrii pomaga LipSync3D wytwarzać bardziej realistyczne ruchy warg w trudnych warunkach. Inne podejścia z ostatnich lat ograniczały się do ‘stałych’ warunków oświetlenia, które nie ujawnią ich bardziej ograniczonej pojemności w tym zakresie.

Podczas przetwarzania wstępnego klatek wejściowych, system musi zidentyfikować i usunąć punkty świecące, ponieważ są one specyficzne dla warunków oświetlenia, w których zrobiono wideo, i w przeciwnym razie będą przeszkadzać w procesie ponownego oświetlenia.

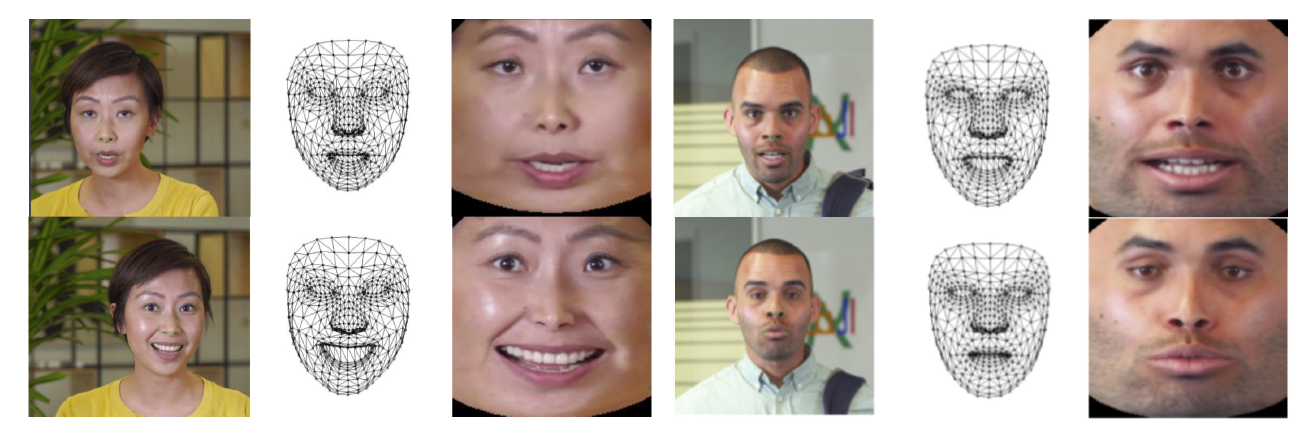

LipSync3D, jak jego nazwa wskazuje, nie wykonuje tylko analizy pikseli na twarzach, które ocenia, ale aktywnie używa zidentyfikowanych punktów orientacyjnych twarzy do generowania motylich siatek CGI, wraz z “rozłożonymi” teksturami, które są owijane wokół nich w tradycyjnym potoku CGI.

Normalizacja pozy w LipSync3D. Po lewej stronie są klatki wejściowe i wykryte cechy; w środku, znormalizowane wierzchołki wygenerowanej siatki; a po prawej, odpowiadająca atlas tekstury, który dostarcza podstawę prawdy dla predykcji tekstury. Źródło: https://arxiv.org/pdf/2106.04185.pdf

Oprócz nowatorskiej metody ponownego oświetlenia, badacze twierdzą, że LipSync3D oferuje trzy główne innowacje w stosunku do poprzednich prac: separację geometrii, oświetlenia, pozy i tekstury na oddzielne strumienie danych w przestrzeni znormalizowanej; łatwo trenowalny model predykcji tekstury auto-regresyjnej, który wytwarza spójną syntezę wideo w czasie; oraz zwiększony realizm, oceniany przez oceny ludzkie i obiektywne metryki.

Rozdzielanie różnych aspektów obrazu twarzy wideo pozwala na większą kontrolę w syntezie wideo.

LipSync3D może wywieść odpowiednią geometrię ruchu warg bezpośrednio z audio, analizując fonemy i inne aspekty mowy, i tłumacząc je na znane odpowiadające pozy mięśni wokół ust.

Ten proces używa potoku wspólnej predykcji, gdzie wywnioskowana geometria i tekstura mają dedykowane kodery w zestawie autoenkodera, ale dzielą jeden kodery audio z mową, która ma być nałożona na model:

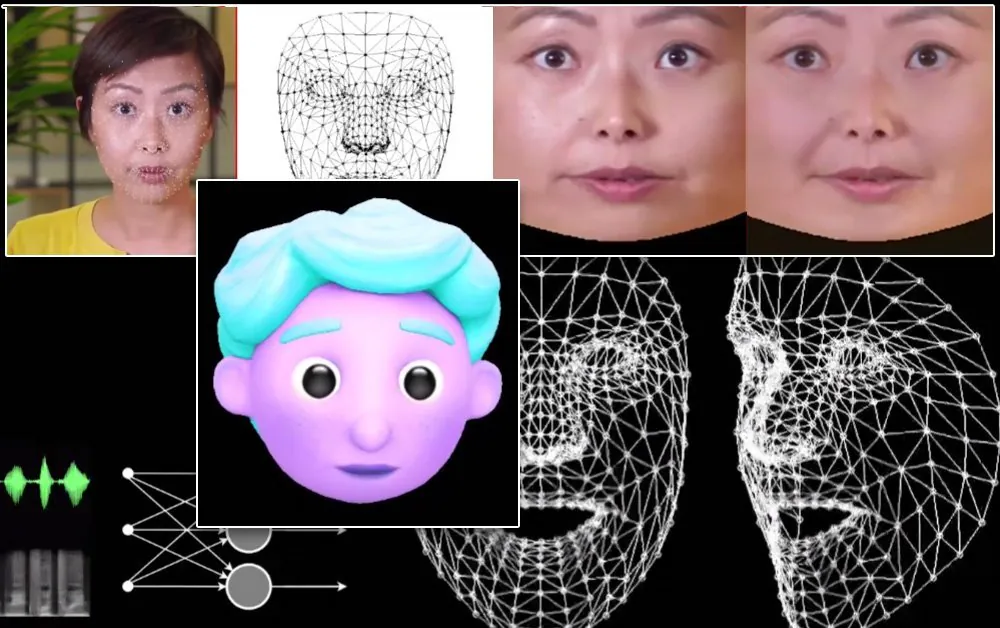

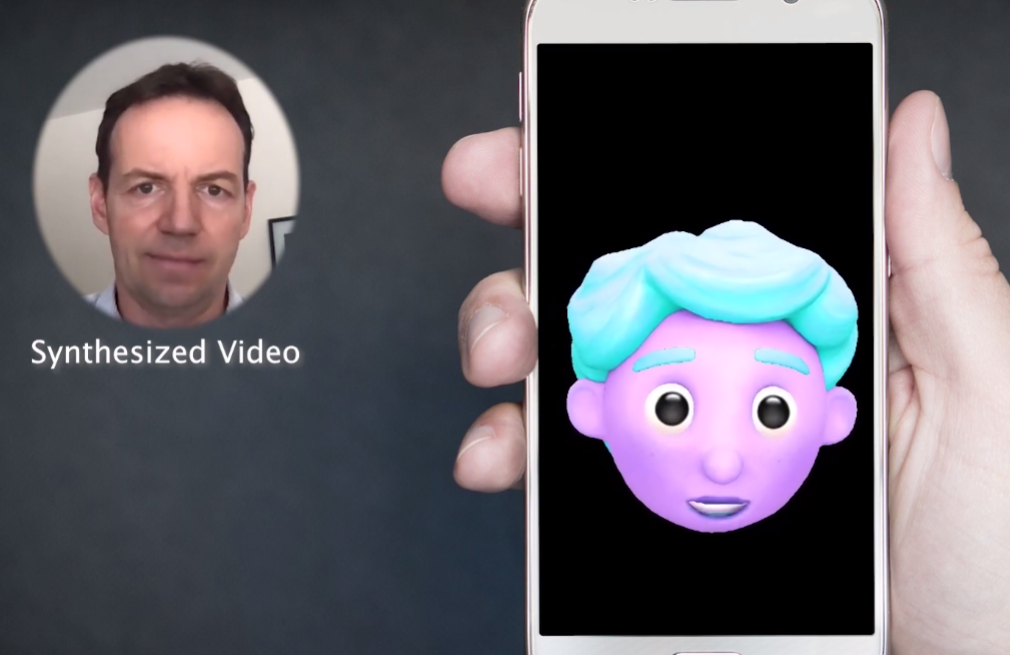

Synteza ruchu LipSync3D jest również przeznaczona do zasilania stylizowanych awatarów CGI, które w rzeczywistości są tylko tym samym rodzajem siatki i informacji tekstury, co obrazy rzeczywiste:

Stylizowany awatar 3D ma swoje ruchy warg zasilane w czasie rzeczywistym przez wideo źródłowe. W takim przypadku najlepsze wyniki uzyskałoby się dzięki personalizowanemu wstępnemu szkoleniu.

Badacze również przewidują użycie awatarów z nieco bardziej realistycznym odczuciem:

![]()

Czas szkolenia próbek wideo wynosi od 3 do 5 godzin dla wideo 2-5 minutowego, w potoku, który używa TensorFlow, Python i C++ na GeForce GTX 1080. Sesje szkoleniowe używały rozmiaru partii 128 klatek przez 500-1000 epok, przy czym każda epoka reprezentowała pełną ocenę wideo.

Ku Dynamicznej Re-Synchronizacji Ruchu Warg

Dziedzina re-synchronizacji warg w celu dostosowania nowego śladu audio otrzymała dużą uwagę w badaniach wizji komputerowej w ostatnich latach (patrz poniżej), nie tylko dlatego, że jest produktem ubocznym kontrowersyjnej technologii deepfake.

W 2017 roku Uniwersytet Waszyngton przedstawił badania zdolne do nauki synchronizacji warg z audio, używając go do zmiany ruchu warg byłego prezydenta Obamy. W 2018 roku; Max Planck Institute for Informatics poprowadził inny projekt badawczy w celu umożliwienia transferu wideo tożsamości, z synchronizacją warg jako produktem ubocznym procesu; a w maju 2021 roku startup AI FlawlessAI ujawnił swoją własną technologię synchronizacji warg TrueSync, która została szeroko przyjęta w prasie jako umożliwiająca ulepszoną technologię dubbingu dla głównych wydań filmowych w różnych językach.

I, oczywiście, ciągły rozwój otwartych repozytoriów deepfake stanowi kolejną gałąź aktywnych badań użytkowników w tej sferze syntezy obrazu twarzy.