Kąt Andersona

AI Woliłby Czytać Książkę Niż Oglądać Film

To zaskakująco trudno nakłonić modele AI do oglądania i komentowania rzeczywistej zawartości wideo, nawet jeśli zostały stworzone do tego celu. Są one bardziej zainteresowane słowem pisanym.

Jeśli kiedykolwiek próbowałeś przesłać krótki klip wideo do ChatGPT lub podobnego popularnego modelu wizji/języka, możesz być zaskoczony, gdy zorientujesz się, że nie mogą one faktycznie parsować wideo. Chociaż modele takie jak ChatGPT-4o+ są w stanie analizować poszczególne klatki – w postaci obrazów, takich jak JPEG i PNG – wolą, aby użytkownik wyodrębnił własne klatki i przesłał je jako obrazy (które są przygotowane do komentowania).

W przypadku serii OpenAI GPT jeden może, dość pracy, wyodrębnić pełny przebieg klatek z klipu wideo i podać je do ChatGPT, w celu, na przykład, generowania ścieżki narracyjnej utworzonej przez AI dla wideo:

![Obrazy i kod z tutorialu OpenAI na temat parsowania wielu wyodrębnionych klatek w celu opracowania komentarza AI dla klipu wideo. [ Źródło ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Obrazy i kod z tutorialu OpenAI na temat parsowania wielu wyodrębnionych klatek w celu opracowania komentarza AI dla klipu wideo. Źródło

Ale to użytkownik musi dokonać konwersji z wideo na klatki, albo przez wywołanie funkcji w większej rutynie, jak w powyższym przykładzie, albo przez wyodrębnienie klatek za pomocą FFMPEG lub różnych bezpłatnych i płatnych rozwiązań do edycji wideo.

W pewnym stopniu, być może nawet w dużym stopniu, ograniczenia analizy wideo w produktach o wysokiej skali, takich jak ChatGPT, zależą od użycia zasobów: po prostu wyposażenie jednego wystąpienia AI w wybraną kolekcję najpopularniejszych kodeków wideo i zaangażowanie zasobów obliczeniowych w proces ekstrakcji, który jest ciężki dla dysku i ograniczający CPU, nie jest żadnym małym rozważaniem, gdyby setki milionów użytkowników zdecydowały się zacząć używać tych udogodnień każdego dnia.

Ponadto analiza temporalna może malować zupełnie inny obraz niż pojedyncza klatka (wyobraź sobie kogoś, kto wchodzi do domu w dobrym nastroju, a następnie odkrywa ciało); dlatego też branie pod uwagę całego temporalnego “skrótu” nawet krótkiego klipu wideo jest wymagającym i zasobochłonnym zadaniem – a także specjalistycznym obszarem literatury badawczej, na przykład z bieżącym rozwojem ram, takich jak Optical Flow – które podstawowo “rozwiną” długość wideo, aby można było na niego patrzeć i działać, jak na dokument statyczny:

![Diagramy przepływu optycznego pokazują, w jaki sposób ruch jest śledzony w sekwencji wideo, z zielonymi wektorami pokazującymi kierunek i intensywność ruchu. Te mapy zapewniają ciągłość czasową potrzebną dla VLM i mogą również służyć jako przewodniki strukturalne w przepływach VFX. [ Źródło ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Diagramy przepływu optycznego pokazują, w jaki sposób ruch jest śledzony w sekwencji wideo, z zielonymi wektorami pokazującymi kierunek i intensywność ruchu. Te mapy zapewniają ciągłość czasową potrzebną dla VLM i mogą również służyć jako przewodniki strukturalne w przepływach VFX. Źródło

Ustalenie się na Notatkach

Niemniej, ponieważ modele takie jak Google’s Notebook LM i nowsze wpisy ChatGPT są w stanie odczytać powiązaną metadane (tj. osadzony tekst, który kontekstualizuje wideo w jakiś sposób), nie zabraniają one przesyłania plików wideo; i czasami nawet podejmują próbę interpretacji wideo, które nie zawiera takich danych.

W następującym przypadku przesłałem 6-sekundowy losowy klip z włoskiego filmu Ręka Boga (2021) do NotebookLM, upewniając się, że klip zawiera zero przydatnego tekstu, ani w metadanych, ani w nazwie pliku.

NotebookLM następnie przystąpił do elaborowanego hallucynowania materiału całkowicie niezwiązanego z wideo*, wraz z nonsensownym i niezwiązanym pięciominutowym podcastem:

Zwykła chwila w 6-sekundowym klipie z włoskiego filmu jest dziko nieprawidłowo interpretowana przez NotebookLM. Źródło: Google NotebookLM

Chociaż Notebook, podobnie jak ChatGPT, zaakceptuje film wideo jako dane wejściowe, zrobi to tylko wtedy, gdy wideo zawiera interpretabilną warstwę tekstową adnotacji i/lub napisy (nie napisy rastrowe, które są wypalane w wideo).

W ten sposób ciężka praca rzeczywistego patrzenia na zawartość wideo i wykonywania semantycznej interpretacji (prawna konieczność dla YouTube, ze względu na jego środki ochrony praw autorskich, i jego system ochrony tożsamości, który jest w trakcie realizacji), została wykonana w wolnym czasie po przesłaniu użytkownika, kiedy klip mógł być zaalokowany niezbędne zasoby przetwarzania.

Rzeczywista interpretacja wideo jest droga i wyczerpująca, i okazuje się, że nawet modele, które zostały przeszkolone specjalnie do wykonania tego zadania, wolą czytać tekst niż rzeczywiście patrzeć na wideo.

TL;DW

To, zgodnie z nowym artykułem z Uniwersytetu w Bristolu w Wielkiej Brytanii, zatytułowanym Wideo nie jest warte tysiąca słów, w którym dwóch autorów stwierdza, że bieżące modele języka wizji (VLM) – modele specjalnie zaprojektowane do analizy wideo w bardziej starannym sposób, i do udziału w odpowiedzi na pytania wideo (VQA) – również domyślnie wybierają informacje oparte na tekście, kiedy tylko mogą.

Gdy podano im zarówno ruchome obrazy, jak i napisane pytania i odpowiedzi wielokrotnego wyboru, autorzy artykułu stwierdzili, że modele zwykle opierały swoje wybory na wzorcach w tekście, a nie na tym, co działo się na ekranie – w wielu przypadkach wykonując równie dobrze, nawet gdy pytanie zostało całkowicie usunięte.

W tym, co wydaje się być zwyczajnym rodzajem przycinania lub oszustwa, to, co było najważniejsze dla większości modeli, było możliwość dostrzeżenia wzorców w możliwych odpowiedziach; dopiero gdy zadanie zostało utrudnione przez dodanie więcej opcji odpowiedzi, AI zaczęły zwracać większą uwagę na wideo.

Autorzy poddali testom VQA sześć modeli VLM o różnych długościach kontekstu, na czterech odpowiednich zestawach danych; i stwierdzili, że wyniki wskazują na zależność modeli od tekstu w stosunku do zawartości wideo.

Przykład ze studium, pokazujący, jak model analizy wideo waży to, co widzi, w stosunku do tego, co czyta. Klip pokazuje osobę tkającą bambus, jednak model przypisuje znacznie większe znaczenie napisanemu pytaniu i tekstu odpowiedzi niż samym klatkom wideo. Niebieskie podświetlenia oznaczają elementy, które wspierają wybraną odpowiedź, podczas gdy czerwone oznaczają te, które pociągają ją w przeciwnym kierunku, ilustrując, w jaki sposób rozumowanie modelu koncentruje się na sformułowaniu, a nie na ruchomych obrazach. Źródło

Metoda

Aby zrozumieć, jak dużo każdy element wejściowy przyczynia się do decyzji modelu, nowa praca wykorzystuje metodę z teorii gier zwaną wartościami Shapleya. Oryginalnie zaprojektowana do sprawiedliwego podziału wypłaty między graczami w koalicji, wartości Shapleya przypisują kredyt do każdego “gracza” na podstawie ich indywidualnego wpływu.

Skutecznie więc, graczami w tym scenariuszu są albo klatki wideo, albo składniki tekstowe (adnotacje, napisy, podpisy itp.) zadania VQA; a “wypłata” jest ostateczną odpowiedzią modelu. Przez systematyczne testowanie tego, co się dzieje, gdy każda część jest dodana lub usunięta, technika ujawnia, jak ważny był ten element w uzyskaniu wybranej odpowiedzi.

W przypadku nowego projektu wartości Shapleya zostały dostosowane do obsługi wielu typów danych, z komponentami wideo i tekstu traktowanymi oddzielnie, a ich różny wpływ na dane wyjściowe modelu został zmierzony, ujawniając, czy zawartość wideo była rzeczywiście interpretowana, czy też były używane pisane wskazówki jako skróty.

Metryki

Zdefiniowano dwie proste metryki, aby porównać, jak dużo każda modalność (tj. wideo, pytanie lub odpowiedź) przyczynia się do decyzji modelu: Wkład modalności mierzy, jak dużo całkowitej wyjaśnienia pochodzi z każdego typu danych wejściowych; tutaj wszystkie dostępne wartości Shapleya są sumowane, a udział należący do każdej modalności jest obliczany jako procent całkowitego.

Po drugie, Wkład na cechę koryguje fakt, że niektóre modalności, takie jak wideo, zawierają znacznie więcej cech niż inne. Zamiast tego, średnia wartość Shapleya jest obliczana dla każdej cechy, a te średnie są porównywane, aby określić, która modalność ma dominujący wpływ.

Dane i testy

Autorzy przetestowali podejście na sześciu modelach VLM o różnych charakterystykach, zaprojektowanych w celu zapewnienia, że testy będą miały ogólne i szerokie zastosowanie. Dlatego modele zostały wybrane ze względu na różne długości kontekstu, wiek (tj. jak długo od czasu wydania ramy) i różne konfiguracje architektury.

Kandydaci byli FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (który wykorzystuje Qwen2); i LongVA (również wykorzystujący Qwen2).

Z tym samym celem różnorodności cztery docelowe zestawy danych zostały wybrane: EgoSchema, zestaw danych VQA zaprojektowany w taki sposób, aby nie można było go ukończyć bez pełnego obejrzenia powiązanych wideo; HD-EPIC, zestaw danych skupiony na kuchni, zawierający niektóre niezwykle długie wideo; MVBench, starannie wyselekcjonowany zbiór wkładów z innych zestawów danych; i LVBench, który stawia pytania VQA dotyczące bardzo długich wideo.

Z nich autorzy opracowali 60 pytań – po 10 z każdego typu pytania.

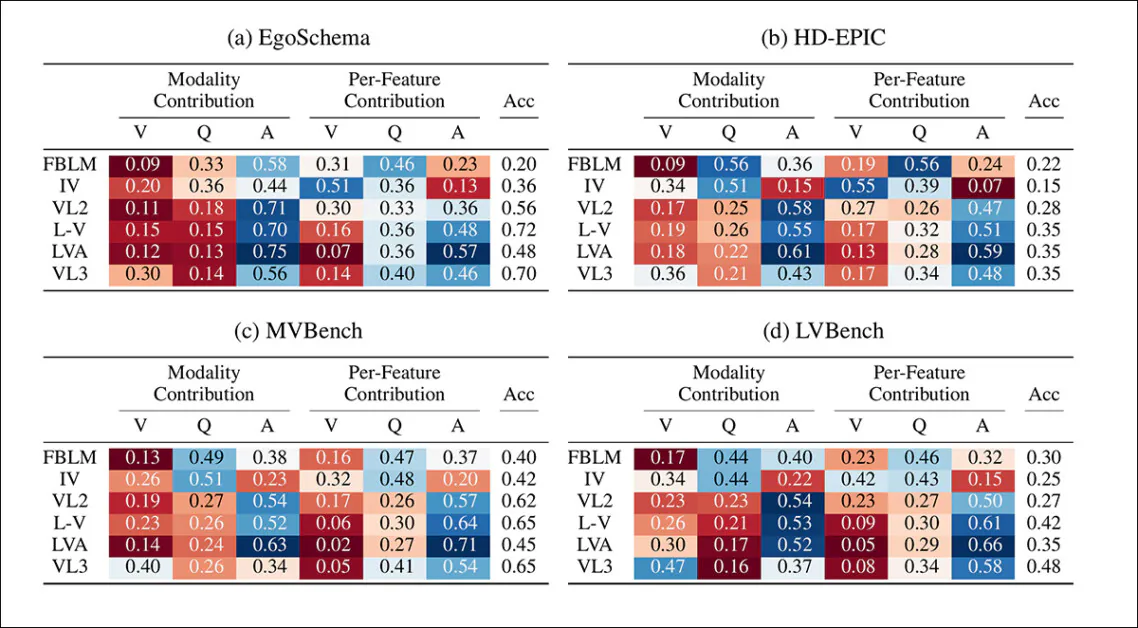

Wyniki wskaźników wkładu ujawniły, że większość modeli polegała bardziej na tekście niż na wideo, zwłaszcza w przypadku oceny klatka po klatce. Nawet tam, gdzie wideo miało rozsądną wagę w ogólnym wkładzie, jego wpływ na cechę był często minimalny, sugerując, że chociaż model mógł korzystać z wideo w sposób ogólny, zwracał niewielką uwagę na poszczególne klatki. VideoLLaMA3 był głównym odstępstwem od tej reguły, z większą zależnością wizualną, zwłaszcza w przypadku dłuższych sekwencji w LVBench:

Wyniki wkładu modalności (MC) i wkładu na cechę (PFC) w modelach i zestawach danych, pokazujące względną wagę wejść wideo (V), pytania (Q) i odpowiedzi (A). Chłodniejsze kolory wskazują silniejsze wkłady; cieplejsze kolory wskazują słabsze lub nieistotne wpływy. We wszystkich ustawieniach język jest wyraźnie dominujący, a wideo jest często pomijane – zwłaszcza w przypadku wpływu na klatkę.

Co do tekstu, pytanie tendencję do znaczenia więcej niż odpowiedź, zwłaszcza w przypadku silniejszych modeli. Było to najbardziej widoczne w zestawach danych takich jak EgoSchema, gdzie pytania były dłuższe i bardziej naturalistyczne, podczas gdy odpowiedzi były krótkie i czasami schematyczne. MVBench odwrócił to nieco, ponieważ jego struktura odpowiedzi binarnych powiększała pozornie ważność tokenów odpowiedzi.

We wszystkich modelach i zestawach danych wizja była konsekwentnie pomijana, a język wykonywał większość ciężkiej pracy.

Artykuł stwierdza:

‘[Dla] modeli o długim kontekście, wideo pokazuje znacznie zmniejszone wkłady, co oznacza, że wartości Shapleya na klatkę są znacznie mniejsze niż ich odpowiedniki w cechach tekstowych.

‘Wideo jako cała modalność jest nadal wysoce istotne, ale to dowód, że wartości Shapleya ich poszczególnych klatek są bardziej skupione wokół zera, i że uwaga modelu do nich jest znacznie mniej ukierunkowana niż w przypadku tekstu.’

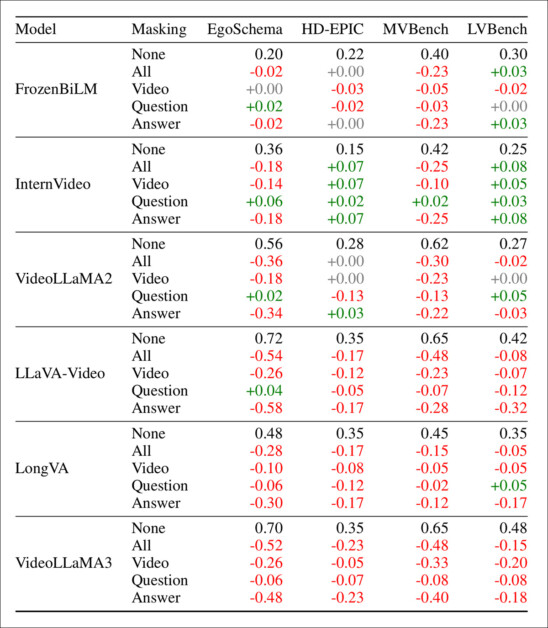

Aby przetestować, jak każda część danych wejściowych przyczynia się do dokładności modelu, badacze przeprowadzili dodatkowe testy za pomocą maskowania – celowego ukrywania jednej lub więcej części danych wejściowych i sprawdzania, jak bardzo dokładność modelu ulega zmianie w wyniku tego.

Jeśli dokładność znacznie spada, gdy określone dane wejściowe są usunięte, oznacza to, że dane te są prawdopodobnie ważne; jeśli model wykonuje się mniej więcej tak samo, sugeruje to, że brakująca część nie była silnie wykorzystywana. W tym sensie testy maskowania są rodzajem iteracyjnego badania ablacjacji.

Wpływ maskowania danych wejściowych wideo, pytania lub odpowiedzi na czterech benchmarkach VQA. Wyniki pokazują zmianę od niezmaskowanego wyniku bazowego. Czerwony kolor oznacza niższą dokładność, zielony wyższą. Modele często utrzymywały wysokie wyniki bez wideo, ale straciły więcej, gdy odpowiedź (tekst) została usunięta. Pytanie mogło zwykle być maskowane z minimalnym wpływem.

Wyniki (wizualizacja powyżej) wskazują, że odpowiedzi (tekstowe odpowiedzi w danych wielokrotnego wyboru) mają największy wpływ we wszystkich przypadkach. Maskowanie odpowiedzi zwykle powodowało największy spadek dokładności, często redukując modele do niemal losowych wyników.

Jednak maskowanie pytania zwykle miało znacznie mniejszy wpływ, co potwierdza wcześniejsze stwierdzenie, że modele często niedoceniają pytanie.

W niektórych przypadkach dokładność nawet poprawiła się gdy pytanie zostało usunięte, co sugeruje, że modele czasami po prostu dopasowywały odpowiedzi do wizualnych lub tekstowych wskazówek, zamiast właściwie oceniać pytanie.

Modele również różniły się pod względem zależności od wideo: niektóre utrzymywały rozsądną dokładność bez niego, co potwierdza wcześniejsze stwierdzenie, że cechy wideo mają ograniczony wkład we współczesnych konfiguracjach.

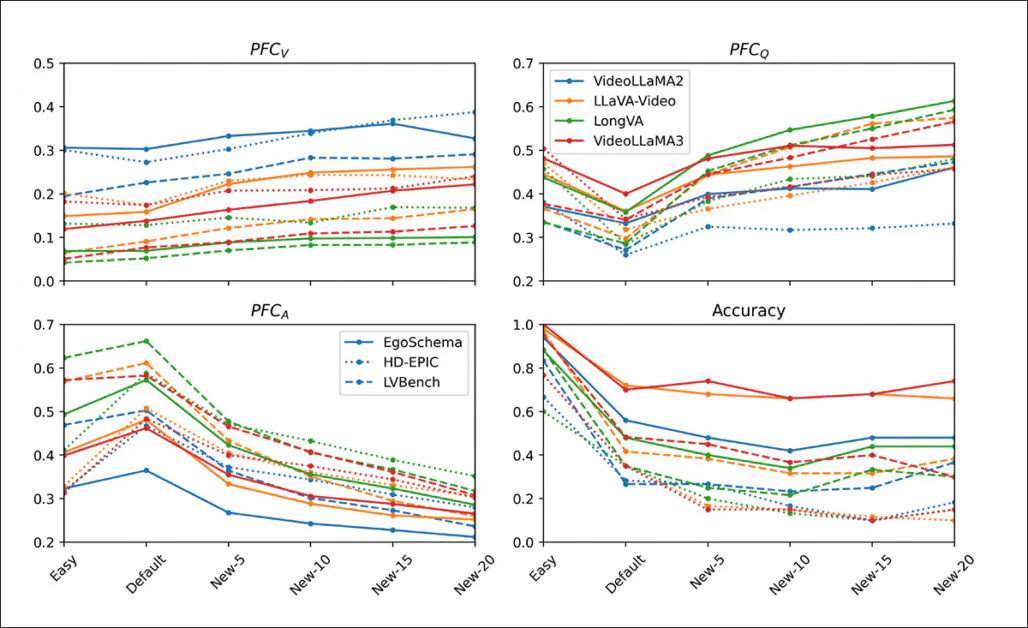

Autorzy następnie przetestowali, czy modele mogą być zmuszone do polegania na wideo, dodając dodatkowe niewłaściwe odpowiedzi do opcji wielokrotnego wyboru.

Gdy rozproszenia były łatwe i pochodziły z innych pytań, wyniki poprawiły się, ponieważ modele dopasowywały wzorce tekstowe bez większego rozumu. Ale z dziesięcioma lub więcej niezwiązanymi odpowiedziami zaczęły one bardziej polegać na wideo i pytaniu:

Wkład na cechę i dokładność dla danych wejściowych wideo, pytania i odpowiedzi, gdy dodawane są dodatkowe niewłaściwe odpowiedzi do każdego testu VQA, pokazując, że zwiększanie liczby rozproszeń redukuje dominację tekstu i zwiększa względną wagę cech wizualnych i pytań.

Dla VideoLLaMA3 maskowanie wideo zmniejszyło dokładność o 40% w EgoSchema i 15% w LVBench, co wskazuje, że proste zwiększenie liczby odpowiedzi może przesunąć modele od skrótów tekstowych w kierunku prawdziwego wielomodalnego rozumu.

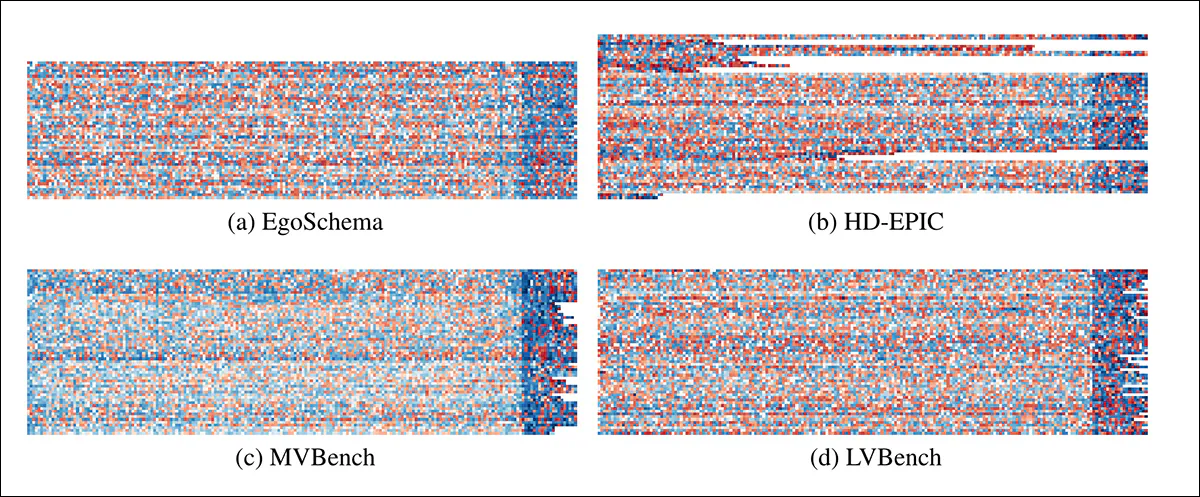

Badacze również zbadali, jak atrybucja jest rozdzielana wśród danych wejściowych, a poniżej widzimy mapy cieplne wartości Shapleya dla każdego wejścia modelu:

Mapy cieplne wartości Shapleya dla czterech zestawów danych, gdzie każdy wiersz przedstawia jeden zestaw VQA, a każda kolumna pojedynczą cechę. Cechy wideo pojawiają się po lewej stronie, po prawej stronie znajduje się tekst. Znacznie silniejsze wartości w (czerwonych) regionach tekstowych potwierdzają, że modele polegają znacznie bardziej na języku niż na wideo.

Komentując wyniki powyżej, autorzy stwierdzają:

‘Wielkość wartości Shapleya jest znacznie większa w prawej części każdej mapy cieplnej, reprezentującej atrybucje pytania i odpowiedzi. Ta wyraźna granica to miejsce, w którym kończą się klatki wideo i zaczynają się cechy tekstowe, demonstrując, że wkład modalności wideo jest znacznie mniejszy niż pytanie/odpowiedź. ‘

W podsumowaniu, we wszystkich zestawach danych wartości są znacznie silniejsze w kierunku tekstu, co silnie wskazuje, że modele polegają znacznie bardziej na języku niż na wskazówkach wizualnych. Nawet tam, gdzie wideo jest używane, wkład jest rozproszony cienko przez wiele klatek, często bez żadnego spójnego wzorca.

Poniżej widzimy przykład z adnotacjami z EgoSchema. Wybrano 16 najbardziej “ważnych” klatek za pomocą wartości Shapleya i pokolorowano je według ich wpływu, z niebieskim oznaczającym pozytywny wkład, a czerwonym negatywny:

Atrybucje Shapleya dla jednego przykładu z EgoSchema, pokazujące 16 najbardziej wpływowych klatek i wszystkie dane wejściowe tekstowe. Wkłady wideo są minimalne w porównaniu z tekstem, który dominuje w rozumowaniu modelu. Niebieski i czerwony kolor oznaczają pozytywny i negatywny wpływ na wybraną odpowiedź.

Wynik jest taki, że prawie każda klatka ma tylko słaby wpływ w porównaniu z słowami w pytaniu i odpowiedziach. Wskazówki wizualne są rzadkie i niespójne, podczas gdy rzeczowniki, takie jak “krzesło” i “ogrodzenie”, kierują modelem w stronę prawidłowego wyboru – lub od niego, w zależności od kontekstu.

Wnioski

Ktokolwiek, kto kiedykolwiek próbował edycji wideo lub analizy wideo, już wie, jak zasobochłonne są te procesy, i rozumie, dlaczego firmy, które parsują miliony żądań AI dziennie, nie mogą pozwolić sobie na to, aby użytkownicy wykonywali ad hoc edycję i interpretację wideo.

Jedną rzeczą, o której należy pamiętać w tym zakresie, jest to, że prawie każde API AI, z którym kiedykolwiek próbujesz współpracować (z możliwym wyjątkiem nowego i krótkotrwałego demo w celu wsparcia nowych badań naukowych), jest zaprojektowane tak, aby osiągnąć życzenia użytkownika na minimalnym poziomie wydatków zasobów.

Oznacza to poleganie na istniejących metadanych z danych dostarczonych przez użytkownika lub RAG odzyskiwania, jeśli to możliwe; oraz wyodrębnianie (jeśli absolutnie konieczne) metadanych dla bardziej parsowalnych formatów, takich jak PDF, dokumenty i pojedyncze obrazy.

To, czego nie ma na stole, to uruchamianie przesłanego wideo przez CLIP lub najnowszy YOLO wydanie, lub przez jakikolwiek zasobochłonny i czasochłonny VLM, który może rzeczywiście zidentyfikować, co jest w klatkach, i zrozumieć, co się dzieje w przesłanym wideo, biorąc pod uwagę czasowość.

Jednak nie oznacza to, że zjawiska, które dokumentuje obecny artykuł, koniecznie wynikają z oszczędnych podejść architektonicznych. Autorzy zauważają, że tekst dominuje w najlepszych paradygmatach szkolenia multimodalnego w każdym przypadku, co wskazuje, że “język wizualny” jest mniej rozwinięty, mniej ważny lub mniej informacyjny w kontekście multimodalnym, lub (przynajmniej na razie) mniej dobrze zrozumiany,

* Co ciekawe, materiał, który NotebookLM wygenerował, wydaje się być albo całkowicie oryginalny, albo całkowicie niezindeksowany przez Google, ponieważ nie jestem w stanie znaleźć żadnych wyników wyszukiwania, które mogłyby się dostać do danych szkoleniowych i spowodować ten wynik.

Pierwotnie opublikowane w piątek, 31 października 2025; edytowane 14:20 w celu sformatowania