Liderzy opinii

Od kodu do leczenia: Następna rewolucja AI potrzebuje ręki (i oczu)

Jak systemy agentic, okulary XR i robotyka będą wspierać ludzi, a nie ich zastępować

Przechodzimy przez paradoks w sztucznej inteligencji.

Na ekranach AI jest nadludzka. Duże modele językowe piszą funkcjonalny kod Pythona w sekundach. Systemy generatywne produkują fotorealistyczne obrazy i filmy w minutach. Nagrodzone systemy, takie jak AlphaFold, przewidziały struktury prawie wszystkich znanych białek. Cyfrowe zwycięstwa się kumulują.

Jednak w fizycznym świecie badań biomedycznych proces odkrycia pozostaje boleśnie ręczny. Nie czujemy, że AI przyspiesza naukę lub medycynę, przynajmniej na razie. Liczby ujawniają głębię problemu. Kamień milowy ankiety Nature przeprowadzonej wśród ponad 1 500 naukowców wykazał, że ponad 70% próbowało i nie powiodło się w powtórzeniu eksperymentów innego badacza. Co gorsza: ponad połowa nie mogła powtórzyć własnej pracy. W biologii nowotworowej konkretnie, ośmioletni projekt powtarzalności ustalił, że tylko 40% wysokowpływowych odkryć mogło być powtórzonych i 68% eksperymentów nie miało wystarczającej dokumentacji, aby nawet spróbować powtórzyć.

To jest brudny sekret nowoczesnej nauki: mamy problem przechwytywania wiedzy, a nie tylko problem odkrycia. Krytyczne szczegóły eksperymentalne żyją w głowach badaczy, a nie w artykułach. Protokoły dryfują. Wiedza niejawna wychodzi za drzwi, gdy stażyści kończą studia. Systemy AI szkolone na opublikowanej literaturze dziedziczą wszystkie te luki.

Podstawowy problem polega na tym, że podczas gdy AI może zaprojektować nowe białko do terapii nowotworowej w symulacji cyfrowej, nie może podnieść pipety, aby to przetestować. Nie może nawigować w brudnym, nieprzewidywalnym świecie laboratoryjnym, aby zwalidować własną hipotezę. Nie może obserwować rąk doświadczonego naukowca i nauczyć się subtelnych technik, które sprawiają, że eksperymenty działają.

Ten “luka wykonawcza” jest największą przeszkodą, która uniemożliwia rewolucji AI stanie się rewolucją medyczną. Podczas gdy większość firm roboczych jest zajęta nauczaniem maszyn, aby składać pranie lub ładować zmywarki, pozostają w tyle pod względem prawdziwie przełomowych możliwości tych postępów w dziedzinach takich jak medycyna.

Aby rozwiązać ten problem, musimy wyjść poza czatboty i w kierunku AI współnaukowców, systemów agentic, które łączą świat cyfrowy z fizycznym, przechodząc poza planowanie i kodowanie, aż do wykonania w świecie rzeczywistym. Na Uniwersytecie Stanforda rozwijamy LabOS, cyfrowo-fizyczny framework AI, który pokazuje, jak agenci AI, okulary XR i robotyka współpracują, aby zamknąć tę lukę, przekształcając eksperymenty naukowe w rozmowę między człowiekiem a maszyną, a jednocześnie automatycznie przechwytując wiedzę, która obecnie ginie.

Wielka przepaść: Dlaczego AI potrzebuje “oczu” i “rąk”

Wiele z najbardziej widocznych zwycięstw AI miało miejsce tam, gdzie środowisko jest w pełni cyfrowe: repozytoria kodu, zestawy danych lub symulowane benchmarki (gdzie AI konkurowało, aby prowadzić wirtualny biznes lub inwestować cyfrowo w akcje).

Laboratoria mokre są inne. Biologia, a ogólnie odkrycia naukowe, jest bardzo głośnym procesem. Instrumenty dryfują, operatorzy improwizują, a “protokół” często żyje częściowo w głowach ludzi. Różnica między czystym wynikiem a nieudanym przebiegiem może być kątem pipetowania, wzorcem wirowania, substytucją odczynnika lub inkubacją, która trwała 10 minut dłużej. Te szczegóły kontekstowe rzadko trafiają do artykułu i są dokładnie tym, czego potrzebuje model AI, jeśli ma generalizować poza zestawem danych.

Dlatego AI laboratoryjne potrzebuje oczu (aby postrzegać, co się dzieje w kontekście), rąk (aby standaryzować i bezpiecznie zautomatyzować kroki o wysokiej zmienności) i pamięci (aby nagrywać, co się naprawdę wydarzyło). Bez tych możliwości modele mogą polecać, co zrobić, ale nie mogą wiarygodnie przetłumaczyć rekomendacji na zwalidowane wykonanie fizyczne lub wyjaśnić niepowodzenia, gdy rzeczywistość odbiega od planu.

Poza czatbotami: Od współpilotów do współnaukowców

Termin “agentic AI” jest czasem używany luźno. W środowiskach biomedycznych powinien oznaczać coś precyzyjnego: system, który może przyjąć cel (na przykład “zoptymalizuj wydajność edycji genów CRISPR, minimalizując niecelowe”), rozłożyć go na sekwencję zadań, wykonać te zadania na narzędziach, ocenić wyniki i dostosować plan pod ograniczeniami i z audytowalnym podejmowaniem decyzji.

To ma znaczenie, ponieważ przepływy pracy badawcze nie są jednym wywołaniem modelu. Są to potoki końcowe, które rozciągają się od formułowania hipotez, projektowania eksperymentów, przetwarzania danych, testowania statystycznego i interpretacji. Ostatnie myślenie w odkryciu leków zaczęło podkreślać systemy agentic, które mogą skalować te potoki, a nie tylko przyspieszać poszczególne kroki (na przykład dyskusja Unite.AI na temat agentów w odkryciu małocząsteczkowych leków).

W inżynierii oprogramowania już widzieliśmy wczesne dowody empiryczne, że AI współpiloci mogą zwiększyć wydajność deweloperów. W biomedycynie analogiczna okazja nie polega tylko na pisaniu kodu, ale na pisaniu i walidowaniu protokołów, strukturyzowaniu danych, monitorowaniu wykonania i zamykaniu pętli między predykcją a pomiarem, łącząc AI z naukowcami w laboratoriach.

LabOS: Kiedy AI działa na systemie operacyjnym dla laboratoriów jutra

W naszej pracy na Uniwersytecie Stanforda nad AI4Science, obejmującej współpilotów edycji genów takich jak CRISPR-GPT i systemy współwykonania AI-XR takie jak LabOS, które pomagają naukowcom w laboratoriach biomedycznych i materiałowych, badaliśmy architektoniczną zmianę:

1. Projektowanie zintegrowanego “systemu operacyjnego laboratoryjnego”, który łączy laboratorium cyfrowe z fizycznym.

Założenie jest proste: jeśli notatnik laboratoryjny jest pamięcią nauki, to system operacyjny laboratoryjny powinien być warstwą wykonawczą, przechwytującą intencje, tłumaczącą ją na działania, obserwującą wyniki i zmieniającą każdy przebieg w ustrukturyzowaną wiedzę.

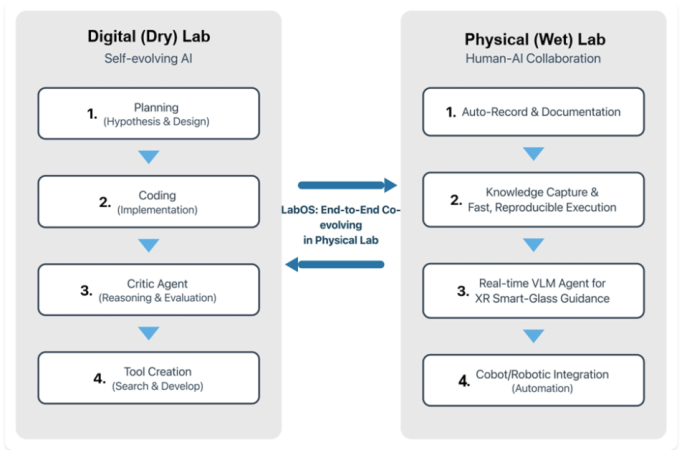

Rysunek. Konceptualny widok LabOS łączący samorozwijający się cyfrowy pętle laboratoryjny (planowanie, kodowanie, krytyka, tworzenie narzędzi) z pętlą laboratoryjną człowiek-AI (auto-dokumentacja, przechwytywanie wiedzy, przewodnictwo XR i integracja robotyczna).

2. AI w laboratorium cyfrowym – samorozwijające się planowanie i budowanie narzędzi

W laboratorium cyfrowym (suchym) możemy pozwolić AI zrobić to, co już dobrze robi: wyszukiwanie, syntezowanie i proponowanie. Chcemy również, aby było samodoskonalące się. Nie przez “halucynowanie nowej nauki”, ale przez uczenie się lepszych narzędzi i przepływów pracy z opinii.

Praktyczny pętle laboratoryjny cyfrowy można scharakteryzować jako cztery powtarzające się etapy:

- Planowanie (hipoteza + projekt): proponuj hipotezy, wybierz zmienne eksperymentalne, przewiduj czynniki zakłócające i określ mijane punkty końcowe.

- Kodowanie (implementacja): generuj lub adaptuj skrypty analityczne, potoki symulacyjne i szablony kontroli instrumentów, gdzie stosowne.

- Agent krytyczny (rozumowanie + ocena): testuj założenia, sprawdzaj moc statystyczną, proponuj kontrole i flaguj prawdopodobne tryby niepowodzenia.

- Tworzenie narzędzi (wyszukiwanie + rozwój): gdy przepływ pracy brakuje składnika (parser, rutyna QC, pulpity), zbuduj go i dodaj z powrotem do zestawu narzędzi.

3. AI w laboratorium fizycznym – AI z “oczyma” (okulary XR) i “rękoma” (robotyka)

Laboratorium fizyczne (mokre) to miejsce, gdzie system albo zyskuje zaufanie – albo je traci. Celem jest nie zastąpienie naukowca, ale zmniejszenie tarcia i błędu, a jednocześnie zwiększenie obserwowalności.

Widzimy pętle laboratoryjną fizyczną jako cztery komplementarne możliwości:

- Auto-nagrywanie i dokumentacja: przechwytywanie działań, znaczników czasu, ustawień instrumentów i odchyleń automatycznie, aby dokumentacja nie była pomyślana jako coś, co robimy później.

- Przechwytywanie wiedzy dla szybkiej, powtarzalnej wykonania: konwertuj przebiegi w ustrukturyzowane, zapywalne artefakty (wersje protokołów, zestawy parametrów, wyniki QC) zgodne z zasadami opiekunów danych, takimi jak FAIR.

- Wizja-językowa pomoc w czasie rzeczywistym za pomocą okularów XR: użyj modeli multimodalnych, aby zinterpretować scenę (co operator robi, jaki odczynnik jest w ręku) i zapewnić krok-po-kroku przewodnictwo i kontrole bezpieczeństwa. AR/XR już wykazało wartość w wysokostakowych przepływach pracy fizycznej, takich jak przewodnictwo eksperymentalne (LabOS, Stanford, Princeton, we współpracy z NVIDIA).

- Integracja cobota/robotyczna do automatyzacji: standaryzuj powtarzalne kroki, umożliwiaj bezpieczne przekazywanie i zmniejszaj zmienność. Platformy dla symulacji-do-świata rzeczywistego (na przykład NVIDIA Isaac) i przetwarzanie AI w czasie rzeczywistym na krawędzi, takie jak transmisja strumieniowa szkła inteligentnego i interakcja człowiek-AI w LabOS, są ważnymi warstwami umożliwiającymi.

Ta architektura jest zgodna z szerszym kierunkiem w dziedzinie: “samosterujące” lub autonomiczne laboratoria, które łączą automatyzację z uczeniem maszynowym, aby zaplanować następny eksperyment. Co LabOS dodaje, to ciaśniejsza warstwa interfejsu ludzkiego, aby autonomia nie szła kosztem przejrzystości.

Dlaczego AI laboratoryjne nie jest po prostu “AI na zestawie danych”

Systemy AI dla superinteligencji naukowej/biomedycznej często wyglądają imponująco w retrospektywnej ocenie lub podczas egzaminów, a potem nie radzą sobie w laboratorium fizycznym. Powodem jest rzadko jeden błąd. Zazwyczaj jest to niezgodność między założeniami modelu a rzeczywistością laboratoryjną.

Trzy luki pojawiają się powtarzalnie:

- Luka kontekstowa: zestawy danych zwykle pomijają zmienne kontekstowe, które operatorzy wiedzą, że mają znaczenie (występy temperatury, numery partii odczynników, subtelne odchylenia od protokołu).

- Luka działania: wiele systemów AI może polecać, co zrobić, ale nie może wiarygodnie przetłumaczyć tej rekomendacji na zwalidowane fizyczne kroki.

- Luka sprzężenia zwrotnego: bez ustrukturyzowanego, wysokiej jakości sprzężenia zwrotnego z wykonania, modele nie mogą się uczyć, gdzie zawodzą – i naukowcy nie mogą audytować, dlaczego.

Zamknięcie tych luk jest mniej związane z wymyśleniem nowej architektury sieci neuronowej, a bardziej z budowaniem instrumentacji, interfejsów i umów dotyczących danych, które czynią laboratorium zrozumiałym dla maszyn i pozwalają AI widzieć i pracować z ludźmi.

Zaufanie przez projekt: Bezpieczeństwo i zarządzanie dla AI, które może działać

AI agentic w badaniach odkrywczych nie tylko podnosi znane obawy dotyczące dokładności. Wprowadza nowe tryby niepowodzenia, ponieważ może działać. W laboratorium działanie oznacza potencjał marnotrawstwa, szkody lub mylących wniosków, zwłaszcza gdy eksperymenty wpływają na hipotezy kliniczne.

Użyteczna postawa jest traktowanie AI-wyposażonej sterty laboratoryjnej jako socio-technicznego systemu, który wymaga pewności. Kilka istniejących ram pomaga, ale muszą być przetłumaczone na rzeczywistość laboratoryjną:

- Zarządzanie ryzykiem jako ciągła praktyka: ramy zarządzania ryzykiem AI NIST (AI RMF 1.0) dostarczają praktycznego słownika do mapowania, pomiaru i zarządzania ryzykiem AI w całym cyklu życia.

- Zgodność regulacyjna dla AI medycznej: praca FDA nad oprogramowaniem AI/ML jako urządzeniem medycznym, w tym Plan działania i powiązane wytyczne, oferuje konkretny widok tego, co “dobra praktyka” wygląda, gdy AI wpływa na opiekę pacjentów.

Dla domen o wysokich konsekwencjach, takich jak edycja genów, zarządzanie jest już globalną dyskusją. Zalecenia są dyskutowane na temat edycji genomu ludzkiego, aby podkreślić potrzebę odpowiednich mechanizmów nadzoru i odpowiedzialnego zarządzania, takich jak te przedstawione przez Amerykańskie Towarzystwo Terapii Genowej i Komórkowej, lub ASGCT. Systemy takie jak LabOS powinny być zaprojektowane tak, aby ułatwić zgodność, a nie utrudniać ją.

Lista kontrolna: Kontrole dla bezpiecznych AI współnaukowców dla odkryć naukowych

W naszej opinii, system operacyjny laboratoryjny, który jest świadomy bezpieczeństwa, powinien wdrożyć co najmniej następujące projekty:

- Pochodzenie domyślnie: każdy zestaw danych, wersja protokołu i dane wyjściowe modelu powinny być śledzone do wejść i znaczników czasu.

- Autonomia ograniczona: system powinien mieć wyraźne uprawnienia (co może zrobić bez potwierdzenia) i reguły eskalacji (kiedy musi poprosić).

- Nadzór ludzki i łagodne pogorszenie: gdy czujniki lub strumienie danych zawodzą, lub niepewność jest wysoka, system powinien wrócić do bezpieczniejszego, prostszego trybu.

- Ciągła walidacja: przewidywania in-silico powinny być sparowane z walidacją laboratoryjną; laboratoryjne przebiegi powinny zawierać bramki QC przed wnioskami, które są przekazywane do modeli/agentów AI w świecie cyfrowym.

- Bezpieczeństwo i świadomość podwójnego użytku: chronić infrastrukturę laboratoryjną przed ingerencją.

Wzmocnij ludzi wszędzie: Czy AI współnaukowcy mogą wyrównać pole?

Jedną z najbardziej kuszących obietnic AI-XR “współnaukowca” nie jest tylko prędkość dla elitarnych instytucji, ale dostępność dla wszystkich. Zastanów się, co obecnie ogranicza mniejsze laboratoria, startupy i oddalone/ wiejskie/ regionalne kliniki:

- Ograniczony dostęp do specjalistycznej ekspertyzy dla złotych standardów protokołów i instrumentów.

- Wyższy koszt szkolenia, błędów i przeróbek.

- Fragmentaryzacja narzędzi: notatniki, arkusze kalkulacyjne, logi instrumentów i skrypty analityczne rzadko łączą się czysto.

System, który może przewodzić wykonaniu w kontekście (przez szkła XR), przechwytuje to, co się wydarzyło automatycznie, i sugeruje następny najlepszy krok na podstawie poprzednich przebiegów, mógłby uczynić zaawansowane testy bardziej powtarzalnymi w różnych miejscach. W zasadzie mógłby również wspierać rozproszone badania kliniczne, gdzie protokoły muszą być wykonywane spójnie, nawet gdy zasoby się różnią.

Plan czasowy: Kiedy każdy naukowiec i klinicysta otrzyma współnaukowca?

Krótko mówiąc, jesteśmy bliżej niż wielu myśli dla niektórych wysokowartościowych, wysokoczęstotliwościowych zadań (takich jak wytwarzanie leku w sposób niezawodny w laboratorium) i dalej niż większość demo sugeruje dla innych (takich jak AI całkowicie rozwiązuje duże problemy, takie jak rak lub choroba Alzheimera). Realistyczna mapa drogowa wygląda następująco:

- Bliski termin (w ciągu 1 roku): Współpiloci przepływu pracy, które zmniejszają obciążenie administracyjne: projektowanie protokołu, synteza literatury, szablony analityczne i automatyczne raporty QC. Czynnik ograniczający jest integracja, a nie zdolność modelu.

- Średni termin (1-2 lata): Systemy współwykonania w laboratorium: przewodnictwo szkła XR, automatyczna dokumentacja i wybiórcza robotyka dla kroków o wysokiej zmienności. Zaufanie będzie zależało od śladów audytowych i ścisłego projektu człowiek-w-pętli.

- Dłuższy termin (3+ lata): Współbadacze międzydomenowi, którzy łączą odkrycie z translacją: łącząc dane laboratoryjne z punktami końcowymi klinicznymi, monitorując sygnały bezpieczeństwa i pomagając w projektowaniu badań – przy jednoczesnym przestrzeganiu oczekiwań regulacyjnych i etycznych.

Od kodu do leczenia: Ścieżka do 1000-krotnego odkrycia naukowego

LabOS jest jedną z prób odpowiedzi na proste pytanie: co, jeśli eksperyment mógł być prowadzony jako rozmowa, gdzie intencja, wykonanie i dowód są połączone od końca do końca? Jeśli zbudujemy te systemy dobrze, mogą pomóc w rozwiązaniu luki translacyjnej, która spowalnia biomedycynę i wiele dyscyplin naukowych (np. nauka o materiałach). Jeśli zbudujemy je źle, zwiększą one niepowtarzalność i utworzą nowe ryzyko bezpieczeństwa.

Najważniejsza praca w najbliższych latach będzie podstawowa: standaryzowane interfejsy danych i urządzeń za pomocą budowy systemu operacyjnego (podobnie jak iOS uruchamia wszystkie rodzaje aplikacji), budowanie benchmarków AI, które obejmują wykonanie i niepewność (takie jak benchmark LabSuperVision w LabOS), oraz rozpoczynanie wdrożenia w świecie rzeczywistym, które zachęcają do innowacji, chroniąc jednocześnie pacjentów i integralność badań.

Dla badaczy i klinicystów pytanie nie brzmi, czy AI wejdzie do laboratorium. Już tam jest. Pytanie brzmi, czy zintegrujemy ją jako zbiór niepołączonych narzędzi, czy jako godny zaufania, audytowalny system zaprojektowany z myślą o realiach nauki biomedycznej.

Podane czytanie i źródła

- Badanie powtarzalności (Nature, 2016): https://www.nature.com/articles/533452a

- Artykuł recenzowany CRISPR-GPT (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Wiadomości Stanford Medicine na temat CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Wstępny artykuł LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Strona internetowa benchmarku LabOS: https://ai4lab.stanford.edu

- Ramka zarządzania ryzykiem AI NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Przegląd FDA oprogramowania AI/ML jako urządzenia medycznego: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Zasady danych FAIR (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI o przeszkodach w odkryciu leków małocząsteczkowych: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI o AI i chirurgii roboczej: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/