Liderzy opinii

Osobowość Twojego AI jest równie ważna jak jego IQ — i może zadecydować o powodzeniu wdrożenia w przedsiębiorstwie

Większość firm nadal wybiera modele AI na podstawie benchmarków. W praktyce rzadko jest to czynnik, który decyduje o tym, czy te systemy naprawdę działają.

Do tej pory większość rozmów na temat dużych modeli językowych w środowiskach przedsiębiorstw była dominowana przez benchmarki. Zespoły są przyciągane przez wymierne wyniki, takie jak który model jest najbardziej inteligentny, najmocniejszy w kodowaniu, najdokładniejszy w podsumowaniach lub w rozumowaniu matematycznym.

Jednak gdy zespoły zaczynają przechodzić od fazy eksperymentowania do rzeczywistego wdrożenia w dużych skalach, inne ważne czynniki, które są znacznie niedoceniane przez większość CEO, szybko okazują się równie istotne dla sukcesu biznesu.

Możliwość zatrudnienia AI

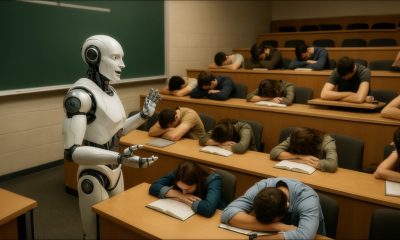

Surowy inteligencja i zdolność analityczna są oczywiście ważne, ale najbardziej niedoceniana zmienna w wdrożeniu AI w przedsiębiorstwie jest osobowość. Osobowość, w kontekście dużych modeli językowych, odnosi się do spójnego głosu, tonu i zachowania, które model przekazuje w interakcjach. To, co sprawia, że AI wydaje się spójne i godne zaufania.

Podczas wdrażania AI, firmy powinny podejść do tego w taki sam sposób, jak przy zatrudnianiu pracownika: ocenić nie tylko to, jak dobrze model może wykonać zadanie, ale także jego nastawienie do pracy, jak komunikuje się i jak wpisuje się w większy przepływ pracy.

Zdolność modelu do utrzymania spójności, odpowiedniego reagowania i radzenia sobie z niuansami w różnych kontekstach może mieć znaczący wpływ na wyniki biznesowe. Technicznie błyskotliwy AI, który odpowiada powoli, zmienia ton lub źle radzi sobie z nuansami interakcji, może być niewłaściwie stosowany przez firmy, frustrując użytkowników, zmniejszając zaangażowanie i ostatecznie redukując skuteczność AI i sukces biznesu.

Jest to szczególnie ważne w branżach takich jak wsparcie klienta, działania polityczne lub komunikacja wewnętrzna, ponieważ subtelne zmiany tonu lub sformułowania między odpowiedziami mogą powodować zamieszanie, niszczyć zaufanie i zmniejszać ogólne zaangażowanie. Jak w przypadku ludzi, nie ma jednego idealnego modelu, który przewyższa konkurencję w każdej kategorii. Niektóre modele są lepsze w wykonywaniu zadań analitycznych, takich jak kodowanie lub matematyka, podczas gdy inne radzą sobie znacznie lepiej w pisaniu konwersacyjnym i podsumowaniach spotkań.

Jednak wyzwaniem dla zespołów budujących na podstawie tych systemów jest to, że te cechy nie są stałe.

Ruszający cel

Krajobraz AI ewoluuje szybciej, niż większość organizacji może za tym nadążyć. Nowe wersje są wydawane często, a charakterystyki wydajności mogą ulegać zmianie z jednej aktualizacji na następną. Seria modeli Gemini od Google to niedawny przykład.

Gemini 2.0 Pro zostało wydane w lutym 2025 r. i zostało natychmiast okrzyknięte jako flagowy model dla deweloperów i przedsiębiorstw korzystających z niego do kodowania i złożonych poleceń na całym świecie.

Przyniosło to wówczas największe okno kontekstowe, jakie kiedykolwiek zaoferował Google, liczące dwa miliony tokenów, co dało mu możliwość kompleksowej analizy i zrozumienia ogromnych ilości informacji jednocześnie, a także jednoczesnego korzystania z narzędzi takich jak Google Search i nawet pisanie kodu.

Dla zespołów budujących systemy, które muszą przetwarzać duże ilości danych szybko i dokładnie, wydawało się to klarą wyborem. Ale już w ciągu kilku tygodni Google wydało Gemini 2.5 Pro, które natychmiast przewyższyło poprzednika dzięki ulepszeniom w kodowaniu, matematyce i nauce.

W ciągu nocy model, który był dopiero co najlepszym wyborem na rynku, został już wyprzedzony mniej niż dwa miesiące po premierze. Ale wczesni adopterzy natychmiast zauważyli, że zmiany nie były tylko stopniowe lub analityczne — cała osobowość Gemini została zmieniona w ciągu nocy. Wielu deweloperów posunęło się nawet do stwierdzenia, że AI zachowywało się, jakby zostało „lobotomizowane” po aktualizacji.

Skarżyli się, że AI wydawało się, dosłownie, „stawać głupsze” — stale produkując wolniejsze odpowiedzi, mniej spójne dane wyjściowe i wykazując niekonsekwencje w Radzeniu sobie z poleceniami, z którymi wcześniej nie miało problemów, a zadania, które kiedyś wydawały się płynne, nagle stały się sztywne.

I to jest miejsce, w którym strategia firmy wokół wdrożenia AI zaczyna się fundamentalnie zmieniać.

Poza benchmarkami

Na papierze Gemini 2.5 Pro powinno było być wyraźnym zwycięzcą dzięki ogromnym ulepszeniom możliwości i bezpieczeństwa.

Ale w praktyce te zmiany całkowicie zmieniły, jak niezawodny był model, jak się zachowywał, odpowiadał na polecenia i, w konsekwencji, posłały zespoły, które dopiero co wydały fortunę i spędziły niezliczone godziny na budowaniu systemów wokół tych systemów, z powrotem do punktu wyjścia, jeśli nowe możliwości modelu nie były zgodne z ich istniejącą infrastrukturą.

Nawet niewielkie zmiany w zachowaniu mogą zakłócić systemy zbudowane wokół spójności i przewidywalności. To stwarza realne ryzyko operacyjne, jeśli firma jest ściśle związana z jednym modelem, ponieważ każda aktualizacja może wprowadzić natychmiastową niestabilność do zespołów, które polegają na tych systemach.

Aby przeciwdziałać temu, wiele firm myślących o przyszłości zaczęło wdrażać strategię wielomodelową, w której kierują różne zadania do modeli najlepiej dopasowanych do nich, zamiast polegać na jednym modelu do obsługi wszystkiego.

Ten podejście nie tylko poprawia wyniki dostosowane do każdego zadania, ale także redukuje ryzyko związane z wdrożeniem AI, ponieważ jeśli jeden model uległby pogorszeniu po aktualizacji, nie spowodowałby, że cały system, który na nim polega, również uległby awarii, ponieważ są dostępne kopie zapasowe.

Po prostu, osobowość AI i niezawodność są równie ważne jak surowy inteligencja, gdy chodzi o stosowanie modelu w środowisku roboczym do wykonania różnych zadań. Ta zmiana myślenia reprezentuje fundamentalną zmianę w tym, jak firmy nie tylko kupują „inteligentniejsze narzędzie”, ale również budują i zarządzają całym cyfrowym systemem infrastruktury.

Aby firmy nie tylko przetrwały, ale także prosperowały w dzisiejszym krajobrazie biznesowym, zespoły muszą ustanowić potoki, które mogą wymieniać różne modele w zależności od zadania i stale monitorować, jak aktualizacje wpływają na wyniki i jakość interakcji.

Ostatecznie modele same będą nadal ewoluować w tempie, który jest trudny do nadążenia. Ale firmy, które planują zmiany, budują redundancję i traktują AI jako zarówno narzędzie, jak i współpracownika, będą tymi, które zamienią te szybkie zmiany w przewagę konkurencyjną.