Andersons vinkel

Virtuell prøving av nye klær gjennom AI

En AI-modell kan nå omdanne et enkelt bilde og klesbilder til en flytende video av en person som bærer nye antrekk, og unngår feilene som er vanlige i eldre, to-trinns systemer.

Den ‘virtuelle prøving’ (VTON) kategorien i datavisjonsforskning er blant de best finansiert og mest produktive forsøk i litteraturen – hovedsakelig fordi, som kan utledes fra de hyppige industrie/akademiske samarbeidene som publiseres hver år, dette målet mottar betydelig finansiering fra den velhavende moteindustrien:

Fra papiret ‘Image-Based Virtual Try-On: A Survey’, eksempler på personrepresentasjonstyper, og noen av filter- og finpussstadiene som selv grunnleggende bilder må gå gjennom for en virtuell prøving (VTON). Kilde

Det finnes mange variasjoner av målet, som å trekke ut klær fra bilder av mennesker, og å tilpasse den fulle figuren når det er nødvendig. Noen bildebaserte systemer er kommersielt implementert, på plattformer som veesual.ai, wanna.fashion og fashn.ai.

For video, Google Labs’ eksperimentelle Doppl-app eksperimenterte med denne funksjonaliteten, lansert forrige sommer:

Vennligst klikk for å spille hvis videoen ikke autoplayes. Utdrag fra det forkastede Google Doppl video prøving prosjektet. Kilde

Men Doppl stengte i april 2026 etter en lunkent mottakelse, med seere som nå henvises til selskapets bildebaserte prøvingstjeneste†:

Googles bildebaserte prøvingstjeneste, hvor brukere henvises fra selskapets forkastede Doppl-plattform. Kilde

Selv om det finnes noen plattformer som tilbyr virtuell prøving med video, ser det ikke ut til at noen av dem er tilknyttet et faktisk utgangspunkt; og de er alle ‘bleeding edge’, marginale (og ofte ‘tvilsomme’) token-baserte produkter.

Mens det finnes en rekke interessante forsøk fra forskningssektoren, er de tradisjonelt komplekse arkitekturer som er vanskelige å implementere for lav latens og høy kvalitet:

Vennligst klikk for å spille hvis videoen ikke autoplayes. Fra 2024 Fashion-VDM-prosjektet, et eksempel på ‘headless’ klesoverføring. Kilde

Sannheten er at oppgaven med å tilpasse klær til en virkelig person, uten å forvrengte enten klærne eller personen, samtidig som man opprettholder en slags nyttig demonstrativ bevegelse (som nøyaktig viser produktets bakside når personen vender ryggen til), er en formidabel utfordring for den nåværende tilstanden av kunsten.

Vanast

Det er en utfordring som et nytt papir fra Korea prøver å møte, ved å bruke en ny og fullstendig integrert løsning for å parsere klær + person + bevegelse:

Vennligst klikk for å spille hvis videoen ikke autoplayes. Eksempler fra det suppleringssiden for Vanast-prosjektet. Kilde

Det nye systemet, tittelen Vanast, utnytter en skreddersydd datasett som inkorporerer og orkestrerer alle tre faktorene nødvendige for å oppnå oppgaven: klærne; personen; og bevegelsen:

Klikk for å spille. Flere eksempler fra Vanast-prosjektets side.

Systemet utnytter rammer som Flux, Qwen og ChatGPT, for å generere en ‘triplet’-datasett som kan informere en slutt-til-slutt-arkitektur:

Fra det nye papiret, eksempler på datasettdataene som brukes for generering og trening. Kilde –

Det nye papiret er tittelen Vanast: Virtuell prøving med menneskebildefanimasjon via syntetisk triplet-overvåking, og kommer fra fire forskere ved Seoul National University. Det finnes også en video-rik prosjektside.

Metode

Forfatternes uttalte mål i arbeidet er å samle de tre ovennevnte aspektene i en enkelttrinnsramme – ikke bare fordi prosessen ville være diskret, men også fordi det gir de ulike aspektene mer mulighet til å sammenflette og samhandle under trening, med et mål om en mer samlet generering:

Vanast kombinerer et enkelt menneskebilde, separate klesbilder og en bevegelsesreferanse for å generere en flytende sekvens hvor samme person bærer det nye antrekket, med poseveiledning som sikrer konsistent bevegelse mens identitet og klesdetaljer bevares over rammer.

For å oppnå dette, tar systemet bilder av målklærne; et bilde av personen som bærer forskjellige klær; en bevegelsesreferansevideo som definerer hvordan personen skal bevege seg; og en tekstprompt som beskriver handlingen og settingen; og produserer en fullstendig videosekvens hvor samme person ser ut til å bære det nye antrekket, mens den følger den påtvungne bevegelsen, med hver rame holdt visuelt konsistent over tid.

I stedet for å skille påkledning og animasjon i separate stadier – som har vært tilnærmingen i de fleste lignende tidligere arbeider – håndterer Vanast klær, identitet og bevegelse sammen i en enkelt prosess, og lar disse elementene samhandle under generering, og reduserer de slags mismatch og ustabilitet som er å se i tidligere metoder.

Datasett

Trening for prosjektet er basert på parvis eksempler på et menneskebilde, de tilsvarende klesartiklene og en video av at personen beveger seg mens de bærer disse klærne, med bevegelse ekstrahert ved hjelp av en tidligere arkitektur, for å gi stabil poseveiledning over rammer.

I fravær av en offentlig tilgjengelig datasett som oppfyller prosjektets krav, ble data skrapt fra (uspesifiserte) nettbutikker, og ga en cache av videoer med mangfoldige klær. Men oppgaven krevde videoer av samme person bærende flere antrekk, som er en sjeldenhet i vill data, og som nødvendiggjorde skapelsen av syntetisk data.

De tre-stegsprosessen involverte å velge egnet kandidatrammer fra de skrapede videoene, håndtert via Qwen2.5-VL Vision-Language Model (VLM), med passende beskjæring og evaluering av egnethet (dvs. ingen okklusjoner, subjekt i riktig posisjon, osv.); og å lage egnet inpainting-masker for å isolere de berørte områdene – som (i linje med tidligere arbeid PERSE) håndteres av den nå-venerable SDXL-diffusjonsmodellen.

Oversikt over Vanast-pipeline, hvor et menneskebilde, målklærbilder og en bevegelsesveiledningsvideo blir kodet og prosessert i en samlet videodiffusjonsmodell. Systemet genererer en animasjon som bevare identitet, følger posesekvensen og påfører målklærne, mens syntetisk triplet-generering støtter trening, og en dobbeltmodul-design skiller animasjon fra klesoverføring for å opprettholde konsistens.

I det tredje stadiet, tar Qwen igjen oppgaven til å klassifisere bilder etter kjønn, og den populære Flux-bilde-diffusjonsrammen brukes så til å lage endringer i klesartiklene i et bilde (siden Flux er i stand til å samle flere inndata-elementer). Inpainting-tekstpromptene ble kuratert av ChatGPT (versjon uspesifisert).

For å ytterligere øke pose- og bakgrunnsdiversitet, ble en pipeline introdusert for å konstruere trenings-tripletter fra vill-videoer, ved hjelp av HumanVid-datasettet. Samme prosess ble brukt til å generere identitetsbevarende menneskebilde.

Ettersom det ikke fantes noen selvstendig klesbilde i disse videoene, ble klesbilder syntetisert direkte fra filmene. Rammer ble samplet fra hver video, og Qwen brukt til å score dem for frontal synlighet, før den mest egnete kandidaten ble valgt, basert på fullkropps-synlighet, bildeklarhet, minimal okklusjon, lyskvalitet og overordnet komposisjon.

En øvre-klesregion ble så ekstrahert ved hjelp av SegFormer, og bakgrunnen fjernet for å isolere klesartiklene.

For å unngå posisjonsforvrengning, ble klesregionen tilfeldig forskyvet innenfor sin avgrensning, og Qwen brukt igjen til å filtrere ut upålitelige segmenteringer. Denne prosessen produserte syntetiske klesbilder parret med bevegelse og identitet, og tillot stor skala-triplet-konstruksjon fra ustrukturert videodata, mens den forbedret robustheten over varierte virkelige forhold.

Arkitektur

En dobbeltmodul-arkitektur ble introdusert for å håndtere den langsomme konvergens og svak kontrollbalanse sett i tidligere metoder som hadde forsøkt å fusjonere alle betingelser. Tilnærmingen utnyttet tekst-til-video-diffusjons-transformator fra Wan, og dro også på VACE-prosjektet (se under).

Modellen ble delt inn i en Menneske-animasjonsmodul (HAM), som håndterte bevegelse og identitet fra menneske- og pose-inndata; og en Kles-overføringsmodul (GTM), som håndterte klær fra klesbilder. Begge delte tilgang til ryggraden, mens de integrerte funksjoner på en distribuert, kaskadisk måte, for å forbedre betingelsen.

Trening ble utført ved å fryse ryggraden og å optimere kun HAM- og GTM-parametrene, med deres bidrag balansert under funksjonsintegrasjon. Inndata fra den syntetiske triplet-datasett ble konvertert til latente representasjoner ved hjelp av WANs variational autoencoder (VAE).

Bevegelses-orientert kontekst ble konstruert ved å kombinere menneske- og pose-informasjon over tid, mens klesfunksjoner ble prosessert separat, og justert gjennom prosjeksjon til token-embeddings.

Modellen ble også utvidet til å støtte kles-interpolasjon. Her ble representasjoner fra to klesartikler kombinert for å generere glatte overganger, og tillot konsistente og koherente blandinger mellom klesartikler, uten ekstra optimering.

Data og tester

Modellen ble trent på 9 135 videoer, med varierende lengder fra tre til ti sekunder, hentet fra ovennevnte ‘nettbutikker’; forfatternes eget genererte datasett; og HumanVid-datasettet.

Fra disse ble to evaluering-datasett etablert: ‘Internett-datasettet’, som inneholder videoer og produktbilder fra nettbutikker; og den offisielle test-deling av Alibabas ViViD-datasett.

Ettersom ViViD-data mangler ansikter (se ovenfor video, for et eksempel på dette, som er svært vanlig i den virtuelle prøvingslitteraturen), ble disse lagt til via Flux-outpainting.

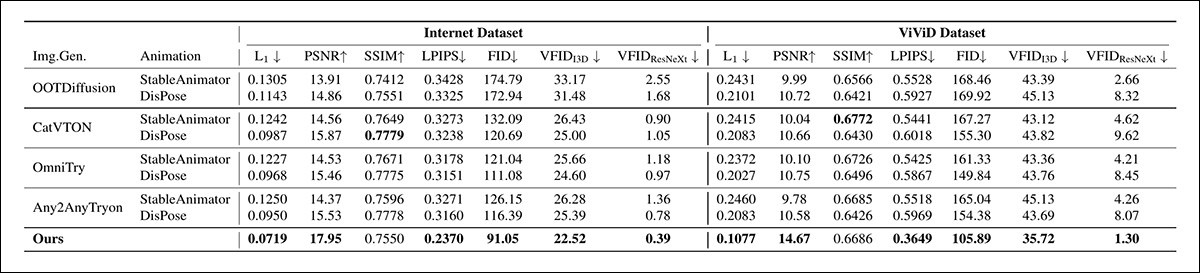

Metrikker brukt var L1-tap; Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Lært Perceptual Image Patch Similarity (LPIPS); Fréchet Inception Distance (FID); og Fréchet Video Distance†† (FVD)

Systemer testet for kles-overføring var OOTDiffusion; CatVTON; OmniTry; og Any2AnyTryon. Emne-til-bilde-genereringsmodeller prøvd var VisualCloze; MOSAIC; og ByteDances UNO.

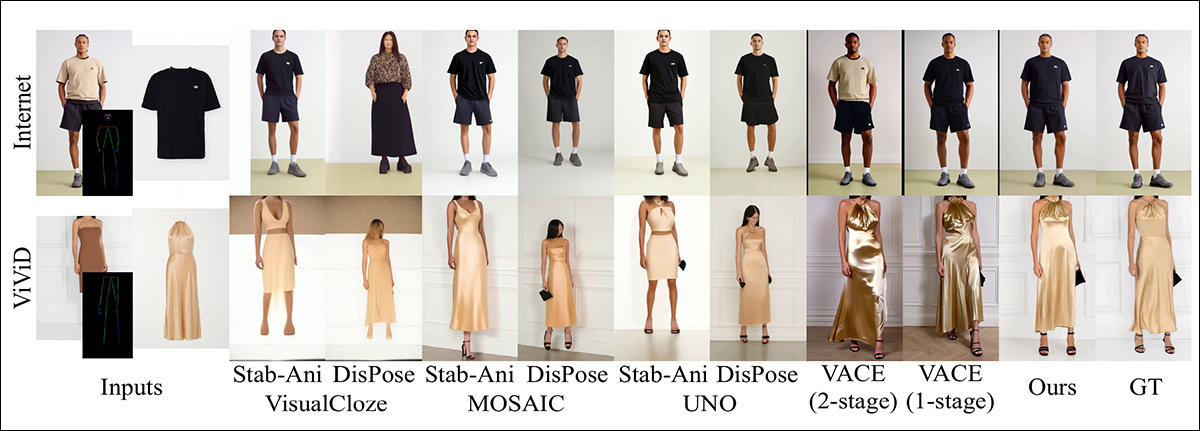

For den andre kategorien tester, hvor kombinasjoner av bilde-virtuell prøving og animasjonsmodeller ble testet, var det nye arbeidet i stand til å oppnå den høyeste scoren:

Kvantitativ sammenligning mot kombinasjoner av subjekt-til-bilde og animasjonsmodeller på Internett- og ViViD-datasettene, hvor det foreslåtte metoden oppnådde den beste ytelsen over alle rapporterte metrikker. Fete verdier indikerer den øverste scoren i hver kolonne.

Forfatterne sier:

‘[Vår] modell oppnår den beste ytelsen over alle metrikker når sammenlignet med kombinasjoner av subjekt-til-bilde-genereringsmodeller og animasjonsmodeller.

‘Kvalitative resultater [vist nedenfor] bekrefter videre at vår tilnærming produserer den mest nøyaktige pose-følging og kles-overføring, mens den bevare identitet mer trofast enn alle subjekt-til-bilde-baserte referanser.’

Kvalitativ sammenligning på Internett- og ViViD-datasettene mot subjekt-til-bilde og animasjonsbaselinjer, hvor det foreslåtte metoden, ifølge forfatterne, tilbyr mer nøyaktig pose-justering og kles-overføring, mens den bevare identitet mer konsistent enn VisualCloze, MOSAIC, UNO og VACE.

For den andre kategorien tester, hvor kombinasjoner av bilde-virtuell prøving og animasjonsmodeller ble testet, var det nye arbeidet i stand til å oppnå den høyeste scoren:

Kvantitativ sammenligning med kombinasjoner av bildebasert virtuell prøving og animasjonsmodeller på Internett- og ViViD-datasettene. Det foreslåtte metoden oppnådde den beste samlede ytelsen over metrikker, med SSIM som forble sammenlignbar med den sterkeste referansen. Fete verdier betegner den høyeste scoren.

Forfatterne legger til:

‘Kvalitative sammenligninger [vist nedenfor] demonstrerer at våre resultater ligner mest på grunnssannheten blant alle bilde-virtuell prøvings-baserte referanser.’

Kvalitative tester med referanser skapt ved å kombinere VTON-modeller med animasjonsmodeller.

Konklusjon

Selv om Vanast-prosjektet oppnår en diskret slutt-til-slutt-løsning, indikerer papirets manglende detalj om trening og inferens-resurskrav at dette kanskje ikke er den mest agile eller smidige løsningen. I virkeligheten er utfordringen i seg selv ekstremt vanskelig å oppnå, selv i et ikke-optimert system – og hvor mye mer i en kommersiell utbredelse som ville trenge lav latens og lav kostnad/avkastning i skala..?

Virtuell prøving er ett av flere ‘månelanding’-AI-mål hvor den nåværende tilstanden av kunsten, som diffusert gjennom ulike overskrifter og cherry-picked resultater, skjuler den faktiske vanskeligheten av oppgaven, som kanskje til slutt vil bli løst av senere og lettere teknologier enn Transformatorer.

† Tilgjengelig i USA, geo-blokkert i mange andre regioner, hvis ikke alle.

†† Forfatterne henviser til ‘VFID’, men lenker kun til ViViD-papiret, som ikke berettiger henvisningen, så langt jeg kan se, med begrenset tid til å spore det opp. Jeg har antatt at de faktisk mente Fréchet Video Distance (FVD), og var likevel kort på tid. Vennligst kontakt meg for å endre, hvis nødvendig.

Først publisert onsdag, 8. april 2026