Andersons vinkel

Å bringe visuelle analogier til AI

De nåværende AI-modellene klarer ikke å gjenkjenne ‘relasjonelle’ bildelikheter, som for eksempel hvordan jordens lag er lignende en fersken, og mangler derfor en viktig del av hvordan mennesker oppfatter bilder.

Selv om det finnes mange computer vision-modeller som kan sammenligne bilder og finne likheter mellom dem, har den nåværende generasjonen av sammenligningssystemer liten eller ingen fantasifull kapasitet. Tenk på noen av tekstene i den klassiske 1960-talls-sangen, Windmills of Your Mind:

Like en karusell som snurrer, løper ringer rundt månen

Like et ur hvis hender sveiper forbi minuttene på dens ansikt

Og verden er som et eple som snurrer stille i rommet

Slike sammenligninger representerer et domene av poetisk allusjon som er meningsfull for mennesker på en måte langt utenfor kunstnerisk uttrykk; snarere er det knyttet til hvordan vi utvikler våre perseptuelle systemer; når vi skaper vårt ‘objekt’-domene, utvikler vi en evne for visuell likhet, så at – for eksempel – tverrsnitt som viser en fersken og jorden, eller fraktale rekurrenser som kaffespiraler og galaksegrener, registrerer som analoge med oss.

På denne måten kan vi dedusere forbindelser mellom åpenbart uforbindede objekter og typer av objekter, og inferere systemer (slik som gravitasjon, bevegelsesmengde og overflatekohesjon) som kan brukes i en rekke domener på ulike skalaer.

Å se ting

Selv den siste generasjonen av bilde-sammenligningssystemer for AI, som Learned Perceptual Image Patch Similarity (LPIPS) og DINO, som er informert av menneskelig tilbakemelding, utfører bare bokstavelig overflate-sammenligninger.

Deres evne til å finne ansikter der ingen eksisterer – dvs. pareidolia – representerer ikke den type visuell likhetsmekanismer som mennesker utvikler, men skjer fordi ansiktsøkende algoritmer bruker lavnivå ansiktsstruktur funksjoner som noen ganger samstemmer med tilfeldige objekter:

Eksempler på feilpositive for ansiktsgjenkjenning i ‘Faces with Things’-datasettet. Kilde

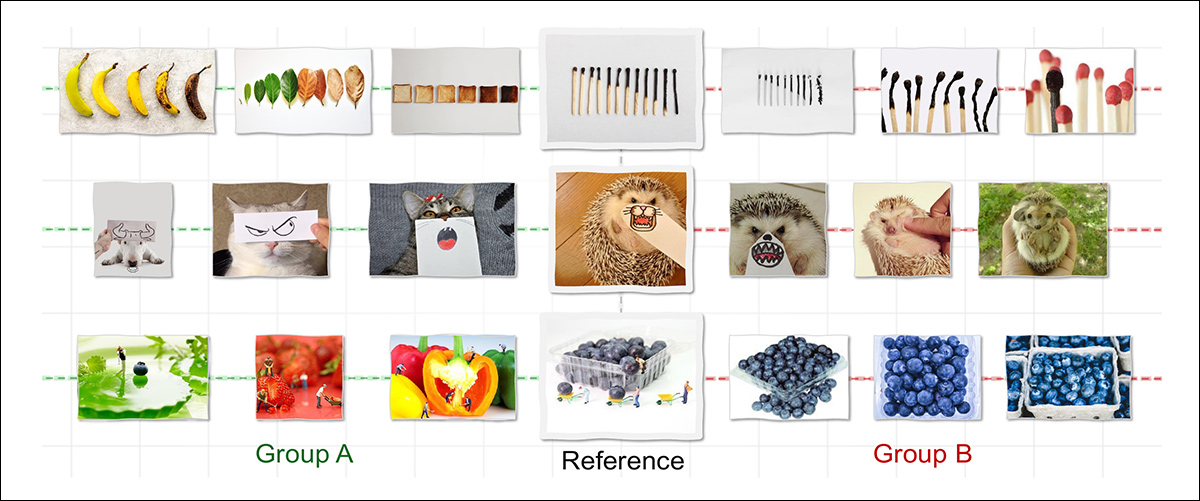

For å bestemme om maskiner virkelig kan utvikle vår fantasifull kapasitet til å gjenkjenne visuell likhet over domener, har forskere i USA utført en studie omkring Relasjonell Visuell Likhhet, og har kuratert og trent et nytt datasett designet for å tvinge abstrakte relasjoner til å danne seg mellom ulike objekter som likevel er bundet sammen av en abstrakt relasjon:

De fleste AI-modellene gjenkjenner bare likhet når bilder deler overflate-trekk som form eller farge, som er hvorfor de bare kobler gruppe B (ovenfor) til referansen. Mennesker, på den andre siden, ser også gruppe A som lik – ikke fordi bildene ligner hverandre, men fordi de følger samme underliggende logikk, som for eksempel å vise en transformasjon over tid. Det nye arbeidet forsøker å reprodusere denne type strukturell eller relasjonell likhet, med mål om å bringe maskinpersepsjon nærmere menneskelig resonnering. Kilde: https://arxiv.org/pdf/2512.07833

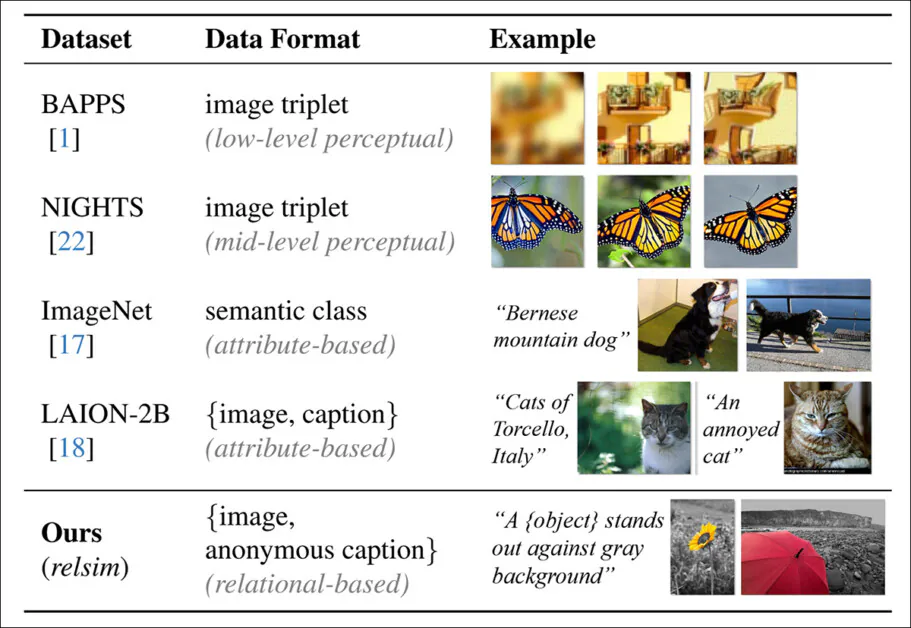

Kapionsystemet som er utviklet for datasettet muliggjør usedvanlig abstrakte annotasjoner, designet for å tvinge AI-systemer til å fokusere på basis-karakteristika fremfor spesifikke lokale detaljer:

De predikerte ‘anonyme’ kapionser som bidrar til forfatternes ‘relsim’-metrisk.

Den kuraterte samlingen og den usedvanlige kapionsstilen driver forfatternes nye foreslåtte metrisk relsim, som forfatterne har finjustert inn i en visuell-språklig modell (VLM).

En sammenligning mellom kapionsstilen i typiske datasett, som fokuserer på attributt-likhet, mens relsim-tilnærmingen (nederste rad) betoner relasjonell likhet.

Den nye tilnærmingen bygger på metoder fra kognitiv vitenskap, spesielt Dedre Gentners Struktur-Kartleggingsteori (en studie av analogi) og Amos Tverskys definisjon av relasjonell likhet og attributt-likhet.

Fra det tilknyttede prosjektets nettsted, et eksempel på relasjonell likhet. Kilde

Forfatterne uttaler:

‘[Mennesker] prosesserer attributt-likhet perseptuelt, men relasjonell likhet krever konseptuell abstraksjon, ofte støttet av språk eller forhåndsviten. Dette antyder at gjenkjenning av relasjonell likhet først krever å forstå bildet, å trekke på kunnskap, og å abstrahere dets underliggende struktur.’

Den nye artikkelen heter Relasjonell Visuell Likhhet, og kommer med et prosjektnettsted (se video innbedded i slutten av denne artikkelen).

Metode

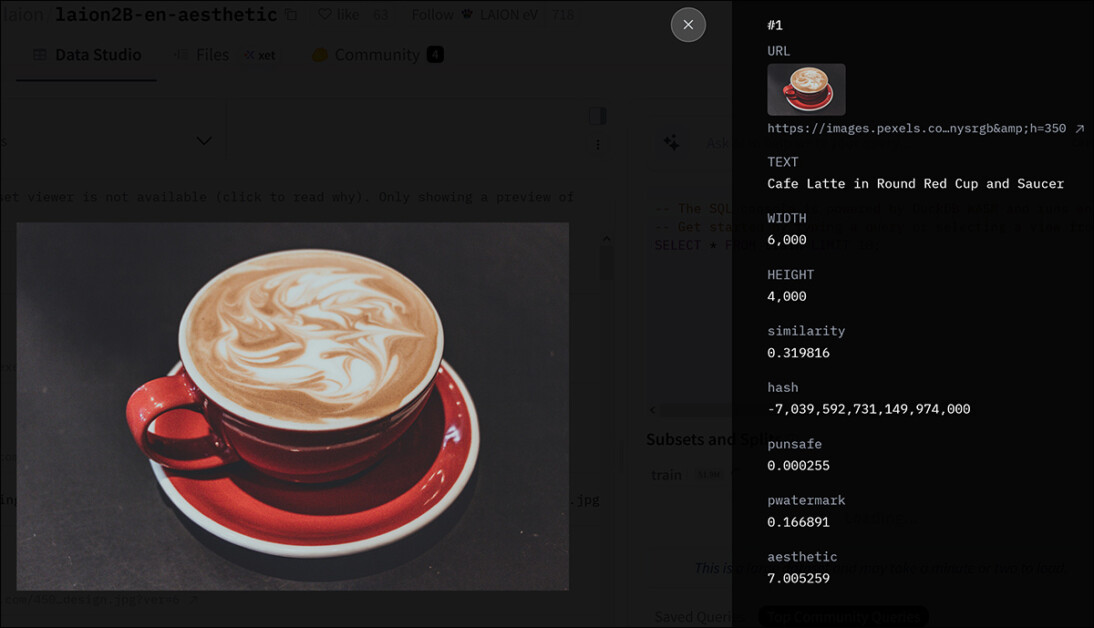

Forskerne brukte ett av de best kjente hyperskale-datasettene som utgangspunkt for sin egen samling – LAION-2B:

Metadata for en innføring i LAION-2B-samlingen. Kilde

114 000 bilder som sannsynligvis inneholder elastiske relasjonelle strukturer, ble trukket ut fra LAION-2B, inkludert filtrering av de mange lavkvalitets-bildene som er til stede i det minimalt kuraterte datasettet.

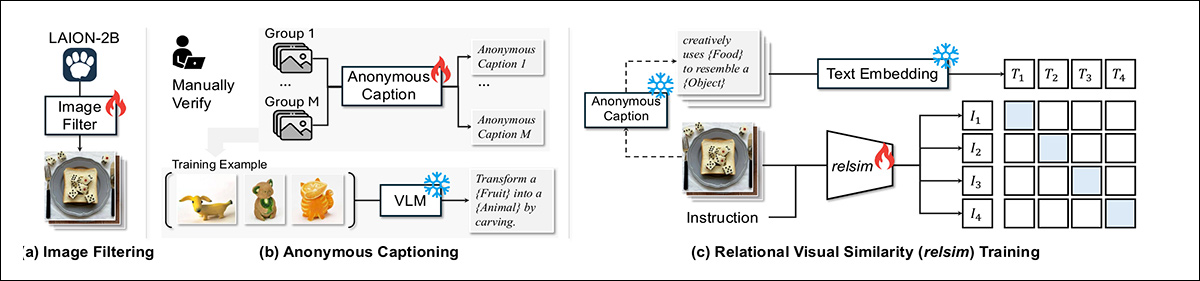

For å lage en pipeline for denne valgprosessen, brukte forfatterne Qwen2.5-VL-7B, og utnyttet 1 300 positive og 11 000 negative menneske-labelede eksempler:

RelSim-systemet er trent i tre stadier: filtrering av bilder fra LAION-2B for relasjonelt innhold; tildeling av hver gruppe en felles anonym kapion som fanger dets underliggende logikk; og læring av å matche bilder til disse kapionsene ved hjelp av en kontrastiv tap.

Artikkelen uttaler:

‘Annotatorer ble instruert: “Kan du se noen relasjonell mønster, logikk eller struktur i dette bildet som kunne være nyttig for å lage eller koble til et annet bilde?”. Den finjusterte modellen oppnår 93% enighet med menneskelige vurderinger, og når den blir brukt på LAION-2B, resulterer det i N = 114k bilder identifisert som relasjonelt interessante.’

For å generere relasjonelle merker, ble Qwen-modellen bedt om å beskrive den felles logikken bak sett av bilder uten å navngi spesifikke objekter. Denne abstraksjonen var vanskelig å oppnå når modellen så bare ett bilde, men ble mulig når flere eksempler demonstrerte det underliggende mønsteret.

De resulterende gruppe-nivå-kapionsene erstattet spesifikke termer med stedfortredere som ‘{Subject}’ eller ‘{Type of Motion}’, og gjorde dem bredt anvendelige.

Etter menneskelig verifisering, ble hver kapion parret med alle bilder i sin gruppe. Mer enn 500 slike grupper ble brukt til å trene modellen, som deretter ble brukt på de 114 000 filtrerte bildene for å produsere en stor samling av abstrakte, relasjonelt annoterte prøver.

Data og tester

Etter ekstraksjon av relasjonelle funksjoner med Qwen2.5-VL-7B, ble en modell finjustert på dataene ved hjelp av LoRA, for 15 000 steg, via åtte A100-GPUer*. For tekst-siden, ble relasjonelle kapionser innbettet ved hjelp av all-MiniLM-L6-v2 fra Sentence-Transformers-biblioteket.

Datasettet på 114 000 kapionserte bilder ble delt inn i 100 000 for trening og 14 000 for evaluering. For å teste systemet, ble en innhenting-oppsett brukt: gitt et spørsmål-bilde, måtte modellen finne et annet bilde fra en 28 000-objekt-pool som uttrykte samme relasjonelle idé. Innhentings-poolen inkluderte 14 000 evaluering-bilder og 14 000 ekstra prøver fra LAION-2B, med 1 000 spørsmål tilfeldig valgt fra evaluering-sammenlingen for benchmarking.

For å evaluere innhentings-kvalitet, ble GPT-4o brukt til å score den relasjonelle likheten mellom hver spørsmål og hentet bilde på en skala fra 0 til 10. En separat menneskelig studie ble også gjennomført for å måle brukerpreferanse (se nedenfor).

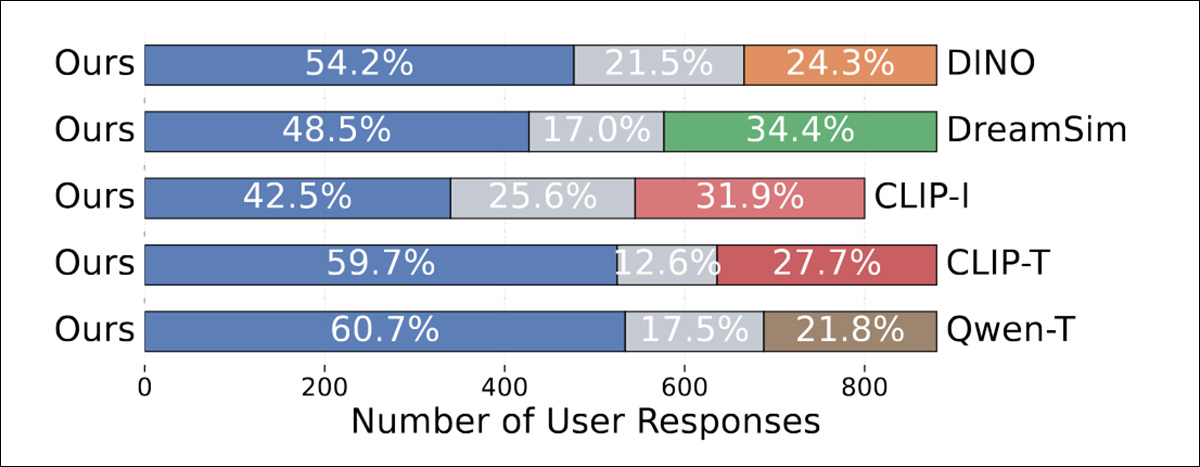

Hver deltager ble vist et anonymt spørsmål-bilde med to kandidater, en hentet av den foreslåtte metoden og den andre av en baseline. Deltagerne ble bedt om å velge hvilket bilde som var mer relasjonelt likt spørsmålet, eller hvis begge var like nære.

RelSim-tilnærmingen ble sammenlignet med flere etablerte bilde-til-bilde-ligningsmetoder, inkludert den ovennevnte LPIPS og DINO, samt dreamsim og CLIP-I. I tillegg til baselines som direkte beregner ligningspoeng mellom bilde-par, som LPIPS, DINO, dreamsim og CLIP-I, ble også kapions-baserte metoder testet, hvor Qwen ble brukt til å generere en anonym eller abstrakt kapion for hvert bilde.; dette tjente deretter som innhentings-spørsmål.

To innhentings-variantene ble evaluert, med CLIP-basert tekst-til-bilde-innhenting (CLIP-T) brukt til tekst-til-bilde-innhenting, og Qwen-T som brukte tekst-til-tekst-innhenting. Begge kapions-baserte baselines brukte den opprinnelige forhånds-trente Qwen-modellen, i stedet for den versjonen som var finjustert på relasjonell logikk. Dette tillot forfatterne å isolere effekten av gruppe-basert trening, ettersom den finjusterte modellen hadde vært eksponert for bilde-sammenlinger, i stedet for isolerte eksempler.

Eksisterende metriske og relasjonelle likhet

Forfatterne testet først om eksisterende metriske kunne fange relasjonell likhet:

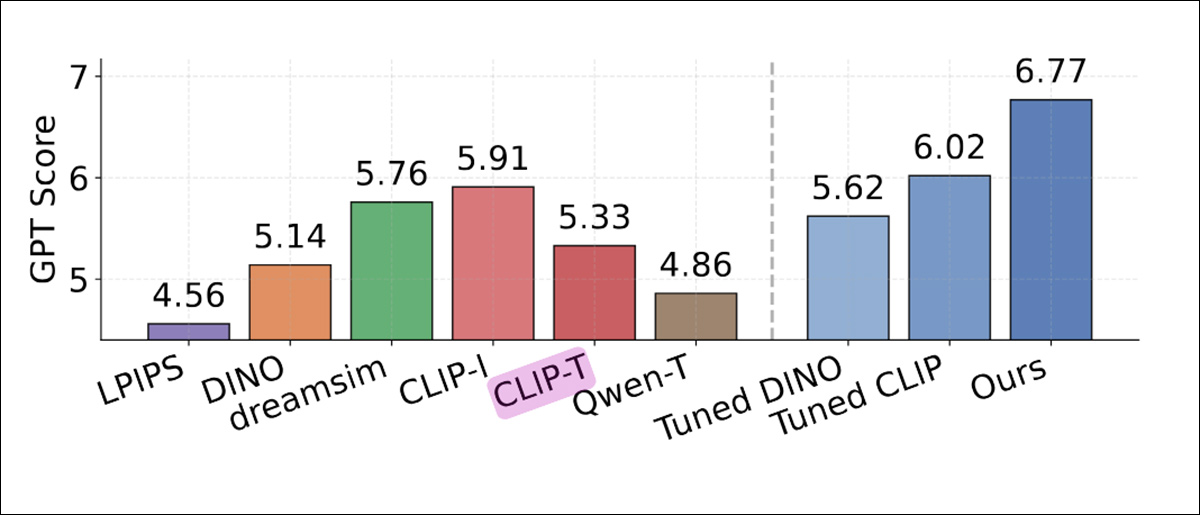

Sammenligning av innhentings-ytelse som dømt av GPT-4o, som viser gjennomsnittlig relasjonell likhetspoeng for hver metode. Konvensjonelle ligningsmetriske som LPIPS, DINO og CLIP-I scoret lavere. Kapions-baserte baselines Qwen-T og CLIP-T underpresterte også. Den høyeste scoren ble oppnådd av relsim (6,77, høyre mest blå kolonne), som indikerer at finjustering på gruppe-basert relasjonell mønster forbedret sammenligning med GPT-4o sine vurderinger.

Med hensyn til disse resultater, uttaler forfatterne**:

‘[LPIPS], som fokuserer ren på perseptuell likhet, oppnår den laveste scoren (4,56). [DINO] presterte bare litt bedre (5,14), sannsynligvis fordi den er trent utelukkende på en selv-tilsyns-måte på bilde-data. [CLIP-I] gir de sterkeste resultater blant baselines (5,91), sannsynligvis fordi noen abstraksjon noen ganger er til stede i bilde-kapionser.

‘Men CLIP-I underpresterer likevel i forhold til vår metode, da å oppnå en bedre score kan kreve evnen til å nå enda høyere abstraksjonsnivå, som for eksempel de i anonyme kapionser.’

I den menneskelige studien, foretrakk mennesker konsekvent relsim-metoden over alle baselines:

Relasjonell likhetspoeng tildelt av GPT-4o for hver metode. Standard ligningsmetriske som LPIPS, DINO og CLIP-I scoret lavere, og kapions-baserte varianter Qwen-T og CLIP-T presterte bare litt bedre. Selv justerte versjoner av DINO og CLIP lukket ikke gapet. Den høyeste scoren, 6,77, ble oppnådd av den foreslåtte modellen trent med gruppe-basert tilsyn.

Forfatterne noterer:

‘Dette er svært oppmuntrende, da det ikke bare viser at vår modell, relsim, kan suksessfullt innhente relasjonelt like bilder, men også, igjen, bekrefter at mennesker faktisk oppfatter relasjonell likhet–ikke bare attributt-likhet!’

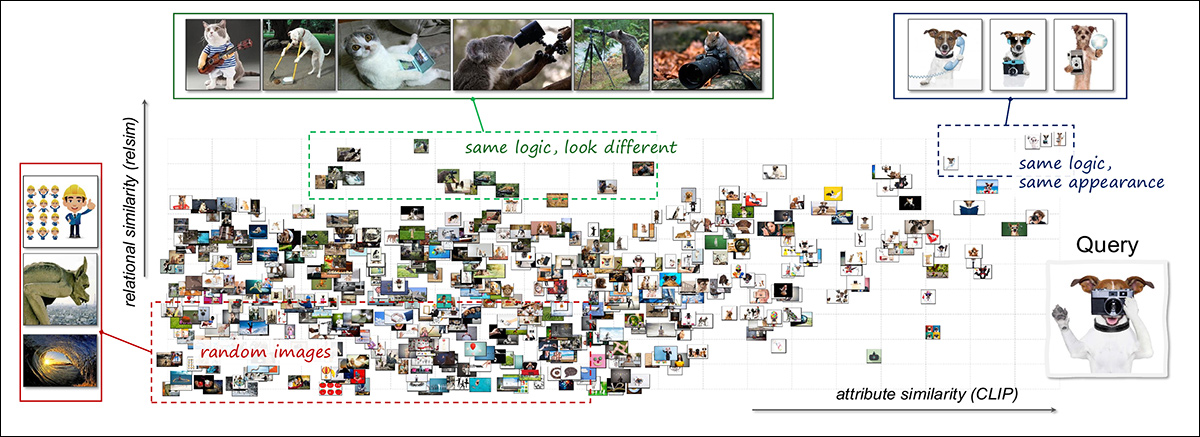

For å utforske hvordan relasjonell og attributt-likhet kan supplere hverandre, brukte forskerne en kombinasjons-metode for visualisering. Et enkelt spørsmål-bilde (‘En hund som holder et kamera’) ble sammenlignet mot 3 000 tilfeldige bilder, og ligningen ble beregnet ved hjelp av både relasjonell og attributt-basert modeller:

Fellessamlingen av visuell lignings-rom med relasjonell og attributt-akser. Et enkelt spørsmål-bilde, som viser en hund som bruker et kamera, ble sammenlignet mot 3 000 andre. Resultatene ble organisert etter relasjonell ligning (vertikal) og attributt-ligning (horisontal). Øvre høyre regionen inneholder bilder som ligner spørsmålet både i logikk og utseende, som for eksempel andre hunder som bruker verktøy. Øvre venstre regionen inneholder semantisk relaterte, men visuelt ulike eksempler, som for eksempel andre dyr som utfører kamera-relaterte handlinger. De fleste gjenværende eksempler klumper lavere i rommet, og reflekterer svakere ligning. Layouten viser hvordan relasjonell og attributt-modeller høydepunktsetter komplementære aspekter av visuell data. Vennligst se kilde-artikkelen for bedre oppløsning.

Resultatene avdekket kluster som motsvarer ulike typer ligning: noen bilder var både relasjonelt og visuelt like; andre delte relasjonell logikk, men ikke utseende; resten viste hverken.

Anvendelsesområder

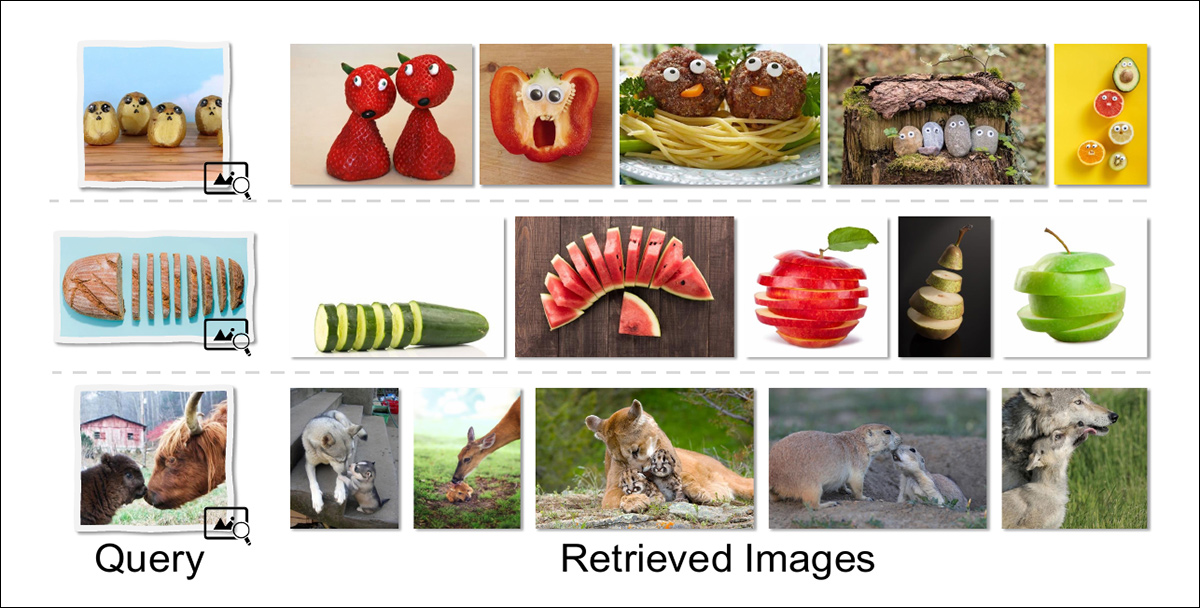

Artikkelen utforsker også noen mulige sluttbruksscenarier for relasjonell likhet, inkludert relasjonell bilde-innhenting, som tillater bilde-søk som er mer i samsvar med menneskers egen kreative måte å se på verden:

Relasjonell innhenting returnerer bilder som deler en dypere konseptuell struktur med spørsmålet, i stedet for å matche overflate-trekk. For eksempel, et matprodukt som er stilisert for å ligne et ansikt, returnerer andre antropomorfe måltider; et skåret objekt returnerer andre skårede former; og scener med voksen-avkom-interaksjon returnerer bilder med lignende relasjonelle roller, selv om arter og komposisjon forskjeller.

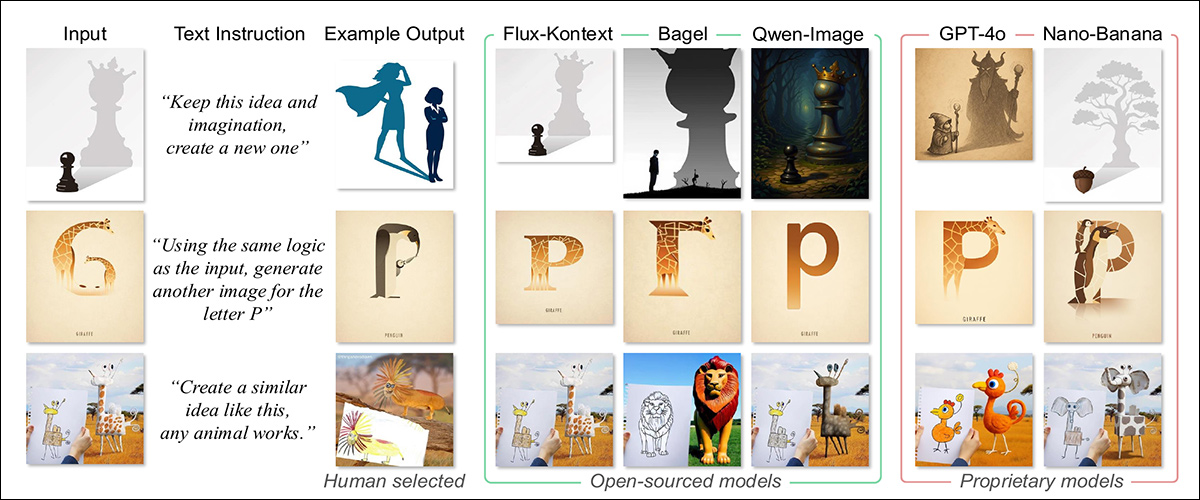

En annen mulighet er analogisk bilde-generering, som ville tillate syntese av spørsmål som bruker relasjonelle strukturer i stedet for direkte beskrivelser. I en sammenligning av resultater fra den nåværende generasjonen av state-of-the-art tekst-til-bilde-modeller, kan vi se at resultatene av en slik tilnærming sannsynligvis vil være mer diverse:

Gitt et inndata-bilde og et relasjonelt spørsmål, ble modellene bedt om å generere et nytt bilde som uttrykker samme underliggende konsept. Proprietære modeller produserte mer trofaste analogier, som bevarte strukturell logikk over store endringer i form, og åpne kilde-modeller tenderte til å regrediere til bokstavelige eller stilistiske matcher, og mislyktes i å overføre den dypere ideen. Utdata ble sammenlignet med menneske-kuraterte analogier, som eksemplifiserte den ønskede transformasjonen.

Konklusjon

Generative AI-systemer ville, det ser ut til, være merkbart forbedret av en evne til å inkorporere abstrakt representasjon i deres konseptualiseringer. Som det står nå, å be om konsept-baserte bilder som “sinne” eller “lykke” tenderer til å returnere bilder stilisert fra de mest populære eller tallrike bildene som hadde disse assosiasjonene i datasettet; hvilket er memorisering i stedet for abstraksjon.

Dette prinsippet kunne sannsynligvis være enda mer nyttig hvis det kunne bli brukt på generativ skriving – spesielt analytisk, spekulativ eller fiktiv utgang.

Trykk for å spille. Kilde

* En A100 kan ha 40Gb eller 80GB med VRAM; dette er ikke spesifisert i artikkelen.

** Forfatternes sitater er redundante og ekskludert.

Først publisert tirsdag, 16. desember 2025