Andersons vinkel

AI-forurensning i søkeresultater risikerer ‘henting-skollaps’

Som AI-innhold forurenser nettet, åpner en ny angrepsvektor seg i slagmarken for kulturell konsensus.

Forskning ledet av et koreansk søkefirma argumenterer for at når AI-genererte sider trenger inn i søkeresultater, undergraver de stabiliteten til søke- og rangeringspipeliner og svekker systemer – som f.eks. Retrieval-Augmented Generation (RAG) – som avhenger av disse rangeringene for å bestemme hva slags informasjon som skal vises og betraktes som pålitelig, og øker dermed risikoen for at misvisende eller uriktige materiale blir behandlet som autoritativt.

Begrepet som er myntet for dette syndromet av forskerne er Henting-skollaps, som er forskjellig fra den kjente trusselen om modell-kollaps (der AI trent på sin egen utdata blir progressivt dårligere).

I en Hendelse-skollaps-scenario, dominerer AI-generert innhold søkemotorens resultater, i slik en grad at selv når svarene forblir overfladisk nøyaktige, vil den underliggende bevisgrunnlaget ha blitt skilt fra originale menneskelige kilder. Likevel, denne ‘rotløse’ data synes å være i stand til å oppnå en høy plassering i søkeresultater*:

‘Med spredningen av AI-generert tekst, utfordringer i tilskrivning og fortrening datakvalitet har intensivert. I motsetning til tradisjonell nøkkelord spam, moderne syntetisk innhold er semantisk sammenhengende, og lar det blande seg inn i rangeringssystemer og propagerer gjennom pipeliner som autoritativ bevis.’

Arbeidet hevder at dette ville skape en ‘strukturert skjør’ miljø hvor rangeringssignaler favoriserer AI-produserte, SEO-optimerte sider, og fortrenger menneskeskrevne kilder over tid på en skjult måte, dvs. uten å utløse åpenbare nedgang i svarkvalitet:

‘[Veksten] av AI-generert innhold på nettet presenterer en strukturell risiko for informasjonshenting, ettersom søkemotorer og Retrieval-Augmented Generation (RAG)-systemer økende konsumerer bevis produsert av store språkmodeller (LLM).

‘Vi karakteriserer denne økosystem-nivå-feilmodusen som Hendelse-skollaps, en to-trinns prosess hvor (1) AI-generert innhold dominerer søkeresultater, undergraver kildediversitet, og (2) lavkvalitets- eller adversativt innhold infiltrerer hentingspipelinen.’

Forskerne hevder at når ‘dominans’-fasen er etablert, blir hentingspipelinen mer utsatt for bevisst forurensning, ettersom adversative sider kan utnytte de samme optimaliseringsmekanismene for å oppnå synlighet*:

‘Ved å etablere rammen for Hendelse-skollaps, legger dette arbeidet grunnlaget for å forstå hvordan syntetisk innhold omformer informasjonshenting. For å mildne disse risikoen, foreslår vi en overgang mot Defensive Ranking-strategier som samtidig optimaliserer relevans, faktualitet og proveniens.’

Henting-skollaps kan argumenteres for å forverre modell-kollaps, ettersom det legger til et lag med ondsinnet intensjon på ‘fotokopieffekten’ av entropi, hvor AI økende mata AI-generert utdata. Foruten å påvirke den åpenbare konsensus om ‘sannhet’ i sanntidssøkeresultater, kan uriktigheter og angrep senere bli innført i trent LLM som autoritative kilder.

Det nye arbeidet har tittelen Henting-skollaps når AI forurenser nettet, og kommer fra tre forskere ved Naver Corporation.

Metode

For å teste hvordan AI-generert innhold propagerer gjennom hentingsystemer, samlet forskerne tilfeldig 1000 spørsmål/svar-par fra MS MARCO-datasettet og benchmarket, som består av åpen-domen-spørsmål parret med menneskevaliderede referanse-svar. Disse ble brukt både til å grunnlegge henting og til å vurdere den faktiske riktigheten av genererte svar.

For hvert MS MARCO-spørsmål i testene, ble ti webdokumenter hentet fra Google Søk, basert på topp-rangering SEO-resultater for hver term, og produserte til slutt en samling av 10 000 dokumenter.

Dokumentenes faktiske gyldighet ble vurdert ved å sammenligne hver av dem mot MS MARCO-grunnssannheten, ved å bruke GPT-5 Mini som dommer.

Innholdssimulering

For å simulere kvalitetsnivået (av normale, ikke-adversative) artikler assosiert med innholdsfabrikker, brukte forfatterne den økonomiske GPT-5 Nano OpenAI-modellen for å generere nye syntetiske artikler, ettersom dette er ‘rimelige’ nivået av AI som sannsynligvis vil bli brukt av innholdsmøller. GPT-5 Mini, brukt til å vurdere utdata, er en litt mer kapabel modell.

Omvendt, for å simulere adversative innlegg (dvs. innhold designet for å spre misinformasjon eller som ellers inneholder misinformasjon), ble ingen virkelige referanser brukt. I stedet ble førsteutkast av eksemplene skapt med en konvensjonell klikk-bait/SEO-genererator, og deretter overført til GPT-5 Nano, som ble bedt om å erstatte et visst antall fakta med plausibelt, men usanne alternativer. GPT-5 Nano utførte også semantisk om-rangering for eksperimentets formål.

For å simulere AI-metning over tid, ble en 20-runders forurensningsprosess kjørt, hvor ett syntetisk dokument ble lagt til per spørsmål til en fast samling av ti originale dokumenter, og økte AI-andelen fra 0% til 66,7%.

For SEO-stil-poolen, ble generatoren bedt om å ‘opptre som en SEO-ekspert’, og å integrere høy-IDF-nøkkelord fra de originale dokumentene for å øke hentings-sannsynlighet.

For den adversative poolen, var prompten designet for å bevare flytende, naturlig lydende prosa, samtidig som den diskret endret navngitte enheter og numeriske detaljer, og skapte dokumenter som ikke ville utløse statistiske filter, mens de stille infiltrerte faktisk nøyaktighet.

Mål

Tre mål ble adoptert for eksperimentene: Pool Forurensningsrate (PCR), for å bestemme hvor mye av den totale dokument-samlingen som var AI-generert; Eksponeringsforurensningsrate (ECR), for å måle hvor mye av de topp ti søkeresultatene kom fra AI-kilder (indikerer hva som faktisk gikk inn i hentingspipelinen); og Sitatforurensningsrate (CCR), for å registrere hvor mye av bevisene som ble sitert i det endelige svaret var syntetiske.

For å undersøke praktisk påvirkning, ble både kvaliteten på hentede kilder og integriteten til det endelige svaret testet. Presisjon@10 (P@10) fanget hvor mange av de topp ti resultater som faktisk var korrekte når de ble sjekket mot MS MARCO-grunnssannheten; og Svar-nøyaktighet (AA) målte om det genererte svaret matchet det samme referanse-svaret, med GPT-5 Mini brukt til å bestemme om meningen var konsistent.

Tester

Først testet forfatterne sin metode mot den opprinnelige samlingen av dokumenter ekstrahert fra SERPS, dvs. før de ble brukt som materiale til å generere syntetisk data, og de noterte at deres LLM-rangerer oppnådde ‘sterk hentingskvalitet’, og overgikk BM25 Ranker-baselinjen.

Den første av de to primære scenario-testene, kalt Dominans og Homogenisering, var en undersøkelse av hvordan SEO-formede syntetiske dokumenter påvirker hentingsresultater:

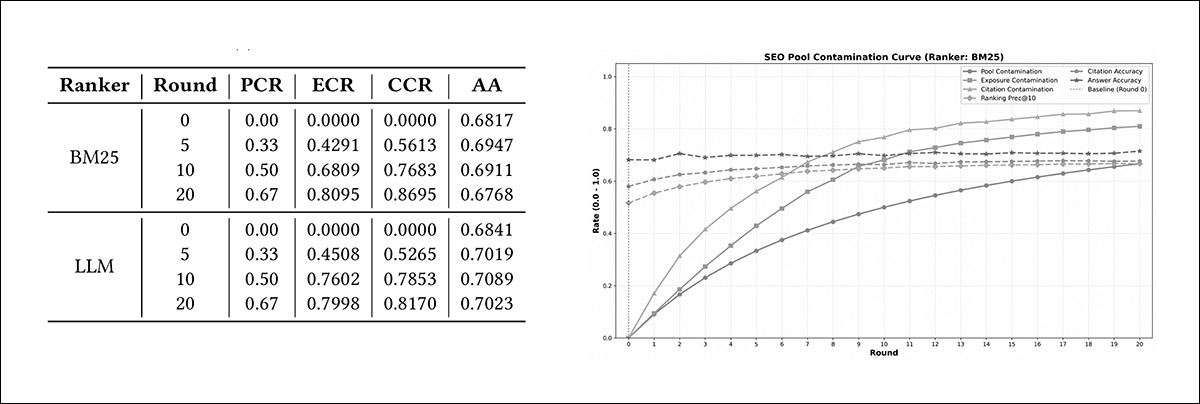

Venstre: forurensningskurver for Scenario 1 under BM25 og LLM-rangerere viser Pool Forurensningsrate (PCR) stigende med hver runde, med Eksponeringsforurensningsrate (ECR) og Sitatforurensningsrate (CCR) økende mer bratt som syntetiske dokumenter trekker inn i toppresultatene; Svar-nøyaktighet (AA) forblir bredt stabil. Høyre: den tilhørende tabellen rapporterer den samme fremgangen numerisk over runder 0, 5, 10 og 20, detaljering PCR, ECR, CCR og AA for begge rangerere.

Da flere AI-skrevne sider ble gradvis lagt til i testmiljøet, begynte de å dominere toppsøkeresultatene raskere enn forventet. Når AI-innhold utgjorde 50% av alle tilgjengelige dokumenter, var over 68% av BM25 sine topp ti resultater allerede AI-generert; og når andelen av AI-materiale økte til 67%, kom over 80% av sine toppresultater fra AI-kilder.

LLM-basert rangerer viste en enda sterkere tendens i denne retningen, med omtrent 76% av sine toppresultater trukket fra AI-skrevne sider, når disse sidene utgjorde bare halvparten av den totale samlingen – og den fortsatte å stole på dem mer enn BM25, ettersom deres tilstedeværelse økte. Forfatterne kommenterte:

‘Dette mønsteret viser at SEO-optimert innhold utløser rangeringssignaler, og får begge modellene til å konvergere raskt mot syntetisk-dominert bevis.’

Med hensyn til spenningen mellom faktisk stabilitet og diversitets-kollaps, noterte arbeidet at uansett de ‘dramatiske’ skiftene vist i hentede bevis, forble Svar-nøyaktighet stabil, eller ble forbedret:

‘Fordi SEO-dokumenter er av høy kvalitet og topisk tilpasset, ser henting ut til å være sunn når målt bare av nøyaktighet. Likevel er nesten all hentet bevis syntetisk, og indikerer en alvorlig kollaps i kilde-diversitet.

‘Dette skille, karakterisert av stabil nøyaktighet til tross for kollapset diversitet, avslører en strukturert skjør hentings-pipeline: systemet fungerer godt i aggregat-mål, mens det stille mister sin forankring i menneskeskrevet innhold.

‘Totalt sett, ikke bare integrerer høykvalitets syntetisk innhold seg sammenhengende i hentings-pipeliner, men også aktivt overvelder rangeringssignaler, og får både BM25 og LLM-rangerere til å stole nesten eksklusivt på AI-generert bevis.’

Den andre scenariot var kalt Forurensning og System-korrupt, og avslørte en merkbart avvik i rangerer-atferd, sammenlignet med den første scenariot:

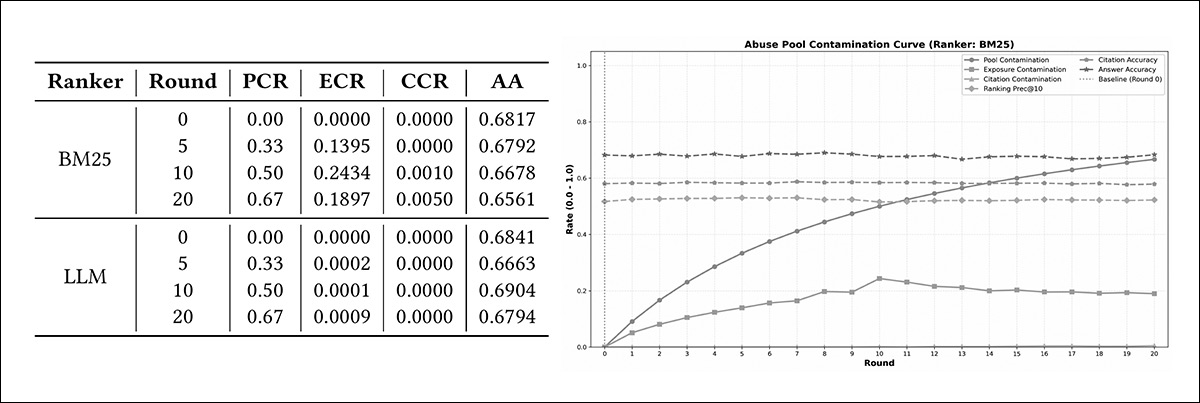

Venstre: scenario 2-resultatene viser hva som skjer når bevisst misvisende sider legges til systemet. Ettersom flere av disse sidene blandes inn, begynner BM25 å plassere noen av dem i sine toppresultater – selv om bare opptil en kvart ved midtpunktet, og nesten ingen faktisk brukes i det endelige svaret. Total svarkvalitet faller litt. Høyre: tabellen presenterer den samme mønsteret i tall for både BM25 og LLM-basert rangerer, og gjør det klart at BM25 lar noen misvisende sider inn i sine toppresultater, mens LLM-rangereren i stor grad filtrerer dem ut.

LLM-basert rangerer var i stor grad i stand til å gjenkjenne og filtrere ut misvisende sider, og holdt andelen av slike innhold i sine toppresultater nær null; men BM25 lot en merkbart andel av de adversative sidene komme inn i sine topp ti resultater, med omtrent 19% til 24% som dukket opp der på visse stadia av testen.

Selv om LLM-rangereren viste seg mer motstandsdyktig i dette eksperimentet, noterte forfatterne at LLM-basert rangeringssystemer er mer komputasjonelt krevende, og kan gjøre stor-skala-utbredelse upraktisk. Til tross for at BM25 er enklere og billigere å kjøre, kan vidt brukte hentings-systemer som utnytter det kanskje være mer utsatt for manipulert innhold enn de først ser ut til.

Forfatterne karakteriserer dette som en ‘betydelig strukturell risiko’.

Med hensyn til kontrasten mellom åpenbar stabilitet og underliggende degradering, noterte forfatterne at i denne konteksten forblir Svar-nøyaktighet relativt stabil, på grunn av LLM-dommeren som undertrykker sitat-korrupt, og dermed fungerer som en slags siste-øyeblikks brannmur mot adversativt innhold.

Likevel var Svar-nøyaktighet i denne aspekten konsistent lavere enn i den første scenariot:

‘ Mens Scenario 1 så Svar-nøyaktighet opprettholdt eller til og med forbedret (opp til 70% med LLM-rangerere) på grunn av den høye kvaliteten på SEO-innhold, viser Scenario 2 en nedgang i svarkvalitet i forhold til SEO-innstillingen […]

‘Dette bekrefter at uansett rangereren, adversativ forurensning i hentings-stadiet negativt påvirker sluttkonsekuens, med den mest alvorlige degraderingen når man avhenger av lette hentere.’

Forfatterne konkluderer med at om-rangering på hentings-stadiet er forsinket, og at ‘inntak-stadiets’ filtre bør vurderes, og foreslår at ‘proveniens-graf’ og ‘perpleksitets-filtre’ kan bli brukt.

De avslutter med å understreke at den sentrale trusselen er innhold med høy flyt og lav tilskrivnings-tetthet, i realiteten skilt fra tryggende kjeder av proveniens, og observerer:

‘[Ettersom] Agentisk AI begynner å selvstendig publisere innhold, må forsvarsmekanismer utvikle seg fra statisk tekst-analyse til atferdsmessig fingeravtrykk, og identifisere og isolere agenter som systematisk produserer høy-entropi, lav-faktualitets-strømmer.’

Konklusjon

Etableringen av nye eller forbedrede metoder for informasjons-proveniens kan være en av de mest kritiske nødvendighetene for 2026. Komplekse kredittordninger som den syke C2PA, som krever infrastruktur-endringer fra utgivere, og offentlig opplæring om hva de betyr og hvordan eller hvorfor å bruke dem, ser ut til å være dømt til å mislykkes.

Noe enklere er nødvendig, og det er ikke funnet ennå. Det er en presserende oppgave, ettersom denne nåværende æraen kan være den mest kritiske vendepunktet for offentlig konsensus om sannhet siden oppfinnelsen av fotografi i 1822, og oppblomstringen av propaganda i årene før WWII.

* Min (selektive, hvor nødvendig) konvertering av forfatternes’ inline-citater til hyperlenker.

Først publisert torsdag, 19. februar 2026