Andersons vinkel

AI Kan Gjette Året for Et Foto Basert på Personers Alder

Ny forskning viser at AI kan bruke menneskers ansikter til å estimere året et foto ble tatt, ved å kombinere aldersgjetninger med kjente fødselsår for å slå gjeldende scenebaserte metoder.

Å gjette datoen for et foto var tidligere mye enklere enn det er nå, fordi hårmoter og klesmoter utviklet seg i en rasende fart. Av mange omdiskuterte årsaker, stoppet denne utviklingen av visuell stil for omtrent tretti år siden, noe som gjør at det ikke lenger er like enkelt å se på en frisyre eller klesplagg og gjette året ut fra denne type visuell ledetråd.

For en stund var det mulig å datere bilder og filmer basert på fargeresolusjon og kornkarakteristika for filmstock. En trengte ikke å være en rettsmedisinsk spesialist; hvis du så nok gamle filmer, ville de kulturelle ledetrådene (slik som musikk, biler, mote, emner osv.) til slutt bli assosiert med filmstock-stiler:

![En illustrasjon av hvordan forbedringer i filmstock gradvis utvidet rekkevidden av hudtoner og lysstiler over tid, fra flate, frontale oppsett til mer naturalistiske og varierende utseender. [Kilde ] https://archive.is/3ZSjN (min egen artikkel)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

En illustrasjon av hvordan forbedringer i filmstock gradvis utvidet rekkevidden av hudtoner og lysstiler over tid, fra flate, frontale oppsett til mer naturalistiske og varierende utseender. Kilde (min egen artikkel)

En ekstra “anker” for å datere et fotografi var om det var i sort-hvitt – en økonomi som ble unødvendig etter populariseringen av digital fotografering tidlig i dette århundret

Et antall kommersielle og eksperimentelle systemer, som MyHeritage-abonnementsbundlet PhotoDater, prøver å datere bilder ved å bruke disse og andre kriterier.

![Et eksempel på fotoaldersestimering fra MyHeritage PhotoDater-abonnementsbasert tjeneste. Kilde [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Et eksempel på fotoaldersestimering, fra MyHeritage PhotoDater-abonnementsbasert tjeneste. Kilde

Fraværet av andre avslørende tegn, som smarttelefoner eller andre tidsspesifikke teknologier, gjør at den beste måten å bestemme alderen på et foto tatt i løpet av de siste 15-25 årene er hvis du kjenner personen (dvs. en kjendis eller kanskje en bekjent), og kan estimere deres alder, noe som gir en omtrentlig årstall.

Ansiktets Alder som Referanse

I feltet datavisualisering, og i mange andre felt (dvs. rettsmedisin, arkivbehandling, journalistikk, datasettarkitektur osv.), er evnen til å bestemme alderen på et foto et ettertraktet mål, siden mange av de mest interessante digitale og analoge samlinger mangler ordentlig annotering og metadata, eller har feil metadata fra tidligere (feil) gjetninger.

Derfor ville det være nyttig hvis et AI-system kunne gjennomgå bilder på samme måte som vi gjør når vi ser tilbake på våre historiske samlinger, og kommenterer ‘Oh ja, det var da…’. Spørsmålet er, hva kunne være hakken, fraværende de vanlige nødvendige ledetrådene?

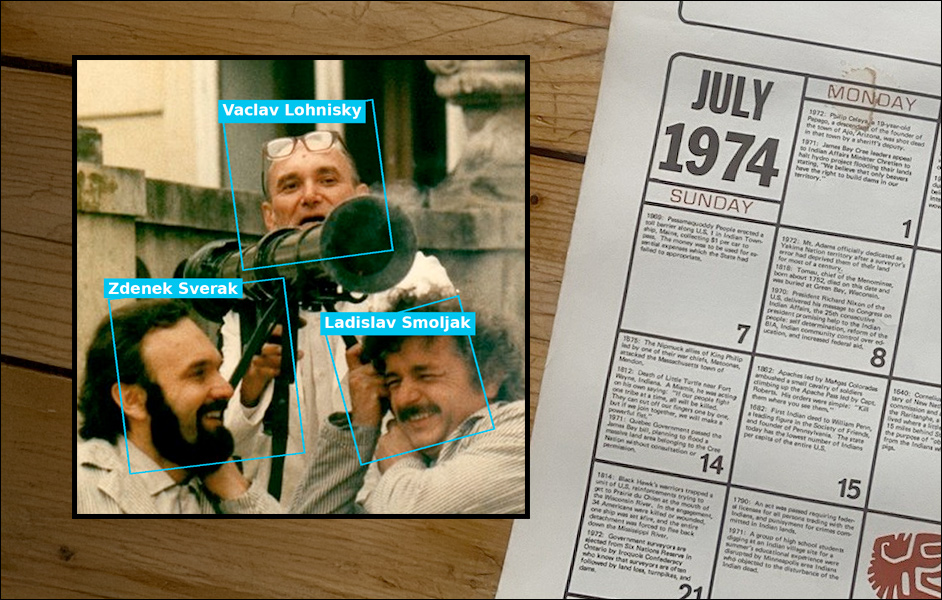

En ny forskningsartikkel fra Tsjekkia tilbyr en initial fotfeste inn i denne tilnærmingen, ved å utnytte AI-basert aldersgjenkjenning systemer, i koncert med ansikts gjenkjenningssystemer koblet til en felles database over identiteter (i dette tilfelle en IMDB-liknende samling med tsjekkiske artister og filmprodusenter):

![Et bilde fra Joachim, Put It in the Machine (1974), brukt til å illustrere datingsprosessen. Modellen detekterer kjente personer i bildet, estimerer deres alder ved å bruke en ansiktaldersestimator (høyre kolonne), og trekker denne verdien fra hvert persons fødselsår for å generere en sannsynlighetsfordeling over mulige fotodatoer. Grafene viser sannsynligheten for hver aldersestimat, med streked linjer som markerer personens sanne alder på tidspunktet for fotot. [Kilde ] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Et bilde fra ‘Joachim, Put It in the Machine’ (1974), brukt til å illustrere datingsprosessen. Modellen detekterer kjente personer i bildet, estimerer deres alder ved å bruke en ansiktaldersestimator (høyre kolonne), og trekker denne verdien fra hvert persons fødselsår for å generere en sannsynlighetsfordeling over mulige fotodatoer. Grafene viser sannsynligheten for hver aldersestimat, med streked linjer som markerer personens sanne alder på tidspunktet for fotot. Kilde

Systemet fungerer ved å detektere kjente personer i et bilde, estimere deres ansiktsalder ved å bruke en forhånds trenet modell, og trekke denne estimaten fra deres dokumenterte fødselsår for å generere sannsynlige datoer for bildet. Når flere ansikter er til stede, blir datoestimater aggregert for å produsere en endelig prediksjon.

Metoden ble testet på bilder kuratert fra Czecho-Slovak Movie Database (CSFD), med det resulterende tilnærmingen, som forfatterne hevder, tilbyr jevnt bedre nøyaktighet enn scenebaserte modeller (statiske modeller som baserer seg på bakgrunns-elementer eller visuell kontekst fremfor ansikter) trenet på samme data.

Schemat for denne metoden krever en sentral database som inneholder kunnskap om en bred gruppe personer; men noen lignende samling som inneholder bekreftede fødselsdatoer og sentral dato-bekreftede hendelser kunne gi et lignende resultat.

Artikkelen sier:

‘Unikt, vårt datasett tilbyr annotasjoner for flere personer innen ett enkelt bilde, og muliggjør studiet av multi-ansiktsinformasjonsaggregasjon. Vi foreslår en sannsynlighetsramme som kombinerer visuell bevis fra moderne ansiktsgjenkjenning og aldersestimeringsmodeller, og karrierebaserte tidsfordrunger for å slutte seg til fotooppfatningsåret.

‘Våre eksperimenter demonstrerer at aggregasjon av bevis fra flere ansikter konsistent forbedrer ytelsen og tilnærmingen overgår betydelig sterke, scenebaserte utgaver, spesielt for bilder som inneholder flere identifiserbare personer.’

Den nye artikkelen heter Photo Dating by Facial Age Aggregation, og kommer fra to forskere ved Czech Technical University i Praha, med løftet om en senere kode/data-utgivelse.

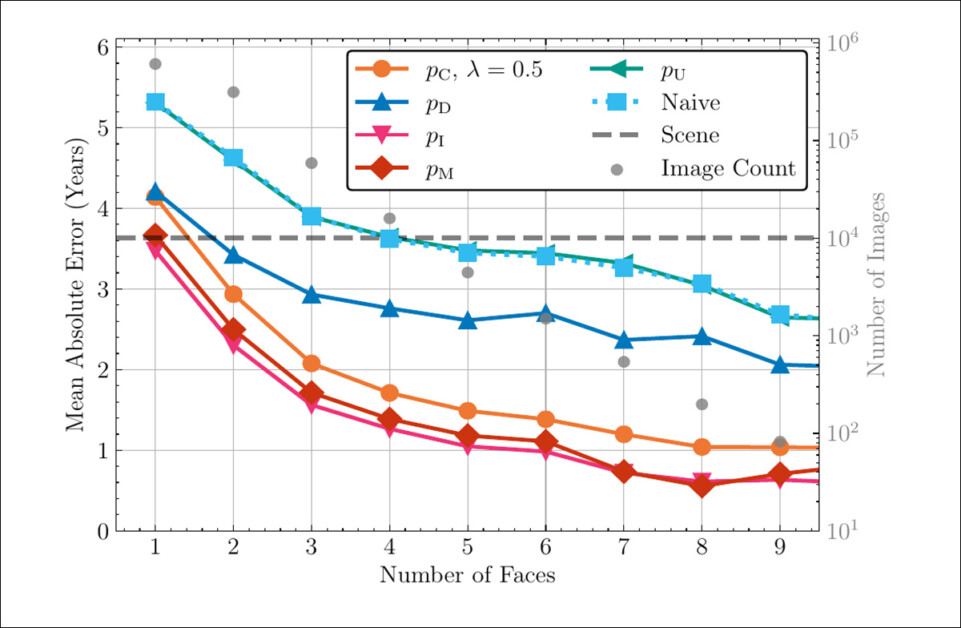

Metode

For å estimere når et foto ble tatt, ser forfatternes nye system på hvert detektert ansikt og prøver å gjette hvem det kan være, ved å bruke den ovennevnte database over kjente personer. Siden en person bare kan opptre en gang i et bilde, sjekker systemet alle kombinasjoner av mulige identiteter og bruker deres kjente fødselsår for å gjette hvor gammel hver person ser ut.

Etter dette arbeider det bakover for å estimere det mest sannsynlige året som ville gjøre at disse alderne stemmer overens:

Venstre: systemet bygger en tidslinje som viser når de gjenkjente personene var mest aktive, basert på deres kjente karrierer. Høyre: dette kombineres med ansiktsaldersestimer til å produsere en endelig gjett på når bildet ble tatt.

For å håndtere de mange mulige identitetskombinasjonene, antar systemet at ansikter er uavhengige, og at hver enkelt ansikts utseende avhenger bare av dens identitet og dato for bildet.

For å estimere når et foto ble tatt, gjettet systemet først alderen til hvert detektert ansikt ved å bruke NIST cvut-002-modellen, som er basert på en ViT-B/16-arkitektur, og trenet på en privat datasett (som, forfatterne hevder, rangerer høyt i NISTs Face Analysis Technology Evaluation (FATE) database).

Når personens fødselsår er kjent, konverterer modellen aldersestimaten til en sannsynlig bildedato ved å enkelt legge til alderen til fødselsåret, og gir en sannsynlighetsfordeling over mulige oppfatningsår. For å vurdere hvor godt et detektert ansikt matcher en kjent identitet, sammenligner systemet deres innlejring i ArcFace-rom:

![ArcFace, den sentrale bidragende arkitekturen for den nå populære InsightFace-modellen, ble lansert i 2015, og var bestemt til å bli et innflytelsesrikt prosjekt i ansiktsvurdering og evaluering. [Kilde ] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, den sentrale bidragende arkitekturen for den nå populære InsightFace-modellen, ble lansert i 2015, og var bestemt til å bli et innflytelsesrikt prosjekt i ansiktsvurdering og evaluering. Kilde

Hver identitet representeres av en gjennomsnittlig innlejring bygget fra dens referanseportretter. Likheten mellom et testansikt og en identitet måles deretter ved å bruke en Von Mises Fisher Distribution, som modellerer hvor tett identitetens portretter samler seg rundt denne gjennomsnittlige innlejringen. En felles skarphetsparameter kontrollerer hvor sikker systemet er på disse klustrene, og estimeres ved å bruke en leave-one-out-strategi på identitetsportrettene.

Modellen definerer fem typer priorer for å estimere når en gjenkjent person kan opptre i et bilde: uniform; tiår; film; bilde; og en konvex kombinasjonsprior som blandet de sterkeste og svakeste alternativene, for å teste følsomheten for prior-styrke (dvs. styrken på priorer under stress).

For å håndtere ansikter som ikke kan gjenkjennes med sikkerhet, inkluderer modellen en reserve ‘ukjent’ identitet med upåvirkede fordelinger, med et ansiktslikhet som er flat i innlejningsrommet, og en tidsfordel som er flat over alle år. Dette tillater usikre ansikter å bli ignorert uten å forvrengle den endelige datoestimaten:

Hvordan ytelsen påvirkes når noen ansikter i et bilde ikke kan gjenkjennes. Hver firkant viser gjennomsnittlig dato-feil for forskjellige antall kjente og ukjente identiteter, med firkants størrelse som reflekterer hvor vanlig denne kombinasjonen er i datasett. Feil øker med flere ukjente, men synker jevnt når flere kjente identiteter legges til.

Data og Tester

Forfatterne brukte den ovennevnte CSFD-datasett for å tilby data for en ny samling som de titulerte CSFD-1.6M. Datasett ble bygget fra scener med flere personer, med hvert ansikt merket med identitet og år. Denne strukturen var nødvendig for å lære modellen hvordan ansikter relaterer til hverandre i kontekst; enkeltansiktsdatasett som IMDB-WIKI støtter ikke dette, siden de kun merker en person per bilde.

Filmutsendelsesår fra Czecho-Slovak Movie Database ble brukt til å estimere når hvert foto ble tatt, med hver person i bildet matchet til en offentlig profil som inneholder fødselsåret, og et portrett.

Deretter ble hvert ansikt i bildet matchet til en av de kjente identitetene, først ved å bruke ArcFace til å lage ansiktsinnlejring, og beregne en gjennomsnittlig innlejring for hver identitet.

Etter dette ble Hungarian-algoritmen brukt til å tildele ansikter til identiteter ved å sammenligne innlejringssimilaritet, med justeringer gjort når antallet detekterte ansikter via SCRFD-10GE-rammeverket ikke matchet antallet kjente personer.

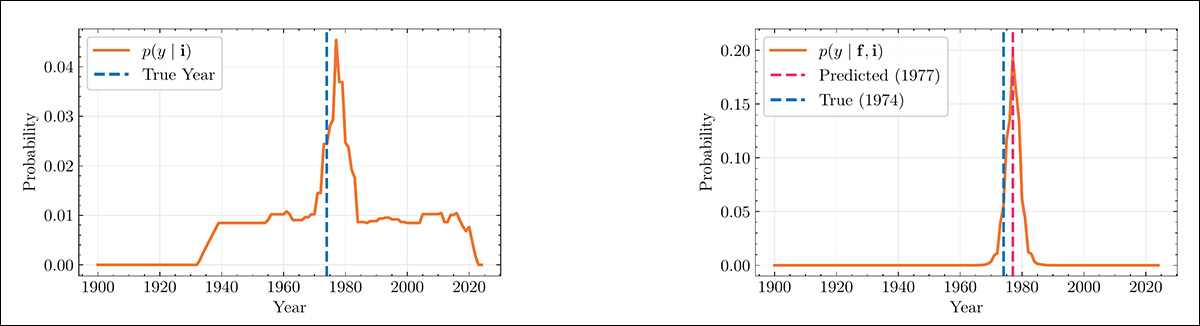

Statistikk fra CSFD-1.6M-datasett, detaljert skrapede bilder, detekterte ansikter, identitetsmatcher, endelige annoterte prøver, og den tilgjengelige identitetspoolen.

Matcher ble avvist hvis likheten var for lav eller hvis den estimerte alderen avviet for mye fra den kjente alderen, med større toleranse tillatt for eldre personer, og ansikter ble ikke filtrert etter kvalitet eller størrelse.

Forfatterne påpeker overlegenheten til deres kurerte sett over det nærmeste sammenlignbare datasett, IMDB-WIKI:

‘Vårt datasett er ikke bare betydelig større, men kritisk, består av multi-person-scener som kreves av vår modell. Mens ingen webskrapede datasett er fri for etikettstøy, vår annoteringspipeline utnytter de eksplisitte lenkene mellom bilder og identitetsprofiler som er gitt av database, med mål om høyere kvalitet på identitets tilordninger.’

Deres evaluering sammenlignet flere versjoner av datingsystemet, for å forstå hvor dens gevinster kom fra. En modell antok fullstendig kunnskap om hvem som var i bildet, og ga en øvre grense for ytelse ved å fjerne all usikkerhet i identitetsgjenkjenning, med den fullstendige versjonen av modellen som estimerte identiteter og datoer sammen, og veide forskjellige mulige identitets tilordninger før den kom til en endelig årsestimat.

En enklere variant valgte den enkelt mest sannsynlige identitetskonfigurasjon uten å marginalisere over alternativer, noe som viste seg å være nesten like effektiv i praksis.

I motsetning til dette var den enkleste baseline at hver enkelt ansikt ble tildelt uavhengig, og de resulterende aldersbaserte årsestimer ble kombinert uten å vurdere om identitetene kollektivt gjorde mening.

For å teste hvor mye metoden ble forbedret ved å bruke ansikter overhodet, ble en separat modell trenet til å estimere datoen direkte fra hele scenen. Denne scenebaserte modellen utgjør den sterkeste alternative tilnærmingen som for tiden brukes i bilde-datoestimering, siden den kan lære æraspesifikke visuelle mønster over hele bildet, fremfor å basere seg på identitet eller alder.

Metrikker og Data

Gjennomsnittlig absolutt feil (MAE) mellom den estimerte året og den kjente bakgrunnsåret var den sentrale metrikken for eksperimentene.

Dataene ble delt inn i fem deler, med omsorg for å sikre at alle bilder fra samme film ble holdt innen en enkelt partisjon. Tre av disse delene ble brukt til trening, en til validering, og en til testing. Denne fem-doble rotasjonen ble brukt til å forhindre overfitting.

Ettersom ansiktsbaserte modeller ikke ble trenet på dette datasett, var ingen splitting nødvendig, og i stedet ble de evaluert direkte på hele CSFD-1.6M-settet.

Den Scene-modellen ble trenet i 200 epoker under Adam-optimalisatoren, med bilder resizet til en 384×384 kropp.

Resultater

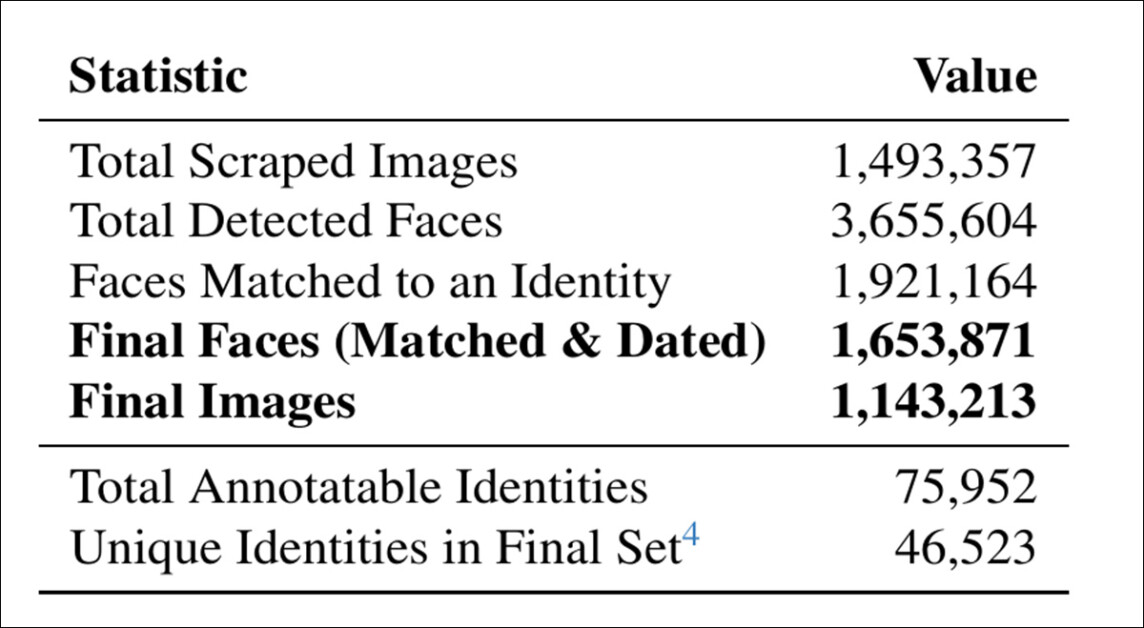

Resultatdelene av artikkelen er uvanlig fordelt over en rekke ytelsesindikatorer, med ingen enkelt utmerket eller sentral test. Imidlertid vil vi presentere en rekke av de mest pertinente resultater her.

Det viktigste resultatet er ikke et enkelt tall, men en mønster: ansiktsaggregasjonsmodeller (spesielt Full og Top-1-varianter) overgår konsistent den sterke Scene-baselinjen når to eller flere kjente identiteter er til stede – selv om Scene-modellen er trenet direkte på datasett, og støtter den sentrale påstanden om at identitetslenket ansiktsdatoestimering gir en mer robust signal enn helhetlig scene-tolkning.

For å evaluere effekten av tidsfordel, sammenlignet forfatterne flere konfigurasjoner av deres Full-modell. Den sterkeste ytelsen ble oppnådd ved å bruke tiår-prior, som signifikant overgikk både Naive-modellen (som ikke bruker noen tidsfordel) og Uniform-prior (som antar ingen preferanse over år):

Ytelse synker skarpt for alle metoder når antallet ansikter øker, men modeller som bruker realistiske tidsfordel som tiår-prior er påvirket langt mindre. Den naive og Scene-baselinjene forblir flate eller forverrer seg med større grupper, mens Full-modellen guidet av informerte priorer holder lav feil. Oracle-baserte priorer, som avhenger av testsett-statistikk, definerer den nedre grensen for oppnåelig ytelse.

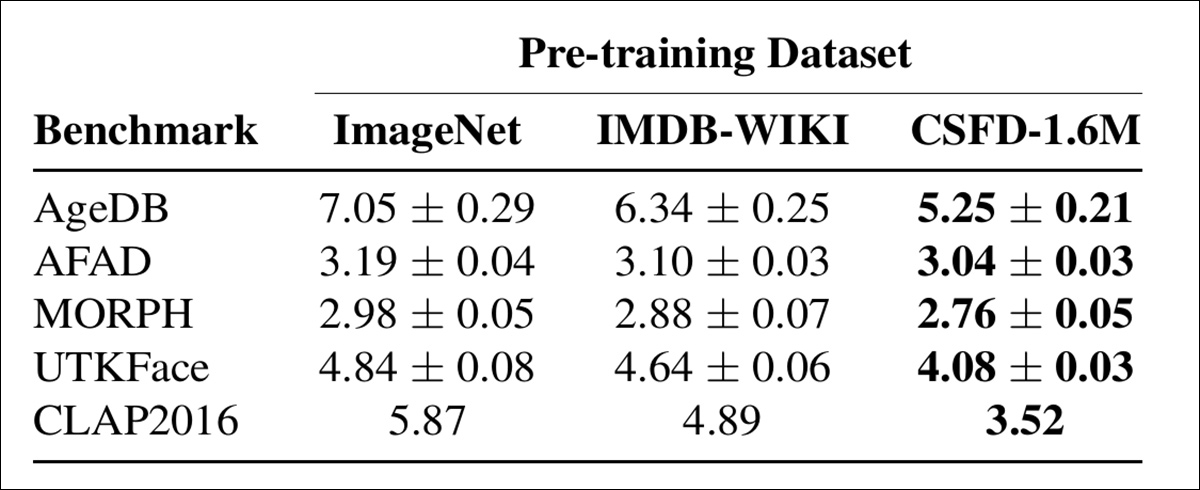

For å demonstrere verdien av CSFD-1.6M utover foto-datoestimering, ble datasett også testet som en forhåndstreningsressurs for den bredere oppgaven med ansiktsaldersestimering. Etter en standard evalueringprotokoll, ResNet101-modeller ble forhåndstrenet på CSFD-1.6M, og sammenlignet med motparter forhåndstrenet på IMDB-WIKI og ImageNet. Disse modellene ble deretter finjustert og evaluert over fem populære benchmarksett: AgeDB; AFAD, MORPH; UTKFace; og CLAP2016:

Gjennomsnittlig absolutt feil (plus/minus standardavvik) på fem aldersestimeringsbenchmarksett, sammenlignende modeller forhåndstrenet på ImageNet, IMDB-WIKI, og CSFD-1.6M. Lavere verdier indikerer bedre ytelse. CSFD-1.6M gir de sterkeste resultater over alle benchmarksett.

Over alle fem datasett førte forhåndstrenning på CSFD-1.6M til de laveste feilratene, og overgikk de to andre forhåndstreningskildene med et tydelig margin – et ytelsesgap som viste seg å være sterkest på AFAD og CLAP2016, men forblev konsistent over hele linjen.

Vi henviser leseren til resten av den noe fragmenterte resultatdel i kildeartikkelen, som også omhandler omfattende ablasjonsstudier.

Konklusjon

Selv om den nye artikkelen raskt blir tett og utilgjengelig for den vanlige leseren, er emnet behandlet blant de mest interessante og relevante i datavisualiseringslitteraturen – ikke minst fordi det krysser over ganske dyktig inn i antropologi og kulturstudier, hvor konstantene er harde å fange.

* Akkurat som musikalsk evolusjon også slo ned sin endringshastighet.

Først publisert mandag, 10. november 2025