Andersons vinkel

Bruk av ‘sannsynlighet’ som en metode for å oppdage deepfakes

Hvis AI-generert video og lyd blir gode nok, vil deepfake-oppdagermetoder basert på visuelle artefakter eller andre tradisjonelle signaler ikke fungere lenger. Men ettersom mennesker sjelden avviker fra forutsigbar atferd, kan kanskje ‘sannsynlighet’ bli tatt i bruk som en signal for om en video eller en nyhetsrykte er sannsynlig å være sann.

Opinion I begynnelsen av 1990-årene avslørte den respekterte tidligere britiske fotballspilleren og TV-sportkommentatoren David Icke uventet på en pratshow at han var ‘Guds sønn’ – en merkelig og uventet avsløring som ville utvikle seg over de neste tiårene til en varig og omfattende konspirasjonsteori om en hemmelig og mektig global kabale av ‘øglepersoner’.

Med internettadopsjon fortsatt noen år unna, og begynnelsen på sosiale medier enda lenger fremme i tid, hadde den store dissonansen mellom Ickes berømmelse og naturen til hans nye innsikt en dyp innvirkning på den britiske offentligheten – ikke minst på grunn av fullstendig manglende kontekst eller noen type forberedelse for denne massive endringen, fra en velkjent og etablert sportspersonlighet.

Mer enn tjue år senere skjedde en lignende og mye mørkere variant av denne sosiale sjokket, da den elskede veldedighetskampanjen og barne-TV-verten Jimmy Savile ble posthumt funnet å være en seriøs og rapacious livslang sexforbryter som hadde brukt sin fromme offentlige bilde til å lette sine forbrytelser.

Den påfølgende Operation Yewtree-politietterforskningen ville avdekke mange flere britiske kjendiser med lange historier av seksuelle forbrytelser; senere ville Harvey Weinsteins rettssak føre til en lignende oppdagelse av kjendis-sexforbrytere i USA, som ville utvikle seg til #metoo-bevegelsen, og bli en del av amerikansk kultur i utgaver som The Morning Show. ‘Sjokk’-nyheter syntes å utvikle en ny og brå mal – en som til slutt ville bli tatt i bruk av deepfake-angripere.

Slutten på ‘tradisjonell’ deepfake-oppdaging?

Selv om sosiale medier og AI hadde vært til stede i begynnelsen av 1990-årene, ville ingen prediktivt system i verden ha kunnet forutse Ickes pratshow-avsløring, som (som jeg godt husker) ikke var noen gang forutsagt i årene før hendelsen.

Men hvis AI hadde vært til stede, ville det kanskje ha tatt noen tid å overbevise et bredere publikum om at Ickes erklæringer ikke var et produkt av Google Veo 3, eller en annen av de nye hyper-realistiske audio/visuelle deepfake-rammeverkene.

Det er først i løpet av de siste 6-12 månedene at AI-deepfake-metodene har blitt effektive nok til å innfri års medie-doom-saying om deepfake-valginterferens, og kapable nok til å generere den type rask-strekk rykter som er usann, men vanskelig å utrydde i en stadig mer troende kultur.

Inntil nå har AI-video-utdata vanligvis falt kort av sant realisme, begrenset av tekniske hindringer og stadig mer polarisert av en økende gap mellom restriktive vestlige modeller og Kinas usensurerte åpne kilde-utgaver**.

Likevel bemerker jeg stadig mer i forskningslitteraturen en nærmende krigserklæring av denne kalde krigen, for eksempel i den nye artikkelen Performance Decay in Deepfake Detection†:

‘[Vi] antar at deepfake-videoer vil fortsette å inneholde maskinlærte egenskaper som pålitelig skiller dem fra ekte videoer. Ettersom generative AI-kapasiteter fortsetter å utvikle seg raskt, kan denne antagelsen bryte sammen.

‘I en slik situasjon vil vannmerking og andre proveniens-sporingsmetoder være den eneste utveien for å opprettholde tillit til digitale medier.’

Men samme artikkel innrømmer at proveniens-baserte løsninger som Adobe-ledende Content Authenticity Initiative (og de mange mindre forsknings tilbud fra de siste 7-8 årene) krever en så omfattende adopsjon at det er urealistisk; og artikkelen ender på en generell note av retrett, hvis ikke nederlag.

Hvis audio-visuelle deepfake-oppdagermetoder utvikles av generative AI, og global adopsjon av en intrusiv vannmerking eller proveniens-scheme faller på de diverse logistiske hindringer, hva kan være en felles sentral egenskap som kan erstatte dem som indikatorer for potensielt falskt utdata? Eller må vi resignere oss til en verden hvor all media er i tvil, og Liar’s Dividend hersker?

Kunnskapsgrafer

Det ser ut til å være på tide å utnytte sannsynlighet og troverdighet av ‘rapporterte hendelser’ som en signal-egenskap i deepfake-oppdaging. Videre, ettersom video- og audio-generative AI-systemer stadig konvergerer, kan det også være på tide for de separate forskningsstrålene ‘fake news’ (som en tekst-basert narrativ hendelse) og fake-bilder/video å konvergere.

En sannsynlighet-deepfake-metrik er ikke det samme som RAG-aidet fakta-verifisering, hvor en AI-modell kan hente inn nåværende web-resultater for å få kunnskap om hendelser som skjer etter dens egen stengingsdato, og/eller for å bekrefte sine påstander.

Snarere ville det utføre prediksjoner basert på generelt indikative statistiske trender, avledet fra historiske mønster som samsvarer med en nåværende undersøkelse.

I denne forstand er en sannsynlighetsmetode nærmere statistisk analyse enn mer moderne tråder i den nåværende maskinlærings-scenen.

Tidligere overskygget av mer moderne Transformers-tilnærminger, kunnskapsgrafer gjør en slags comeback i bedriftsrommet, og ser ut til å være tilpasset potensiell utbredelse av ‘sannsynlighet’-metrikker i deepfake-oppdaging.

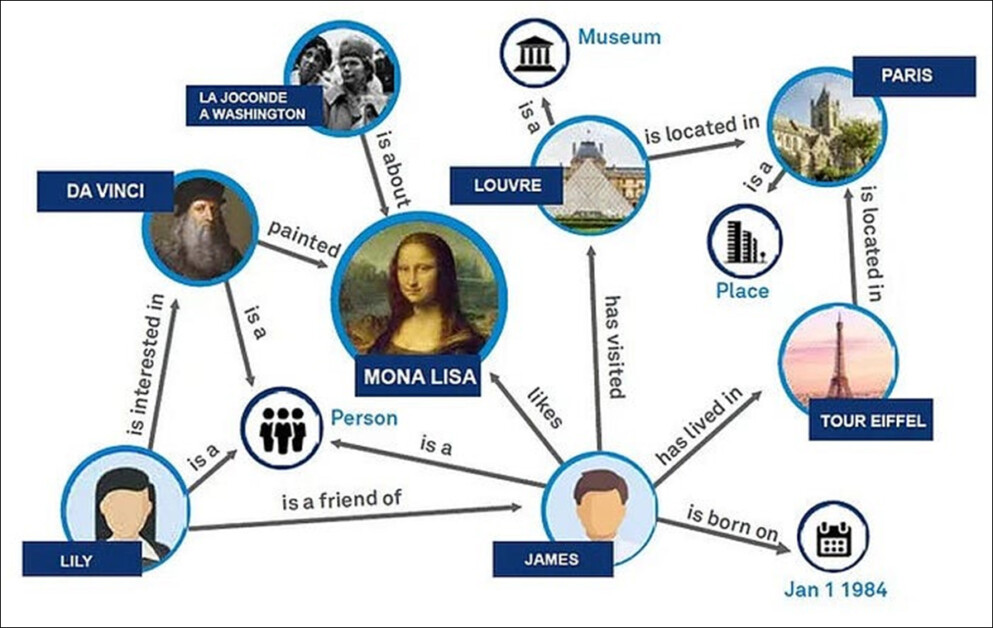

En forenklet kunnskapsgraf som viser hvordan mennesker, steder, kunstverk og hendelser kan kobles sammen gjennom merkte relasjoner, og muliggjør maskiner å resonnere over virkelige enheter og deres sammenhenger. Kilde

En kunnskapsgraf er en måte å organisere informasjon ved å kartlegge virkelige ting som mennesker, selskaper, hendelser eller ideer inn i et nettverk av sammenkoblede fakta.

Hver underenhet er en node, og lenkene mellom dem (kanter) beskriver hvordan de relaterer. For eksempel kan ‘Microsoft’ (en node) kobles til ‘OpenAI’ (en annen node) med en kant som sier ‘er en kunde av’. Disse sammenhengene lagres ofte i graf-databaser og følger en subjekt-predikat-objekt-struktur, som ‘Microsoft er en kunde av OpenAI’.

Varig minne

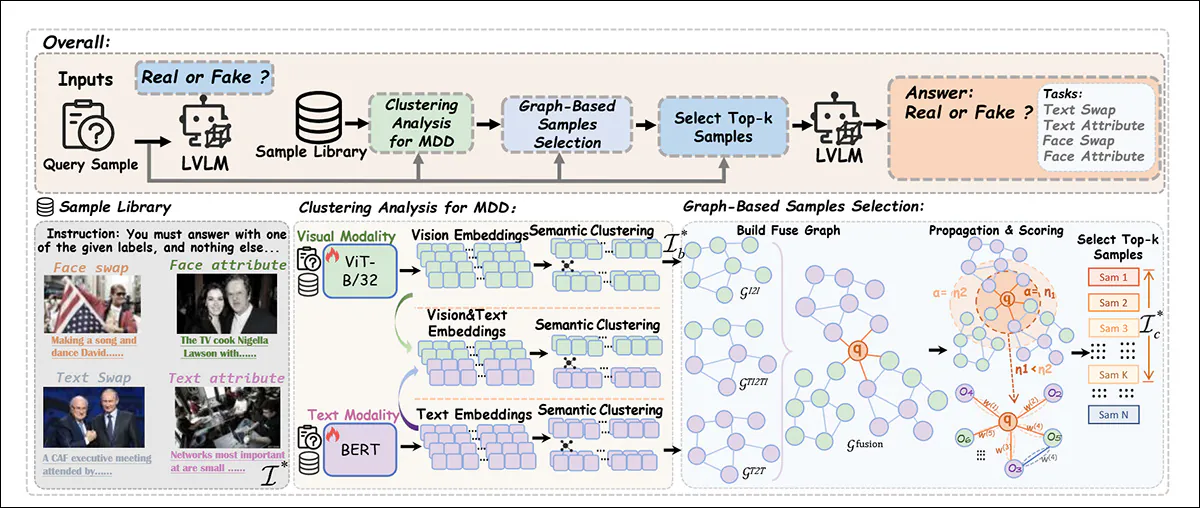

En kinesisk studie fra september i år foreslo en trening-fri metode som bruker graf-basert resonnement til å oppdage subtile inkonsistenser i multimodale deepfakes.

I stedet for å generere begrunnelser eller fine-tune store modeller, bygger systemet opp bild-tekst-par, bygger en likhetsgraf, og scorer koblinger, for å hente inn de mest relevante eksemplene, og disse guidere modellens dømmekraft uten behov for ny trening:

En oversikt over GASP-ICL-rammeverket, som forbedrer deepfake-oppdaging ved å kombinere graf-basert utvalg av prøver med kontekst-læring, og muliggjør en frozen visuell-språk-modell å klassifisere bild-tekst-par som ekte eller falske, uten trening eller fine-tuning. Kilde [ https://www.arxiv.org/pdf/2509.21774](https://www.arxiv.org/pdf/2509.21774)

Dette er sannsynligvis det nærmeste arbeidet, og det som har krysset min vei, til en ‘informert’ og historie-bevisst tilnærming til evaluering og verifisering av nye medie-utgaver. For det meste analyserer datamaskin-syns-tilnærminger bilder (inkludert rammer av videoer og temporale anomali som omfatter flere rammer) mens ‘fake news’-oppdager-rammeverk fortsetter å betone tekst-basert data, selv i multimodale prosjekter.

Funksjonskryp

Utfordringen med et prediktivt system av denne typen er omfanget av overvåking som kan være nødvendig for å gjøre tilnærmingen fullt ut utført – at minst beyond analysen av kjendiser og offentlige personer, for hvem fritt tilgjengelig data allerede eksisterer.

Sannsynligvis er den mest liknende nåværende tråden i forskningen feltet pre-crime, som merker diverse multimodale intelligens-signaler som ‘mistenkelige’, og presenterer seg som en pålitelig AI-skrekkel i utgaver som Person of Interest (2011-2016), og Minority Report (2002).

Mens en Person of Interest-lignende allomfattende overvåkingssystem ville produsere optimale resultater, er det usannsynlig at vestlig kultur kunne sanksjonere nivået av personlig intrusivitet som Kinas interne nettverk pålegger sine borgere.

Derfor, i forhold til potensielle falske nyheter om ikke-kjendiser, ville bare regjeringens etater som politiet (sammen med fødsels- og døds-registre og skattekontor) ha nok relevant historisk informasjon til å informere sannsynligheter i en graf-basert arbeidsflyt; og selv da ville de trenge CCCP-stil, kapasitet, lovgivning og ressurser for å inkludere gjennomsnittlige borgere i deres dekning og analyser (dvs. beyond banale, men obligatoriske data-punkter som passnummer og bilregistreringer).

Sannsynlighets-scoring

Det ser ut til å være sannsynlig at potensiell effektivitet av et system av denne typen ville være begrenset til de mest åpenbare (nåværende) bruksfallene for deepfake-innhold: destabilisering (stats-støttede deepfakes); kjendis- og ‘ukjent’ porn deepfakes (som begge kan regnes som skadelige, selv om den siste typen tenderer å tiltrekke seg dypere medie-oppmerksomhet); svindel (inkludert audio/visuelle deepfakes designet for å utføre ‘impersonation-tyverier’); og politisk karakter-myrding.

Et kunnskaps-basert system ville trenge en skala av sannsynligheter for en mangfoldighet av mulige hendelser. På den ene enden av spekteret, vanlige menneskelige svakheter som tvilsom økonomisk ledelse, utroskap, avhengighet, uforstand, osv.; på den andre enden… å avsløre at du er Guds sønn på en direktesendt TV-pratshow (eller hendelser av lignende størrelse og innvirkning).

Selv i den siste tilfelle ville personlige historiske faktorer for enkeltpersoner veie sannsynlighets-resultatet: en fremtredende politisk skikkelse som offentlig har tvilt på kontroversielle spørsmål (slik som sannhetsgehalten i 1960-/70-årenes månelanding) for å tjene kapital med en stadig ‘alternativt’-informert velger, kan få ekstra wildcard-status i verifiserings-rutiner, sammenlignet med deres mer stasjonære kolleger.

I tilfelle kjendis-porn, er det nok virkelige kontekst (dvs. 2012-kjendis-foto-lekkasjer, blant andre – ganske sjeldne – hendelser) for å generere en moderat Liar’s Dividend, i visse kontekster; men siden disse outlier-hendelsene tenderer å fungere som unntak som beviser regelen, ville de fleste av den nåværende avlingen av diffusjons-basert kjendis-porn-videoer være ansett som ekstremt ‘usannsynlig’ (selv om dette ikke løser problemet med å bruke menneskers identiteter for slike formål).

I forhold til nasjonal forstyrrelse, er det en betydelig rikdom av statistisk data som kan hjelpe med å vurdere sannsynligheten av ‘katastrofale’ rapporter. Selv i oldtiden syntes ‘ut-av-det-blu’ hendelser som utbruddet av den ukjente vulkanen Vesuvius i 79 e.Kr. å være forutsagt, hvis du hadde lyttet nøye; og foruten tilgjengeligheten av en mengde regjerings- og NGO-støttede strømmer, kan AI sin evoluerende kapasitet til å utvinne struktur fra rå data gi ekstra historisk kontekst for sannsynlighets-scoring.

Konklusjon

Selv en godt implementert prediktivt system av denne typen kunne ikke forklare tilfeldigheit, Guds verk, eller ondsinnede hendelser som er konstruert utenfor all overvåking.

Videre ville den enorme mengden og dybden av data som trengs, for å gi dekning også for ikke-berømte mennesker, være et politisk hindringspunkt – at minst for øyeblikket.

Likevel ser valgene ut til å bli smalere; visuell analyse er på vei til å mislykkes i møte med forbedret generativ AI, mens verifisering- og proveniens-scheme bærer en hindrende byrde av teknisk gjeld, og friksjon mot adopsjon. Dette gjør løsninger som Content Authenticity Initiative, og det uoppfylte Metaphysic.ai ansikt-kopieringssystem Metaphysic Pro, utfordrende å popularisere.

I deres bredeste bruk, kan RAG-baserte systemer bare bestemme om en autoritativ kilde støtter opp en uverifisert påstand; og siden mange store (sanne) nyhets-historier oppstår uten forhåndskontekst, er manglende støtte fra autoritative kilder ikke nødvendigvis meningsfullt.

Deres verdi kan vise seg å være større hvis de kan danne en del av et større data-økosystem som er opptatt av det ene som de fleste nåværende former for AI finner utfordrende – historisk kontekst.

* Ikke å forveksles med de tidlige autoencoder-utgavene som debuterte i 2017 og ville til slutt bli erstattet av overlegne tilnærminger.

† https://arxiv.org/abs/2511.07009

** Som vanligvis kan kjøres fritt på mer kraftfulle hjemme-PC-er, i stedet for bare å være tilgjengelig via gate-kept API-er som ChatGPT og Veo-serien.

††† Utelt legitime underholdnings-bruk, som profesjonelle visuelle effekter i film- og TV-produksjoner.

Først publisert torsdag, 13. november 2025