Kunstig intelligens

Supercharging Graph Neural Networks med store språkmodeller: Den ultimate guiden

Grafene er datastrukturer som representerer komplekse relasjoner over et bredt spekter av domener, inkludert sosiale nettverk, kunnskapsbaserte systemer, biologiske systemer og mange flere. I disse grafene representeres enheter som noder, og deres relasjoner avbildes som kanter.

Evnen til å effektivt representere og resonnere om disse intrikate relasjonelle strukturer er avgjørende for å muliggjøre fremgang i felt som nettverksvitenskap, kemioinformatikk og anbefalingsystemer.

Grafneurale nettverk (GNN) har oppstått som en kraftfull dyp læring ramme for graf maskinlæringsoppgaver. Ved å inkorporere graf topologien i neuralt nettverksarkitektur gjennom naboaggregasjon eller grafkonvolusjoner, kan GNN lære lavdimensjonale vektorrepresentasjoner som koder både nodens egenskaper og deres strukturelle roller. Dette gjør det mulig for GNN å oppnå toppkvalitet på oppgaver som nodklassifisering, lenkeprediksjon og grafklassifisering over diverse anvendningsområder.

Selv om GNN har drevet betydelig fremgang, finnes det noen nøkkelutfordringer igjen. Å oppnå høykvalitetsmerkede data for trening av overvåkede GNN-modeller kan være dyrt og tidskrevende. I tillegg kan GNN ha problemer med heterogene grafstrukturer og situasjoner hvor graf fordelt på testtid forskjeller betydelig fra treningsdata (ut av distribusjon generalisering).

I parallell har store språkmodeller (LLM) som GPT-4 og LLaMA tatt verden med storm med deres utrolige naturlige språkforståelse og genereringskapasiteter. Trenet på massive tekstkorpus med milliarder av parametre, viser LLM utrolige få-skuddlæringsferdigheter, generalisering over oppgaver og sunn fornuftsfærdigheter som tidligere ble ansett å være ekstremt utfordrende for AI-systemer.

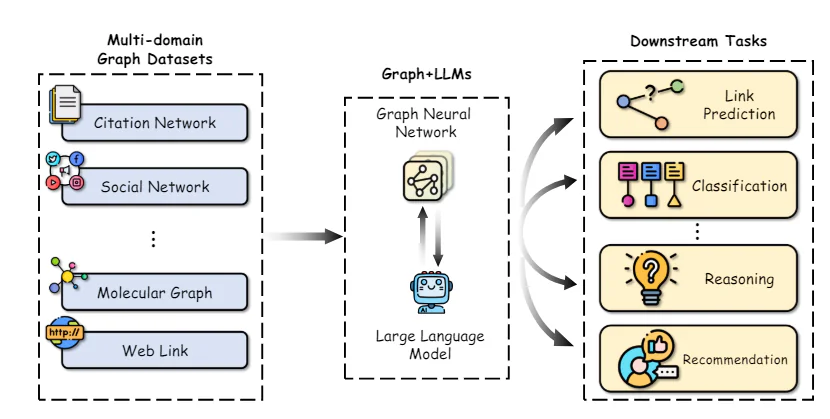

Den enorme suksessen til LLM har katalysert utforskninger av å utnytte deres kraft for graf maskinlæringsoppgaver. På den ene siden presenterer kunnskapen og resonnementskapasitetene til LLM muligheter for å forbedre tradisjonelle GNN-modeller. Omvendt kunne de strukturerte representasjonene og faktiske kunnskapen som er innebygget i grafene være avgjørende for å håndtere noen nøkkelbegrensninger i LLM, som hallucinasjoner og mangel på forklarbarhet.

Grafneurale nettverk og selv-overvåket læring

For å gi den nødvendige konteksten, vil vi først kort gjennomgå de grunnleggende konseptene og metodene i grafneurale nettverk og selv-overvåket grafrepresentasjonslæring.

Grafneuralt nettverksarkitektur

Grafneuralt nettverksarkitektur – kilde

Den nøkelforskjellen mellom tradisjonelle dype neurale nettverk og GNN ligger i deres evne til å operere direkte på grafstrukturert data. GNN følger en naboaggregasjonsskje, hvor hver node aggregerer egenskapsvektorer fra sine naboer for å beregne sin egen representasjon.

Mange GNN-arkitekturer har blitt foreslått med forskjellige instansieringer av meldings- og oppdateringsfunksjoner, som Grafkonvolusjonsnettverk (GCN), GraphSAGE, Grafoppmerksomhetsnettverk (GAT) og Grafisomorfienettverk (GIN) blant andre.

Mer nylig har graftransformatorer blitt populære ved å tilpasse selv-oppmerksomhetsmekanismen fra naturlige språktransformatorer til å operere på grafstrukturert data. Noen eksempler inkluderer GraphormerTransformer og GraphFormers. Disse modellene er i stand til å fange langrekkeavhengigheter over grafen bedre enn ren nabo-basert GNN.

Selv-overvåket læring på grafene

Selv om GNN er kraftfulle representasjonsmodeller, er deres ytelse ofte begrenset av mangelen på store merkede datamengder som kreves for overvåket trening. Selv-overvåket læring har oppstått som et løftende paradigme for å for-trene GNN på umerkede grafdata ved å utnytte pretextoppgaver som bare krever den intrinsikke grafstrukturen og nodeegenskapene.

Selv-overvåket graf – kilde

Noen vanlige pretextoppgaver som brukes for selv-overvåket GNN-for-trening inkluderer:

- Nodens egenskapsprediksjon: Tilfeldig maskering eller korrupsjon av en del av nodeattributtene/egenskapene og oppgaven til GNN til å rekonstruere dem.

- Kant/lenkeprediksjon: Læring til å predikere om en kant eksisterer mellom et par noder, ofte basert på tilfeldig kantmaskering.

- Kontrastiv læring: Maksimering av likheter mellom grafvisninger av samme grafprøve mens de skyver fra hverandre visninger fra forskjellige graf.

- Gjensidig informasjonsmaksimering: Maksimering av den gjensidige informasjonen mellom lokale noderepresentasjoner og en målrepresentasjon som den globale grafemblingen.

Pretextoppgaver som disse tillater GNN å trekke ut meningfulle strukturelle og semantiske mønster fra umerkede grafdata under for-trening. Den for-trente GNN kan deretter finjusteres på relativt små merkede undermengder for å utmerke seg på forskjellige nedstrømsoppgaver som nodklassifisering, lenkeprediksjon og grafklassifisering.

Ved å utnytte selv-overvåkning, viser GNN som er for-trent på store umerkede datamengder bedre generalisering, robusthet til distribusjonsforandringer og effektivitet sammenlignet med å trene fra scratch. Imidlertid finnes det noen nøkkelbegrensninger i tradisjonelle GNN-baserte selv-overvåkede metoder igjen, som vi vil utforske å utnytte LLM til å håndtere neste.

Forbedring av graf-ML med store språkmodeller

Integrering av graf og LLM – kilde

De bemerkelsesverdige evnene til LLM i å forstå naturlig språk, resonnere og få-skuddlæring presenterer muligheter for å forbedre flere aspekter av grafmaskinlæringspipeliner. Vi utforsker noen nøkkel forskningsretninger i dette rommet:

En nøkkelutfordring i å anvende GNN er å oppnå høykvalitets egenskapsrepresentasjoner for noder og kanter, spesielt når de inneholder rike tekstattributter som beskrivelser, titler eller abstrakter. Tradisjonelt har enkle sekkmønster eller for-trente ord-embedding-modeller blitt brukt, som ofte ikke klarer å fange de nyanserte semantikkene.

Nylige arbeider har demonstrert kraften til å utnytte store språkmodeller som tekst-encodere for å konstruere bedre nod-/kant-egenskapsrepresentasjoner før de sendes til GNN. For eksempel Chen et al. utnytter LLM som GPT-3 til å kode tekstuelle nodeattributter, og viser betydelige ytelsesforbedringer sammenlignet med tradisjonelle ord-embeddings på nodklassifiseringsoppgaver.

Utenfor bedre tekst-encodere kan LLM brukes til å generere augmentert informasjon fra de opprinnelige tekstattributtene på en semi-overvåket måte. TAPE genererer potensielle etiketter/forklaringer for noder ved å bruke en LLM og bruke disse som ekstra augmenterte egenskaper. KEA trekker ut termer fra tekstattributter ved å bruke en LLM og får detaljerte beskrivelser for disse termene for å augmentere egenskaper.

Ved å forbedre kvaliteten og uttrykkskraften til inndata-egenskaper, kan LLM impregnere sine overlegne naturlige språkforståelsesevner til GNN, og forbedre ytelsen på nedstrømsoppgaver.