Tankeledere

Hva hver dataekspert burde vite om Graph Transformers og deres innvirkning på strukturert data

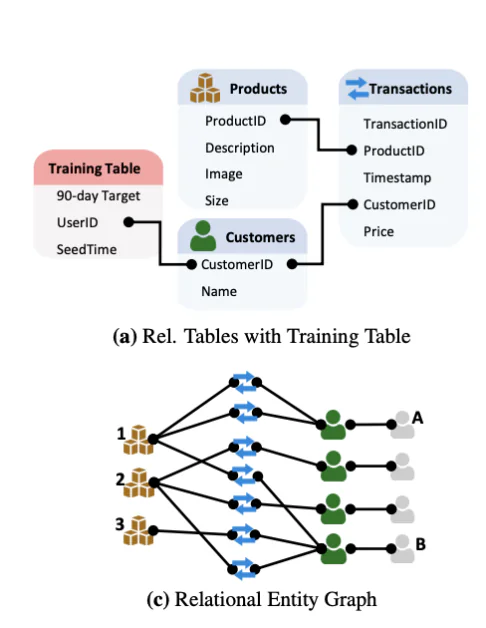

Jeg var med på å skape Graph Neural Networks mens jeg var ved Stanford. Jeg innsett tidlig at denne teknologien var usedvanlig kraftig. Hver datapunkt, hver observasjon, hver kunnskapsdel eksisterer ikke i isolasjon; det er en del av en graf som er koblet til andre kunnskapsdelar. Viktigst er at de fleste verdifulle forretningsdata, ofte lagret som tabeller i databaser og datahus, kan naturlig representeres som en graf. Å utnytte denne relasjonelle strukturen er nøkkel til å bygge nøyaktige og ikke-hallusinatoriske AI-modeller.

Grafneurale nettverk (GNNs) innførte meldingspasseringsarkitekturer som kunne resonnere over grafer og fange oppforbindelser mellom kunnskapsdelar. Men likevel som Transformers forvandlet språkforståelse, er en ny klasse modeller, Graph Transformers, med på å bringe lignende gevinster til graf-basert data. Disse modellene kombinerer fleksibiliteten til oppmerksomhetsmekanismer med strukturelle graf-priorer for å modellere komplekse relasjoner mer effektivt enn deres GNN-foregåere.

Hvorfor grafer trenger mer enn meldingspassering

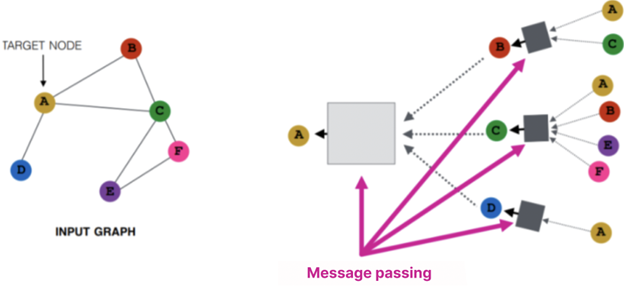

Tradisjonelle grafneurale nettverk (GNNs) avhenger av meldingspassering, en prosess hvor hver node oppdaterer sin interne tilstand ved å aggregere informasjon fra sine naboer. Tenk på det som hver node utveksler sammenfatninger med nærliggende noder, og deretter bruker disse sammenfatningene til å forfine sin egen forståelse. Over flere lag tillater dette informasjon å propagere gjennom grafen.

Selv om dette er kraftig for å lære lokale mønster, har meldingspassering viktige begrensninger:

- Over-kverning: Ettersom informasjon blir aggregert over mange hopp, kan den bli komprimert og miste meningsfulle detaljer. Dette er spesielt problematisk i dype GNNs.

- Begrenset kontekst: Standard meldingspassering kan ikke lett fange opp lange avhengigheter uten mange lag, noe som øker kompleksitet og støy.

- Uttrykksfullhet: Mange grafstrukturer kan ikke differentieres ved hjelp av bare lokale nabo-informasjon, noe som begrenser modellens ytelse på oppgaver som krever fine strukturelle distinksjoner.

Dette er der Graph Transformers kommer inn. Ved å erstatte eller supplere meldingspassering med oppmerksomhetsmekanismer, tillater de hver node å direkte oppmerke seg på andre noder (også fjerne noder) basert på lært viktighet. Resultatet er rikere representasjoner, bedre skalerbarhet og evnen til å resonnere over komplekse strukturer mer fleksibelt.

Fra GNNs til Graph Transformers

Den opprinnelige Transformer-modellen, introdusert i den ikoniske artikkelen, Attention Is All You Need, var designet for å modellere relasjoner mellom token i en sekvens. Suksessen ligger i selv-oppmerksomhet, en mekanisme som tillater hver inndata å vurdere hver annen inndata, vektet av lært relevans.

Graph Transformers adapterer denne paradigmen ved å tillate noder å oppmerke seg ikke bare på sine naboer, men på enhver node i grafen, enten gjennom fullt koblet oppmerksomhet eller en hybridtilnærming som balanserer globale og lokale signaler. Utfordringen er å introdusere en forestilling om struktur i en modell designet for ustrukturerte sekvenser.

Graf-spesifikke posisjonskodninger

I motsetning til tekst, har grafer ingen innebygd orden, noe som gjør posisjonskodning, som refererer til teknikker for å injisere strukturell eller lokasjonsbasert informasjon i en modell, ikke-trivielt. Graph Transformers takler dette med ulike metoder:

- Laplacian-eigenvectorer: Avledet fra graf-Laplacian-matrisen, gir disse en spektral innpakning som fanger opp global struktur.

- Tilfeldige turer: Fanger opp sannsynligheten for å gå fra en node til en annen over flere hopp.

- Strukturelle kodninger: Inkluderer avstandsmål, noddegrader eller kanter.

Disse posisjonskodningene, enten spektrale, sannsynlige eller strukturelle, gir Graph Transformers en måte å forstå hvor hver node sitter i den bredere grafen. Denne strukturelle bevisstheten er essensiell for å aktivere oppmerksomhetsmekanismer til å operere meningsfullt over uregelmessige, uordnede data, og til slutt tillater modellen å fange opp relasjoner som ville være usynlige for enklere, rent lokale metoder.

Reelle implementeringer og brukstilfeller

Å bringe Graph Transformers i produksjon krever infrastruktur som kan skaleres til reelle datasize. Biblioteker som PyTorch Geometric (PyG) gjør dette mulig. Bygget på PyTorch, tilbyr PyG en modulær ramme for å implementere GNNs og Graph Transformers over en rekke applikasjoner, fra molekylmodellering til anbefalingssystemer. Det støtter mini-batch-trening på både mange små grafer og enkelte store grafer, med multi-GPU og torch.compile-støtte, noe som gjør det godt egnet for forskning og bedriftsprosesser like.

Disse verktøyene er allerede i bruk i en rekke reelle applikasjoner. I legemiddelforskning hjelper Graph Transformers med å forutsi molekylærens egenskaper ved å modellere atomiske interaksjoner som grafer. I logistikk og forsyningskjedeoptimalisering kan de representere og resonnere over dynamiske nettverk av forsendelser, lagerhus og ruter. E-handelsbedrifter bruker dem til å forbedre anbefalinger ved å forstå produkt-samkjøps- og nettleseratferd som relasjonelle grafer. Og i cybersikkerhet brukes graf-baserte modeller til å detektere anomalier ved å analysere tilgangsmønster, nettverkstopologi og hendelsesekvenser.

I hver av disse settingene er evnen til å lære fra komplekse, sammenkoblede strukturer, uten å avhenge bare av håndlagde egenskaper, vist å være en stor fordel.

Tekniske overveielser

Til tross for deres potensiale, kommer Graph Transformers med reelle ingeniørvalg. Full selv-oppmerksomhet skalerer kvadratisk med antall noder, noe som gjør minne- og beregnings-effektivitet en topprioritet, spesielt for store eller tette grafer. Mange reelle grafer har også rettede kanter, noe som introduserer asymmetrier som kompliserer hvordan strukturell informasjon koderes. Og i praktiske utrullinger er inndata sjelden uniforme: å kombinere graf-strukturert data med tekst, tidsserier eller bilder krever omhyggelige arkitekturvalg og robust dataprosessering.

Disse utfordringene er ikke uovervinnelige, men de krever omhyggelig systemdesign, spesielt når man går fra forskningsprototyper til produksjonsklare modeller.

Hva er neste: LLMs møter grafer

En viktig forskningsretning er integreringen av store språkmodeller (LLMs) med grafstrukturer. Disse hybrid-systemene bruker LLMs til å kode tekstkontekst eller ekstrahere enheter, og deretter grunnlegge denne informasjonen i en graf for resonnement og beslutning.

I biologi har dette aktivert verktøy som AlphaFold. I bedrifts-AI muliggjør det kundesupportsystemer som kombinerer dokumentasjon og atferdsgrafer. Graph Transformers spiller også en økende rolle i å aktivere AI-agenter til å ta smartere, mer handlebare beslutninger ved å tillate dem å resonnere over strukturerte tilstandsrepresentasjoner og prioritere interaksjoner dynamisk. Denne fusjonen hjelper agenter bedre å forstå hierarkiske relasjoner, spore avhengigheter over tid og tilpasse atferden i komplekse miljøer.

Feltet er fortsatt under utvikling, men potensialet er betydelig.

Konklusjon

Graph Transformers er ikke bare den neste iterasjonen av GNNs; de representerer en konvergens av oppmerksomhet, struktur og skalerbarhet. Uansett om du jobber i finans, livsvitenskap eller anbefalingssystemer, er beskjeden klar: din data danner en graf, så dine modeller burde også gjøre det.