Kunstig intelligens

ST-NeRF: Composisjon og redigering for videosyntese

Et kinesisk forskningskonsortium har utviklet teknikker for å bringe redigerings- og komposisjonsfunksjoner til ett av de heteste bilde-synteseforskningsområdene i løpet av det siste året – Neurale Radiance Fields (NeRF). Systemet kalles ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field).

Hva som ser ut som en fysisk kamera-panorama i bildet under er faktisk bare en bruker som ‘blar’ gjennom forskjellige perspektiver på videoinnhold som eksisterer i et 4D-rom. POV er ikke låst til ytelsen til personene avbildet i videoen, hvis bevegelser kan sees fra hvilken som helst del av en 180-graders radius.

Hver fasette innenfor videoen er et diskret fanget element, komponert sammen til en samlet scene som kan utforskes dynamisk.

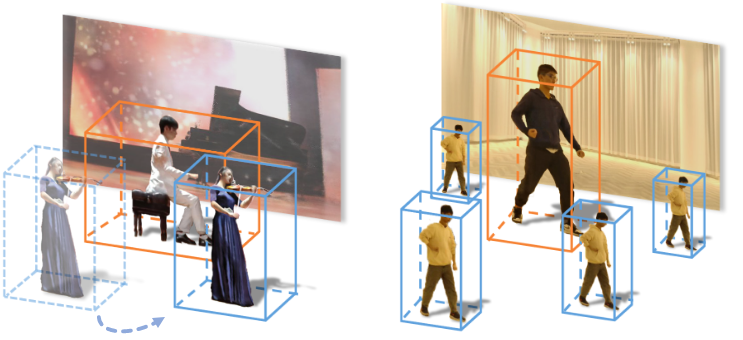

Fasettene kan fritt dupliseres innenfor scenen, eller endres i størrelse:

I tillegg kan den temporale atferden til hver fasette lett endres, sakt ned, kjørt bakover eller manipulert på en rekke måter, åpner veien for filterarkitekturer og en ekstremt høy nivå av tolkbarhet.

To separate NeRF-fasetter kjører med forskjellige hastigheter i samme scene. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Det er ingen behov for å rotoscope utøvere eller omgivelser, eller å få utøvere til å utføre bevegelsene blinde og utenfor konteksten av den ønskede scenen. I stedet blir filmen fanget naturlig via en rekke av 16 video-kameraer som dekker 180 grader:

De tre elementene avbildet ovenfor, de to personene og omgivelsene, er distinkte og konturert bare for illustrative formål. Hver kan byttes ut, og hver kan settes inn i scenen på et tidligere eller senere punkt i deres individuelle fangst-tidslinje.

ST-NeRF er en innovasjon på forskning i Neurale Radiance Fields (NeRF), et maskinlæring-rammeverk hvor flere perspektiver fanget sammen syntetiseres til et navigerbart virtuelt rom ved omfattende trening (selv om enkelt perspektiv-fangst også er en undersektor av NeRF-forskning).

Neurale Radiance Fields fungerer ved å samle flere fangst-perspektiver inn i et enkelt kohrent og navigerbart 3D-rom, med hullene mellom dekning estimert og rendret av et neuralt nettverk. Der video (i stedet for stille bilder) brukes, er rendering-resursene som trengs ofte betydelige. Source: https://www.matthewtancik.com/nerf

Interessen for NeRF har blitt intens i løpet av de siste ni månedene, og en Reddit-vedlikeholdt liste over avledede eller utforskende NeRF-papirer lister nå seksti prosjekter.

Bare noen av de mange avleggerne av det opprinnelige NeRF-papiret. Source: https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

Rimelig Trening

Papiret er et samarbeid mellom forskere ved Shanghai Tech University og DGene Digital Technology, og har blitt akseptert med noe entusiasme at Open Review.

ST-NeRF tilbyr en rekke innovasjoner over tidligere initiativer i ML-avledede navigerbare video-rom. Ikke minst, det oppnår et høyt nivå av realisme med bare 16 kameraer. Selv om Facebooks DyNeRF bruker bare to kameraer mer enn dette, tilbyr det et mye mer begrenset navigerbart bue.

Et eksempel på Facebooks DyNeRF-miljø, med en mer begrenset bevegelsesfelt, og flere kameraer per kvadratfot nødvendig for å rekonstruere scenen. Source: https://neural-3d-video.github.io

Foruten å mangle evnen til å redigere og komponere individuelle fasetter, er DyNeRF særlig dyrt i forhold til beregningsressursene. I kontrast til dette sier de kinesiske forskerne at treningkostnadene for deres data kommer ut til å ligge et sted mellom $900-$3,000, sammenlignet med $30,000 for den mest avanserte video-genereringsmodellen DVDGAN, og intensive systemer som DyNeRF.

Recensenter har også notert at ST-NeRF gjør en stor innovasjon i å skille prosessen med å lære bevegelse fra prosessen med bilde-syntese. Denne separasjonen er det som muliggjør redigering og komposisjon, med tidligere tilnærminger begrensede og lineære i sammenligning.

Selv om 16 kameraer er et svært begrenset array for en så full halvsirkel av utsikt, håper forskerne å kutte dette tallet ned videre i senere arbeid gjennom bruk av proxy-forhåndsscannede statiske bakgrunner, og mer data-drevne scenemodelleringstilnærminger. De håper også å inkorporere re-lysbelysningsevner, en ny innovasjon i NeRF-forskning.

Å håndtere Begrensninger av ST-NeRF

I sammenheng med akademiske CS-papirer som tenderer til å kaste bort den faktiske brukbarheten av et nytt system i en kast-til-slutt-av-teksten, er selv begrensningene som forskerne anerkjenner for ST-NeRF usedvanlige.

De observerer at systemet ikke kan individuelt rendre ut bestemte objekter i en scene, fordi personene i filmen er segmentert i individuelle enheter via et system designet for å gjenkjenne mennesker og ikke objekter – et problem som ser ut til å være lett løst med YOLO og lignende rammer, med det hardeste arbeidet med å trekke ut menneskevideo allerede utført.

Selv om forskerne noterer at det for tiden ikke er mulig å generere slow-motion, ser det ut til å være lite som hindrer implementeringen av dette ved hjelp av eksisterende innovasjoner i ramme-interpolasjon som DAIN og RIFE.

Som med alle NeRF-implementeringer, og i mange andre sektorer av datavisjonsforskning, kan ST-NeRF feile i tilfeller av alvorlig okklusjon, hvor subjektet midlertidig skjules av en annen person eller et objekt, og kan være vanskelig å kontinuerlig spore eller å gjenoppnå nøyaktig etterpå. Som andre steder, kan denne vanskeligheten måtte vente på oppstrømsløsninger. I mellomtiden, innrømmer forskerne at manuell inngripen er nødvendig i disse okkluderte rammer.

Til slutt observerer forskerne at de menneskelige segmenteringsprosedyrene for tiden avhenger av fargeforskjeller, som kan føre til uforvollte sammenføyning av to personer i én segment-blokk – en hindring ikke begrenset til ST-NeRF, men innebygget i biblioteket som brukes, og som kanskje kan løses av optisk flytanalyse og andre fremvoksende teknikker.

Publisert først 7. mai 2021.