Kunstig intelligens

Nevral gjengivelse: NeRF tar en tur i frisk luft

Et samarbeid mellom Google Research og Harvard University har utviklet en ny metode for å lage 360-graders nevrale video av komplette scener ved hjelp av Nevrale utstrålingsfelt (NeRF). Den nye tilnærmingen tar NeRF et skritt nærmere tilfeldig abstrakt bruk i ethvert miljø, uten å være begrenset til bordmodeller or lukkede interiørscenarier.

Se slutten av artikkelen for full video. Kilde: https://www.youtube.com/watch?v=YStDS2-Ln1s

Mip-NeRF 360 kan håndtere utvidede bakgrunner og «uendelige» objekter som himmelen, fordi den, i motsetning til de fleste tidligere iterasjoner, setter grenser for hvordan lysstråler tolkes, og skaper oppmerksomhetsgrenser som rasjonaliserer ellers lange treningstider. Se den nye medfølgende videoen som er innebygd på slutten av denne artikkelen for flere eksempler og et utvidet innblikk i prosessen.

Ocuco nytt papir har tittelen Mip-NeRF 360: Ubegrensede anti-aliasede nevrale utstrålingsfelt, og ledes av Senior Staff Research Scientist ved Google Research Jon Barron.

For å forstå gjennombruddet er det nødvendig å ha en grunnleggende forståelse av hvordan bildesyntese basert på nevral utstrålingsfelt fungerer.

Hva er NeRF?

Det er problematisk å beskrive et NeRF-nettverk i form av en «video», ettersom det er nærmere et fullstendig 3D-realisert, men AI-baserte virtuelt miljø, der flere synspunkter fra enkeltbilder (inkludert videorammer) brukes til å sette sammen en scene som teknisk sett bare eksisterer i det latente rommet til en maskinlæringsalgoritme – men som et ekstraordinært antall synspunkter og videoer kan trekkes ut etter ønske. .

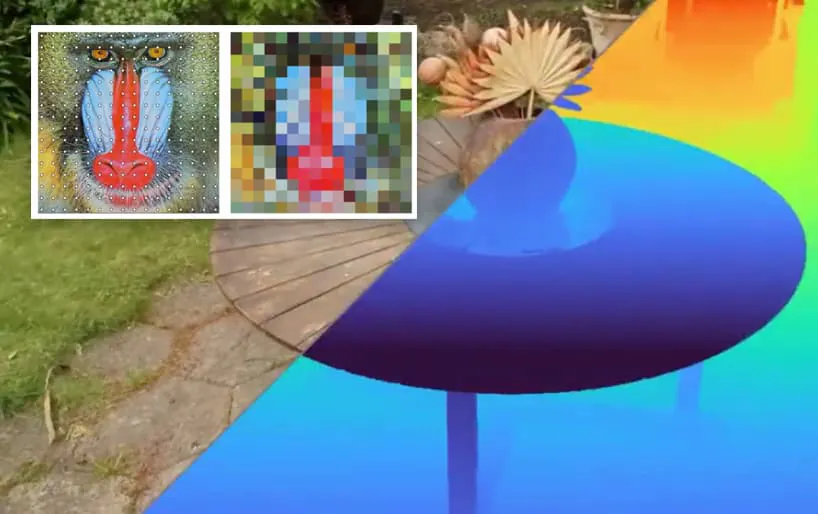

En skildring av de flere kamerafangstpunktene som gir dataene som NeRF setter sammen til en nevral scene (bildet til høyre).

Informasjon hentet fra de bidragende bildene trenes inn i en matrise som ligner på en tradisjonell voxel rutenett i CGI-arbeidsflyter, ved at hvert punkt i 3D-rommet ender opp med en verdi, noe som gjør scenen navigerbar.

En tradisjonell voxelmatrise plasserer pikselinformasjon (som normalt eksisterer i en 2D-kontekst, for eksempel pikselnettet til en JPEG-fil) i et tredimensjonalt rom. Kilde: ResearchGate

Etter å ha beregnet mellomrommet mellom bildene (om nødvendig), blir banen til hver mulige piksel i hvert bidragende bilde effektivt «strålesporet» og tilordnet en fargeverdi, inkludert en gjennomsiktighetsverdi (uten hvilken den nevrale matrisen ville være fullstendig ugjennomsiktig eller helt tom).

Som voxel grids, og I motsetning til CGI-basert 3D-koordinatrom, det «interiør» av et «lukket» objekt, eksisterer ikke i en NeRF-matrise. Du kan åpne et CGI-trommesett og se inni det, hvis du vil; men når det gjelder NeRF, slutter trommesettets eksistens når opasitetsverdien til overflaten er lik '1'.

En bredere visning av en piksel

Mip-NeRF 360 er en utvidelse av forskning fra mars 2021, som effektivt introduserte effektiv anti-aliasing til NeRF uten uttømmende supersampling.

NeRF beregner tradisjonelt bare én pikselbane, som er tilbøyelig til å produsere den typen «jaggies» som preget tidlige internettbildeformater, samt tidligere spillsystemer. Disse taggete kantene ble løst ved hjelp av forskjellige metoder, vanligvis med å prøve å prøve tilstøtende piksler og finne en gjennomsnittlig representasjon.

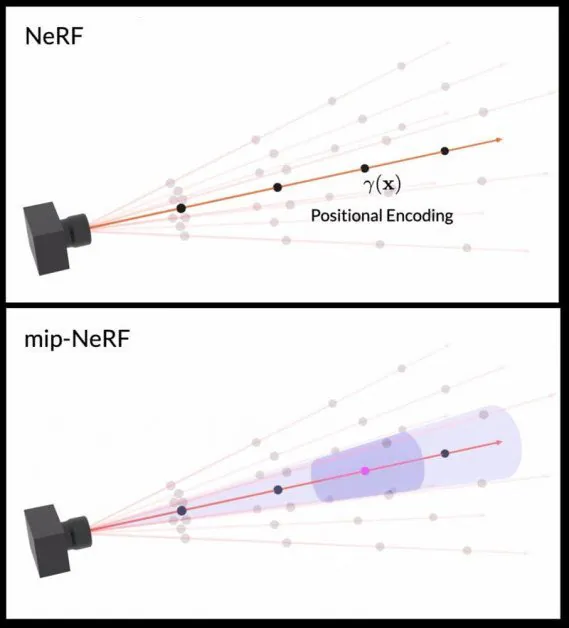

Fordi tradisjonell NeRF bare prøver den ene pikselbanen, introduserte Mip-NeRF et «konisk» nedslagsområde, som en bredstrålefakkel, som gir nok informasjon om ved siden av piksler for å produsere økonomisk antialiasing med forbedrede detaljer.

Det koniske kjegleoppsamlingsområdet som Mip-NeRF bruker er delt opp i koniske stumper (nederste bilde), som er ytterligere «uskarpe» for å lage vage gaussiske rom som kan brukes til å beregne nøyaktigheten og aliasing av en piksel. Kilde: https://www.youtube.com/watch?v=EpH175PY1A0

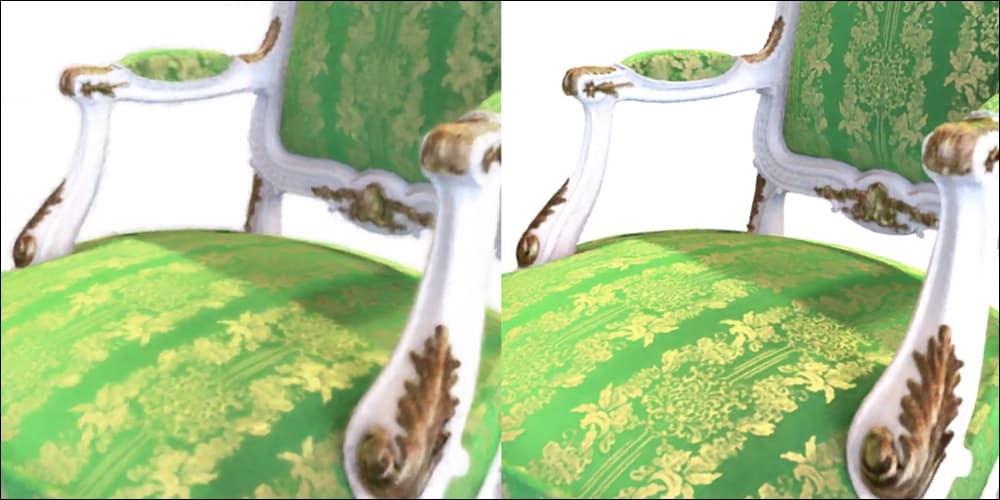

Forbedringen i forhold til en standard NeRF-implementering var bemerkelsesverdig:

Mip-NeRF (til høyre), utgitt i mars 2021, gir forbedrede detaljer gjennom en mer omfattende, men økonomisk aliasing-pipeline, i stedet for bare å «uskarpe» piksler for å unngå hakkete kanter. Kilde: https://jonbarron.info/mipnerf/

NeRF Ubundet

Mars-avisen etterlot tre problemer uløst med hensyn til å bruke Mip-NeRF i ubegrensede miljøer som kan inkludere svært fjerne objekter, inkludert himmel. Det nye papiret løser dette ved å bruke en Kalman-stil varp til Mip-NeRF Gausserne.

For det andre krever større scener større prosesseringskraft og lengre treningstider, noe Mip-NeRF 360 løser ved å «destillere» scenegeometri med et lite «forslag». flerlags perceptron (MLP), som forhåndsbegrenser geometrien forutsagt av en stor standard NeRF MLP. Dette øker treningen med en faktor tre.

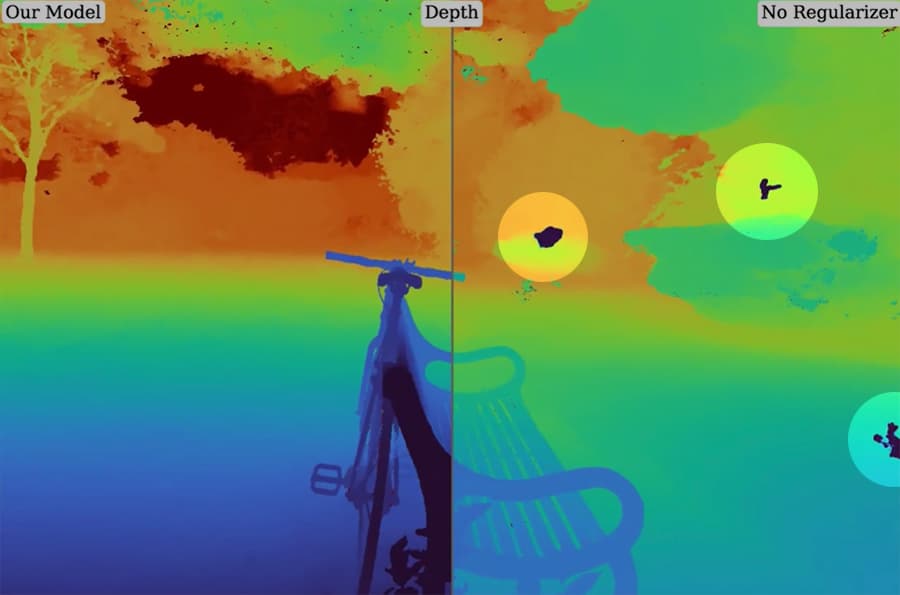

Til slutt har større scener en tendens til å gjøre diskretisering av den tolkede geometrien tvetydig, noe som resulterer i den typen artefakter spillere kan være kjent med når spillutdata «river». Den nye artikkelen tar for seg dette ved å lage en ny regulariserer for Mip-NeRF-stråleintervaller.

Til høyre ser vi uønskede gjenstander i Mip-NeRF på grunn av vanskeligheten med å avgrense en så stor scene. Til venstre ser vi at den nye regularizeren har optimalisert scenen godt nok til å fjerne disse forstyrrelsene.

For å finne ut mer om det nye papiret, sjekk ut videoen nedenfor, og også Mars 2021 videointroduksjon til Mip-NeRF. Du kan også finne ut mer om NeRF-forskning ved å sjekke ut vår dekning så langt.

Opprinnelig publisert 25. november 2021

21. desember 2021, 12:25 – Erstattet død video. – MA