Kunstig intelligens

Multimodal AI utvikler seg når ChatGPT får syn med GPT-4V(ision)

I den pågående innsatsen for å gjøre AI mer lik mennesker, har OpenAI’s GPT-modeller kontinuerlig presset grensene. GPT-4 kan nå godta instruksjoner av både tekst og bilder.

Multimodalitet i generativ AI betegner en modells evne til å produsere varierende utdata som tekst, bilder eller lyd basert på inndata. Disse modellene, trent på spesifikke data, lærer underliggende mønster for å generere lignende ny data, og beriker AI-applikasjoner.

Seneste fremskritt i multimodal AI

Et nylig bemerkelsesverdig sprang i dette feltet er å se med integreringen av DALL-E 3 i ChatGPT, en betydelig oppgradering i OpenAI’s tekst-til-bilde-teknologi. Denne blandingen gjør det mulig for en jevnere interaksjon hvor ChatGPT hjelper med å lage nøyaktige instruksjoner for DALL-E 3, og omdanner brukerideer til levende AI-generert kunst. Så, mens brukerne kan interagereekte med DALL-E 3, gjør ChatGPT-prosessen med å lage AI-kunst mye mer brukervennlig.

Se mer om DALL-E 3 og dens integrasjon med ChatGPT her. Denne samarbeidet viser ikke bare fremgangen i multimodal AI, men gjør også AI-kunstskapelse en lett sak for brukerne.

Google’s helse på den andre siden introduserte Med-PaLM M i juni dette året. Det er en multimodal generativ modell dyktig i å kode og tolke diverse biomedisinske data. Dette ble oppnådd ved å finjustere PaLM-E, en språkmodell, for å møte medisinske domener ved hjelp av en åpen kilde-benchmark, MultiMedBench. Denne benchmarken består av over 1 million eksempler over 7 biomedisinske datatyper og 14 oppgaver som medisinske spørsmål og generering av radiologirapporter.

Forskjellige industrier tar i bruk innovative multimodale AI-verktøy for å drive forretningsutvikling, strømlinje operasjoner og heve kundeengasjement. Fremgang i tale-, video- og tekst-AI-egenskaper driver multimodal AI’s vekst.

Bedrifter søker etter multimodale AI-applikasjoner i stand til å omgjøre forretningsmodeller og prosesser, åpner vekstmuligheter over hele den generative AI-økosystemet, fra dataverktøy til nye AI-applikasjoner.

Etter lanseringen av GPT-4 i mars, observerte noen brukere en nedgang i svarkvaliteten over tid, en bekymring som ble gjentatt av bemerkelsesverdige utviklere og på OpenAI’s forum. Først avvist av OpenAI, en senere studie bekreftet problemet. Den avdekket en nedgang i GPT-4’s nøyaktighet fra 97,6% til 2,4% mellom mars og juni, og indikerte en nedgang i svarkvalitet med påfølgende modelloppdateringer.

Hypeen rundt Open AI’s ChatGPT er tilbake nå. Den kommer nå med en visjonfunksjon GPT-4V, som lar brukerne få GPT-4 til å analysere bilder gitt av dem. Dette er den nyeste funksjonen som er åpnet for brukerne.

Tillegging av bildeanalyse til store språkmodeller (LLM) som GPT-4 sees på av noen som et stort skritt fremover i AI-forskning og utvikling. Denne type multimodal LLM åpner opp nye muligheter, tar språkmodeller utenfor tekst til å tilby nye grensesnitt og løse nye typer oppgaver, og skaper nye erfaringer for brukerne.

Treningen av GPT-4V ble fullført i 2022, med tidlig tilgang rullet ut i mars 2023. Den visuelle funksjonen i GPT-4V er drevet av GPT-4-teknologi. Treningprosessen forble den samme. Først ble modellen trent til å forutsi neste ord i en tekst ved hjelp av en massiv datasett av både tekst og bilder fra forskjellige kilder, inkludert internettet.

Senere ble den finjustert med mer data, ved å bruke en metode kalt forsterkning av læring fra menneskelig tilbakemelding (RLHF), for å generere utdata som mennesker foretrakk.

GPT-4 Visjon Mekanismer

GPT-4’s bemerkelsesverdige visjon-språk-egenskaper, selv om de er imponerende, har underliggende metoder som forblir på overflaten.

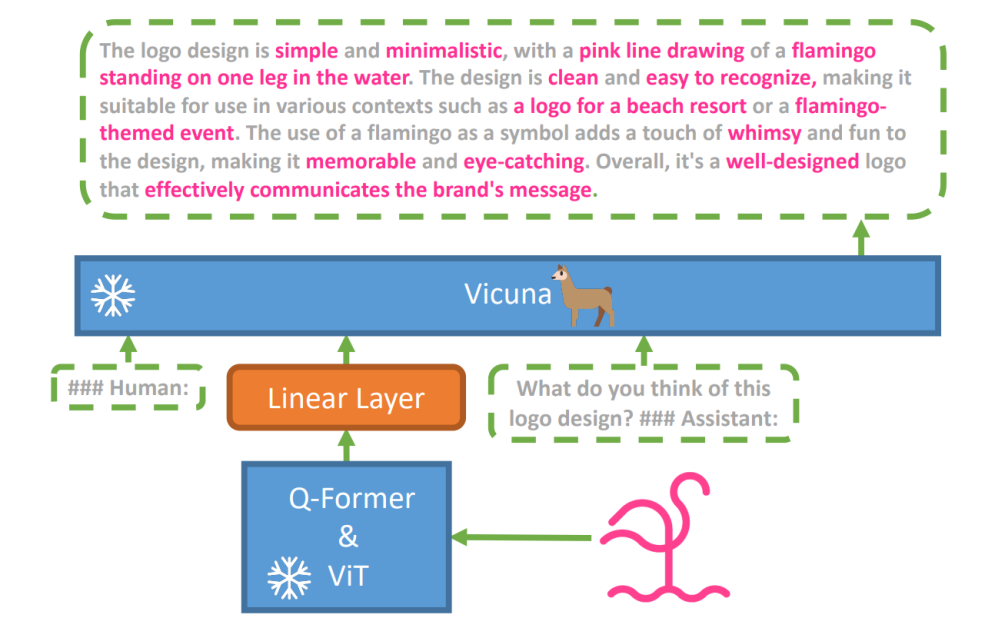

For å utforske denne hypotesen, ble en ny visjon-språk-modell, MiniGPT-4, introdusert, som benytter en avansert LLM kalt Vicuna. Denne modellen bruker en visjon-encoder med forhånds-trente komponenter for visuell persepsjon, som sammenfaller med kodifiserte visuelle funksjoner med Vicuna-språkmodellen gjennom ett enkelt projeksjonslag. Arkitekturen til MiniGPT-4 er enkel, men effektiv, med fokus på å sammenfalle visuelle og språkfunksjoner for å forbedre visuell samtale-egenskaper.

MiniGPT-4’s arkitektur inkluderer en visjon-encoder med forhånds-trent ViT og Q-Former, ett enkelt lineært projeksjonslag, og en avansert Vicuna stor språkmodell.

Trenden med autoregressive språkmodeller i visjon-språk-oppgaver har også vokst, og utnytter kryss-modalt overføring for å dele kunnskap mellom språk og multimodale domener.

MiniGPT-4 broer over visuelle og språkdomener ved å sammenfalle visuell informasjon fra en forhånds-trent visjon-encoder med en avansert LLM. Modellen bruker Vicuna som språk-dekoder og følger en to-trinns treningstilnærming. Først blir den trent på en stor datasett av bilde-tekst-par for å tilegne seg visjon-språk-kunnskap, fulgt av finjustering på en mindre, høykvalitetsdatasett for å forbedre genererings-pålitelighet og brukervennlighet.

For å forbedre naturlighet og brukervennlighet av generert språk i MiniGPT-4, utviklet forskerne en to-trinns sammenfallingsprosess, som adresserte mangelen på adekvate visjon-språk-sammenfallingsdatasett. De kurerte en spesialisert datasett for dette formålet.

Først genererte modellen detaljerte beskrivelser av inndata-bilder, og forbedret detaljene ved å bruke en samtale-prompt som sammenfalt med Vicuna-språkmodellens format. Denne fasen hadde som mål å generere mer omfattende bilde-beskrivelser.

Initial bilde-beskrivelses-prompt:

###Human: <Img><ImageFeature></Img>Beskriv dette bildet i detalj. Gi så mange detaljer som mulig. Si alt du ser. ###Assistant:

For, ble eventuelle inkonsistenser eller feil i de genererte beskrivelsene korrigert ved hjelp av ChatGPT, fulgt av manuell verifisering for å sikre høy kvalitet.

Andre-trinns finjusterings-prompt:

###Human: <Img><ImageFeature></Img><Instruction>###Assistant:

Denne utforskningen åpner et vindu for å forstå mekanismene til multimodal generativ AI som GPT-4, og kaster lys over hvordan visjon og språk-modaler kan effektivt integreres for å generere koherente og kontekstuell rike utdata.

Utforsk GPT-4 Visjon

Bestemme bilde-opphav med ChatGPT

GPT-4 Visjon forbedrer ChatGPT’s evne til å analysere bilder og peke ut deres geografiske opphav. Denne funksjonen overfører brukerinteraksjoner fra bare tekst til en blanding av tekst og visuelle elementer, og blir et nyttig verktøy for de som er nysgjerrige på forskjellige steder gjennom bilde-data.

Komplekse matematiske konsepter

GPT-4 Visjon utmerker seg i å dykke ned i komplekse matematiske ideer ved å analysere grafiske eller håndskrevne uttrykk. Denne funksjonen fungerer som et nyttig verktøy for personer som søker å løse intrikate matematiske problemer, og markerer GPT-4 Visjon som en bemerkelsesverdig hjelp i utdannings- og akademiske felt.

Omvandling av håndskrevet inndata til LaTeX-koder

En av GPT-4V’s bemerkelsesverdige evner er dens kapasitet til å oversette håndskrevne inndata til LaTeX-koder. Denne funksjonen er en velsignelse for forskere, akademikere og studenter som ofte må omgjøre håndskrevne matematiske uttrykk eller annen teknisk informasjon til en digital format. Omformingen fra håndskrevet til LaTeX utvider horisonten av dokument-digitalisering og forenkler den tekniske skriveprosessen.

Ekstrahering av tabell-detaler

GPT-4V viser ferdighet i å ekstrahere detaljer fra tabeller og besvare relaterte spørsmål, en vital verdi i. Brukere kan bruke GPT-4V til å si gjennom tabeller, samle inn nøkkel-innsikt og løse spørsmål, og gjør det til et robust verktøy for og andre fagfolk.

Mens resultatet ikke helt matcher min opprinnelige visjon, her er resultatet jeg oppnådde.

Begrensninger og feil i GPT-4V(ision)

For å analysere GPT-4V, gjennomførte Open AI team kvalitative og kvantitative vurderinger. Kvalitative vurderinger inkluderte interne tester og eksterne ekspert-vurderinger, mens kvantitative vurderinger målte modell-nekt og nøyaktighet i forskjellige scenarier som identifisering av skadelig innhold, demografisk gjenkjenning, personvernsproblemer, geolokalisering, cybersikkerhet og multimodale fengsler.

Likevel er modellen ikke perfekt.

Den rapporten fremhever begrensninger i GPT-4V, som feilaktige slutninger og manglende tekst eller tegn i bilder. Den kan hallucinere eller oppfinne fakta. Spesielt er den ikke egnet for å identifisere farlige stoffer i bilder, og ofte misidentifiserer dem.

I medisinske bilder kan GPT-4V gi inkonsistente svar og mangler kunnskap om standard praksis, noe som kan føre til potensielle misdiagnoser.

Upålitelig ytelse for medisinske formål (Kilde)

Den mangler også å forstå nyansene til visse hat-symbolet og kan generere upassende innhold basert på visuelle inndata. OpenAI råder mot å bruke GPT-4V for kritiske tolkninger, spesielt i medisinske eller sensitive sammenhenger.

Oppsummering

Laget med Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

Ankomsten av GPT-4 Visjon (GPT-4V) bringer med seg en rekke nye muligheter og nye utfordringer. Før lanseringen, har det vært mye arbeid med å sikre at risikoene, spesielt når det gjelder bilder av mennesker, er godt undersøkt og redusert. Det er imponerende å se hvordan GPT-4V har fremmet seg, og viser mye løfte i vanskelige områder som medisin og vitenskap.

Nå er det noen store spørsmål på bordet. For eksempel, bør disse modellene være i stand til å identifisere berømte personer fra bilder? Bør de gjetting en persons kjønn, rase eller følelser fra et bilde? Og, bør det være spesielle tilpasninger for å hjelpe synshemmede personer? Disse spørsmålene åpner opp en boks med ormene om personvern, rettferdighet og hvordan AI bør inngå i våre liv, noe som er noe alle bør ha et ord med og om.