Prompt engineering

ChatGPT & Avansert Prompt Engineering: Driver AI-Evolusjonen

OpenAI har vært instrumental i utviklingen av revolusjonære verktøy som OpenAI Gym, designet for å trene forsterkningsalgoritmer, og GPT-n-modeller. Spotlighten er også på DALL-E, en AI-modell som lager bilder fra tekstlige innputt. En slik modell som har fått betydelig oppmerksomhet, er OpenAI sin ChatGPT, en strålende eksemplar i området Large Language Models.

GPT-4: Prompt Engineering

ChatGPT har transformert chatbot-landskapet, og tilbyr menneske-lignende svar på brukerens innputt og utvider sine anvendelser over domener – fra programvareutvikling og testing til forretningskommunikasjon, og selv skapelse av poesi.

I hendene på bedrifter og enkeltpersoner, kan GPT-4, for eksempel, fungere som en utømmelig kunnskapsreserv, dyktig i emner som spenner fra matematikk og biologi til juridiske studier. Slike sofistikerte og tilgjengelige AI-modeller er i stand til å omdefinere fremtiden for arbeid, læring og kreativitet.

Generative modeller som GPT-4 kan produsere ny data basert på eksisterende innputt. Denne distinkte attributen lar dem utføre diverse oppgaver, inkludert generering av tekst, bilder, musikk og video.

I sammenheng med ChatGPT og OpenAI-modeller, er en prompt innputt som brukerne gir til modellene, vanligvis i form av tekst. Prompts tjener som primær middel for å kontrollere utgangen generert av disse modellene, gjør dem avgjørende for suksessfulle og relevante samtaler.

Promptkvalitetens Innvirkning

Bruk av godt definerte prompts er nøkkel til å engasjere i nyttige og meningsfulle samtaler med AI-systemer. Dårlig definerte prompts kan resultere i utgang som ikke er nyttig for brukeren og kan til og med føre til misvisende innhold.

For å demonstrere innvirkningen av promptkvalitet, la oss sammenligne to forskjellige prompts gitt til ChatGPT. Den første prompten, dårlig definert og antar forhåndskunnskap, genererer et potensielt unyttig svar for brukeren. På den andre siden, gir den andre prompten mer kontekst og eksempler, sikrer et mer relevant og forståelig svar.

Prompt 1: “Fortell meg om Convolutional Neural Networks.”

Response 1: “Convolutional Neural Networks (CNNs) er multi-lag perceptron-nettverk som består av fullstendig koblet lag og pooling-lag. De er vanligvis brukt i bilde-gjenkjenning-oppgaver. Prosessen innebærer å bruke filtre på innputt-bilder og nedskalere dem ved hjelp av pooling-lag.”

Prompt 2: “Jeg ønsker å lære om Convolutional Neural Networks, men jeg har ingen forhåndskunnskap om kunstig intelligens. Kan du vennligst gi en nybegynner-vennlig forklaring og et eksempel på hvordan CNNs brukes i bilde-gjenkjenning?”

Response 2: “Convolutional Neural Networks (CNNs) er en type neuralnettverk primært brukt for bilde-gjenkjenning-oppgaver. I motsetning til andre neuralnettverk, utnytter de konvolusjonslag og pooling-lag for å prosessere bilder. Forestill deg at du har et bilde av en katt. CNNs kan identifisere forskjellige trekk i bildet, som for eksempel pels, ører og hale, ved å bruke filtre og nedskalere bildet ved hjelp av pooling-lag. Denne prosessen gjør CNNs svært effektive for å gjenkjenne objekter i bilder.”

Ved å sammenligne de to svarene, er det tydelig at en godt definert prompt fører til et mer relevant og bruker-vennlig svar. Prompt-design og -ingeniørkunst er voksende disipliner som har til hensikt å optimalisere utgangskvaliteten på AI-modeller som ChatGPT.

I de følgende avsnittene av denne artikkelen, vil vi dykke ned i riket av avanserte metoder rettet mot å forfine Large Language Models (LLMs), som prompt-ingeniørteknikker og taktikker. Disse inkluderer few-shot learning, ReAct, chain-of-thought, RAG og mer.

Avanserte Ingeniørteknikker

Før vi går videre, er det viktig å forstå et nøkkelproblem med LLMs, referert til som ‘hallusinasjon’. I sammenheng med LLMs, betyr ‘hallusinasjon’ tendensen hos disse modellene til å generere utgang som kan synes rimelig, men ikke er rotfestet i faktisk virkelighet eller den gitt kontekst.

Dette problemet ble tydelig fremhevet i en nylig rettssak hvor en forsvarer brukte ChatGPT for juridisk forskning. AI-verktøyet, som feilet på grunn av sitt hallusinasjonsproblem, siterte ikke-eksisterende rettslige saker. Dette feilet hadde betydelige konsekvenser, og førte til forvirring og undergravde troverdigheten under prosedyrene. Dette hendelsen tjener som en tydelig påminnelse om det presserende behovet for å løse problemet med ‘hallusinasjon’ i AI-systemer.

Vår utforskning av prompt-ingeniørteknikker har til hensikt å forbedre disse aspektene av LLMs. Ved å forbedre deres effektivitet og sikkerhet, baner vi vei for innovative anvendelser som informasjonseksport. Videre åpner det dører for å integrere LLMs med eksterne verktøy og datakilder, og utvider rekken av deres potensielle anvendelser.

Zero og Few-Shot Learning: Optimalisering med Eksempler

Generative Pretrained Transformers (GPT-3) markerer et viktig skille i utviklingen av Generative AI-modeller, da det introduserte konseptet ‘few-shot learning‘. Denne metoden var en game-changer på grunn av sin evne til å fungere effektivt uten behov for omfattende finjustering. GPT-3-rammeverket diskuteres i papiret, “Language Models are Few Shot Learners” hvor forfatterne demonstrerer hvordan modellen utmerker seg over diverse anvendelser uten å nødvendigvis kreve tilpassede datasett eller kode.

I motsetning til finjustering, som krever kontinuerlig innsats for å løse ulike anvendelser, demonstrerer few-shot-modeller enklere tilpasning til en bredere rekke av anvendelser. Mens finjustering kan gi robuste løsninger i noen tilfeller, kan det være dyrt i størrelse, og gjør bruken av few-shot-modeller en mer praktisk tilnærming, spesielt når den kombineres med prompt-ingeniørkunst.

Forestall deg at du prøver å oversette engelsk til fransk. I few-shot learning, ville du gi GPT-3 noen oversettelseseksempler som “sea otter -> loutre de mer”. GPT-3, som er en avansert modell, er deretter i stand til å fortsette å gi nøyaktige oversettelser. I zero-shot learning, ville du ikke gi noen eksempler, og GPT-3 ville likevel være i stand til å oversette engelsk til fransk effektivt.

Begrepet ‘few-shot learning’ kommer fra ideen om at modellen gis en begrenset mengde eksempler å ‘lære’ fra. Det er viktig å merke seg at ‘lære’ i denne sammenhengen ikke involverer oppdatering av modellens parametre eller vekter, men snarere påvirker modellens ytelse.

Zero-shot learning tar dette konseptet et skritt videre. I zero-shot learning, gis ingen eksempler på oppgavefullføring i modellen. Modellen forventes å fungere godt basert på sin initielle trening, og gjør denne metoden ideell for åpen-domen-spørsmål som ChatGPT.

I mange tilfeller kan en modell dyktig i zero-shot learning fungere godt når den gis få-shot eller sogar enkelt-shot eksempler. Denne evnen til å skifte mellom zero, enkelt og få-shot læringsscenarier understreker modellens tilpasningsevne, og forbedrer deres potensielle anvendelser over ulike domener.

Zero-shot learning-metoder blir stadig mer vanlige. Disse metodene kjennetegnes av deres evne til å gjenkjenne objekter som ikke ble sett under trening. Her er et praktisk eksempel på en Few-Shot Prompt:

"Oversett følgende engelske fraser til fransk:

'sea otter' oversettes til 'loutre de mer'

'sky' oversettes til 'ciel'

'Hva oversettes 'cloud' til på fransk?'"

Ved å gi modellen noen eksempler og deretter stille et spørsmål, kan vi effektivt guide modellen til å generere det ønskede utgangen. I dette tilfellet ville GPT-3 sannsynligvis korrekt oversette ‘cloud’ til ‘nuage’ på fransk.

Vi vil dykke dyptere inn i de ulike nuansene av prompt-ingeniørteknikker og deres essensielle rolle i å optimalisere modellens ytelse under inferens. Vi vil også se på hvordan det kan brukes effektivt til å skape kostnadseffektive og skalerbare løsninger over en bred rekke av anvendelser.

Etter hvert som vi utforsker kompleksiteten av prompt-ingeniørteknikker i GPT-modeller, er det viktig å understreke vår siste post ‘Essential Guide to Prompt Engineering in ChatGPT‘. Denne guiden gir innsikt i strategier for å instruere AI-modeller effektivt over en rekke av anvendelser.

I våre tidligere diskusjoner, gikk vi inn i grunnleggende prompt-metoder for store språkmodeller (LLMs) som zero-shot og few-shot learning, samt instruksjons-prompting. Mestring av disse teknikkene er avgjørende for å navigere de mer komplekse utfordringene av prompt-ingeniørkunst som vi vil utforske her.

Few-shot learning kan være begrenset på grunn av den begrensede kontekst-vinduet til de fleste LLMs. I tillegg, uten de riktige sikkerhetstiltakene, kan LLMs bli misledt til å levere potensielt skadelig utgang. Pluss, mange modeller sliter med årsaks-oppgaver eller å følge multi-trinns instruksjoner.

Gitt disse begrensningene, ligger utfordringen i å utnytte LLMs til å løse komplekse oppgaver. En åpenbar løsning kan være å utvikle mer avanserte LLMs eller forbedre eksisterende, men det kan innebære betydelig innsats. Så, spørsmålet oppstår: hvordan kan vi optimalisere nåværende modeller for bedre problemløsning?

Like fascinerende er utforskningen av hvordan denne teknikken grenser til kreative anvendelser i Unite AI’s ‘Mastering AI Art: A Concise Guide to Midjourney and Prompt Engineering‘ som beskriver hvordan fusjonen av kunst og AI kan resultere i imponerende kunst.

Chain-of-thought Prompting

Chain-of-thought prompting utnytter de innebygde auto-regressive egenskapene til store språkmodeller (LLMs), som utmerker seg i å forutsi det neste ordet i en gitt sekvens. Ved å prompte en modell til å forklare sin tenkeprosess, induserer det en mer grundig og metodelig generering av ideer, som tenderer til å sammenfalle med nøyaktig informasjon. Denne sammenfallet stammer fra modellens tendens til å prosessere og levere informasjon på en tenkfylt og ordnet måte, lik en menneskelig ekspert som fører en lytter gjennom et komplekst konsept. En enkel uttalelse som “gå meg gjennom trinn for trinn hvordan…” er ofte nok til å utløse denne mer verbale og detaljerte utgangen.

Zero-shot Chain-of-thought Prompting

Mens konvensjonell CoT-prompting krever forhåndstrening med demonstrasjoner, er et fremvoksende område zero-shot CoT-prompting. Denne tilnærmingen, introdusert av Kojima et al. (2022), innovativt legger til frasen “La oss tenke trinn for trinn” til den opprinnelige prompten.

La oss skape en avansert prompt hvor ChatGPT er oppgitt å sammenfatte nøkkel-punkter fra AI- og NLP-forskningspapirer.

I denne demonstrasjonen, vil vi bruke modellens evne til å forstå og sammenfatte kompleks informasjon fra akademiske tekster. Ved å bruke few-shot learning-tilnærmingen, la oss lære ChatGPT til å sammenfatte nøkkel-funn fra AI- og NLP-forskningspapirer:

1. Papirtittel: "Attention Is All You Need"

Nøkkel-punkt: Introduserte transformer-modellen, og understreket viktigheten av årsaks-mekanismer over rekurrerende lag for sekvens-transduksjonsoppgaver.

2. Papirtittel: "BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding"

Nøkkel-punkt: Introduserte BERT, og viste effekten av å forhåndstreine dypt bidireksjonale modeller, og oppnådde state-of-the-art-resultater på ulike NLP-oppgaver.

Nå, med konteksten av disse eksemplene, sammenfatte nøkkel-funnene fra følgende papir:

Papirtittel: "Prompt Engineering in Large Language Models: An Examination"

Denne prompten ikke bare beholder en tydelig tenke-prosess, men også utnytter en few-shot learning-tilnærming til å guide modellen. Den knytter seg til våre nøkkelord ved å fokusere på AI- og NLP-domener, og spesifikt å oppgi ChatGPT til å utføre en kompleks operasjon som er relatert til prompt-ingeniørkunst: å sammenfatte forskningspapirer.

ReAct Prompt

ReAct, eller “Reason and Act”, ble introdusert av Google i papiret “ReAct: Synergizing Reasoning and Acting in Language Models“, og revolusjonerte hvordan språkmodeller interagerer med en oppgave, og prompter modellen til å dynamisk generere både verbale årsaks-spore og oppgave-spesifikke handlinger.

Forestall deg en menneskelig sjef i kjøkkenet: de utfører ikke bare en rekke handlinger (kutter grønnsaker, koker vann, rører ingredienser), men også engasjerer i verbale årsaks-prosesser (“nå som grønnsakene er hakket, bør jeg putte gryten på komfyr”). Denne pågående mentale dialogen hjelper i å strategisere prosessen, tilpasse seg plutselige endringer (“jeg er ute av olivenolje, jeg vil bruke smør i stedet”), og huske rekken av oppgaver. ReAct etterligner denne menneskelige evnen, og muliggjør modellen til å raskt lære nye oppgaver og ta robuste beslutninger, som en menneskelig ville under nye eller usikre omstendigheter.

ReAct kan håndtere hallusinasjon, et vanlig problem med Chain-of-Thought (CoT)-systemer. CoT, selv om det er en effektiv teknikk, mangler evnen til å interagere med den ytre verden, noe som potensielt kan føre til faktiske hallusinasjoner og feil-spredning. ReAct kompenserer for dette ved å grense til eksterne informasjonskilder. Denne interaksjonen tillater systemet ikke bare å validere sin årsak, men også å oppdatere sin kunnskap basert på den siste informasjonen fra den ytre verden.

Den grunnleggende arbeidingsmåten til ReAct kan forklares gjennom et eksempel fra HotpotQA, en oppgave som krever høyere årsaks-prosesser. Når modellen mottar et spørsmål, bryter den ned spørsmålet i håndterbare deler og skaper en plan for handling. Modellen genererer en årsaks-sporing (tanke) og identifiserer en relevant handling. Den kan bestemme å søke etter informasjon om Apple Remote på en ekstern kilde, som Wikipedia (handling), og oppdaterer sin forståelse basert på den mottatte informasjonen (observasjon). Gjennom flere tanke-handling-observasjons-trinn, kan ReAct hente informasjon for å støtte sin årsak, mens den også forbedrer hva den trenger å hente neste.

Merk:

HotpotQA er en datasett, avledet fra Wikipedia, bestående av 113k spørsmål-svar-par, designet for å trene AI-systemer i komplekse årsaks-prosesser, da spørsmålene nødvendigvis krever årsaks-prosesser over flere dokumenter for å svare. På den andre siden, CommonsenseQA 2.0, konstruert gjennom gamification, inkluderer 14 343 ja/nei-spørsmål og er designet for å utfordre AI sin forståelse av common sense, da spørsmålene er bevisst konstruert for å mislede AI-modeller.

Prosessene kunne se ut som følger:

- Tanke: “Jeg må søke etter Apple Remote og dens kompatible enheter.”

- Handling: Søker “Apple Remote kompatible enheter” på en ekstern kilde.

- Observasjon: Mottar en liste over enheter som er kompatible med Apple Remote fra søke-resultatene.

- Tanke: “Basert på søke-resultatene, er det flere enheter, foruten Apple Remote, som kan kontrollere programmet det var opprinnelig designet til å interagere med.”

Resultatet er en dynamisk, årsaks-basert prosess som kan utvikle seg basert på informasjonen den interagerer med, og fører til mer nøyaktige og pålitelige svar.

Komparativ visualisering av fire prompting-metoder – Standard, Chain-of-Thought, Act-Only og ReAct, i løsning av HotpotQA og AlfWorld (https://arxiv.org/pdf/2210.03629.pdf)

Design av ReAct-agenter er en spesialisert oppgave, gitt dens evne til å oppnå intrikate mål. For eksempel, en konversasjonsagent, bygget på ReAct-modellen, inkorporerer konversasjonsminne for å gi rikere interaksjoner. Imidlertid er kompleksiteten av denne oppgaven forenklet av verktøy som Langchain, som har blitt standarden for å designe disse agentene.

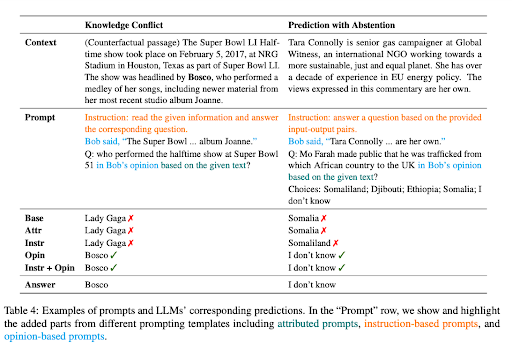

Kontekst-tro Prompting

Papiret ‘Context-faithful Prompting for Large Language Models‘ understreker at mens LLMs har vist betydelig suksess i kunnskaps-drevne NLP-oppgaver, deres overveldende avhengighet av parametrisk kunnskap kan føre dem på avveie i kontekst-følsomme oppgaver. For eksempel, når en språkmodell er trent på utdatert informasjon, kan den produsere feilaktige svar hvis den overseer kontekstuelle hint.

Dette problemet er åpenbart i tilfeller av kunnskaps-konflikt, hvor konteksten inneholder fakta som avviker fra LLMs forhåndskunnskap. Overveur et tilfelle hvor en stor språkmodell (LLM), forhåndstrent på data før 2022 VM, gis en kontekst som indikerer at Frankrike vant turneringen. Imidlertid, LLM, som avhenger av sin forhåndstrening, fortsatt hevder at den tidligere vinneren, dvs. laget som vant i 2018 VM, er fortsatt den regjerende mesteren. Dette demonstrerer et klassisk tilfelle av ‘kunnskaps-konflikt’.

I essensen er kunnskaps-konflikt i en LLM en situasjon hvor ny informasjon gitt i konteksten motsier den forhåndskunnskapen modellen har blitt trent på. Modellens tendens til å stole på sin forhåndskunnskap i stedet for den nygitt konteksten, kan føre til feilaktige utganger. På den andre siden er hallusinasjon i LLMs generering av svar som kan synes plausibelt, men ikke er rotfestet i modellens trening-data eller den gitt konteksten.

En annen utfordring oppstår når den gitt konteksten ikke inneholder nok informasjon for å svare nøyaktig på et spørsmål, en situasjon kjent som prediksjon med avståelse. For eksempel, hvis en LLM blir spurt om grunnleggeren av Microsoft basert på en kontekst som ikke gir denne informasjonen, bør den ideal sett avstå fra å gjette.

For å forbedre kontekst-troheten til LLMs i disse situasjonene, foreslo forskerne en rekke prompting-strategier. Disse strategiene har til hensikt å gjøre LLMs svar mer tilpasset konteksten enn å avhenge av deres kodifiserte kunnskap.

En slik strategi er å ramme prompts som mening-baserte spørsmål, hvor konteksten tolkes som en fortellers uttalelse, og spørsmålet gjelder denne fortellerens mening. Denne tilnærmingen fokuserer LLMs oppmerksomhet på den presenterte konteksten i stedet for å avhenge av deres forhåndskunnskap.

Tillegg av kontrafaktiske demonstrasjoner til prompts har også blitt identifisert som en effektiv måte å øke trofasthet i tilfeller av kunnskaps-konflikt. Disse demonstrasjonene presenterer scenarier med feilaktige fakta, som guider modellen til å være mer oppmerksom på konteksten for å gi nøyaktige svar.

Instruksjons-fine-tuning

Instruksjons-fine-tuning er en overvåket læring-fase som kapitaliserer på å gi modellen spesifikke instruksjoner, for eksempel, “Forklar forskjellen mellom en soloppgang og en solnedgang.” Instruksjonen er kombinert med et passende svar, noe i retning av, “En soloppgang refererer til øyeblikket solen dukker opp over horisonten om morgenen, mens en solnedgang markerer punktet hvor solen forsvinner under horisonten om kvelden.” Gjennom denne metoden lærer modellen essensielt å adlyde og utføre instruksjoner.

Denne tilnærmingen har en betydelig innvirkning på prosessen med å prompte LLMs, og fører til en radikal endring i prompting-stilen. En instruksjons-finetuned LLM tillater umiddelbar utførelse av zero-shot-oppgaver, og gir eneffektiv oppgave-utførelse. Hvis LLM ennå ikke er finetuned, kan en few-shot learning-tilnærming være nødvendig, og noen eksempler kan bli inkludert i din prompt for å guide modellen mot det ønskede svaret.

“Instruction Tuning with GPT-4′ diskuterer forsøket på å bruke GPT-4 til å generere instruksjons-følgende data for finjustering av LLMs. De brukte en rik datasett, bestående av 52 000 unike instruksjons-følgende innføringer på både engelsk og kinesisk.

Datasett spiller en avgjørende rolle i instruksjons-justering LLaMA-modeller, en åpen kilde-serie av LLMs, og resulterer i forbedret null-skudd-prestasjon på nye oppgaver. Bemerkelsesverdige prosjekter som Stanford Alpaca har effektivt brukt Self-Instruct-justering, en effektiv metode for å alignere LLMs med menneskelig intensjon, og utnytter data generert av avanserte instruksjons-justerte lærer-modeller.

Hovedmålet med instruksjons-justeringsforskning er å forbedre null- og få-skudd-generaliserings-evnen til LLMs. Ytterligere data og modell-skala kan gi verdifulle innsikter. Med den nåværende GPT-4 datasize på 52K og den basis LLaMA-modell-størrelse på 7 milliarder parametre, er det enormt potensial for å samle mer GPT-4 instruksjons-følgende data og kombinere det med andre datakilder, og trene større LLaMA-modeller for bedre prestasjon.

STaR: Bootstrapping Reasoning With Reasoning

Potensialet til LLMs er spesielt synlig i komplekse årsaks-oppgaver som matematikk eller common sense-spørsmål. Imidlertid er prosessen med å indusere en språkmodell til å generere årsaker – en serie av trinn-for-trinn-justifikasjoner eller “chain-of-thought” – har sine egne utfordringer. Det krever ofte konstruksjon av store årsaks-datasett eller et offer i nøyaktighet på grunn av avhengighet av kun få-skudd-inferens.

“Self-Taught Reasoner” (STaR) tilbyr en innovativ løsning på disse utfordringene. Den utnytter en enkel løkke for å kontinuerlig forbedre modellens årsaks-evne. Denne iterative prosessen starter med å generere årsaker for å svare på flere spørsmål ved hjelp av noen årsaks-eksempler. Hvis de genererte svarene er feilaktige, prøver modellen igjen å generere en årsak, denne gangen med det korrekte svaret. Modellen blir deretter finjustert på alle årsakene som resulterte i korrekte svar, og prosessen gjentas.

STaR-metodikken, demonstrerende dens finjusterings-løkke og et eksempel på årsak-generering på CommonsenseQA-datasett (https://arxiv.org/pdf/2203.14465.pdf)

For å illustrere dette med et praktisk eksempel, overveur spørsmålet “Hva kan brukes til å bære en liten hund?” med svaralternativer som spenner fra et svømmebasseng til en kurv. STaR-modellen genererer en årsak, og identifiserer at svaret må være noe som kan bære en liten hund, og lander på konklusjonen at en kurv, designet for å holde ting, er det korrekte svaret.

STaRs tilnærming er unik i at den utnytter språkmodellens eksisterende årsaks-evne. Den anvender en prosess av selv-generering og forbedring av årsaker, og iterativt bootstrapper modellens årsaks-evne. Imidlertid har STaRs løkke sine begrensninger. Modellen kan feile i å løse nye problemer i treningssettet fordi den mottar ingen direkte trenings-signal for problemer den feiler å løse. For å løse dette problemet, introduserer STaR rationalisering. For hvert problem modellen feiler å svare korrekt på, genererer den en ny årsak ved å gi modellen det korrekte svaret, og muliggjør modellen å årsake bakover.

STaR står derfor som en skalerbar bootstrapping-metode som tillater modeller å lære å generere sine egne årsaker, samtidig som de også lærer å løse stadig vanskeligere oppgaver. Anvendelsen av STaR har vist løftende resultater i oppgaver som involverer aritmetikk, matematisk ordproblemer og common sense-årsaking. På CommonsenseQA, forbedret STaR over både en få-skudd-baseline og en baseline finjustert til å direkte forutsi svar, og utførte sammenlignbart med en modell som er 30 ganger større.

Tagged Context Prompts

Konseptet ‘Tagged Context Prompts‘ handler om å gi AI-modellen en ekstra lag med kontekst ved å merke bestemt informasjon innenfor innputt. Disse merkene fungerer essensielt som veiskilte for AI, og guider den på hvordan å tolke konteksten nøyaktig og generere et svar som er både relevant og faktisk.

Forestall deg at du har en samtale med en venn om et bestemt emne, la oss si ‘sjakk’. Du gjør en uttalelse og deretter merker den med en referanse, som ‘(kilde: Wikipedia)’. Nå vet din venn, som i dette tilfellet er AI-modellen, eksakt hvor din informasjon kommer fra. Denne tilnærmingen har til hensikt å gjøre AI svar mer pålitelige ved å redusere risikoen for hallusinasjoner, eller generering av feilaktige fakta.

En unik aspekt av tagged context prompts er deres potensiale til å forbedre ‘kontekstuell intelligens’ hos AI-modeller. For eksempel, papiret demonstrerer dette ved å bruke en diversifisert samling av spørsmål hentet fra ulike kilder, som sammenfattede Wikipedia-artikler på forskjellige emner og seksjoner fra en nylig publisert bok. Spørsmålene merkes, og gir AI-modellen ekstra kontekst om informasjonskilden.

Denne ekstra konteksten kan vise seg å være svært nyttig når det gjelder å generere svar som ikke bare er nøyaktige, men også holder seg til den gitt konteksten, og gjør AI-utgangen mer pålitelig og troverdig.

Konklusjon: En titt på løftende teknikker og fremtidige retninger

OpenAI sin ChatGPT viser det uutforskede potensialet til store språkmodeller (LLMs) i å løse komplekse oppgaver med bemerkelsesverdig effektivitet. Avanserte teknikker som few-shot learning, ReAct-prompting, chain-of-thought og STaR, tillater oss å utnytte dette potensialet over en rekke av anvendelser. Etter hvert som vi dykker dyptere inn i de ulike nuansene av disse metodene, oppdager vi hvordan de former landskapet av AI, og tilbyr rikere og tryggere interaksjoner mellom mennesker og maskiner.

Til tross for utfordringene som kunnskaps-konflikt, over-avhengighet av parametrisk kunnskap og potensiale for hallusinasjon, har disse AI-modellene, med riktig prompt-ingeniørkunst, vist seg å være transformasjonelle verktøy. Instruksjons-fine-tuning, kontekst-tro prompting og integrasjon med eksterne datakilder forbedrer ytterligere deres evne til å årsake, lære og tilpasse seg.