Kunstig intelligens

Bedre maskinlæringsytelse gjennom CNN-basert bilde-omstørrelse

Google Research har foreslått en ny metode for å forbedre effektiviteten og nøyaktigheten av bilde-basert datamaskin-syn trening arbeidsflyter ved å forbedre måten bildene i en datamengde blir minifisert på forbehandlingsstadiet.

I paperet Lær å endre størrelse på bilder for datamaskin-syn oppgaver, bruker forskerne Hossein Talebi og Peyman Milanfar en CNN til å lage en ny hybrid bilde-omstørrelse-arkitektur som produserer en merkbart forbedring i gjenkjennelsesresultater som er oppnådd over fire populære datamaskin-syn datamengder.

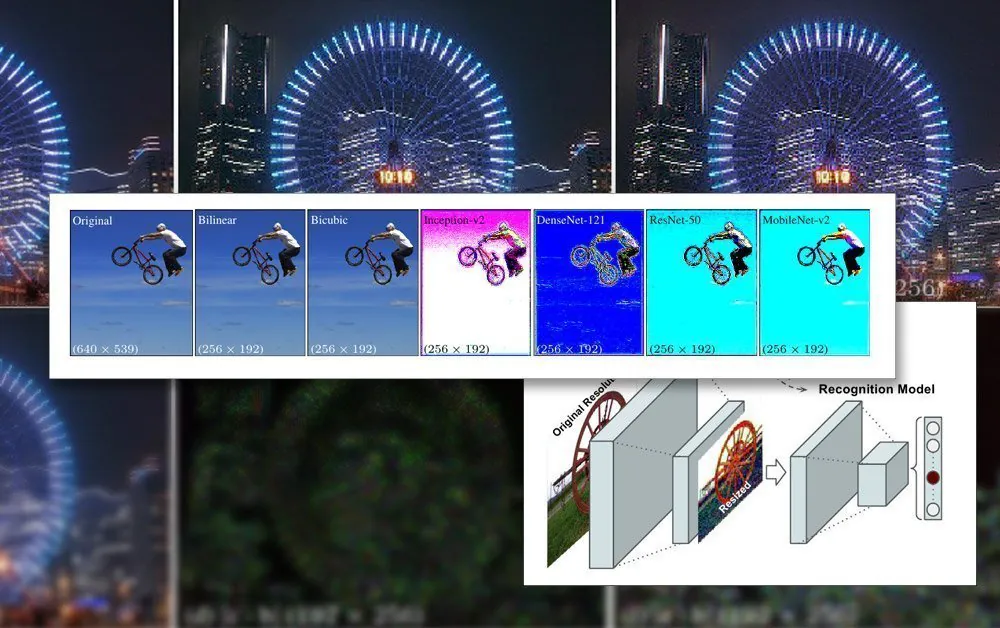

Den foreslåtte fellesrammen for gjenkjennelse og omstørrelse. Kilde: https://arxiv.org/pdf/2103.09950.pdf

Paperet observerer at reskalerings-/omstørrelsemetodene som brukes i automatiserte maskinlærings-pipelines er tiår gamle, og ofte bare bruker grunnleggende bilineær, bikubisk og nærmeste nabo omstørrelse – metoder som behandler alle piksler likegyldig.

Til sammenligning forbedrer den foreslåtte metoden bilde-data via en CNN og inkorporerer denne innmaten i de omstørrede bildene som til slutt vil gå gjennom modellens arkitektur.

Bilde-begrensninger i AI-trening

For å trene en modell som håndterer bilder, vil en maskinlærings-ramme inkludere en forbehandlingsstadium, hvor en mangfoldig variasjon av bilder av forskjellige størrelser, fargespasiale og oppløsninger (som vil bidra til trening datamengden) systematisk beskåres og omstørres til konsistente dimensjoner og en stabil, enkelt format.

Vanligvis vil dette innebære en kompromiss rundt PNG-formatet, hvor en avveiing mellom prosesserings tid/ressurser, filstørrelse og bildekvalitet vil bli etablert.

I de fleste tilfeller er de endelige dimensjonene av de prosesserte bildene svært små. Under ser vi et eksempel på 80×80 oppløsning bildet som noen av de tidligste deepfakes datamengdene ble generert:

Ettersom ansikter (og andre mulige subjekter) sjelden passer inn i den nødvendige kvadrat-forhold, kan svarte bjelker måtte legges til (eller bortkastet plass tillatt) for å homogenisere bildene, og ytterligere kutte ned den faktiske brukbare bilde-dataen:

Her har ansiktet blitt trukket ut fra en større bilde-område til det er beskåret så økonomisk som mulig for å inkludere hele ansikt-området. Men, som vist til høyre, vil en stor del av den gjenværende området ikke bli brukt under trening, og legger til større vekt på viktigheten av bildekvaliteten på de omstørrede dataene.

Ettersom GPU-egenskapene har forbedret seg i løpet av de siste årene, med den nye generasjonen av NVIDIA-kort utstyrt med økende mengder av video-RAM (VRAM), begynner gjennomsnittlige bidragende bildestørrelser å øke, selv om 224×224 piksler fortsatt er ganske standard (for eksempel, er det størrelsen på ResNet-50 datamengden).

Et ubeskåret 224×244 piksler bilde.

Passer batches inn i VRAM

Grunden til at bildene må være alle av samme størrelse er at gradient descent, metoden som modellen forbedrer seg over tid, krever enhetlig trening data.

Grunden til at bildene må være så små er at de må lastes (fullstendig dekomprimert) inn i VRAM under trening i små batches, vanligvis mellom 6-24 bilder per batch. For få bilder per batch, og det er ikke nok gruppe-materiale til å generalisere godt, i tillegg til å forlenge treningstiden; for mange, og modellen kan feile å oppnå nødvendige egenskaper og detaljer (se under).

Denne ‘live loading’ delen av trening-arkitekturen kalles latent rom. Dette er hvor funksjoner blir gjentatte ganger trukket ut fra samme data (dvs. samme bilder) til modellen har konvergert til en tilstand hvor den har all den generaliserte kunnskapen den trenger for å utføre transformasjoner på senere, usette data av en lignende type.

Dette prosessen tar vanligvis dager, selv om det kan ta en måned eller mer av konstant og uavbrutt høy volum 24/7 kognition for å oppnå nyttig generalisering. Økninger i VRAM-størrelse er bare nyttige opp til et visst punkt, siden selv små økninger i bilde-oppløsning kan ha en orden-av-størrelse effekt på prosesseringskapasitet, og relaterte effekter på nøyaktighet som kanskje ikke alltid er gunstige.

Bruk av større VRAM-kapasitet for å akkommodere høyere batch-størrelser er også en blandet velsignelse, siden de større treningshastighetene som oppnås av dette er sannsynligvis å bli offset av mindre presise resultater.

Derfor, siden trening-arkitekturen er så begrenset, er alt som kan effektuere en forbedring innenfor de eksisterende begrensningene av pipeline en merkbart oppnåelse.

Hvordan overlegen nedskalering hjelper

Den ultimate kvaliteten på et bilde som vil bli inkludert i en trening datamengde har blitt bevist å ha en forbedrende effekt på resultatet av trening, spesielt i objekt-gjenkjennelse oppgaver. I 2018 forskere fra Max Planck Institute for Intelligent Systems hevdet at valget av resampling-metode merkbart påvirker trening-ytelse og resultater.

I tillegg har tidligere arbeid fra Google (skrevet av de nye paperets forfattere) funnet at klassifiseringsnøyaktighet kan forbedres ved å opprettholde kontroll over kompresjons-artefakter i datamengde-bilder.

CNN-modellen bygget inn i den nye resamplen kombinerer bilineær omstørrelse med en ‘skip connection’ funksjon som kan inkorporere utgang fra det trente nettverket inn i det omstørrede bildet.

I motsetning til en typisk encoder/decoder-arkitektur, kan den nye foreslåtte funksjonen ikke bare som en feed-forward bottleneck, men også som en invers bottleneck for oppskalering til enhver mål-størrelse og/eller aspekt-forhold. I tillegg kan den ‘standard’ resampling-metoden bli byttet ut med noen annen passende tradisjonell metode, som Lanczos.

Høyfrekvente detaljer

Den nye metoden produserer bilder som i virkeligheten ser ut til å ‘bake’ nøkkel-egenskaper (som vil til slutt bli gjenkjent av trening-prosessen) direkte inn i kilde-bildet. I estetiske termer er resultater uvanlige:

Den nye metoden brukt over fire nettverk – Inception V2; DenseNet-121; ResNet-50; og MobileNet-V2. Resultatene av Google Research bilde-omstørrelse-metoden produserer bilder med åpenbar piksel-aggregasjon, som forutsier de nøkkel-egenskaper som vil bli gjenkjent under trening-prosessen.

Forskerne merker at disse innledende eksperimentene er eksklusivt optimert for bilde-gjenkjennelse oppgaver, og at i tester deres CNN-drevne ‘lærte resizer’ var i stand til å oppnå forbedrede feil-rater i slike oppgaver. Forskerne har til hensikt å bruke metoden til andre typer bilde-basert datamaskin-syn-applikasjoner i fremtiden.