Kunstig intelligens

AnomalyGPT: Detektering av industrielle anomalier med LVLMs

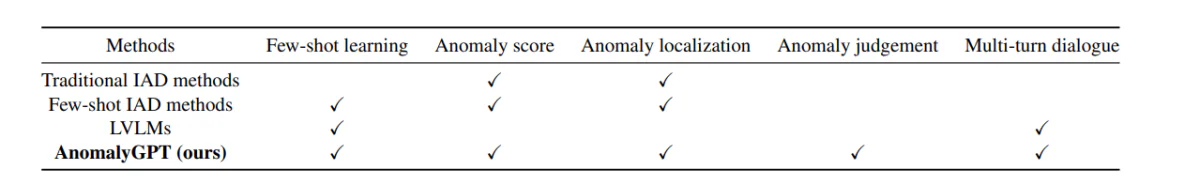

Nylig har store visuelt språkmodeller (LVLMs) som LLava og MiniGPT-4 vist evnen til å forstå bilder og oppnå høy nøyaktighet og effisiens i flere visuelle oppgaver. Mens LVLMs er dyktige til å gjenkjenne vanlige objekter på grunn av deres omfattende treningsdatasett, mangler de spesifik domenekunnskap og har en begrenset forståelse av lokale detaljer innen bilder. Dette begrenser deres effektivitet i oppgaver med deteksjon av industrielle anomalier (IAD). På den andre siden kan eksisterende IAD-rammeverk bare identifisere kilder til anomalier og krever manuell innstilling av terskler for å skille mellom normale og anomale prøver, noe som begrenser deres praktiske implementering.

Hovedformålet med et IAD-rammeverk er å detektere og lokalisere anomalier i industrielle scenarioer og produktbilder. Imidlertid, på grunn av uforutsigbarheten og sjeldenheten av virkelige bildesample, trenes modellene vanligvis bare på normale data. De skiller anomale prøver fra normale basert på avvik fra typiske prøver. For tiden tilbyr IAD-rammeverk og modeller hovedsakelig anomaliscore for testprøver. Dessuten krever skille mellom normale og anomale instanser for hver klasse av elementer manuell spesifisering av terskler, noe som gjør dem uegnet for virkelige applikasjoner.

For å utforske bruken og implementeringen av store visuelt språkmodeller i å håndtere utfordringene som IAD-rammeverk stiller, ble AnomalyGPT, en ny IAD-tilnærming basert på LVLM, introdusert. AnomalyGPT kan detektere og lokalisere anomalier uten behov for manuell innstilling av terskler. Videre kan AnomalyGPT også tilby relevante opplysninger om bildet for å engasjere interaktivt med brukerne, og tillate dem å stille følgespørsmål basert på anomalien eller deres spesifikke behov.

Industri Anomali Deteksjon og Store Visuelt Språkmodeller

Eksisterende IAD-rammeverk kan deles inn i to kategorier.

- Rekonstruksjonsbasert IAD.

- Egenskapsinnbedningsbasert IAD.

I et rekonstruksjonsbasert IAD-rammeverk er hovedmålet å rekonstruere anomale prøver til deres respektive normale motstykkeprøver, og detektere anomalier ved å beregne rekonstruksjonsfeil. SCADN, RIAD, AnoDDPM og InTra bruker forskjellige rekonstruksjonsrammeverk, fra generative adversarial nettverk (GAN) og autoencodere til diffusjonsmodell og transformatorer.

På den andre siden, i et egenskapsinnbedningsbasert IAD-rammeverk, er hovedmotivet å fokusere på å modellere egenskapsinnbeddingen av normale data. Metoder som PatchSSVD prøver å finne en hyper sfære som kan omfatte normale prøver tett, mens rammeverk som PyramidFlow og Cfl projiserer normale prøver på en gaussisk distribusjon ved å bruke normaliserende flater. CFA- og PatchCore-rammeverk har ettableret en minnebank av normale prøver fra patch-innbedninger, og bruker avstanden mellom testprøve-innbedning og normal innbedning for å detektere anomalier.

Begge disse metodene følger «en klasse en modell», en læringsparadigme som krever en stor mengde normale prøver for å lære distribusjonene av hver objekt klasse. Kravet om en stor mengde normale prøver gjør det upraktisk for nye objekt kategorier, og med begrenset anvendelse i dynamiske produkt miljøer. På den andre siden, AnomalyGPT-rammeverket bruker en kontekstuell læringsparadigme for objekt kategorier, som tillater det å aktivere interferens bare med en håndfull normale prøver.

Videre, har vi store visuelt språkmodeller eller LVLMs. LLMs eller store språkmodeller har hatt enorm suksess i NLP-industrien, og de blir nå utforsket for deres anvendelser i visuelle oppgaver. BLIP-2-rammeverket utnytter Q-former for å innføre visuelle egenskaper fra Vision Transformer inn i Flan-T5-modellen. Videre, MiniGPT-rammeverket kobler bildedelen av BLIP-2-rammeverket og Vicuna-modellen med en lineær lag, og utfører en to-trinns finjusteringsprosess ved å bruke bilde-tekst data. Disse tilnærmingene indikerer at LLM-rammeverk kan ha noen anvendelser for visuelle oppgaver. Imidlertid, disse modellene er trenet på generell data, og de mangler den nødvendige domenespesifikke ekspertisen for vidstrakt anvendelse.

Hvordan fungerer AnomalyGPT?

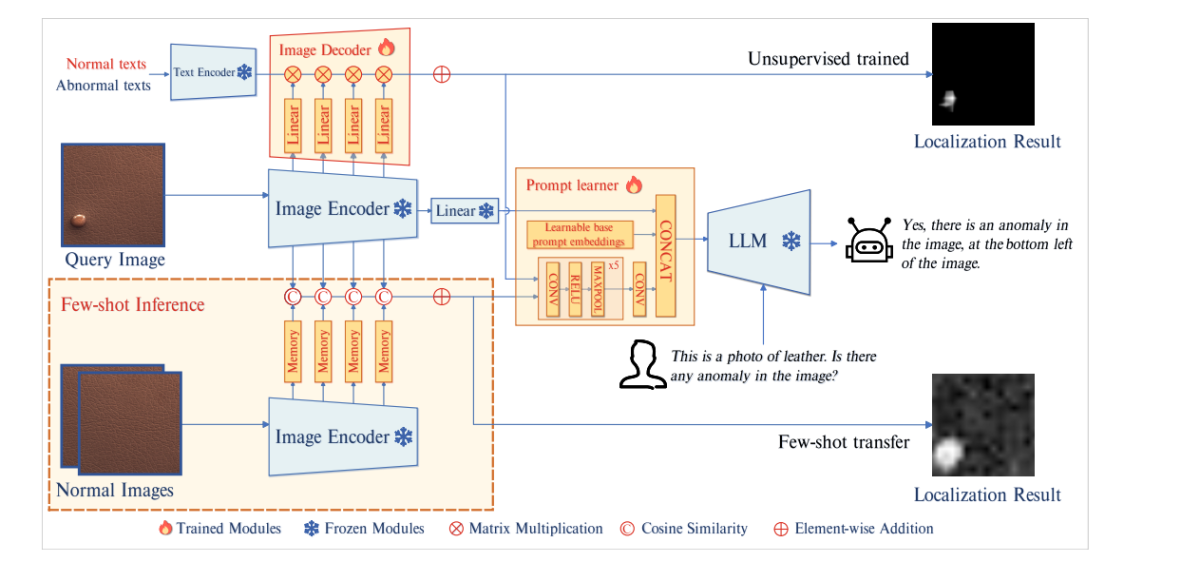

AnomalyGPT i kjernen er en ny konversasjons IAD-visuelt språkmodell designet primært for å detektere industrielle anomalier og angi deres nøyaktige lokasjon ved å bruke bilder. AnomalyGPT-rammeverket bruker en LLM og en forhåndstrent bilde-encoder for å justere bilder med deres respektive tekstbeskrivelser ved å bruke stimulert anomali data. Modellen innfører en dekoder modul, og en prompt lærer modul for å forbedre ytelsen av IAD-systemene, og oppnå piksel-nivå lokalisering utgang.

Modell Arkitektur

Bildet over viser arkitekturen av AnomalyGPT. Modellen passerer først spøringsbildet til den frosne bilde-encoderen. Modellen trekker deretter ut patch-nivå egenskaper fra mellomlagene, og matar disse egenskapene til en bilde-dekoder for å beregne deres likhet med abnormale og normale tekster for å få resultater for lokalisering. Prompt læreren konverterer dem deretter til prompt-innbedninger som er egnet for å brukes som inndata i LLM sammen med bruker-tekst inndata. LLM-modellen bruker deretter prompt-innbedningene, bilde-inndata og bruker-tilbudte tekst-inndata for å detektere anomalier, angi deres lokasjon, og lage sluttsvar for brukeren.

Dekoder

For å oppnå piksel-nivå anomali lokalisering, AnomalyGPT-modellen bruker en lettvektig funksjons-matching-basert bilde-dekoder som støtter både few-shot IAD-rammeverk og usuperviserte IAD-rammeverk. Designet av dekoderen brukt i AnomalyGPT er inspirert av WinCLIP, PatchCore og APRIL-GAN-rammeverk. Modellen deler bilde-encoderen inn i 4 stadier, og trekker ut mellomliggende patch-nivå egenskaper fra hvert stadium.

Imidlertid, har disse mellomliggende egenskapene ikke vært gjennom den endelige bilde-tekst justeringen, som er hvorfor de ikke kan sammenlignes direkte med egenskaper. For å håndtere dette problemet, innfører AnomalyGPT-modellen ekstra lag for å projicere mellomliggende egenskaper, og justere dem med tekst-egenskaper som representerer normale og abnormale semantikker.

Prompt Lærer

AnomalyGPT-rammeverket innfører en prompt lærer som prøver å transformere lokalisering resultater til prompt-innbedninger for å utnytte fine-grained semantikker fra bilder, og også opprettholde semantisk konsistens mellom dekoder- og LLM-utgang. Videre, inkorporerer modellen lærbare prompt-innbedninger, uavhengig av dekoder-utgang, i prompt læreren for å gi ekstra informasjon for IAD-oppgaven. Til slutt, matar modellen innbedningene og original bilde-informasjon til LLM.

Prompt læreren består av lærbare basis prompt-innbedninger, og et konvolusjons-nevralt nettverk. Nettverket konverterer lokalisering resultater til prompt-innbedninger, og danner en samling av prompt-innbedninger som deretter kombineres med bilde-innbedningene inn i LLM.

Anomali Simulering

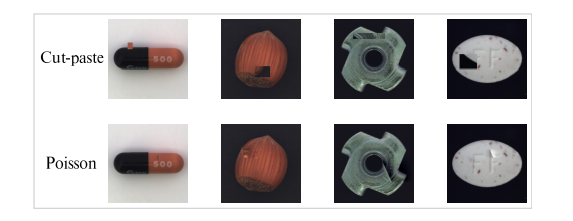

AnomalyGPT-modellen adopterer NSA-metoden for å simulere anomale data. NSA-metoden bruker Cut-paste-teknikken ved å bruke Poisson-bilde-redigering metoden for å lettelse av ujevnheten introdusert av lime bilde-segmenter. Cut-paste er en vanlig brukt teknikk i IAD-rammeverk for å generere simulerete anomali-bilder.

Cut-paste-metoden innebærer å klippe ut en blokkregion fra et bilde tilfeldig, og lime den inn i en tilfeldig lokasjon i et annet bilde, og dermed skape en del av simulerete anomalier. Disse simulerete anomali-prøvene kan forbedre ytelsen av IAD-modeller, men det er en ulempe, da de ofte kan produsere merkbare ujevnheter. Poisson-redigering metoden sikter på å klone et objekt fra et bilde til et annet ved å løse Poisson del-differensial ligninger.

Bildet over viser sammenligningen mellom Poisson og Cut-paste-bilde-redigering. Som det kan ses, er det synlige ujevnheter i Cut-paste-metoden, mens resultater fra Poisson-redigering ser mer naturlig ut.

Spørsmål og Svar Innhold

For å utføre prompt-justering på store visuelt språkmodell, genererer AnomalyGPT-modellen en tilsvarende tekstlig spørsmål basert på anomali-bildet. Hvert spørsmål består av to hovedkomponenter. Den første delen av spørsmålet består av en beskrivelse av inndata-bildet som gir informasjon om objekter som er til stede i bildet sammen med deres forventede attributter. Den andre delen av spørsmålet er å detektere tilstedeværelsen av anomalier innenfor objektet, eller å sjekke om det er en anomali i bildet.

LVLM-modellen svarer først på spørsmålet om det er en anomali i bildet? Hvis modellen detekterer anomalier, fortsetter den å angi lokasjonen og antallet av anomale områder. Modellen deler bildet inn i en 3×3-rutenett av distinkte regioner for å tillate LVLM å verbalt angi posisjonen av anomalier som vist i figuren under.

LVLM-modellen matas med deskriptiv kunnskap om inndata-bildet som gir grunnleggende kunnskap om bildets komponenter bedre.

Datasett og Evaluering Metrikk

Modellen utfører sine eksperimenter primært på VisA- og MVTec-AD-datasettene. MVTec-AD-datasettet består av 3629 bilder for treningsformål, og 1725 bilder for testing som er delt inn i 15 forskjellige kategorier, noe som gjør det til ett av de mest populære datasettene for IAD-rammeverk. Treningsbildene inneholder bare normale bilder, mens testbildene inneholder både normale og anomale bilder. På den andre siden, består VisA-datasettet av 9621 normale bilder og nærmere 1200 anomale bilder som er delt inn i 12 forskjellige kategorier.

Videre, på samme måte som eksisterende IAD-rammeverk, bruker AnomalyGPT-modellen AUC eller area under mottaker-operatør-karakteristikk som evaluering metrikk, med piksel-nivå og bilde-nivå AUC for å vurdere anomali-lokalisering ytelse, og anomali-deteksjon henholdsvis. Imidlertid, bruker modellen også bilde-nivå nøyaktighet for å evaluere ytelsen av den foreslåtte tilnærmingen, fordi den unikt tillater å bestemme tilstedeværelsen av anomalier uten å måtte sette opp terskler manuelt.

Resultater

Kvantitative Resultater

Few-Shot Industri Anomali Deteksjon

AnomalyGPT-modellen sammenligner sine resultater med tidligere few-shot IAD-rammeverk, inkludert PaDiM, SPADE, WinCLIP og PatchCore som baselinjer.

Bildet over sammenligner resultater fra AnomalyGPT-modellen i sammenligning med few-shot IAD-rammeverk. Over begge datasett, overstiger metoden fulgt av AnomalyGPT tilnærmingene til tidligere modeller i terms av bilde-nivå AUC, og returnerer også god nøyaktighet.

Usupervisert Industri Anomali Deteksjon

I en usupervisert treningsinnstilling med en stor mengde normale prøver, trenes AnomalyGPT en enkelt modell på prøver hentet fra alle klasser innenfor et datasett. Utviklerne av AnomalyGPT har valgt UniAD-rammeverket, fordi det er trenet under samme oppsett, og vil fungere som en baseline for sammenligning. Videre, sammenlignes modellen også mot JNLD- og PaDim-rammeverk ved å bruke samme enhetlig oppsett.

Bildet over sammenligner ytelsen av AnomalyGPT i sammenligning med andre rammeverk.

Kvalitative Resultater

Bildet over viser ytelsen av AnomalyGPT-modellen i usupervisert anomali-deteksjon metode, mens figuren under demonstrerer ytelsen av modellen i 1-shot kontekstuell læringsmetode.

AnomalyGPT-modellen er i stand til å indikere tilstedeværelsen av anomalier, angi deres lokasjon, og gi piksel-nivå lokalisering resultater. Når modellen er i 1-shot kontekstuell læringsmetode, er lokalisering ytelsen av modellen litt lavere sammenlignet med usupervisert læringsmetode på grunn av mangelen på treningsdata.

Konklusjon

AnomalyGPT er en ny konversasjons IAD-visuelt språkmodell designet for å utnytte de kraftige evnene til store visuelt språkmodeller. Den kan ikke bare detektere anomalier i et bilde, men også angi deres nøyaktige lokasjon. Dessuten, AnomalyGPT muliggjør multi-turn dialoger fokusert på anomali-deteksjon og viser fremragende ytelse i few-shot kontekstuell læringsmetode. AnomalyGPT utforsker de potensielle anvendelsene av LVLM i anomali-deteksjon, og introduserer nye ideer og muligheter for IAD-industrien.