Andersons vinkel

AI-samtalemodeller kan drive opp kostnader gjennom endeløst snakking

Populære AI-samtalemodeller hemmelig kaster bort enorme mengder betalte token på meningsløs verbositet. Berørte modeller vet faktisk hva de gjør, men kan ikke stoppe seg selv.

Large Reasoning Models (LRMs) som ChatGPT-5 og Google Gemini tar mer betalt for resonnement – å gå gjennom et problem steg for steg, som bruker betydelig mer beregningskraft enn bare å forutsi neste ord. Den simulerende resonnementprosessen tar lengre tid og koster mer å kjøre; derfor ender brukerne med å betale for denne ‘ekstra tenketiden’.

Men hvis du har brukt en state-of-the-art LLM nylig, kan du ha lagt merke til at din tildeling av token ofte blir brukt på verbositet og ugress, snarere enn å fokusere på å løse problemene du stiller til modellen. Dette kan ta form av eksessiv sycophancy, prolix og/eller redundante svar – eller sogar en slags ‘snakking’, som om AI-en hadde blitt tatt på fersken og prøver å snakke seg ut av en vanskelig situasjon.

Naturligvis ville vi foretrekke at våre LLMs innrømmer nederlag, følger eller tilbyr alternative løsninger, eller ber om klargjøring. Men selv å få en AI av denne typen til å innrømme at de ikke kjenner svaret er en betydelig utfordring i seg selv.

I mellomtiden kan brukere på lavere eller gratis nivåer finne at de har brent gjennom sine token i en rask takt, uansett hvor målrettede eller økonomiske deres spørsmål og interaksjoner var, fordi AI-en selv elsker å snakke; og i dette tilfelle er snakking ikke billig.

Ord-salat

I forhold til den ovennevnte ‘snakking’, tilbyr en ny akademisk samarbeid en rasjonalisering og en løsning, ved å foreslå at LLM-er med resonnementsevner er utsatt for å brenne gjennom dine token når de havner i en ‘ord-salat’-løkke – en tilstand av forvirring hvor resonnementprosessen havner i rekursive blindgater – på din regning*.

Forskerne bak den nye artikkelen har funnet at en betydelig andel av tokenene som prosesseres i en typisk LLM består av repetisjon og redundanser – og at modellen selv ser ut til å forstå at den er i trøbbel, selv om den ikke kan stoppe den kostbare løkken.

Artikkelen sier:

‘Vi viser at en betydelig andel av disse tokenene er nytteløse selv-repetisjoner – hva vi kaller “ord-salat” – som uttømmer dekodingsbudsjettet uten å legge til verdi. Interessant nok observerer vi at LRM-er er selv-bevisste når de er fanget i disse løkkene: de skjulte tilstandene av <\n\n> tokenene som følger hver resonnement-blokk, viser mønster som tillater oss å detektere ord-salat-atferd på en enkelt lag lineær klassifikator.

‘Når det er detektert, kan en enkel kutting føyet til en rettfram regenereringsprompt gi betydelige lengdebesparelser med minimal kvalitetstap.’

Løsningen som tilbys av den nye artikkelen er en intervensjon som kan kutte av den spiralerende prosessen til en feil LRM på en på-en-gang-måte, uten inklusjon i treningdata, eller noen av skadene som kan følge fra finjustering. Rammen, tittelen WordSaladChopper, er publisert på GitHub.

Selv om den innledende artikkelen konsentrerer seg om DeepSeek-varianter som inngår i Qwen- og Llama-serien, påstår artikkelen at den uønskede atferden sannsynligvis er anvendbar på en langt større del av lignende arkitekturerte resonnementmodeller (inkludert populære API-kun tilbud som ChatGPT og Google Gemini).

Som artikkelen bemerker, er tidligere tilbud som Demystifying Long Chain-of-Thought Reasoning in LLMs og Small Models Struggle to Learn from Strong Reasoners likewise bruker det lille antallet offentlig tilgjengelige Chain-of-Thought (CoT) resonnementmodeller for å etablere en større problem blant denne klassen av modeller†:

‘[LRM-er] tenderer å kaste bort en enorm mengde dekodingsbudsjett, bare ved å repetere seg selv ordret, med små variasjoner, eller engasjere i endeløs opptelling av tilfeller til alle budsjett har blitt [utgift] – vi refererer til slik atferd som Ord-salat, en betegnelse ofte brukt til å latterliggjøre offentlige talsmenn for å gi lange, jargong-fylte svar som til slutt mangler substans eller klart mening.

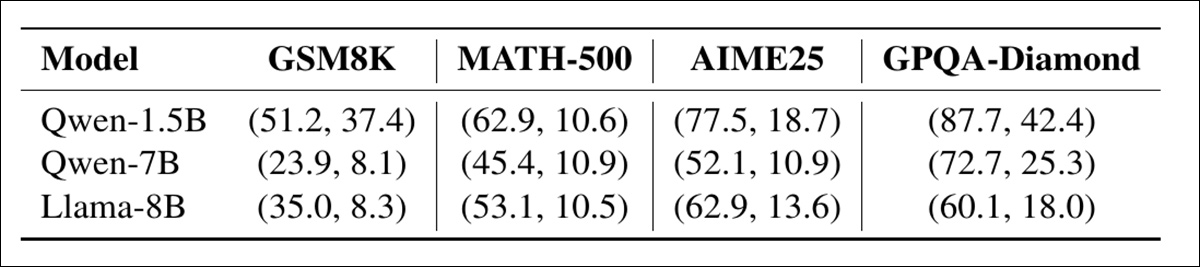

‘Den “Original”-kolonnen i [tabellen nedenfor] viser at når de svarer GPQA-Diamond, observerer vi 55%+ av tokenene generert av DeepSeek-R1-Distill-modellene er merket som “ord-salat-token”, hvor de ikke legger til verdi fra et semantisk synspunkt.’

![Andelen av output-token som er identifisert som semantisk redundante når de svarer GPQA-Diamond. WordSaladChopper reduserer denne overhodemengden fra over 55% til under 6% på alle testede DeepSeek-R1-Distill-modeller, hevder forfatterne. [ Kilde ] https://arxiv.org/pdf/2511.00536](https://www.unite.ai/wp-content/uploads/2025/11/table-1.jpg)

Andelen av output-token som er identifisert som semantisk redundante når de svarer GPQA-Diamond. WordSaladChopper reduserer denne overhodemengden fra over 55% til under 6% på alle testede DeepSeek-R1-Distill-modeller, hevder forfatterne. Kilde

Forfatterne bemerker at forsøk på å forkorte resonnementprosesser mens de bevare svarkvalitet har blitt en sterk understrøm i forskningslitteraturen, navnlig lang-til-kort (L2S); og observerer videre at mens deres prosjektets mål er lignende til en håndfull tidligere initiativer, er deres eget det første som tilbyr en ad hoc-løsning som ikke krever inngripen i treningprosessen, modellredigering eller andre mulige påvirkninger på den underliggende arkitekturen til en LLM; og i den forstand, tror de at deres tilnærming bør bli utbredt blant anvendbare systemer†:

‘Gitt dens lave overhodemengde, sterke besparelser og mangelen på semantisk verdi av ord-salat-token, tror vi det ikke er for langt fra å hevde at [WordSaladChopper] – eller en lignende komponent – er et måtte-ha for alle LRM-applikasjoner med brukeropplevelse i mente ‘

Den nye artikkelen har tittelen Word Salad Chopper: Resonnementmodeller kaster bort en mengde dekodingsbudsjett på nytteløse repetisjoner, selv-bevisst, og kommer fra seks forskere på University of Minnesota, Rice University, Stevens Institute of Technology og Lambda, Inc.

Tidligere overveielser

For å spore tendensen til resonnement LLM-er til å repetere seg selv, delte forfatterne modellens output i blokker hvor det var doble linjeskift, og sjekket hvor lik hver blokk var til tidligere ene:

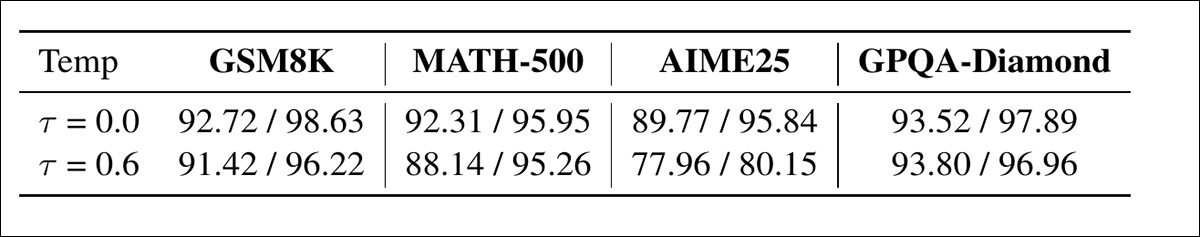

Estimert andel av resonnement-blokker merket som ord-salat under to dekodings-temperaturer (τ = 0,0, 0,6). Klassifikatoren merker en blokk som ‘ord-salat’ når den ligner en tidligere del av modellens output, noe som antyder repetisjon snarere enn fremgang. Resultatene viser at denne atferden er utbredt over datasett og modellstørrelser.

Hvis en blokk var for lik, ble den merket som ‘ord-salat’ (effektivt en nytteløs repetisjon).

Forskerne bemerker at når en modell går inn i ‘ord-salat’-modus, er det svært usannsynlig at den kan slippe ut av det uten ekstern hjelp, men forblir i den kostbare løkken til brukerens dekodingsbudsjett er brukt opp††:

‘Unødvendig å si, presenterer dette en katastrofal problem for brukere, ettersom en ideal sett mye kortere tenke-seksjon nå er maksimalt utnyttet med nytteløse repetisjoner. Så brukeren betaler i praksis maksimumskostnaden for et (sannsynligvis) feil svar, samtidig som de må utstå den lengste sluttkonsektivitet.’

Andel av ord-salat-blokker som oppstår før og etter kutte-punktet (dvs. øyeblikket når repetert output begynner å dominere). De fleste repetisjoner skjer etter dette punktet, noe som viser at når en modell går inn i en ord-salat-løkke, gjenvinner den sjelden uten inngripen.

Forfatterne gjentar sin overraskelse da de oppdaget at resonnement LLM-er††† viste tegn på å være bevisst på sin ord-salat-tilstand. Men det er denne bevisstheten, og måten den kommer inn i modellens sannsynlige resonnementstilstand, som tillater en intervensjonssystem:

‘Lettheten av denne lineære klassifikatoren åpner døren for på-en-gang-deteksjon, hvor vi kan effektivt gripe inn med forskjellige operasjoner for å håndtere modeller fanget i ord-salat-løkker.’

Metode

For å detektere tilstedeværelsen av ord-salat under inferens, trente forfatterne en enkel lineær klassifikator som kjører på den skjulte tilstanden av hver dobbel newline-token.

Enhver blokk som skjedde etter at modellen gikk inn i en repetisjonsløkke, ble behandlet som ord-salat, med denne avkorting (referert til som kutte-punktet) brukt til å merke treningdata. Tusen resonnementsspor ble generert ved hjelp av S1-benchmark, og hver spor ble delt inn i newline-separerte blokker.

Konseptuell skjema for WordSaladChopper. Under generering, analyseres den skjulte tilstanden ved hver dobbel newline-token for å detektere repetitive segmenter. Når to ‘ord-salat’-blokker er merket på rad, stoppes genereringen. En fast regenereringsprompt blir deretter festet til, og lar modellen fortsette og fullføre svaret uten å overstige budsjettet.

Hvis en blokk ble funnet å være svært lik en tidligere ene, ble den merket som ord-salat. Når den tidligste vedvarende repetisjonen ble identifisert, ble alle påfølgende blokker også merket som ord-salat for å reflektere vedvaren av disse løkkene.

Klassifikatoren ble implementert som ett enkelt fullt koblet lag og trent på de skjulte tilstandene av de trailende tokenene fra den siste transformator-blokken. En separat klassifikator ble trent for hver modell, ved hjelp av denne dataen, og ingen finjustering ble utført under evaluering.

Data og tester

Trening og inferens brukte fire NVIDIA A100 (80G VRAM) GPU-er, under Adam-optimalisatoren, med en læringsrate på 1×10-2, for 50 epoker.

Evalueringssammendragene ble ‘Grade School Math’ 8000, også kjent som GSM8K; MATH-500; GPQA-DIAMOND; og AIME25 (2025).

Modellene som ble testet var DeepSeek-R1-Distill-Qwen-1.5B; DeepSeek-R1-Distill-Qwen-7B; og DeepSeek-R1-Distill-Llama-8B, alle under MIT-lisens.

Metrikker som ble brukt var nøyaktighet og AUROC.

Nøyaktighet og AUROC av ord-salat-klassifikatoren på Qwen-7B over fire benchmark og to dekodings-temperaturer. Høye poengsummer bekrefter at pågangen av repetisjon kan pålitelig detekteres fra den skjulte tilstanden av den trailende newline-token.

Av resultatene som er vist her, kommenterer forfatterne:

‘[Tabellen ovenfor] viser at den lineære klassifikatoren er ekstremt nøyaktig i å detektere ord-salat-blokkene; men [tabellen nedenfor] demonstrerer at regenereringsprompten hjelper med å gjenvinne oppgavens nøyaktighet som ble tapt fra brutt-kutting.’

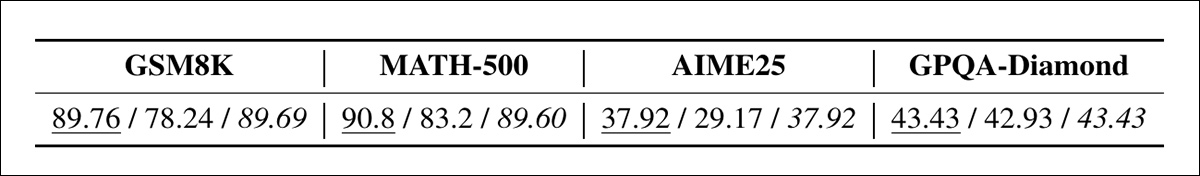

Nøyaktighet av Qwen-7B på hver benchmark ved τ = 0,6, sammenligning av ytelse før ord-salat (Original), etter kutting (Kuttet) og etter å ha brukt regenerering (Regenerert). Gevinstene fra regenerering er beskjedne, men konsistente, og gjenvinner pre-loop-ytelse i de fleste tilfeller.

I tabellen nedenfor kan vi se at WordSaladChopper forbedret eller bevarte nøyaktighet samtidig som den skarpt reduserte lengden av modellens output, med opptil 57%:

Når WordSaladChopper brukes ved grådige dekoding (τ = 0), reduserer den lengden av modellens output, noen ganger med mer enn halvparten, samtidig som den holder nøyaktigheten den samme eller litt bedre, en ytelse som forblir konsistent blant forskjellige modeller og oppgaver (AIME25 er utelatt på grunn av forutsigbare ustabile resultater under denne innstillingen).

De største gevinstene dukket opp i lengre svar, spesielt på GPQA-Diamond, hvor nesten halvparten av teksten ble fjernet uten å skade ytelsen. Nedenfor kan vi se lignende resultater når tilfeldighet ble lagt til under generering:

Ved høyere temperatur (τ = 0,6) fortsetter WordSaladChopper å forkorte output med 10-30 prosent, med nøyaktighet som forblir stabil eller litt forbedret over alle modeller og benchmark (AIME25-resultatene er gjennomsnittlig for å redusere variasjon).

Her forble nøyaktigheten stabil, med kortere output oppnådd. Over hele linjen fortsatte systemet å fungere, selv når modellens svar ble mer repetitive; og forfatterne bemerker at fordi klassifikatoren bare sjekker ett token per setning, kjører den ekstremt raskt, selv når den brukes under live-generering.

Artikkelen observerer at ytterligere strategier i fremtidig forskning langs disse linjene kunne dra nytte av å gi modellen en liten regenereringsbudsjett etter intervensjonen; kontinuerlig anvendelse av en WordSaladChopper-lignende system over regenereringer; og å tvinge en ‘slutt-på-tenk’-token på modellen, for å kreve dens beste nåværende svar.

Til slutt kommenterer forfatterne på kvaliteten av den nåværende tilstanden av kunnskap i evaluering av resonnementmodeller, med en kritisk tone†:

‘[Det] er vår ærlige overbevisning at mange effektive resonnementmetoder synes å være effektive delvis fordi nåværende resonnement-evaluering-benchmark har mye rom for forbedring.

‘Skal vi utvikle mer omfattende evaluerings suiter – som vi sikkert vil i fremtiden – forventer vi å se mange effektive resonnementmetoder feile, eller oppføre seg mye annerledes enn deres vanlige LRM-ekvivalenter.’

Konklusjon

Ved skalaen nådd av ledende systemer som ChatGPT, kan selv små endringer i brukerressursforbruk ha betydelige infrastruktur-, logistikk- og kostnadskonsekvenser. Dette gjør effektivitet til en felles prioritet for både leverandører og den bredere forskningsmiljøet.

Hvis den nye og lette systemet som foreslås i artikkelen blir implementert (som må være tilpasset hver ny modellarkitektur), kunne det forhindre det meningsløse forbrenningen av token – som kan gi kunden inntrykk av at leverandøren ‘blør ut’ deres tildeling på en sløs eller bedragerisk måte. I virkeligheten gjør leverandøren det bedre ved å levere nyttig enn redundant output, som koster like mye i beregningsmessige termer som en ord-salat.

* Skal vi ikke utdype dette her, omfatter dette også lokale modeller, som kan være både bedrifts- og hobbyistiske, og hvor strøm- og produktivitets-tap av ord-salat kan være en faktor verdt å merke.

† Som vanlig er all vektlegging forfatterens, og ikke min egen. Der det er aktuelt, har deres inline-citater blitt konvertert til lenker av meg.

†† Her må vi anerkjenne at rammer og API-er kan tildele ‘under-budsjett’ til spørsmål, så at ett spørsmål ikke nødvendigvis kan forbrenne en dags tillatelser av token – men dette er ikke vanlig praksis, eller vanlig diskutert blant API-kun leverandører.

††† Jeg er ikke generelt forberedt på å adoptere forfatterens bruk av ‘LRM-er’, ettersom dette ikke er en vanlig forkortelse, så jeg vil bruke annen terminologi i denne artikkelen, etter behov.

Først publisert torsdag, 6. november 2025