Prompt engineering

Hva er Chain-of-Thought (CoT) Prompting? Eksempler & Fordeler

I de senere år har store språkmodeller (LLM) gjort bemerkelsesverdige fremskritt i deres evne til å forstå og generere menneske-lignende tekst. Disse modellene, som OpenAI’s GPT og Anthropic’s Claude, har vist imponerende ytelse på en rekke naturlige språkbehandlingsoppgaver. Men når det kommer til komplekse resoneringoppgaver som krever flere steg av logisk tenkning, svikter vanlige promptmetoder ofte. Dette er der Chain-of-Thought (CoT) prompting kommer inn, og tilbyr en kraftfull prompt-teknikk for å forbedre resoneringsevnen til store språkmodeller.

Hovedpoeng

- CoT prompting forbedrer resoneringsevnen ved å generere mellomliggende steg.

- Den bryter ned komplekse problemer i mindre, håndterbare underproblemer.

- Fordelene inkluderer forbedret ytelse, tolkbarhet og generalisering.

- CoT prompting gjelder for aritmetisk, sunn fornuft og symbolisk resonering.

- Den har potensialet til å ha en betydelig innvirkning på AI over diverse domener.

Hva er Chain-of-Thought (CoT) Prompting?

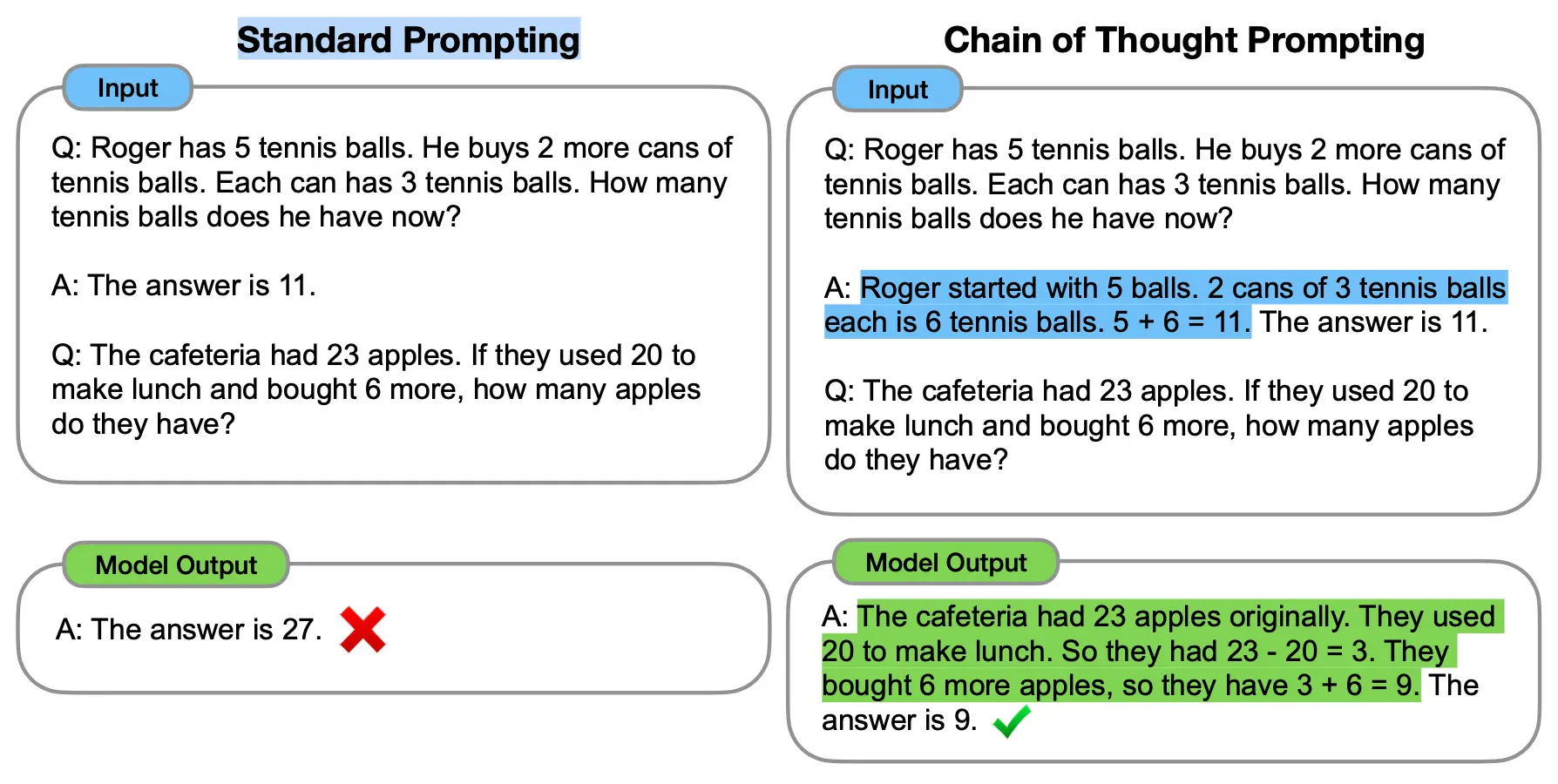

Chain-of-Thought prompting er en teknikk som har som mål å forbedre ytelsen til store språkmodeller på komplekse resoneringoppgaver ved å oppmuntre modellen til å generere mellomliggende resoneringsteg. I motsetning til vanlige promptmetoder, som vanligvis gir en enkelt prompt og forventer et direkte svar, bryter CoT prompting ned resoneringprosessen i en rekke mindre, sammenhengende steg.

På sitt kjernepunkt innebærer CoT prompting å prompte språkmodellen med et spørsmål eller et problem og deretter guide den til å generere en tankekedde – en sekvens av mellomliggende resoneringsteg som fører til det endelige svaret. Ved å uttrykkelig modellere resoneringprosessen, ermöglicher CoT prompting språkmodellen å håndtere komplekse resoneringoppgaver mer effektivt.

En av de viktigste fordelene med CoT prompting er at den tillater språkmodellen å bryte ned et komplekst problem i mer håndterbare underproblemer. Ved å generere mellomliggende resoneringsteg, kan modellen bryte ned den totale resoneringoppgaven i mindre, mer fokuserte steg. Dette hjelper modellen å opprettholde kohens og reduserer sjansen for å miste spor av resoneringprosessen.

CoT prompting har vist løftende resultater i å forbedre ytelsen til store språkmodeller på en rekke komplekse resoneringoppgaver, inkludert aritmetisk resonering, sunn fornuft og symbolisk resonering. Ved å utnytte kraften til mellomliggende resoneringsteg, ermöglicher CoT prompting språkmodeller å vise en dypere forståelse av problemet og generere mer nøyaktige og kohente svar.

Standard vs COT prompting (Wei et al., Google Research, Brain Team)

Hvordan Chain-of-Thought Prompting fungerer

CoT prompting fungerer ved å generere en rekke av mellomliggende resoneringsteg som guider språkmodellen gjennom resoneringprosessen. I stedet for å bare gi en prompt og forvente et direkte svar, oppmuntres modellen til å bryte ned problemet i mindre, mer håndterbare steg.

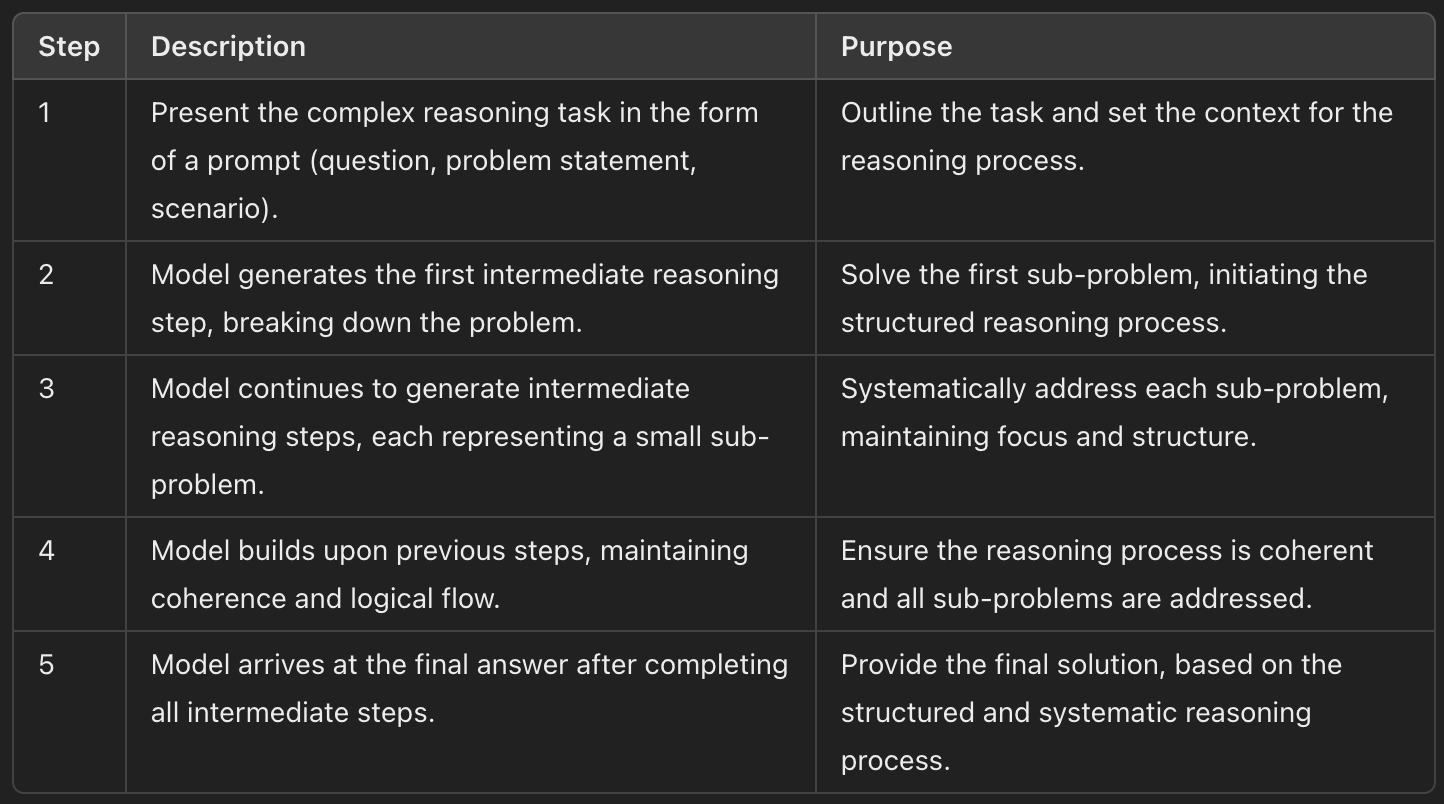

Prosessene begynner med å presentere språkmodellen med en prompt som omrissert den komplekse resoneringoppgaven. Denne prompten kan være i form av et spørsmål, et problemutsagn eller en scenario som krever logisk tenkning. Når prompten er gitt, genererer modellen en sekvens av mellomliggende resoneringsteg som fører til det endelige svaret.

Hver mellomliggende resoneringsteg i tankekedden representerer et lite, fokusert underproblem som modellen må løse. Ved å generere disse stegene, kan modellen nærme seg den totale resoneringoppgaven på en mer strukturert og systematisk måte. De mellomliggende stegene tillater modellen å opprettholde kohens og holde spor av resoneringprosessen, og reduserer sjansen for å miste fokus eller generere irrelevant informasjon.

Ettersom modellen fremmer gjennom tankekedden, bygger den på de foregående resoneringstegene for å nå det endelige svaret. Hvert steg i tankekedden er koblet til de foregående og påfølgende stegene, og danner en logisk flyt av resonering. Denne steg-for-steg-tilnærmingen ermöglicher modellen å håndtere komplekse resoneringoppgaver mer effektivt, da den kan fokusere på ett underproblem om gangen samtidig som den opprettholder den totale konteksten.

Genereringen av mellomliggende resoneringsteg i CoT prompting oppnås vanligvis gjennom nøye designede promptrer og treningsmetoder. Forskere og praktikere kan bruke ulike metoder til å oppmuntre modellen til å produsere en tankekedde, som å gi eksempler på steg-for-steg-resonering, bruke spesielle token til å indikere starten og slutten av hvert resoneringsteg eller finjustere modellen på datasett som demonstrerer den ønskede resoneringprosessen.

5-Step COT prompting prosess

Ved å guide språkmodellen gjennom resoneringprosessen ved å bruke mellomliggende steg, ermöglicher CoT prompting modellen å løse komplekse resoneringoppgaver mer nøyaktig og effektivt. Den uttrykkelige modelleringen av resoneringprosessen forbedrer også tolkbarheten av modellens utdata, da den genererte tankekedden gir innsikt i hvordan modellen kom frem til sitt endelige svar.

Eksempler på Chain-of-Thought Prompting

CoT prompting har vært suksessfullt brukt i en rekke komplekse resoneringoppgaver, og har vist sin effektivitet i å forbedre ytelsen til store språkmodeller.

La oss utforske noen eksempler på hvordan CoT prompting kan brukes i ulike domener.

Aritmetisk Resonering

En av de mest rettframma applikasjonene av CoT prompting er i aritmetiske resoneringoppgaver. Ved å generere mellomliggende resoneringsteg, kan CoT prompting hjelpe språkmodeller å løse multi-steg aritmetiske problemer mer nøyaktig.

For eksempel, betrakt følgende problem:

"Hvis John har 5 epler og Mary har 3 ganger så mange epler som John, hvor mange epler har Mary?"

Ved å bruke CoT prompting, kan språkmodellen generere en tankekedde som følger:

John har 5 epler.Mary har 3 ganger så mange epler som John.For å finne ut hvor mange epler Mary har, må vi multiplisere Johns epler med 3.5 epler × 3 = 15 eplerDerfor har Mary 15 epler.

Ved å bryte ned problemet i mindre steg, ermöglicher CoT prompting språkmodellen å resonere gjennom det aritmetiske problemet mer effektivt.

Sunn Fornuft Resonering

CoT prompting har også vist løftende resultater i å håndtere sunn fornuft resoneringoppgaver, som krever en dyp forståelse av hverdagskunnskap og logisk tenkning.

For eksempel, betrakt følgende spørsmål:

"Hvis en person er allergisk mot hunder og deres venn inviterer dem over til et hus med en hund, hva skal personen gjøre?"

En språkmodell som bruker CoT prompting kan generere en tankekedde som følger:

Personen er allergisk mot hunder.Vennens hus har en hund.Å være i nærheten av hunder kan utløse personens allergi.For å unngå en allergisk reaksjon, bør personen avslå invitasjonen.Personen kan foreslå et alternativt sted å møte vennen.

Ved å generere mellomliggende resoneringsteg, ermöglicher CoT prompting språkmodellen å vise en klarere forståelse av situasjonen og gi en logisk løsning.

Symbolisk Resonering

CoT prompting har også vært brukt i symbolisk resoneringoppgaver, som innebærer å manipulere og resonere med abstrakte symboler og konsepter.

For eksempel, betrakt følgende problem:

"Hvis A impliserer B, og B impliserer C, impliserer A C?"

Ved å bruke CoT prompting, kan språkmodellen generere en tankekedde som følger:

A impliserer B betyr at hvis A er sant, så må B også være sant.B impliserer C betyr at hvis B er sant, så må C også være sant.Hvis A er sant, så er B sant (fra steg 1).Hvis B er sant, så er C sant (fra steg 2).Derfor, hvis A er sant, så må C også være sant.Så, A impliserer C.

Ved å generere mellomliggende resoneringsteg, ermöglicher CoT prompting språkmodellen å håndtere abstrakt symbolisk resonering mer effektivt.

Disse eksemplene demonstrerer den universelle og effektive bruken av CoT prompting i å forbedre ytelsen til store språkmodeller på komplekse resoneringoppgaver over ulike domener. Ved å uttrykkelig modellere resoneringprosessen gjennom mellomliggende steg, ermöglicher CoT prompting språkmodellen å håndtere komplekse problemer og generere mer nøyaktige og kohente svar.

Fordelene med Chain-of-Thought Prompting

Chain-of-Thought prompting tilbyr flere betydelige fordeler i å fremme resoneringsevnen til store språkmodeller. La oss utforske noen av de viktigste fordelene:

Forbedret Ytelse på Komplekse Resoneringoppgaver

En av de primære fordelene med CoT prompting er dens evne til å forbedre ytelsen til språkmodeller på komplekse resoneringoppgaver. Ved å generere mellomliggende resoneringsteg, ermöglicher CoT prompting modeller å bryte ned komplekse problemer i mer håndterbare underproblemer. Denne steg-for-steg-tilnærmingen tillater modellen å opprettholde fokus og kohens gjennom hele resoneringprosessen, og leder til mer nøyaktige og pålitelige resultater.

Studier har vist at språkmodeller trent med CoT prompting konsekvent overgår de som er trent med vanlige promptmetoder på en rekke komplekse resoneringoppgaver. Den uttrykkelige modelleringen av resoneringprosessen gjennom mellomliggende steg har vist seg å være en kraftfull teknikk for å forbedre modellens evne til å håndtere komplekse problemer som krever multi-steg resonering.

Forbedret Tolkbarhet av Resoneringprosessen

En annen betydelig fordel med CoT prompting er den forbedrede tolkbarheten av resoneringprosessen. Ved å generere en tankekedde, gir språkmodellen en klar og gjennomsiktig forklaring av hvordan den kom frem til sitt endelige svar. Denne steg-for-steg-gjennomgangen av resoneringprosessen tillater brukerne å forstå modellens tenketankar og vurdere gyldigheten av dens konklusjoner.

Tolkbarheten tilbudt av CoT prompting er spesielt verdifull i domener hvor resoneringprosessen selv er av interesse, som i utdannelsessammenheng eller i systemer som krever forklarbar AI. Ved å gi innsikt i modellens resonering, ermöglicher CoT prompting tillit og ansvar i bruken av store språkmodeller.

Potensial for Generalisering til Ulike Resoneringoppgaver

CoT prompting har vist sitt potensial for å generalisere til en rekke resoneringoppgaver. Mens teknikken har vært suksessfullt brukt i spesifikke domener som aritmetisk resonering, sunn fornuft og symbolisk resonering, kan de underliggende prinsippene til CoT prompting utvides til å håndtere andre typer komplekse resoneringoppgaver.

Evnen til å generere mellomliggende resoneringsteg er en grunnleggende ferdighet som kan utnyttes over ulike problemområder. Ved å finjustere språkmodeller på datasett som demonstrerer den ønskede resoneringprosessen, kan CoT prompting tilpasses for å håndtere nye resoneringoppgaver, og utvide sin anvendelighet og innvirkning.

Fremme Utviklingen av Mer Kapable AI-Systemer

CoT prompting spiller en kritisk rolle i å fremme utviklingen av mer kapable og intelligente AI-systemer. Ved å forbedre resoneringsevnen til store språkmodeller, bidrar CoT prompting til å skape AI-systemer som kan håndtere komplekse problemer og vise høyere nivåer av forståelse.

Ettersom AI-systemer blir mer avanserte og utplasseres i ulike domener, blir evnen til å utføre komplekse resoneringoppgaver stadig viktigere. CoT prompting tilbyr en kraftfull teknikk for å forbedre resoneringsevnen til disse systemene, og ermögplier dem å håndtere mer komplekse problemer og ta mer informerte beslutninger.

En Rask Oppsummering

CoT prompting er en kraftfull teknikk som forbedrer resoneringsevnen til store språkmodeller ved å generere mellomliggende resoneringsteg. Ved å bryte ned komplekse problemer i mindre, mer håndterbare underproblemer, ermöglicher CoT prompting modeller å håndtere komplekse resoneringoppgaver mer effektivt. Denne tilnærmingen forbedrer ytelsen, forbedrer tolkbarheten og fremmer utviklingen av mer kapable AI-systemer.

FAQ

Hvordan fungerer Chain-of-Thought Prompting (CoT)?

CoT prompting fungerer ved å generere en rekke av mellomliggende resoneringsteg som guider språkmodellen gjennom resoneringprosessen, og bryter ned komplekse problemer i mindre, mer håndterbare underproblemer.

Hva er fordelene med å bruke Chain-of-Thought Prompting?

Fordelene med CoT prompting inkluderer forbedret ytelse på komplekse resoneringoppgaver, forbedret tolkbarhet av resoneringprosessen, potensial for generalisering til ulike resoneringoppgaver og fremme utviklingen av mer kapable AI-systemer.

Hva er noen eksempler på oppgaver som kan forbedres med Chain-of-Thought Prompting?

Noen eksempler på oppgaver som kan forbedres med CoT prompting inkluderer aritmetisk resonering, sunn fornuft resonering, symbolisk resonering og andre komplekse resoneringoppgaver som krever flere steg av logisk tenkning.