Anderson's hoek

De toekomst van RAG-Augmented Image Generation

Generatieve diffusiemodellen zoals Stable Diffusion, Flux en videomodellen zoals Hunyuan vertrouwen op kennis die is opgedaan tijdens een enkele, resource-intensieve trainingssessie met behulp van een vaste dataset. Alle concepten die na deze training worden geïntroduceerd – aangeduid als de kennisgrens – ontbreken in het model, tenzij aangevuld via scherpstellen of externe aanpassingstechnieken zoals Aanpassing van lage rang (LoRA-bestand).

Het zou daarom ideaal zijn als een generatief systeem dat afbeeldingen of video's uitstuurt, neem contact op met online bronnen en ze indien nodig in het generatieproces brengen. Op deze manier zou bijvoorbeeld een diffusiemodel dat niets weet over de allerlaatste Apple- of Tesla-release toch afbeeldingen kunnen produceren met deze nieuwe producten.

Wat taalmodellen betreft, zijn de meesten van ons bekend met systemen zoals Perplexity, Notebook LM en ChatGPT-4o, die nieuwe externe informatie in een Ophalen Augmented Generation (RAG)-model.

RAG-processen maken de reacties van ChatGPT 4o relevanter. Bron: https://chatgpt.com/

Dit is echter een ongebruikelijke voorziening als het gaat om het genereren van afbeeldingen, en ChatGPT zal toegeven dat het op dit gebied zijn eigen beperkingen heeft:

ChatGPT 4o heeft op basis van de algemene lijn en de geïnterpreteerde beschrijvingen een goede inschatting gemaakt van de visualisatie van een gloednieuwe horlogerelease. Het kan echter geen nieuwe beelden 'absorberen' en integreren in een op DALL-E gebaseerde generatie.

Het opnemen van extern opgehaalde gegevens in een gegenereerde afbeelding is een uitdaging, omdat de binnenkomende afbeelding eerst moet worden opgesplitst in tokens en embeddings. Deze moeten vervolgens worden gekoppeld aan de dichtstbijzijnde getrainde domeinkennis van het model over het onderwerp.

Hoewel dit proces effectief werkt voor post-trainingshulpmiddelen zoals ControleNetblijven dergelijke manipulaties grotendeels oppervlakkig en leiden ze in feite tot een rendering-pijplijn waarin de opgehaalde afbeelding wordt doorgestuurd, zonder deze echter diepgaand te integreren in de interne representatie van het model.

Als gevolg hiervan mist het model het vermogen om nieuwe perspectieven te genereren op de manier waarop neurale renderingsystemen dat wel doen. Nerf kunnen, die scènes construeren met een echt ruimtelijk en structureel begrip.

Volwassen logica

Een vergelijkbare beperking geldt voor RAG-gebaseerde query's in Large Language Models (LLM's), zoals Perplexity. Wanneer een model van dit type extern opgehaalde data verwerkt, functioneert het net als een volwassene die put uit een leven vol kennis om waarschijnlijkheden over een onderwerp af te leiden.

Maar net zoals iemand nieuwe informatie niet met terugwerkende kracht kan integreren in het cognitieve raamwerk dat zijn fundamentele wereldbeeld vormgaf – toen zijn vooroordelen en vooroordelen nog in ontwikkeling waren – kan een LLM nieuwe kennis niet naadloos integreren in zijn vooraf getrainde structuur.

In plaats daarvan kan het alleen de nieuwe gegevens 'beïnvloeden' of naast de bestaande, geïnternaliseerde kennis leggen. Daarbij worden geleerde principes gebruikt om te analyseren en te speculeren in plaats van om op fundamenteel niveau te synthetiseren.

Dit tekort aan gelijkwaardigheid tussen naast elkaar en geïnternaliseerd generatie zal waarschijnlijk duidelijker zichtbaar zijn in een gegenereerde afbeelding dan in een op taal gebaseerde generatie: de diepere netwerkverbindingen en toegenomen creativiteit van 'native' (in plaats van op RAG gebaseerde) generatie zijn tot stand gekomen in verschillende studies.

Verborgen risico's van RAG-geschikte beeldgeneratie

Zelfs als het technisch haalbaar zou zijn om opgehaalde internetafbeeldingen naadloos te integreren in nieuw gesynthetiseerde afbeeldingen op een RAG-achtige manier, zouden veiligheidsgerelateerde beperkingen een extra uitdaging vormen.

Veel datasets die worden gebruikt voor het trainen van generatieve modellen zijn samengesteld om de aanwezigheid van expliciete, racistische of gewelddadige content, naast andere gevoelige categorieën, te minimaliseren. Dit proces is echter niet perfect en restassociaties kunnen blijven bestaan. Om dit te beperken, vertrouwen systemen als DALL·E en Adobe Firefly op secundaire filtermechanismen die zowel invoerprompts als gegenereerde uitvoer screenen op verboden content.

Als gevolg hiervan zou een eenvoudig NSFW-filter – een filter dat voornamelijk openlijk expliciete content blokkeert – onvoldoende zijn om de aanvaardbaarheid van opgehaalde RAG-gebaseerde data te evalueren. Dergelijke content kan nog steeds aanstootgevend of schadelijk zijn op manieren die buiten de vooraf gedefinieerde moderatieparameters van het model vallen, en mogelijk materiaal introduceren dat de AI niet contextueel kan beoordelen.

ontdekking van een recente kwetsbaarheid In het door de CCP geproduceerde DeepSeek, dat is ontworpen om discussies over verboden politieke inhoud te onderdrukken, wordt benadrukt hoe alternatieve invoerpaden kunnen worden uitgebuit om de ethische waarborgen van een model te omzeilen. Dit geldt vermoedelijk ook voor willekeurige nieuwe gegevens die van internet worden gehaald, wanneer deze bedoeld zijn om te worden opgenomen in een nieuwe generatie afbeeldingen.

RAG voor beeldgeneratie

Ondanks deze uitdagingen en lastige politieke aspecten zijn er een aantal projecten ontstaan die proberen RAG-gebaseerde methoden te gebruiken om nieuwe data in visuele generaties te integreren.

Opnieuw

De 2023 Op ophalen gebaseerde diffusie (ReDi) project is een leervrij raamwerk dat de inferentie van diffusiemodellen versnelt door vergelijkbare trajecten uit een vooraf berekende kennisbank.

Waarden uit een dataset kunnen worden 'geleend' voor een nieuwe generatie in ReDi. Bron: https://arxiv.org/pdf/2302.02285

In de context van diffusiemodellen is een traject het stapsgewijze pad dat het model aflegt om een afbeelding te genereren van puur lawaaiNormaal gesproken vindt dit proces geleidelijk plaats in meerdere stappen, waarbij elke stap het beeld iets verfijnder maakt.

ReDi versnelt dit door een aantal van die stappen over te slaan. In plaats van elke afzonderlijke stap te berekenen, haalt het een vergelijkbaar traject uit een database en springt het vooruit naar een later punt in het proces. Dit vermindert het aantal benodigde berekeningen, waardoor diffusiegebaseerde beeldgeneratie veel sneller wordt, terwijl de kwaliteit nog steeds hoog blijft.

ReDi wijzigt het diffusiemodel niet gewichten, maar gebruikt in plaats daarvan de kennisbank om tussenstappen over te slaan, waardoor het aantal functieschattingen dat nodig is voor bemonstering wordt verminderd.

Dit is natuurlijk niet hetzelfde als het willekeurig opnemen van specifieke afbeeldingen in een generatieverzoek, maar het heeft wel betrekking op soortgelijke soorten generaties.

Uitgebracht in 2022, het jaar waarin latente diffusiemodellen gevangen In de publieke verbeelding lijkt ReDi een van de eerste op verspreiding gebaseerde benaderingen te zijn die op een RAG-methodologie leunt.

Hoewel vermeld moet worden dat Facebook Research in 2021 Instantie-geconditioneerde GAN, die probeerde te conditioneren GAN afbeeldingen op nieuwe beeldinvoer, dit soort projectie in de latente ruimte is in de literatuur zeer gebruikelijk, zowel voor GAN's als voor diffusiemodellen. De uitdaging is om een dergelijk proces trainingsvrij en in realtime functioneel te maken, zoals LLM-gerichte RAG-methoden.

RDM

Een andere vroege poging tot het genereren van RAG-verbeterde beelden is Retrieval-Augmented Diffusion-modellen (RDM), die een semi-parametrisch benadering van generatieve beeldsynthese. Terwijl traditionele diffusiemodellen alle geleerde visuele kennis opslaan binnen hun neurale netwerkparameters, vertrouwt RDM op een externe beelddatabase:

Dichtstbijzijnde buren opgehaald in een illustratieve pseudo-query in RDM*.

Tijdens de training haalt het model op naaste buren (visueel of semantisch vergelijkbare afbeeldingen) uit de externe database, om het generatieproces te begeleiden. Hierdoor kan het model zijn outputs conditioneren op visuele instanties uit de echte wereld.

Het ophaalproces wordt aangestuurd door CLIP insluitingen, die zijn ontworpen om de opgehaalde afbeeldingen te dwingen zinvolle overeenkomsten te vertonen met de query, en om ook nieuwe informatie te bieden om de generatie te verbeteren.

Hierdoor is er minder afhankelijkheid van parameters en worden kleinere modellen mogelijk die concurrerende resultaten opleveren zonder dat er uitgebreide trainingsdatasets nodig zijn.

De RDM-aanpak ondersteunt post-hoc Wijzigingen: onderzoekers kunnen de database tijdens de inferentie verwisselen, waardoor er direct aanpassingen kunnen worden gedaan aan nieuwe stijlen, domeinen of zelfs compleet andere taken, zoals stilering of klassevoorwaardelijke synthese.

In de onderste rijen zien we de dichtstbijzijnde buren die in het diffusieproces in RDM* worden betrokken.

Een belangrijk voordeel van RDM is de mogelijkheid om de generatie van afbeeldingen te verbeteren zonder het model opnieuw te trainen. Door simpelweg de retrieval-database te wijzigen, kan het model generaliseren naar nieuwe concepten waarop het nooit expliciet is getraind. Dit is met name handig voor toepassingen waarbij domeinverschuivingen zoals het genereren van medische beelden op basis van veranderende datasets of het aanpassen van tekst-naar-beeldmodellen voor creatieve toepassingen.

Een negatief punt is dat dit soort ophaalmethoden afhankelijk zijn van de kwaliteit en relevantie van de externe database. Hierdoor is datacuratie een belangrijke factor bij het bereiken van generaties van hoge kwaliteit. Bovendien is deze aanpak nog lang niet het equivalent van de op RAG gebaseerde interacties die typisch zijn voor commerciële LLM's op het gebied van beeldsynthese.

ReMoDiffuus

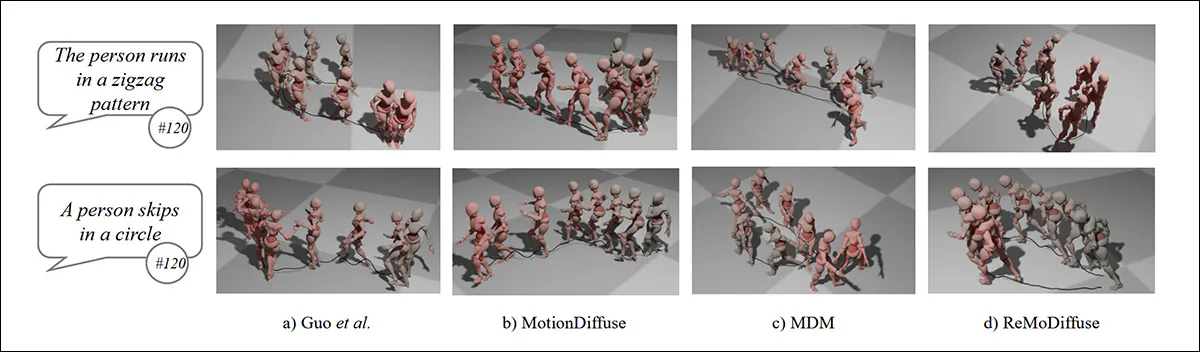

ReMoDiffuus is een retrieval-augmented motion diffusion model ontworpen voor 3D menselijke bewegingsgeneratie. In tegenstelling tot traditionele bewegingsgeneratiemodellen die uitsluitend op geleerde representaties vertrouwen, haalt ReMoDiffuse relevante bewegingsmonsters op uit een grote bewegingsdataset en integreert deze in het denoisingproces, in een schema dat vergelijkbaar is met RDM (zie hierboven).

Vergelijking van RAG-versterkte ReMoDiffuse (meest rechts) met eerdere methoden. Bron: https://arxiv.org/pdf/2304.01116

Hierdoor kan het model bewegingssequenties genereren die natuurlijker en diverser zijn en die semantisch trouw blijven aan de tekstprompts van de gebruiker.

ReMoDiffuse maakt gebruik van een innovatieve hybride ophaalmechanisme, die bewegingsreeksen selecteert op basis van zowel semantische als kinematische overeenkomsten, met als doel ervoor te zorgen dat de opgehaalde bewegingen niet alleen thematisch relevant zijn, maar ook fysiek aannemelijk wanneer ze in de nieuwe generatie worden geïntegreerd.

Het model verfijnt vervolgens deze opgehaalde monsters met behulp van een Semantiek-gemoduleerde transformator, die op selectieve wijze kennis uit de opgehaalde bewegingen integreert, terwijl de karakteristieke kwaliteiten van de gegenereerde reeks behouden blijven:

Schema voor de pijplijn van ReMoDiffuse.

De projecten Conditie Mengsel Met deze techniek kan het model beter generaliseren over verschillende prompts en ophaalcondities, worden opgehaalde bewegingsmonsters in evenwicht gebracht met tekstprompts tijdens de generatie en kan worden aangepast hoeveel gewicht elke bron bij elke stap krijgt.

Dit kan helpen onrealistische of repetitieve outputs te voorkomen, zelfs voor zeldzame prompts. Het pakt ook de Schaalgevoeligheidsprobleem die vaak voorkomt in de classificatievrije begeleiding technieken die gewoonlijk in diffusiemodellen worden gebruikt.

RA-CM3

Stanford's 2023 PapeMet Retrieval-Augmented Multimodal Language Modeling (RA-CM3) kan het systeem op het moment van de inferentie toegang krijgen tot informatie uit de echte wereld:

Het Retrieval-Augmented Multimodal Language Modeling (RA-CM3)-model van Stanford maakt gebruik van van internet opgehaalde afbeeldingen om het generatieproces te verbeteren, maar blijft een prototype zonder openbare toegang. Bron: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integreert opgehaalde tekst en afbeeldingen in de generatiepijplijn, waardoor zowel tekst-naar-afbeelding als afbeelding-naar-tekstsynthese wordt verbeterd. CLIP gebruiken voor ophalen en een Transformator Als generator verwijst het model naar relevante multimodale documenten voordat een uitvoer wordt samengesteld.

Benchmarks op MS-COCO laten opmerkelijke verbeteringen zien ten opzichte van DALL-E en soortgelijke systemen, met een score van 12 punten Fréchet Inception-afstand (FID)-reductie, met veel lagere rekenkosten.

Echter, net als bij andere retrieval-augmented benaderingen, internaliseert RA-CM3 zijn opgehaalde kennis niet naadloos. In plaats daarvan legt het nieuwe data op zijn vooraf getrainde netwerk, net zoals een LLM reacties met zoekresultaten aanvult. Hoewel deze methode de feitelijke nauwkeurigheid kan verbeteren, vervangt het niet de noodzaak van trainingsupdates in domeinen waar diepe synthese vereist is.

Bovendien lijkt het erop dat er nog geen praktische implementatie van dit systeem is uitgebracht, zelfs niet op een API-gebaseerd platform.

EchteRAG

A nieuwe release uit China, en degene die deze blik op RAG-versterkte generatieve beeldsystemen heeft aangewakkerd, wordt genoemd Retrieval-Augmented Realistische Beeldgeneratie (EchteRAG).

Externe afbeeldingen getekend in RealRAG (onder in het midden). Bron: https://arxiv.o7rg/pdf/2502.00848

RealRAG haalt actuele afbeeldingen van relevante objecten op uit een database die is samengesteld uit openbaar beschikbare datasets zoals IMAGEnet, Stanford-auto's, Stanford-hondenen Oxford BloemenVervolgens worden de opgehaalde afbeeldingen geïntegreerd in het generatieproces, waardoor kennishiaten in het model worden aangepakt.

Een belangrijk onderdeel van RealRAG is zelfreflectief contrasterend leren, die een retrievalmodel traint om informatieve referentiebeelden te vinden, in plaats van alleen maar afbeeldingen te selecteren visueel vergelijkbaar degenen.

De auteurs stellen:

'Ons belangrijkste inzicht is dat we een retriever moeten trainen die afbeeldingen ophaalt die buiten de generatieruimte van de generator blijven, maar wel dicht bij de representatie van tekstprompts liggen.

'Hiertoe genereren we eerst afbeeldingen van de gegeven tekstprompts en gebruiken we de gegenereerde afbeeldingen vervolgens als query's om de meest relevante afbeeldingen op te halen in de op echte objecten gebaseerde database. Deze meest relevante afbeeldingen worden gebruikt als reflectieve negatieven.'

Deze aanpak zorgt ervoor dat de opgehaalde afbeeldingen bijdragen ontbrekende kennis aan het generatieproces, in plaats van bestaande vooroordelen in het model te versterken.

Helemaal links de opgehaalde referentieafbeelding; in het midden, zonder RAG; helemaal rechts, met gebruik van de opgehaalde afbeelding.

De afhankelijkheid van de kwaliteit van het ophalen en de databasedekking betekent echter dat de effectiviteit ervan kan variëren, afhankelijk van de beschikbaarheid van hoogwaardige referenties. Als een relevante afbeelding niet in de dataset bestaat, kan het model nog steeds moeite hebben met onbekende concepten.

RealRAG is een zeer modulaire architectuur die compatibel is met meerdere andere generatieve architecturen, waaronder op U-Net gebaseerde, DiT-gebaseerde en autoregressieve modellen.

Over het algemeen brengt het ophalen en verwerken van externe beelden extra rekenkracht met zich mee, en de prestaties van het systeem zijn afhankelijk van hoe goed het ophaalmechanisme werkt. generaliseert over verschillende taken en datasets.

Conclusie

Dit is een representatief in plaats van een uitputtend overzicht van multimodale generatieve systemen die afbeeldingen ophalen. Sommige systemen van dit type gebruiken ophalen uitsluitend om het visuele begrip of de curatie van datasets te verbeteren, naast andere uiteenlopende motieven, in plaats van te proberen afbeeldingen te genereren. Een voorbeeld is internet Explorer.

Veel van de andere RAG-geïntegreerde projecten in de literatuur blijven onuitgebracht. Prototypes, met alleen gepubliceerd onderzoek, omvatten Opnieuw verbeelden, die – ondanks zijn herkomst van Google – alleen toegang heeft tot afbeeldingen uit een lokale aangepaste database.

Ook in november 2024, Baidu aangekondigd Op afbeeldingen gebaseerde opvraging-versterkte generatie (iRAG), een nieuw platform dat opgehaalde afbeeldingen 'uit een database' gebruikt. Hoewel iRAG naar verluidt beschikbaar is op het Ernie-platform, lijken er geen verdere details te zijn over dit ophaalproces, dat lijkt te vertrouwen op een lokaal database (dat wil zeggen lokaal bij de service en niet rechtstreeks toegankelijk voor de gebruiker).

Verder de 2024 papier Geünificeerde tekst-naar-afbeelding-generatie en -opvraging biedt nog een andere RAG-gebaseerde methode om externe afbeeldingen te gebruiken om resultaten te vergroten op het moment van generatie – opnieuw vanuit een lokale database in plaats van ad hoc internetbronnen.

De belangstelling voor RAG-gebaseerde augmentatie bij het genereren van afbeeldingen zal zich waarschijnlijk richten op systemen die afbeeldingen van internet of door gebruikers geüploade afbeeldingen direct in het generatieproces kunnen opnemen en die gebruikers in staat stellen om deel te nemen aan de keuzes of bronnen van afbeeldingen.

Dit is echter een grote uitdaging om ten minste twee redenen. Ten eerste hangt de effectiviteit van dergelijke systemen doorgaans af van sterk geïntegreerde relaties die ontstaan tijdens een trainingsproces dat veel middelen vergt. Ten tweede is dit vanwege zorgen over veiligheid, legaliteit en auteursrechtbeperkingen, zoals eerder opgemerkt, een onwaarschijnlijke functie voor een API-gestuurde webservice en voor commerciële implementatie in het algemeen.

* Source: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Eerste publicatie dinsdag 4 februari 2025