Andersons hoek

Censureren van AI-modellen werkt niet goed, blijkt uit onderzoek

Pogingen om AI-afbeeldingsgeneratoren te censureren door verboden inhoud (zoals pornografie, geweld of auteursrechtelijk beschermde stijlen) uit de getrainde modellen te wissen, zijn niet succesvol: een nieuw onderzoek ontdekt dat huidige concept-wisingsmethoden toelaten dat ‘verboden’ kenmerken doorsijpelen in niet-gerelateerde afbeeldingen en ook niet voorkomen dat nauw verwante versies van de vermeende ‘gewiste’ inhoud verschijnen.

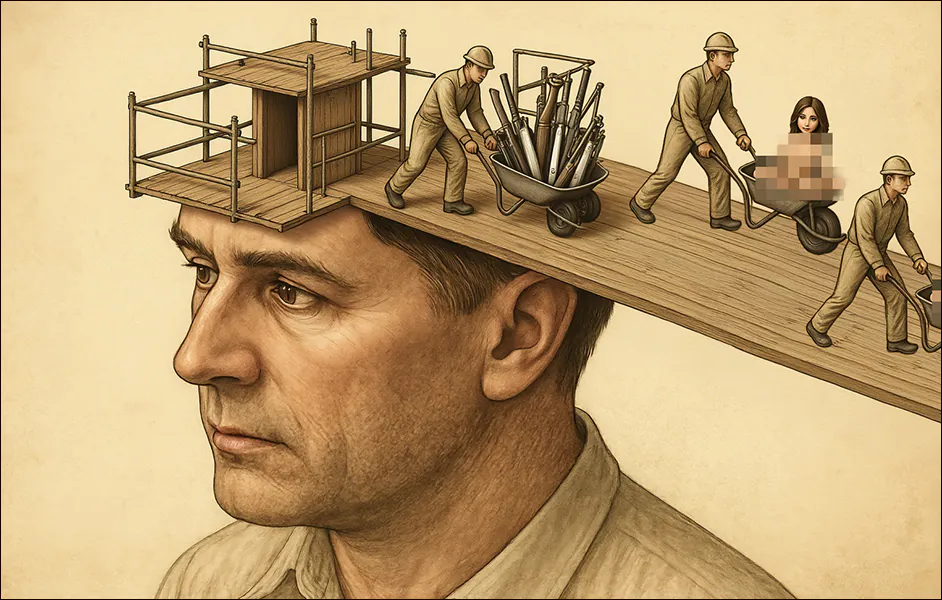

Als bedrijven die basis-AI-modellen produceren, deze niet kunnen beschermen tegen misbruik voor het produceren van afkeurenswaardige of illegale materialen, lopen ze het risico vervolgd te worden en/of te worden gesloten. Omgekeerd zijn leveranciers die hun modellen alleen beschikbaar stellen via een API, zoals Adobe’s Firefly generatieve engine, in staat om zich geen zorgen te maken over wat hun modellen kunnen creëren, aangezien zowel de prompt van de gebruiker als de resulterende output worden geïnspecteerd en gesanitiseerd:

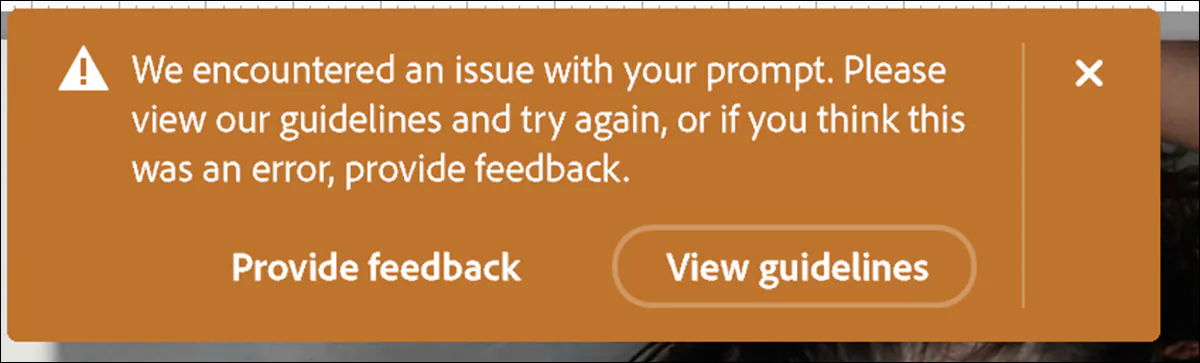

Adobe’s Firefly-systeem, gebruikt in tools zoals Photoshop, weigert soms een generatieve aanvraag direct door de prompt te blokkeren voordat er iets is gecreëerd. Andere keren genereert het de afbeelding, maar blokkeert het resultaat na herziening. Dit soort mid-process-weigering kan ook gebeuren in ChatGPT, wanneer het model een reactie start, maar deze afbreekt nadat het een beleidsovertreding heeft herkend – en soms kan men de geannuleerde afbeelding kort zien tijdens dit proces.

Echter, API-achtige filters van deze soort kunnen meestal worden geneutraliseerd door gebruikers op lokaal geïnstalleerde modellen, inclusief vision-language modellen (VLM’s) die de gebruiker mogelijk wil aanpassen door middel van lokale training op aangepaste gegevens.

In de meeste gevallen is het uitschakelen van dergelijke bewerkingen triviaal, waarbij een functieaanroep in Python moet worden uitgecommentariëerd (hoewel dergelijke hacks meestal moeten worden herhaald of opnieuw uitgevonden na framework-updates).

Vanuit een bedrijfsperspectief is het moeilijk te begrijpen hoe dit een probleem kan zijn, aangezien een API-benadering de corporate controle over de workflow van de gebruiker maximaliseert. Vanuit het perspectief van de gebruiker is het echter waarschijnlijk dat zowel de kosten van API-only-modellen als het risico van verkeerde of overmatige censuur hen ertoe zal brengen om lokaal geïnstalleerde open source-alternatieven te downloaden en aan te passen – tenminste, waar de FOSS-licentie gunstig is.

Het laatste significante model dat zonder enige poging tot ingebouwde censuur werd uitgebracht, was Stable Diffusion V1.5, bijna drie jaar geleden. Later leidde de onthulling dat de trainingscorpora CSAM-gegevens bevatten tot groeiende oproepen om de beschikbaarheid ervan te verbieden, en de verwijdering uit de Hugging Face-repository in 2024.

Knip het uit!

Cynici beweren dat een bedrijfsbelang in het censureren van lokaal installeerbare generatieve AI-modellen uitsluitend gebaseerd is op zorgen over juridische aansprakelijkheid, mochten hun frameworks worden gepubliceerd voor het faciliteren van illegale of afkeurenswaardige inhoud.

In werkelijkheid zijn sommige ‘lokaal-vriendelijke’ open source-modellen niet zo moeilijk te decensureren (zoals Stable Diffusion 1.5 en DeepSeek R1).

Door contrast, werd de recente release van Black Forest Lab’s Flux Kontext model serie gekenmerkt door het bedrijfs opvallende toewijding om de hele Kontext-reeks te bowdleriseren. Dit werd bereikt door zorgvuldige datacuratie en gerichte fine-tuning na training, ontworpen om eventuele resterende neiging tot NSFW- of verboden inhoud te verwijderen.

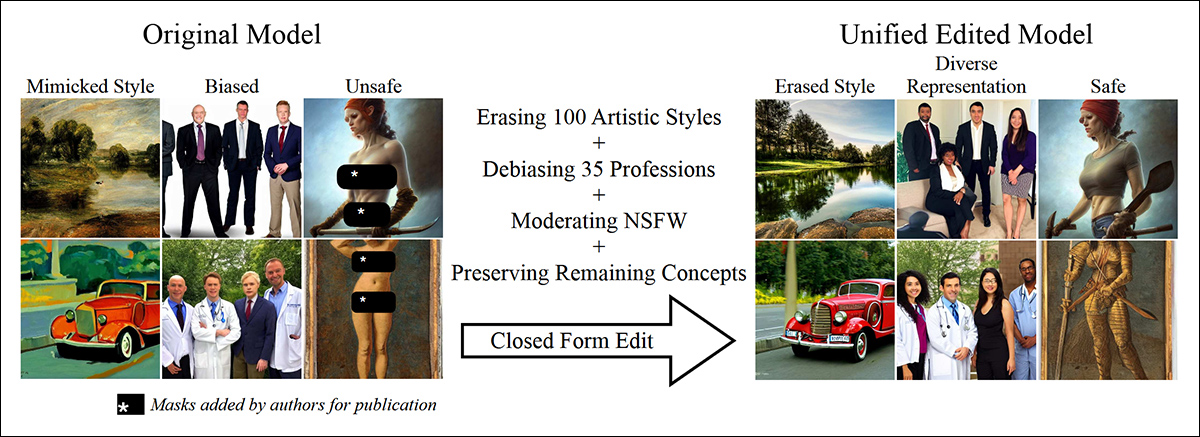

Dit is waar het actiepunt de afgelopen 2-3 jaar in de onderzoekssector is geweest: met een focus op het achteraf repareren van modellen met onder-curated gegevens. Aanbod van deze soort omvat Unified Concept Editing in Diffusion Models (UCE); Reliable and Efficient Concept Erasure of Text-to-Image Diffusion Models (RECE); Mass Concept Erasure in Diffusion Models (MACE); en concept-Semi-Permeable structure is injected as a Membrane (SPM):

Het paper van 2024 ‘Unified Concept Editing in Diffusion Models’ bood gesloten-vorm edits aan voor aandachtsgewichten, waardoor efficiënte bewerking van meerdere concepten in tekst-naar-afbeelding-modellen mogelijk werd. Maar houdt de methode stand tegen onderzoek? Source: https://arxiv.org/pdf/2308.14761

Hoewel dit een efficiënte benadering is (hyperschaalcollecties zoals LAION zijn veel te groot om handmatig te cureren), is het niet noodzakelijkerwijs een effectieve: volgens een nieuw Amerikaans onderzoek werken geen van de bovengenoemde bewerkingsprocedures – die de staat-van-de-kunst in post-training AI-modelmodificatie vertegenwoordigen – eigenlijk heel goed.

De auteurs vonden dat deze Concept Erasure Techniques (CET’s) meestal gemakkelijk kunnen worden omzeild, en dat zelfs waar ze effectief zijn, ze aanzienlijke neveneffecten hebben:

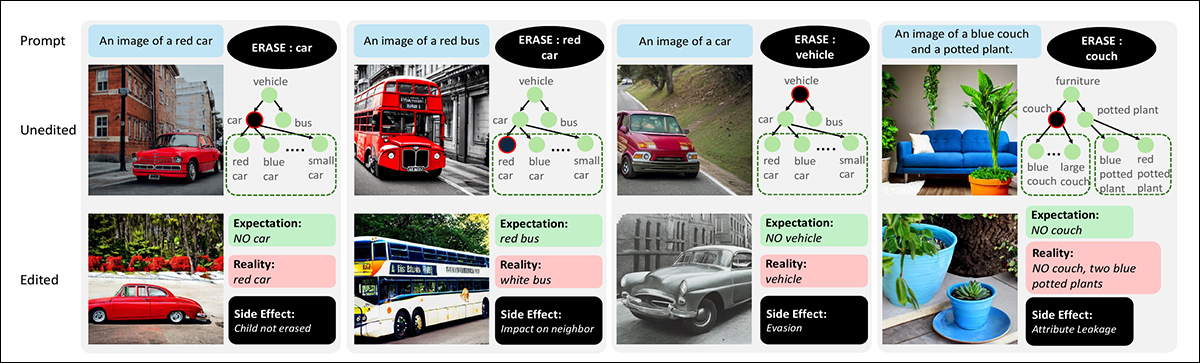

Effecten van concept-wissing op tekst-naar-afbeelding-modellen. Elke kolom toont een prompt en het concept dat voor wissing is gemarkeerd, samen met gegenereerde uitvoer voor en na bewerking. Hiërarchieën geven ouder-kind-relaties tussen concepten aan. De voorbeelden benadrukken veelvoorkomende neveneffecten, waaronder het falen om kind-concepten te wissen, onderdrukking van naburige concepten, ontwijking door herformulering en overdracht van gewiste kenmerken naar niet-gerelateerde objecten. Source: https://arxiv.org/pdf/2508.15124

De auteurs vonden dat de leidende huidige concept-wisingsmethoden falen om compositional prompts te blokkeren (bijvoorbeeld rode auto of kleine houten stoel); vaak laten subklassen doorslippen, zelfs nadat een oudercategorie is gewist (zoals auto of bus die blijven verschijnen nadat voertuig is verwijderd); en introduceren nieuwe problemen zoals kenmerklekkage (waarbij, bijvoorbeeld, het verwijderen van blauwe bank de model ertoe kan brengen om een blauwe stoel te genereren).

In meer dan 80% van de testgevallen, wiste het verwijderen van een brede concept zoals voertuig niet de model om specifieke voertuig-instanties zoals auto’s of bussen te genereren.

Bewerking, merkt het paper op, veroorzaakt ook aandachtskaarten (de delen van de model die beslissen waar te focussen in de afbeelding) te verspreiden, waardoor de kwaliteit van de uitvoer verzwakt.

Interessant is dat het paper ontdekt dat het wissen van verwante getrainde concepten een voor een beter werkt dan het proberen om ze allemaal tegelijk te verwijderen – hoewel het niet alle tekortkomingen van de bestudeerde bewerkingsmethoden wegneemt:

Vergelijking van progressieve en alles-tegelijk-wissen-strategieën. Wanneer alle varianten van ‘teddybeer’ tegelijk worden gewist, gaat de model door met het genereren van beer-achtige objecten. Het wissen van de varianten stap voor stap is effectiever, waardoor de model de doelconcept meer betrouwbaar onderdrukt.

Hoewel de onderzoekers momenteel geen oplossing kunnen bieden voor de problemen die het paper schetst, hebben ze een nieuwe dataset en benchmark ontwikkeld die later onderzoeksprojecten kan helpen om te begrijpen of hun eigen ‘gecensureerde’ modellen zoals verwacht werken.