Andersons hoek

Visuele Analogieën naar AI Brengen

Huidige AI-modellen kunnen geen ‘relationele’ beeldovereenkomsten herkennen, zoals hoe de lagen van de aarde lijken op een perzik, en missen daarmee een belangrijk aspect van hoe mensen beelden waarnemen.

Hoewel er veel computer vision-modellen zijn die in staat zijn om beelden te vergelijken en overeenkomsten tussen hen te vinden, hebben de huidige generatie van vergelijkingsystemen weinig of geen imaginatieve capaciteit. Denk aan enkele van de liedteksten in het klassieke nummer uit de jaren 60, Windmills of Your Mind:

Als een carrousel die draait, rondjes draait om de maan

Als een klok wiens wijzers langs de minuten van zijn gezicht gaan

En de wereld is als een appel die stilzwijgend in de ruimte draait

Vergelijkingen van deze soort vertegenwoordigen een domein van poëtische allusie dat voor mensen op een manier betekenisvol is die verder gaat dan artistieke expressie; het is verbonden met hoe we onze perceptuele systemen ontwikkelen; terwijl we ons ‘object’-domein creëren, ontwikkelen we een capaciteit voor visuele overeenkomst, zodat – bijvoorbeeld – dwarsdoorsneden van een perzik en de planeet Aarde, of fractale recursies zoals koffiespiralen en galaxy-branches, bij ons geregistreerd worden als analoog.

Op deze manier kunnen we verbindingen tussen ogenschijnlijk niet-verbonden objecten en soorten objecten afleiden en systemen afleiden (zoals zwaartekracht, impuls en oppervlaktecohesie) die op verschillende domeinen en schalen kunnen worden toegepast.

Het Zien van Dingen

Zelfs de nieuwste generatie van beeldvergelijkingssystemen, zoals Learned Perceptual Image Patch Similarity (LPIPS) en DINO, die zijn geïnformeerd door menselijke feedback, voeren alleen letterlijke oppervlaktevergelijkingen uit.

Hun capaciteit om gezichten te vinden waar geen gezichten zijn – d.w.z. pareidolie – vertegenwoordigt niet het soort visuele overeenkomstmechanismen dat mensen ontwikkelen, maar gebeurt omdat gezichtzoekende algoritmes gebruikmaken van lage-niveau-gezichtsstructuuropvallende kenmerken die soms overeenkomen met willekeurige objecten:

Voorbeelden van valse positieven voor gezichtsherkenning in de ‘Faces with Things’-dataset. Bron

Om te bepalen of machines echt onze imaginatieve capaciteit kunnen ontwikkelen om visuele overeenkomst te herkennen, hebben onderzoekers in de VS een onderzoek uitgevoerd naar Relationele Visuele Overeenkomst, waarbij een nieuwe dataset is gecreëerd en getraind om abstracte relaties te vormen tussen verschillende objecten die door een abstracte relatie zijn verbonden:

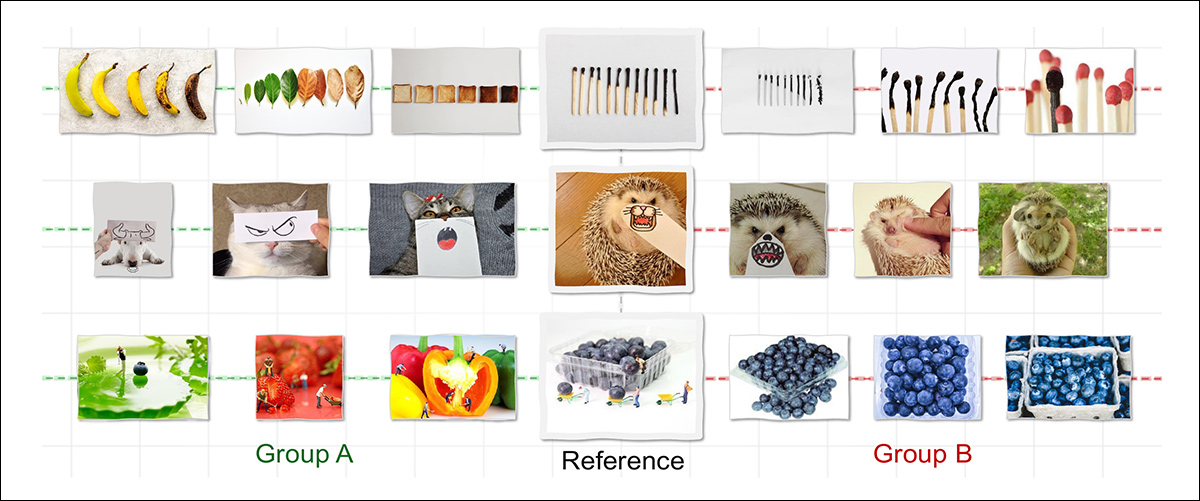

Meeste AI-modellen herkennen alleen overeenkomst als beelden oppervlaktekenmerken delen zoals vorm of kleur, waardoor ze alleen Groep B (hierboven) koppelen aan de referentie. Mensen daarentegen zien ook Groep A als soortgelijk – niet omdat de beelden op elkaar lijken, maar omdat ze dezelfde onderliggende logica volgen, zoals een transformatie over tijd. Het nieuwe onderzoek probeert deze soort structurele of relationele overeenkomst te reproduceren, met als doel machineperceptie dichter bij menselijke redenering te brengen. Bron: https://arxiv.org/pdf/2512.07833

De onderschriftsysteem dat is ontwikkeld voor de dataset, maakt ongebruikelijk abstracte onderschriften mogelijk, die zijn ontworpen om AI-systemen te dwingen zich te concentreren op basiskenmerken in plaats van specifieke lokale details:

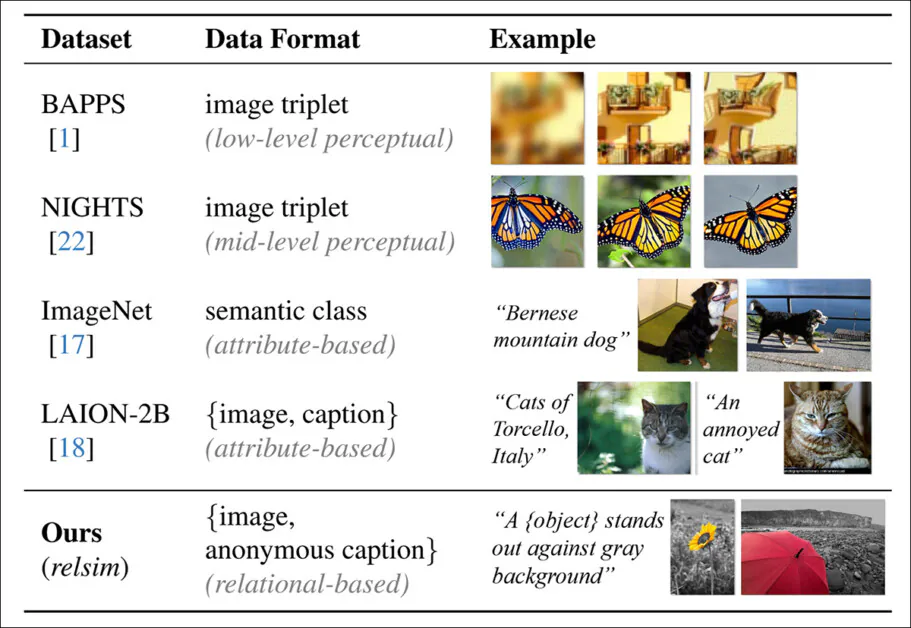

De voorspelde ‘anonieme’ onderschriften die bijdragen aan de ‘relsim’-metriek van de auteurs.

De gecureerde collectie en de ongebruikelijke onderschriftstijl voeden de nieuwe voorgestelde metriek relsim van de auteurs, die ze hebben fijn afgesteld in een visie-taalmodel (VLM).

Een vergelijking tussen de onderschriftstijl van typische datasets, die zich richt op kenmerkovereenkomst, en de relsim-benadering (onderste rij), die relationele overeenkomst benadrukt.

De nieuwe aanpak maakt gebruik van methoden uit de cognitieve wetenschap, met name Dedre Gentner’s Structure-Mapping-theorie (een studie naar analogie) en Amos Tversky’s definitie van relationele overeenkomst en kenmerkovereenkomst.

Van de bijbehorende projectwebsite, een voorbeeld van relationele overeenkomst. Bron

De auteurs stellen:

‘[Mensen] verwerken kenmerkovereenkomst perceptueel, maar relationele overeenkomst vereist conceptuele abstractie, vaak ondersteund door taal of voorafgaande kennis. Dit suggereert dat het herkennen van relationele overeenkomst eerst het begrijpen van het beeld vereist, het gebruik van kennis en het abstraheren van de onderliggende structuur.’

Het nieuwe artikel heet Relationele Visuele Overeenkomst en heeft een projectwebsite (zie de video aan het einde van dit artikel).

Methode

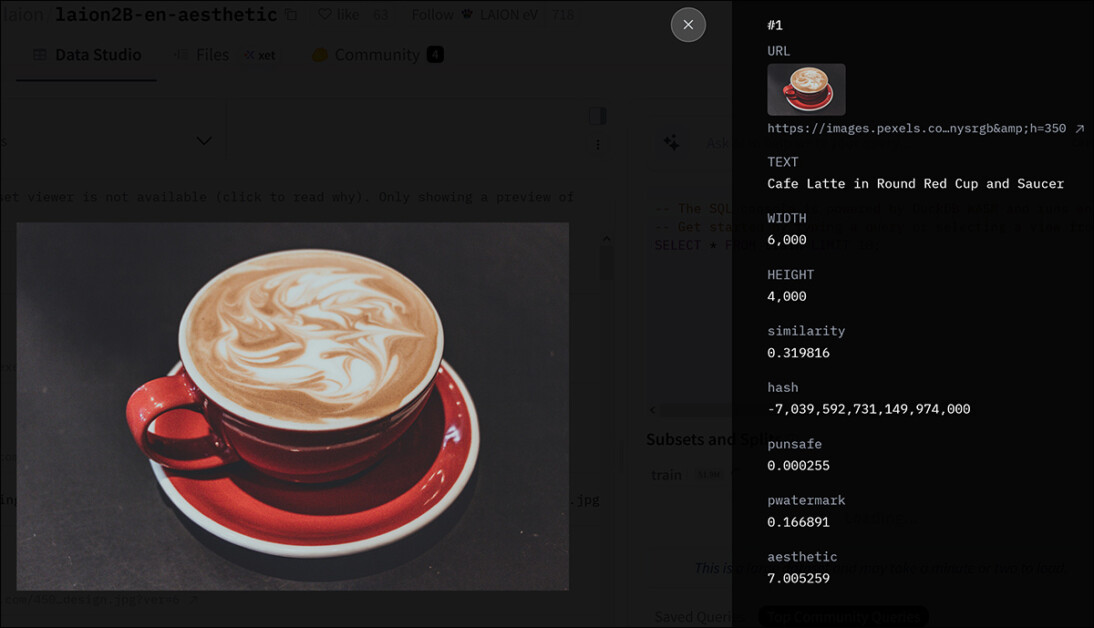

De onderzoekers gebruikten een van de bekendste hyperschaaldatasets als startpunt voor hun eigen collectie – LAION-2B:

Metagegevens voor een item in de LAION-2B-collectie. Bron

114.000 beelden die waarschijnlijk elastische relationele structuren bevatten, zijn geëxtraheerd uit LAION-2B, waarbij de filtering van de vele lagekwaliteitsbeelden in de minimaal gecureerde dataset is uitgevoerd.

Om een pipeline voor dit selectieproces te creëren, hebben de auteurs Qwen2.5-VL-7B gebruikt, waarbij 1.300 positieve en 11.000 negatieve door mensen gelabelde voorbeelden zijn gebruikt:

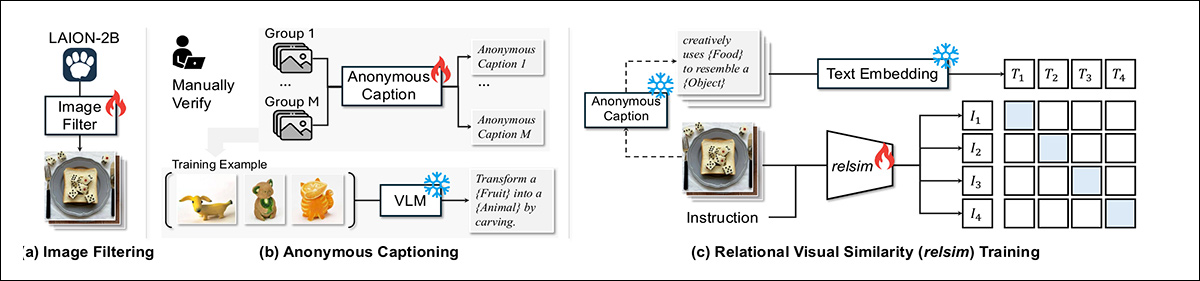

Het relsim-systeem wordt getraind in drie fasen: het filteren van beelden uit LAION-2B op relationele inhoud; het toewijzen van elke groep een gedeelde anonieme onderschrift die de onderliggende logica vastlegt; en het leren om beelden te koppelen aan die onderschriften met behulp van een contrastief verlies.

Het artikel vermeldt:

‘De annotators kregen de opdracht: “Kunt u een relationeel patroon, logica of structuur in dit beeld zien die nuttig kan zijn voor het creëren of koppelen van een ander beeld?”. Het fijn afgestelde model bereikt 93% overeenstemming met menselijke oordelen, en wanneer het op LAION-2B wordt toegepast, levert het N = 114k beelden op die als relationeel interessant zijn geïdentificeerd.’

Om relationele labels te genereren, hebben de onderzoekers Qwen gevraagd om de gedeelde logica achter sets van beelden te beschrijven zonder specifieke objecten te noemen. Deze abstractie was moeilijk te verkrijgen toen het model slechts één beeld zag, maar werd haalbaar toen meerdere voorbeelden de onderliggende patroon toonden.

Het resulterende groepsonderschrift verving specifieke termen met placeholders zoals ‘{Onderwerp}’ of ‘{Type van Beweging}’, waardoor ze breed toepasbaar werden.

Na menselijke verificatie werd elk onderschrift gekoppeld aan alle beelden in de groep. Meer dan 500 van dergelijke groepen werden gebruikt om het model te trainen, dat vervolgens werd toegepast op de 114.000 gefilterde beelden om een grote set van abstracte, relationeel geannoteerde voorbeelden te produceren.

Gegevens en Tests

Na het extraheren van relationele kenmerken met Qwen2.5-VL-7B, werd een model fijn afgesteld op de gegevens met LoRA, voor 15.000 stappen, via acht A100-GPU’s*. Voor de tekstzijde werden relationele onderschriften ingebed met all-MiniLM-L6-v2 van de Sentence-Transformers-bibliotheek.

De dataset van 114.000 onderschreven beelden werd gesplitst in 100.000 voor training en 14.000 voor evaluatie. Om het systeem te testen, werd een opzoekopstelling gebruikt: gegeven een querybeeld, moest het model een ander beeld uit een pool van 28.000 items vinden dat dezelfde relationele idee uitdrukte. De opzoekpool bevatte 14.000 evaluatiebeelden en 14.000 extra voorbeelden uit LAION-2B, met 1.000 queries willekeurig geselecteerd uit de evaluatieset voor benchmarking.

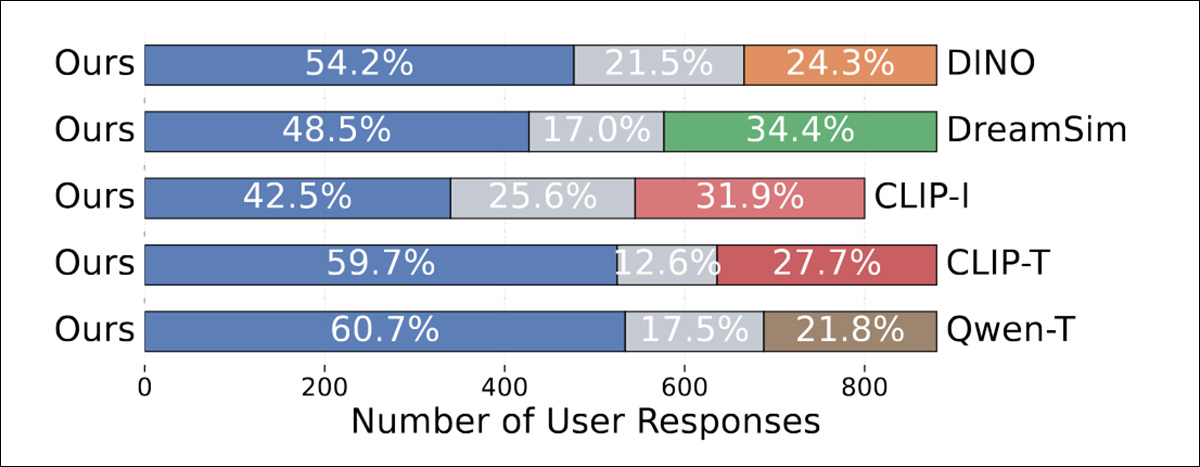

Om de kwaliteit van de opzoekopstelling te evalueren, werd GPT-4o gebruikt om de relationele overeenkomst tussen elk query- en opgehaald beeld te scoren op een schaal van 0 tot 10. Een afzonderlijke menselijke studie werd ook uitgevoerd om de gebruikersvoorkeur te meten (zie hieronder).

Elke deelnemer kreeg een anoniem querybeeld te zien met twee kandidaten, één opgehaald door de voorgestelde methode en de andere door een baseline. Deelnemers werden gevraagd welk beeld relationeel meer overeenkwam met het querybeeld, of als beide even dichtbij waren. Voor elke baseline werden 300 triplets gemaakt en beoordeeld door ten minste drie mensen elk, waardoor ongeveer 900 reacties ontstonden.

De relsim-benadering werd vergeleken met verschillende gevestigde beeld-tot-beeld-overeenkomstmethoden, waaronder de eerder genoemde LPIPS en DINO, evenals dreamsim en CLIP-I. Naast baselines die rechtstreeks overeenkomstscores tussen beeldparen berekenen, zoals LPIPS, DINO, dreamsim en CLIP-I, hebben de auteurs ook onderschrift-gebaseerde methoden getest waarbij Qwen werd gebruikt om een anoniem of abstract onderschrift voor elk beeld te genereren.; dit diende als de opzoekquery.

Twee opzoekvarianten werden geëvalueerd, met CLIP-gebaseerde tekst-tot-beeld-opzoek (CLIP-T) voor tekst-tot-beeld-opzoek, en Qwen-T met tekst-tot-tekst-opzoek. Beide onderschrift-gebaseerde baselines gebruikten het oorspronkelijke voorgetrainde Qwen-model in plaats van de versie die was fijn afgesteld op relationele logica. Dit stelde de auteurs in staat om het effect van groepsgebaseerde training te isoleren, aangezien het fijn afgestelde model was blootgesteld aan beeldsets in plaats van geïsoleerde voorbeelden.

Bestaande Metrieken en Relationele Overeenkomst

De auteurs hebben aanvankelijk getest of bestaande metrieken relationele overeenkomst konden vastleggen:

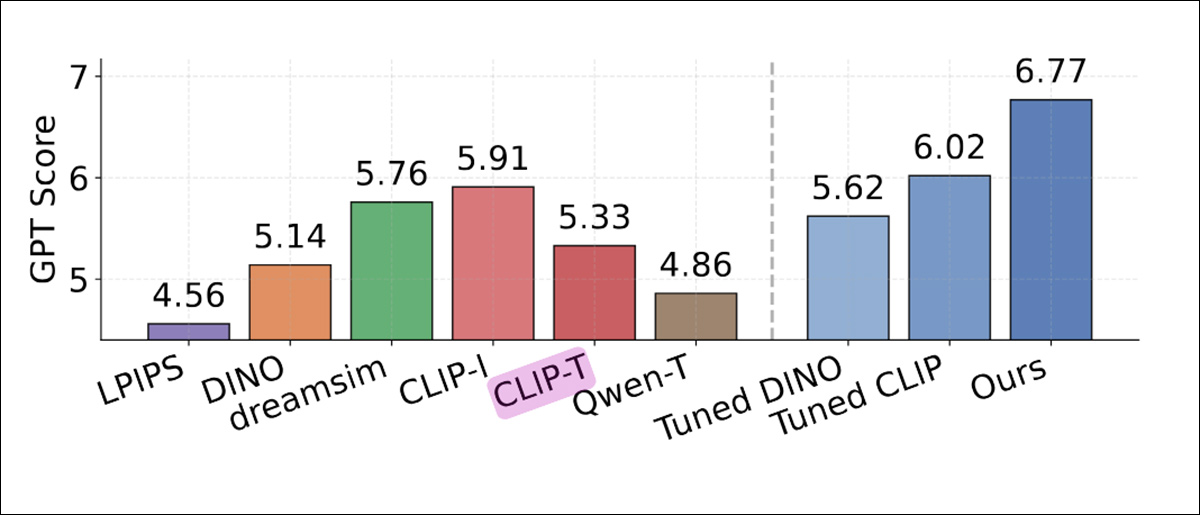

Vergelijking van de opzoekprestaties zoals beoordeeld door GPT-4o, met de gemiddelde relationele overeenkomstscore voor elke methode. Conventionele overeenkomstmetrieken zoals LPIPS, DINO en CLIP-I scoorden lager. Onderschrift-gebaseerde baselines Qwen-T en CLIP-T presteerden ook ondermaats. De hoogste score werd behaald door relsim (6,77, rechtsste blauwe kolom), wat aangeeft dat het afstemmen op groepsgebaseerde relationele patronen de overeenstemming met GPT-4o’s beoordelingen verbeterde.

Met betrekking tot deze resultaten stellen de auteurs**:

‘[LPIPS], die zich uitsluitend richt op perceptuele overeenkomst, behaalt de laagste score (4,56). [DINO] presteert slechts iets beter (5,14), waarschijnlijk omdat het uitsluitend in een zelfgestuurde manier op beeldgegevens is getraind. [CLIP-I] levert de sterkste resultaten onder de baselines (5,91), waarschijnlijk omdat soms enige abstractie aanwezig is in beeldonderschriften.

‘Echter, CLIP-I presteert nog steeds ondermaats ten opzichte van onze methode, aangezien het bereiken van een betere score mogelijk het vermogen vereist om nog hogere abstractieniveaus te bereiken, zoals die in anonieme onderschriften.’

In de gebruikersstudie gaven mensen consequent de voorkeur aan de relsim-methode boven alle baselines:

Relationele overeenkomstscores toegewezen door GPT-4o voor elke methode. Standaardovereenkomstmetrieken zoals LPIPS, DINO en CLIP-I scoorden lager, en onderschrift-gebaseerde varianten Qwen-T en CLIP-T presteerden slechts iets beter. Zelfs afgestelde versies van DINO en CLIP sloten de kloof niet. De hoogste score, 6,77, werd behaald door het relsim-model, getraind met groepsgebaseerde supervisie.

De auteurs merken op:

‘Dit is zeer bemoedigend, aangezien het niet alleen aantoont dat ons model, relsim, succesvol relationeel soortgelijke beelden kan ophalen, maar ook, opnieuw, bevestigt dat mensen relationele overeenkomst waarnemen – niet alleen kenmerkovereenkomst!’

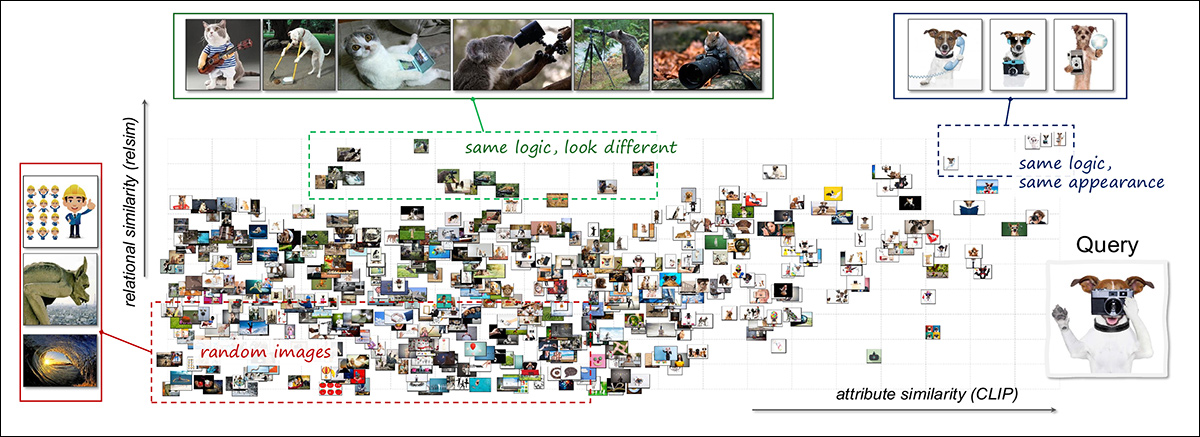

Om te onderzoeken hoe relationele en kenmerkovereenkomst elkaar kunnen aanvullen, hebben de onderzoekers een gecombineerde visualisatiemethode gebruikt. Een enkel querybeeld (‘Een hond die een camera vasthoudt’) werd vergeleken met 3.000 willekeurige beelden, en overeenkomst werd berekend met behulp van zowel relationele als kenmerkgebaseerde modellen:

Gecombineerde visualisatie van de visuele overeenkomstige ruimte met behulp van relationele en kenmerkassen. Een enkel querybeeld, waarop een hond een camera gebruikt, werd vergeleken met 3.000 andere. Resultaten werden georganiseerd op basis van relationele overeenkomst (verticaal) en kenmerkovereenkomst (horizontaal). De rechterbovenhoek bevat beelden die zowel in logica als in uiterlijk op het querybeeld lijken, zoals andere honden die gereedschap gebruiken. De linkerbovenhoek bevat semantisch verwante maar visueel verschillende gevallen, zoals verschillende dieren die cameragerelateerde acties uitvoeren. De meeste resterende voorbeelden clusteren lager in de ruimte, weerspiegelend zwakkere overeenkomst. De lay-out illustreert hoe relationele en kenmerkmodellen complementaire aspecten van visuele gegevens benadrukken. Raadpleeg het bronartikel voor een betere resolutie.

De resultaten toonden clusters die overeenkwamen met verschillende soorten overeenkomst: sommige beelden waren zowel relationeel als visueel soortgelijk; anderen deelden relationele logica maar niet uiterlijk; de rest toonde geen van beide.

Deze analyse suggereert dat de twee soorten overeenkomst verschillende rollen spelen en een rijker structuur opleveren wanneer ze worden gecombineerd.

Gebruiksvoorbeelden

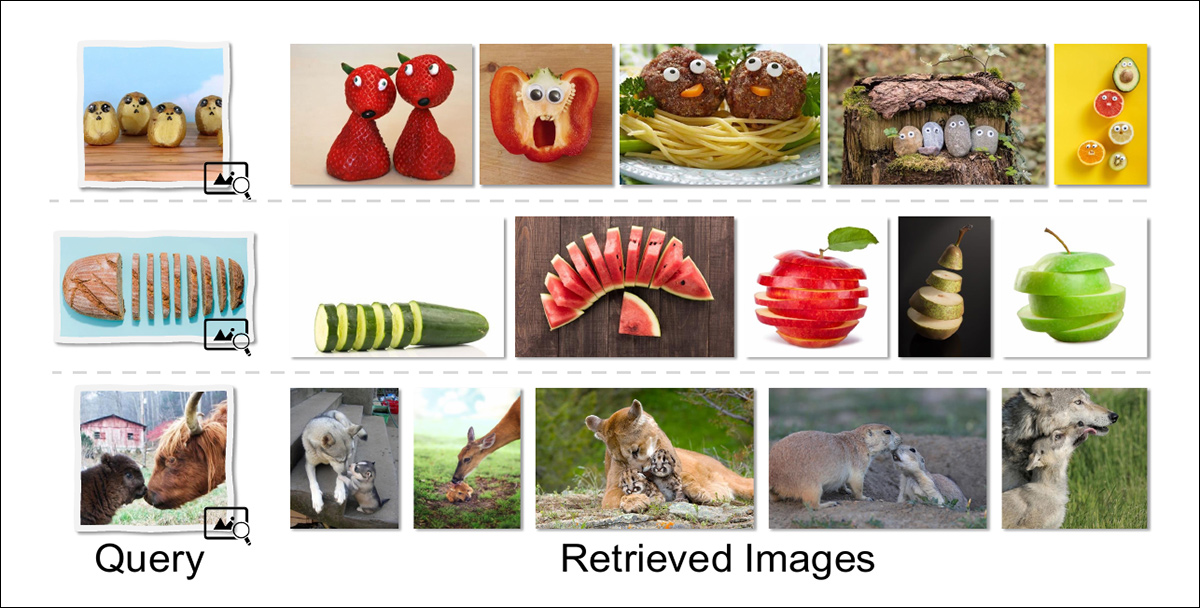

Het artikel onderzoekt ook enkele mogelijke eindgebruiksvoorbeelden voor relationele overeenkomst, waaronder relationele beeldopzoek, die beeldzoek toelaat die meer in overeenstemming is met de creatieve manier waarop mensen naar de wereld kijken:

Relationele opzoek retourneert beelden die een diepere conceptuele structuur delen met het querybeeld, in plaats van oppervlaktekenmerken te matchen. Bijvoorbeeld, een voedingsmiddel dat is gestyled om op een gezicht te lijken, haalt andere antropomorfe maaltijden op; een gesneden object levert andere gesneden vormen op; en scènes van volwassene-nageslachtinteractie retourneren beelden met soortgelijke relationele rollen, zelfs als soort en compositie verschillen.

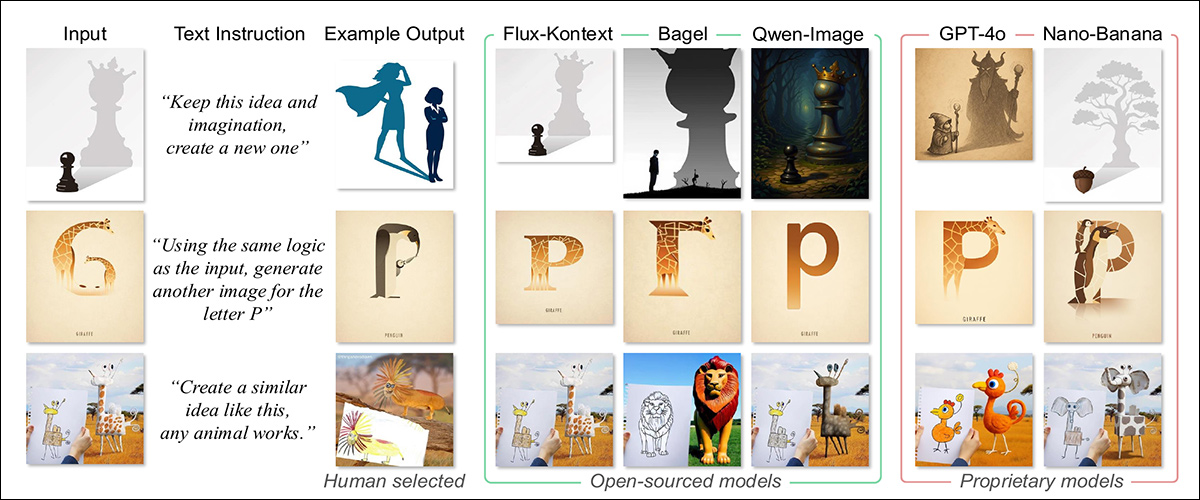

Een ander mogelijkheid is analoge beeldgeneratie, die de synthese van queries toelaat die relationele structuren gebruiken in plaats van directe beschrijvingen. In een vergelijking van resultaten verkregen uit de huidige generatie van state-of-the-art tekst-tot-beeldmodellen, kunnen we zien dat de resultaten van een dergelijke benadering waarschijnlijk diverser zullen zijn:

Gegeven een invoerbeeld en een relationeel prompt, werden modellen gevraagd om een nieuw beeld te genereren dat hetzelfde onderliggende concept uitdrukt. Propriëtaire modellen produceerden meer trouwe analogieën, waarbij de structuurlogica over grote veranderingen in vorm werd behouden, terwijl open-source modellen ernaar neigden om terug te vallen naar letterlijke of stijlmatige overeenkomsten, waardoor ze het diepere idee niet konden overdragen. Uitvoer werd vergeleken met door mensen gecureerde analogieën, die de bedoelde transformatie illustreerden.

Conclusie

Generatieve AI-systemen zouden, zo lijkt het, aanzienlijk worden verbeterd door de capaciteit om abstracte representatie in hun concepten op te nemen. Zoals het er nu voor staat, leidt het vragen om concept-gebaseerde beelden zoals ‘woede’ of ‘geluk’ meestal tot beelden die zijn gestyled vanuit de meest populaire of talrijkste beelden die deze associaties in de dataset hadden; wat memorisatie is in plaats van abstractie.

Waarschijnlijk kan dit principe nog nuttiger zijn als het kan worden toegepast op generatieve schrijfstukken – met name analytische, speculatieve of fictieve output.

Druk op afspelen. Bron

* Een A100 kan 40Gb of 80GB VRAM hebben; dit is niet gespecificeerd in het artikel.

** De citaten van de auteurs zijn redundant en uitgesloten.

Publicatie op dinsdag 16 december 2025