Andersons hoek

Verbositeit vermindert de nauwkeurigheid in grote taalmodellen

Nieuw onderzoek toont aan dat het forceren van grote taalmodellen om kortere antwoorden te geven, de nauwkeurigheid en kwaliteit van hun antwoorden aanzienlijk verbetert.

Iedereen die ooit heeft geprobeerd om een chatbot te stoppen van ‘geklets’ zal de conclusies van nieuw onderzoek herkennen: het forceren van AI om kortere antwoorden te geven, maakt het nauwkeuriger.

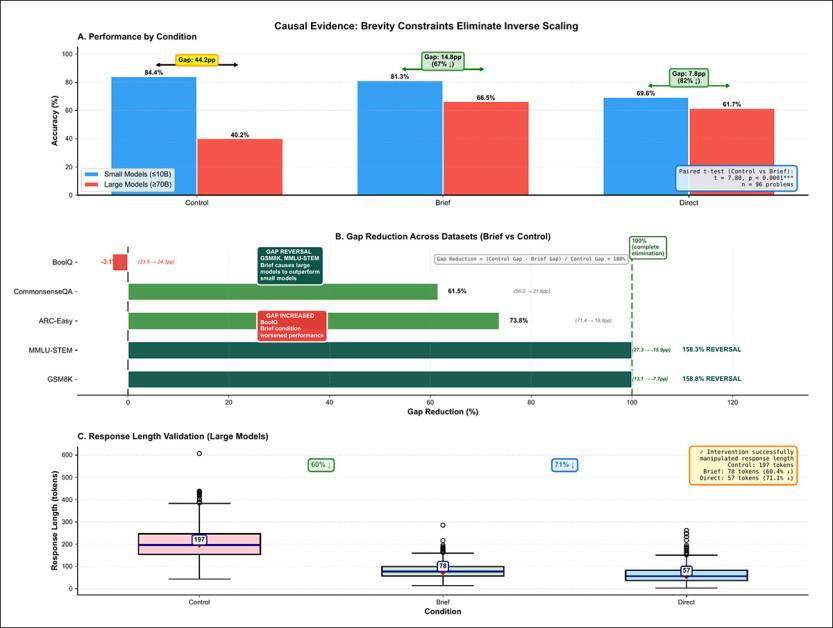

Het onderzoek naar de redenen waarom grotere AI-chatbots in sommige gevallen (bekend als inverse scaling) slechter presteren dan kleinere, toonde aan dat het forceren van 31 populaire grote taalmodellen (LLM’s) om kortere antwoorden te geven, leidde tot een verbetering van de nauwkeurigheid van hun antwoorden met maximaal 26,3%:

‘De resultaten bieden overtuigend causaal bewijs: breviteitsbeperkingen verbeterden de nauwkeurigheid van grote modellen met 26,3 procentpunten en verminderden de inverse scaling-kloof met 67% (van 44,2% naar 14,8%, gepaard t-test: t = 7,80, p < 0,0001).'

Overmatige verbositeit is een veel voorkomende klacht onder eindgebruikers, niet in de laatste plaats onder diegenen die commerciële modellen zoals ChatGPT gebruiken, waar de ondersteuningsforums dit onderwerp vaak bespreken.

Het domein dat het meest wordt beïnvloed door het verhelpen van verbositeit in antwoorden is wiskunde, waar de geteste AI’s werden beperkt tot antwoorden van 50 woorden of minder. Voor leesbegrip-taken werden ze beperkt tot slechts 10 woorden in hun antwoorden.

Het artikel definieert de neiging van AI tot verbositeit als overdenken, waarbij de centrale boodschap niet alleen wordt verduisterd door verbiage, maar soms zelfs nadelig wordt beïnvloed door het. Hoe kleiner het model, merkt het artikel op, hoe minder deze remedie nodig is of werkt.

Het onderzoek concludeert dat er niets architecturaals is dat aangepakt moet worden om deze oplossing systematisch toe te passen. Echter, in een gebruikerschatsessie zou een richtlijn naar bondigheid waarschijnlijk moeten worden herhaald, terwijl een wereldwijd toegepaste systeemprompt – die zou moeten worden geïmplementeerd als een technische standaard op platforms zoals ChatGPT – kortere antwoorden kan maken tot standaardgedrag.

Blustery Winds

Niets van dit alles verklaart precies waarom grotere modellen de neiging hebben tot verbositeit, aangezien dit iets is dat ook open source-modellen beïnvloedt. Het artikel suggereert dat protocollen en gebruikelijke praktijken in Reinforcement Learning from Human Feedback (RLHF)-technieken een verklaring kunnen bieden*:

‘Een plausibele oorsprong is RLHF-alignmenttraining, waarbij menselijke annotators grondigheid onevenredig belonen in grotere modellen met grotere capaciteit om op lengtebeloningsignalen te reageren – consistent met verbositeitsverschillen die groter zijn in instructie-gefinetuneerde dan in basismodelvarianten.

‘Eerder onderzoek documenteert systematische lengtevoorkeur in reward modellen, waarbij annotators lengte verwarren met kwaliteit.

‘Grotere modellen, met grotere capaciteit om lengtebeloningsignalen te bevredigen, kunnen verbose generatie dieper internaliseren dan kleinere modellen, waardoor de schaalafhankelijke overdenking ontstaat die we observeren.’

Bij mensen kan verbositeit optreden om een stilte te vullen, of om gevoelens van ongemak te maskeren, vanwege geestelijke gezondheidsproblemen, of om een gebrek aan kennis te verhullen. In feite kan een AI alleen door deze factoren worden beïnvloed door de absorptie van trainingsgegevens die deze eigenschappen weerspiegelen of vertonen.

In datasetcorpora bestaan andere motivaties voor omstandige antwoorden, zoals de SEO-stimulans om langer tekstinhoud te produceren, bijvoorbeeld in recepten, waarin lengte vaak ten onrechte wordt geassocieerd met autoriteit.

Wat niet volledig kan worden uitgesloten, is dat API-gebaseerde platforms, gestimuleerd om gebruikers naar een hoger en duurder abonnement te duwen, ofwel verbositeit aanmoedigen, ofwel niet toezien op verbositeit, aangezien het tokengebruik vrij goedkoop verhoogt, zonder de noodzaak van excessief redeneren of RAG-aanroepen†.

Het nieuwe artikel heeft als titel Brevity Constraints Reverse Performance Hierarchies in Language Models en komt van de afdeling Informatica van het Sweden Polytechnic Institute in Chattogram, in Bangladesh.

Methode

Om de theorieën van het artikel te testen, werden 31 taalmodellen geëvalueerd – te veel om hier in tekstvorm te noemen, maar afgebeeld in de onderstaande afbeelding:

De grote taalmodellen (LLM’s) getest in verschillende delen van de proeven voor het nieuwe artikel.

De modellen werden geëvalueerd tegen vijf benchmarkcollecties: GSM8K, voor wiskundige redenering; BoolQ, voor leesbegrip; CommonsenseQA, voor gezond verstand; ARC-Easy, voor wetenschappelijke vragen; en MMLU-STEM, ook voor wetenschappelijke kennis.

Antwoorden werden gegenereerd met gierige decodering om deterministische uitvoer te garanderen, en vervolgens geëxtraheerd met taakspecifieke regels, met nauwkeurigheid gemeten als het aandeel correcte antwoorden tegen ground truth.

Modellen werden gesplitst in grootte, met modellen van tien miljard parameters of minder als ‘klein’ behandeld, en modellen boven de zeventig miljard als ‘groot’, op basis van waargenomen prestatieverschillen.

Inverse scaling werd gekwantificeerd door de prestaties van deze groepen op elk probleem te vergelijken, waarbij gevallen werden gemarkeerd waarin kleinere modellen grotere modellen overtroffen; de statistische effectgrootte werd vervolgens gebruikt om te bevestigen dat deze kloven consistente, betekenisvolle verschillen weerspiegelden in plaats van ruis.

Uitsluiting van recall

Om de mogelijkheid uit te sluiten dat modellen eenvoudigweg trainingsgegevens herinnerden, werden drie afzonderlijke controles uitgevoerd, waarbij werd gekeken hoe gevarieerd de antwoorden waren; hoeveel hun lengte fluctueerde; en hoe fouten werden gemaakt. Als modellen zich verlieten op gememoriseerde patronen, zouden antwoorden de neiging hebben om te herhalen of vaste sjablonen te volgen; in plaats daarvan bleken antwoorden grotendeels uniek te zijn over modellen, met merkbare variatie in lengte, van het ene antwoord naar het andere.

Fouten werden ook rechtstreeks geïnspecteerd, waarbij de meeste fouten de vorm aannamen van lange, onjuiste verklaringen, in plaats van korte, ontwijkende antwoorden – wat aangaf dat de modellen daadwerkelijk redeneringen genereerden, in plaats van opgeslagen antwoorden op te halen.

Gegevens en tests

Bij het testen van individuele vragen in plaats van koploperScores, bleek een groot deel van de benchmarktaken oninformatief te zijn, met 27,1% die modellen helemaal niet konden onderscheiden omdat elk systeem slaagde of elk systeem faalde, waardoor er geen echt signaal was over de relatieve prestaties:

Probleemniveau-ontbinding over vijf benchmarks toonde aan dat een aanzienlijk deel van de taken modellen niet kon onderscheiden, terwijl een kleiner maar consistent deel inverse scaling vertoonde, waarbij kleinere modellen grotere modellen overtroffen. De totale verdeling over 1.485 problemen geeft aan dat 7,7% inverse scaling vertonen. Bron

Onder de vragen die wel modellen konden onderscheiden, vertoonden de meeste het verwachte gedrag, met grotere systemen die beter presteerden, maar een kleinere groep vertoonde het tegenovergestelde patroon, met kleinere modellen die voorop liepen. Over alle problemen heen vertoonde inverse scaling zich in 7,7% van de gevallen, wat aangaf dat het effect niet marginaal is.

Inverse scaling naar boven komen

Over de vijf benchmarks heen werden 115 problemen gevonden waarbij kleinere modellen grotere modellen overtroffen, wat 7,7% van alle 1.485 taken uitmaakt, wat aangeeft dat inverse scaling geen zeldzaam of marginaal verschijnsel is in deze context.

In feite dook het effect overal op: het sterkst in BoolQ, en zwakker in CommonsenseQA, ARC-Easy, GSM8K en MMLU-STEM, wat aangeeft dat het wijdverbreid is, maar per taak varieert:

Inverse scaling dook overal op, variërend van 3,9% in MMLU-STEM tot 11,3% in BoolQ, met 115 problemen in totaal. Prestatiekloven bevoordeelden kleinere modellen met een gemiddelde van 28,4 procentpunten. Nauwkeurigheid daalde naarmate de modelgrootte toenam, met kleine modellen die 66,1% bereikten, vergeleken met 41,5% voor grotere modellen.

De grootte van de kloof bleek aanzienlijk, met kleinere modellen die gemiddeld 28,4 procentpunten voorop liepen, en elk geval vertoonde dezelfde richting van voordeel, wat wees op een consistente daling van de prestaties, in plaats van occasionele of ad hoc-fouten.

Hetzelfde patroon gold over verschillende modelgezinnen, waaronder Llama, Qwen, Gemma en Mistral, waar grotere versies onderpresteerden ten opzichte van kleinere modellen, met nauwkeurigheid die de neiging had te dalen naarmate de modelgrootte toenam bij deze problemen.

De kloof tussen kleine en grote modellen was groot genoeg dat toeval onwaarschijnlijk zou zijn om het te verklaren; en omdat hetzelfde patroon optrad over verschillende benchmarks, taken en modelgezinnen, bleek inverse scaling een consistent effect in plaats van een toevallig effect.

Binnen elk modelgezin presteerden grotere versies herhaaldelijk slechter dan kleinere modellen op deze problemen, wat suggereert dat de daling mogelijk samenhangt met de schaal zelf, in plaats van met verschillen in ontwerp.

De resultaten geven ook aan dat er een limiet is voor elke taak, waarbij het verhogen van de modelgrootte de prestaties begint te schaden, wat aangeeft dat grotere modellen niet altijd tot betere resultaten leiden.

Overdenking onderzoeken

Nadat was vastgesteld dat grotere modellen soms slechter presteren op bepaalde domeinen, richtte de analyse zich op de reden waarom dit gebeurt, waarbij werd voorgesteld dat het probleem niet een gebrek aan capaciteit is, maar te veel uitleg – d.w.z. gevallen waarin langere antwoorden correcte redenering beginnen te verduisteren.

Over de gegevens heen werden langere antwoorden in verband gebracht met lagere nauwkeurigheid bij deze moeilijke problemen, zelfs Though grote en kleine modellen ongeveer hetzelfde aantal redeneringsstappen produceerden, wat suggereert dat het probleem niet is hoeveel redenering wordt gedaan, maar hoe het wordt uitgedrukt:

Kortere antwoorden verbeterden de prestaties van grote modellen en verminderden de kloof met kleinere modellen, waardoor het verschil van 44,2 procentpunten tot 14,8 werd teruggebracht (en in sommige gevallen zelfs omgekeerd), terwijl directe antwoordformaten de kloof verder verkleinden. De sterkste verbeteringen traden op in GSM8K en MMLU-STEM, waar de rangordes ten gunste van grotere modellen omsloegen, en controles van antwoordlengte bevestigden dat de interventie werkte, met uitvoer die daalde van ongeveer 197 tokens tot minder dan 80, waarbij verminderde verbositeit in verband werd gebracht met verbeterde nauwkeurigheid.

Wanneer antwoorden werden gedwongen om korter te zijn, verbeterden grote modellen scherp, waardoor een aanzienlijke prestatiekloof werd verkleind, en in sommige gevallen zelfs geëlimineerd. Omgekeerd veranderden kleine modellen nauwelijks, wat aangaf dat verbositeit actief grote systemen schaadde.

Het effect bleek te variëren per taak, met sommige benchmarks die sterk baat hadden bij kortere antwoorden, en andere die een zekere mate van uitleg vereisten; maar in verschillende gevallen keerde de rangorde tussen kleine en grote modellen volledig om zodra verbositeit werd beperkt, wat aangaf dat grotere modellen een verborgen capaciteit hadden die werd gemaskeerd door over-uitweiding.

Verder onderzoek toonde aan dat grote modellen de neiging hadden om langere uitvoer overall te produceren, ondanks dat ze iets minder expliciete redeneringsstappen gebruikten, wat een meer diffuse en minder gestructureerde stijl van redenering aangaf.

Omgekeerd gaven kleinere modellen kortere, directere antwoorden, wat suggereert dat de manier waarop redenering wordt uitgedrukt, in plaats van de hoeveelheid redenering zelf, de daling van de prestaties veroorzaakt.

De auteurs concluderen in het algemeen dat breviteitsbeperkingen nauwkeurigheidsvoordelen opleveren, en overwegen dat dit een fundamentele functie in taalmodellen kan worden, in plaats van een herhaalde, door de gebruiker toegepaste beperking die niet overleeft over sessies heen; en ze verklaren:

‘[Brevity] beperkingen helpen grote modellen dramatisch, terwijl kleine modellen nauwelijks worden beïnvloed.

‘Als verbositeit incidenteel was in plaats van oorzakelijk, zouden uniforme nauwkeurigheidsveranderingen over beide groottecategorieën worden verwacht. De differentiële respons bevestigt dat overdenken een schaal-specifieke foutmodus is, niet een taakmoeilijkheideffect.’

Conclusie

Behalve de geteste open source-versies, lijkt het verbositeitsprobleem, anekdotisch, met enige frequentie op te treden in veel grote modellen, waaronder Claude, Gemini en Grok.

Of deze platforms het verbositeitsprobleem negeren omdat het tokengebruik verhoogt en hogere uitgaven aanmoedigt†, het lijkt niet redelijk dat ze de daling van de nauwkeurigheid die hiermee samenhangt zouden accepteren.

Het zou interessant zijn om te zien of enige empirische methode met zekerheid kan bepalen waar de neiging tot verbositeit vandaan komt. Iedereen die ooit heeft geprobeerd om een chatbot te laten praten, in plaats van bloggen met verwarde, meerdere stappen tellende antwoorden aan de gebruiker, zal hebben gerealiseerd dat het model ernstig is geïmpregneerd met ‘all-in-one’-gebruikershandleidingen en ‘geaccepteerde oplossingen’ in zijn trainingsgegevens.

Het zou dan ook heel interessant zijn om te zien of een model dat specifiek is getraind op stap-voor-stap-gesprekken, daadwerkelijk kan afwijken van de verwarde, samenvattende neiging. Echter, het lijkt waarschijnlijk dat enige beperkingen of filters moeten worden toegepast op het gewicht dat het model wordt getraind om te geven aan het ‘besloten’ antwoord, zodat het rechtstreeks traint op het voorafgaande materiaal – in wezen, de expliciete redenering die expliciet is in gesprekken op basis van beurten.

Aangezien gegevens van dit type waarschijnlijk zeldzaam zijn, is de enige manier om vooruit te komen met deze benadering mogelijk via synthetische gegevens, waarin ‘samengestelde’ eindconclusies op een conversatieachtige manier worden ontleed – ironisch genoeg, op dezelfde manier als de AI-podcasts die Google NotebookLM kan interpreteren vanuit platte tekstinput.

* Mijn conversie van de inline-citaten van de auteurs naar hyperlinks.

† Maar laten we eerlijk zijn, het tekort tussen de werkelijke AI-kosten en abonnementskosten is op dit moment zo groot dat dit alleen maar de gebruikersreputatie zou schaden zonder de ernstige onderliggende economie van deze fase van de ‘conversie’ en ‘convergentie’ van AI op te lossen.

Eerst gepubliceerd op zondag 5 april 2026