Toezicht

‘Degraded’ Synthetische Gezichten Konden Helpen Om Gezichtsafbeeldingsherkenning te Verbeteren

Onderzoekers van de Michigan State University hebben een manier bedacht om synthetische gezichten een pauze te geven van de deepfakes-scene en iets goeds te doen in de wereld – door imageherkenningssystemen te helpen om nauwkeuriger te worden.

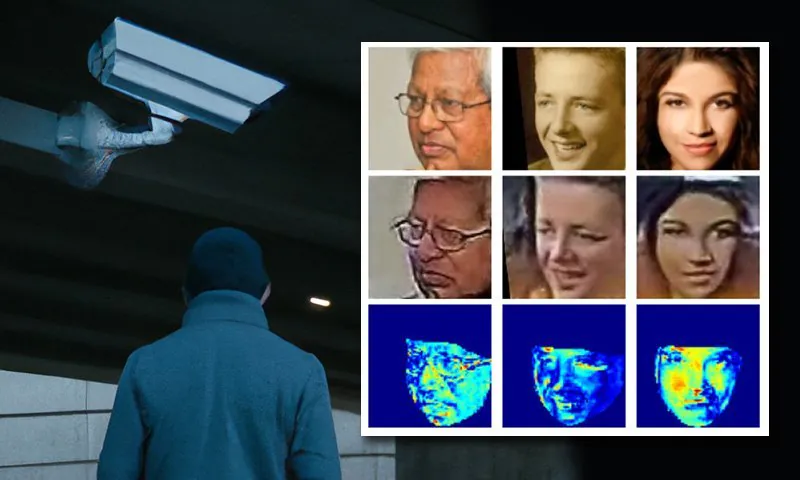

Het nieuwe controllable face synthesis module (CFSM) dat ze hebben ontwikkeld, is in staat om gezichten te regenereren in de stijl van echte videobewakingsbeelden, in plaats van te vertrouwen op de uniform hogere kwaliteit beelden die worden gebruikt in populaire open source datasets van beroemdheden, die niet alle fouten en tekortkomingen van echte CCTV-systemen weerspiegelen, zoals gezichtsvervaging, lage resolutie en sensorruis – factoren die de herkenningsnauwkeurigheid kunnen beïnvloeden.

Conceptuele architectuur voor het Controllable Face Synthesis Module (CFSM). Source: http://cvlab.cse.msu.edu/pdfs/Liu_Kim_Jain_Liu_ECCV2022.pdf

CFSM is niet specifiek bedoeld om authentiek hoofdposities, uitdrukkingen of alle andere gebruikelijke kenmerken te simuleren die het doel zijn van deepfakesystemen, maar om een reeks alternatieve weergaven te genereren in de stijl van het doelherkenningssysteem, met behulp van style transfer.

Het systeem is ontworpen om de stijldomein van het doelsysteem te imiteren en om zijn uitvoer aan te passen aan de resolutie en het bereik van ‘eccentriciteiten’ daarin. Het gebruiksscenario omvat legacy-systemen die niet waarschijnlijk zullen worden geüpgrade vanwege de kosten, maar die momenteel weinig kunnen bijdragen aan de nieuwe generatie van gezichtsherkenningstechnologieën vanwege de lage kwaliteit van de uitvoer die ooit baanbrekend was.

Bij het testen van het systeem, vonden de onderzoekers dat het aanzienlijke verbeteringen opleverde in de staat van de kunst in imageherkenningssystemen die te maken hebben met dit soort lawaaierige en lage kwaliteit gegevens.

Trainen van de gezichtsherkenningmodellen om aan te passen aan de beperkingen van de doelsystemen. Source: http://cvlab.cse.msu.edu/pdfs/Liu_Kim_Jain_Liu_ECCV2022_supp.pdf

Ze vonden ook een nuttig bijproduct van het proces – dat de doeldatasets nu gekarakteriseerd en met elkaar vergeleken konden worden, waardoor het vergelijken, benchmarken en genereren van maatwerkdatasets voor verschillende CCTV-systemen in de toekomst gemakkelijker werd.

Verder kan de methode worden toegepast op bestaande datasets, waardoor de facto domain adaptation wordt uitgevoerd en ze meer geschikt maakt voor gezichtsherkenningssystemen.

Het nieuwe artikel heeft als titel Controllable and Guided Face Synthesis for Unconstrained Face Recognition, wordt ondersteund door het US Office of the Director of National Intelligence (ODNI, bij IARPA), en komt van vier onderzoekers van de afdeling Computer Science & Engineering van MSU.

Featured Content

Lage kwaliteit gezichtsherkenning (LQFR) is de afgelopen jaren een opvallend onderzoeksgebied geworden. Omdat civiele en gemeentelijke autoriteiten videobewakingsystemen hebben gebouwd om resilient en langdurig te zijn (zonder middelen te willen heralloceren voor het probleem), zijn veel ‘legacy’ bewakingsnetwerken slachtoffer geworden van technische schuld, in termen van hun aanpasbaarheid als gegevensbronnen voor machine learning.

Variërende niveaus van gezichtsresolutie over een reeks historische en recentere videobewakingsystemen. Source: https://arxiv.org/pdf/1805.11519.pdf

Gelukkig is dit een taak die diffusiemodellen en andere ruisgebaseerde modellen ongewoon goed aankunnen. Veel van de meest populaire en effectieve beeldsynthesesystemen van de afgelopen jaren voeren upscaling van lage resolutiebeelden uit als onderdeel van hun pipeline, terwijl dit ook absoluut essentieel is voor neurale compressietechnieken (methoden om beelden en films op te slaan als neurale gegevens in plaats van bitmapgegevens).

Deel van de uitdaging van gezichtsherkenning is om de maximale mogelijke nauwkeurigheid te verkrijgen uit het minimum aantal kenmerken dat kan worden geëxtraheerd uit de kleinste en minst veelbelovende lage resolutiebeelden. Deze beperking bestaat niet alleen omdat het nuttig is om een gezicht te kunnen identificeren (of te creëren) bij lage resolutie, maar ook vanwege technische beperkingen op de grootte van beelden die door de opkomende latent ruimte van een model kunnen worden verwerkt dat wordt getraind in welke VRAM beschikbaar is op een lokale GPU.

In deze zin is de term ‘kenmerken’ verwarrend, omdat dergelijke kenmerken ook kunnen worden verkregen uit een dataset van bankjes. In de computer vision sector verwijst ‘kenmerken’ naar de onderscheidende kenmerken die worden verkregen uit beelden – alle beelden, of het nu de lijnen van een kerk, een berg of de dispositie van gezichts kenmerken in een gezichtsdataset.

Aangezien computer vision algoritmes nu bedreven zijn in het upscalen van beelden en videofragmenten, zijn verschillende methoden voorgesteld om ‘verbeterde’ lage resolutie of anderszins gedegradeerde legacy bewakingsmateriaal te ‘verbeteren’, tot het punt dat het mogelijk zou zijn om dergelijke augmentaties voor juridische doeleinden te gebruiken, zoals het plaatsen van een bepaald persoon op een scène, in verband met een misdaadonderzoek.

Behalve de mogelijkheid van misidentificatie, die af en toe koppen heeft gehaald, zou het in theorie niet nodig moeten zijn om lage resolutiebeelden te hyper-resolveren of anderszins te transformeren om een positieve identificatie van een individu te maken, aangezien een gezichtsherkenningssysteem dat is afgestemd op lage niveau kenmerken, niet die niveau van resolutie en helderheid nodig zou moeten hebben. Bovendien zijn dergelijke transformaties duur in de praktijk en roepen ze additionele, recurrent vragen op over hun potentiële geldigheid en legaliteit.

De Behoefte aan Meer ‘Down-At-Heel’ Beroemdheden

Het zou nuttiger zijn als een gezichtsherkenningssysteem kenmerken (d.w.z. machine learning kenmerken van menselijke kenmerken) kon afleiden uit de uitvoer van legacy-systemen zoals ze zijn, door de relatie tussen ‘hoge resolutie’ identiteit en de gedegradeerde beelden die beschikbaar zijn in onverzettelijke (en vaak onvervangbare) bestaande videobewakingskaders beter te begrijpen.

Het probleem hier is een van standaarden: gemeenschappelijke web-gegroepeerde datasets zoals MS-Celeb-1M en WebFace260M (onder andere), zijn vastgemaakt door de onderzoekscommunity omdat ze consistente benchmarks bieden waartegen onderzoekers hun incrementele of grote vooruitgang kunnen meten tegen de huidige stand van de kunst.

Voorbeelden uit Microsofts populaire MS-Celeb1m-dataset. Source: https://www.microsoft.com/en-us/research/project/ms-celeb-1m-challenge-recognizing-one-million-celebrities-real-world/

Echter, de auteurs betogen dat gezichtsherkenning (FR) algoritmes getraind op deze datasets ongeschikt materiaal zijn voor de visuele ‘domeinen’ van de uitvoer van veel oudere bewakingsystemen.

Het artikel zegt*:

‘[State-of-the-art] (SoTA) FR-modellen werken niet goed op echte videobewakingsbeelden (onbeperkt) vanwege het domeinverschil, dat wil zeggen, de grote trainingsdatasets (semi-beperkt) verkregen via web-gekruiste beroemde gezichten ontbreken variaties in de vrije natuur, zoals inherente sensorruis, lage resolutie, bewegingsonscherpte, turbulentie-effect, enz.

‘Bijvoorbeeld, 1:1 verificatie-accuraatheid gerapporteerd door een van de SoTA-modellen op onbeperkte IJB-S dataset is ongeveer 30% lager dan op semi-beperkte LFW.

‘Een potentieel middel tegen zo’n prestatieverschil is om een grote onbeperkte gezichtsdataset samen te stellen. Echter, het construeren van een dergelijke trainingsdataset met tienduizenden onderwerpen is buitengewoon moeilijk met hoge handmatige labelkosten.’

Het artikel vertelt over verschillende eerdere methoden die hebben geprobeerd om de uiteenlopende typen uitvoer van historische of lagekostenbewakingsystemen te ‘matchen’, maar merkt op dat deze te maken hebben met ‘blinde’ augmentaties. In tegenstelling tot CFSM, ontvangt het directe feedback van de uitvoer van het doelsysteem tijdens de training en past het zich aan via style transfer om die domein te imiteren.

Actrice Natalie Portman, geen onbekende in de handvol datasets die de computer vision community domineren, komt voor in dit voorbeeld van CFSM dat style-gematchte domeinadaptatie uitvoert op basis van feedback van de domein van het daadwerkelijke doelmodel.

De architectuur ontworpen door de auteurs maakt gebruik van Fast Gradient Sign Method (FGSM) om de verkregen stijlen en kenmerken van de uitvoer van het doelsysteem te individualiseren en ‘in te voeren’. Het deel van de pipeline gewijd aan beeldgeneratie zal vervolgens verbeteren en trouwer worden aan het doelsysteem met training. Deze feedback van de lage dimensionale stijlruimte van het doelsysteem is van lage orde en komt overeen met de meest algemene afgeleide visuele beschrijvers.

De auteurs merken op:

‘Met de feedback van het FR-model, zijn de gesynthetiseerde beelden meer gunstig voor de FR-prestaties, wat leidt tot aanzienlijk verbeterde generalisatiecapaciteiten van de FR-modellen die ermee zijn getraind.’

Tests

De onderzoekers gebruikten MSU’s eigen eerder werk als sjabloon voor het testen van hun systeem. Op basis van hetzelfde experimentele protocol, gebruikten ze MS-Celeb-1m, dat uitsluitend bestaat uit web-gekruiste beroemde foto’s, als de gelabelde trainingsdataset. Voor eerlijkheid, voegden ze ook MS1M-V2 toe, dat 3,9 miljoen beelden bevat met 85.700 klassen.

De doelgegevens waren de WiderFace-dataset, van de Chinese University of Hong Kong. Dit is een bijzonder diverse set van beelden ontworpen voor gezichtsdetectietaken in moeilijke situaties. 70.000 beelden uit deze set werden gebruikt.

Voor evaluatie, werd het systeem getest tegen vier gezichtsherkenningbenchmarks: : IJB-B, IJB-C, IJB-S, en TinyFace.

CFSM werd getraind met ∼10% van de trainingsgegevens van MS-Celeb-1m, ongeveer 0,4 miljoen beelden, voor 125.000 iteraties bij 32 batchgrootte onder de Adam-optimizer bij een (zeer lage) leersnelheid van 1e-4.

Het doelgezichtsherkenningmodel gebruikte een modificatie van ResNet-50 voor de backbone, met ArcFace-verliesfunctie ingeschakeld tijdens de training. Bovendien werd een model getraind met CFSM als ablatie en vergelijkend onderzoek (genoteerd als ‘ArcFace’ in de resultaatentabel hieronder).

De auteurs merken op over de primaire resultaten:

‘ArcFace-model overtreft alle basismodellen in zowel gezichtsidentificatie- als verificatietaken en bereikt een nieuwe SoTA-prestatie.’

De mogelijkheid om domeinen te extraheren uit de verschillende kenmerken van legacy- of ondergespecificeerde bewakingsystemen, stelt de auteurs ook in staat om de distributiesimilariteit onder deze kaders te vergelijken en te evalueren, en om elk systeem weer te geven in termen van een visuele stijl die kan worden gebruikt in toekomstig onderzoek.

De auteurs merken verder op dat hun systeem een nuttig gebruik kan maken van sommige technologieën die tot nu toe alleen zijn gezien als problemen die moeten worden opgelost door de onderzoeks- en visiegemeenschap:

‘[CFSM] toont aan dat adversarial manipulatie verder kan gaan dan alleen een aanvaller te zijn en kan dienen om herkenningnauwkeurigheid in visietaken te verhogen. Bovendien definiëren we een dataset-similariteitsmetriek op basis van de geleerde stijlbasis, die de stijlverschillen in een label- of predictor-agnostische manier vangt.’

‘We geloven dat ons onderzoek de kracht van een controleerbaar en geleid gezichtssynthesemodel voor onbeperkte FR heeft getoond en een begrip heeft geboden van datasetverschillen.’

* Mijn conversie van de inline citaten van de auteurs naar hyperlinks.

First published 1st August 2022.