Kunstmatige intelligentie

Een Kartel van Invloedrijke Datasets Domineert Machine Learning Onderzoek, Suggesteert Nieuwe Studie

Een nieuw paper van de Universiteit van Californië en Google Research heeft ontdekt dat een klein aantal ‘benchmark’ machine learning datasets, voornamelijk van invloedrijke westerse instellingen, en vaak van overheidsorganisaties, de AI-onderzoekssector steeds meer domineert.

De onderzoekers concluderen dat deze neiging om ‘standaard’ te gaan voor zeer populaire open source datasets, zoals ImageNet, een aantal praktische, ethische en zelfs politieke redenen tot zorg geeft.

Onder hun bevindingen – gebaseerd op core data van het Facebook-geleide community project Papers With Code (PWC) – betogen de auteurs dat ‘wijdverbreide datasets worden geïntroduceerd door slechts een handvol elite-instellingen’, en dat deze ‘consolidatie’ in recente jaren is toegenomen tot 80%.

‘[We] vinden dat er een toenemende ongelijkheid is in het gebruik van datasets wereldwijd, en dat meer dan 50% van alle dataset-gebruiken in onze steekproef van 43.140 overeenkwamen met datasets die zijn geïntroduceerd door twaalf elite, voornamelijk westerse, instellingen.’

<img class="wp-image-179082 size-full" src="https://www.unite.ai/wp-content/uploads/2021/12/dataset-concentration-in-elite-institutions.jpg" alt="Een kaart van niet-taakspecifieke dataset-gebruiken over de afgelopen tien jaar. Criteria voor opname is waar de instelling of het bedrijf meer dan 50% van de bekende gebruiken vertegenwoordigt. Rechts wordt de Gini-coëfficiëntvoor de concentratie van datasets over tijd voor zowel instellingen als datasets getoond.” width=”1200″ height=”389″ /> Een kaart van niet-taakspecifieke dataset-gebruiken over de afgelopen tien jaar. Criteria voor opname is waar de instelling of het bedrijf meer dan 50% van de bekende gebruiken vertegenwoordigt. Rechts wordt de Gini-coëfficiënt voor de concentratie van datasets over tijd voor zowel instellingen als datasets getoond. Bron: https://arxiv.org/pdf/2112.01716.pdf

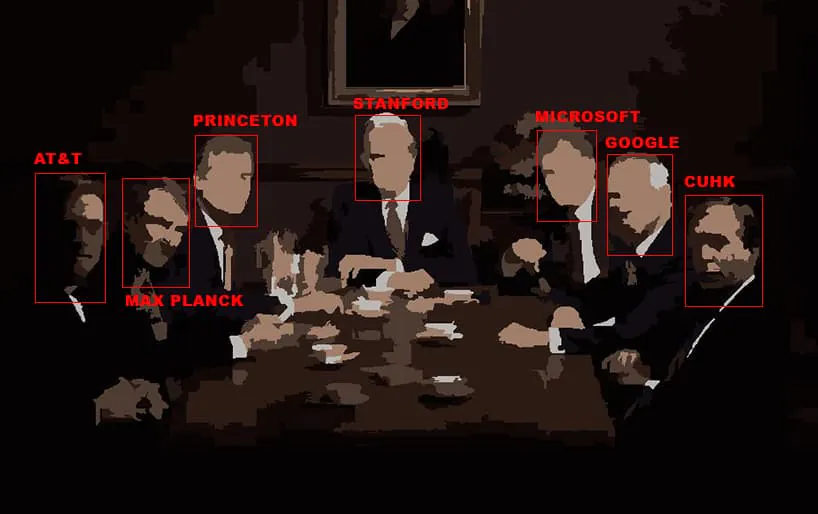

De dominante instellingen omvatten Stanford University, Microsoft, Princeton, Facebook, Google, het Max Planck-instituut en AT&T. Vier van de top tien dataset-bronnen zijn corporate instellingen.

Het paper karakteriseert ook de groeiende gebruik van deze elite datasets als ‘een voertuig voor ongelijkheid in wetenschap’. Dit komt omdat onderzoeksteams die community-goedkeuring zoeken, meer gemotiveerd zijn om state-of-the-art (SOTA) resultaten te behalen tegen een consistente dataset dan om originele datasets te genereren die geen dergelijke status hebben, en die zou vereisen dat peers zich aanpassen aan nieuwe metrieken in plaats van standaardindices.

In elk geval, zoals het paper erkent, is het creëren van je eigen dataset een prohibitief dure onderneming voor minder goed uitgeruste instellingen en teams.

‘De prima facie wetenschappelijke validiteit die wordt verleend door SOTA-benchmarking, wordt generisch verward met de sociale geloofwaardigheid die onderzoekers verkrijgen door te laten zien dat ze kunnen concurreren op een wijd erkende dataset, zelfs als een meer contextspecifieke benchmark meer technisch geschikt zou zijn.

‘We stellen dat deze dynamiek een “Matthew Effect” creëert (d.w.z. “de rijken worden rijker en de armen worden armer”) waarin succesvolle benchmarks en de elite-instellingen die deze introduceren, een onevenredige status binnen het veld verkrijgen.

Het paper heeft als titel Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research, en komt van Bernard Koch en Jacob G. Foster bij UCLA, en Emily Denton en Alex Hanna bij Google Research.

Het werk roept een aantal kwesties op met de groeiende trend naar consolidatie die het documenteert, en is ontvangen met algemene goedkeuring bij Open Review. Een reviewer van NeurIPS 2021 merkte op dat het werk ‘extreem relevant is voor iedereen die betrokken is bij machine learning onderzoek.’ en voorzag de opname ervan als verplichte lectuur in universitaire cursussen.

Van Noodzaak tot Corruptie

De auteurs merken op dat de huidige cultuur van ‘beat-the-benchmark’ ontstond als een remedie voor het gebrek aan objectieve evaluatie-instrumenten dat de interesse en investeringen in AI deed instorten meer dan dertig jaar geleden, na de daling van het bedrijfsenthusiasme voor nieuw onderzoek in ‘Expert Systems’:

‘Benchmarks formaliseren typisch een specifieke taak via een dataset en een geassocieerde kwantitatieve evaluatiemethode. De praktijk werd oorspronkelijk geïntroduceerd in [machine learning onderzoek] na de “AI Winter” van de jaren tachtig door overheidsfinanciers, die probeerden de waarde die werd ontvangen op subsidies meer nauwkeurig te beoordelen.’

Het paper betoogt dat de initiële voordelen van deze informele cultuur van standaardisatie (het verminderen van deelnamebarrières, consistente metrieken en meer agile ontwikkelingsmogelijkheden) beginnen te worden overtroffen door de nadelen die natuurlijk optreden wanneer een lichaam van gegevens krachtig genoeg wordt om effectief de ‘voorwaarden voor gebruik’ en de reikwijdte van invloed te definiëren.

De auteurs suggereren, in overeenstemming met veel recente industrie- en academische gedachten over het onderwerp, dat de onderzoekscommunity niet langer nieuwe problemen stelt als deze niet kunnen worden aangepakt met bestaande benchmark datasets.

Ze merken ook op dat blindelings vasthouden aan deze kleine aantal ‘gouden’ datasets onderzoekers aanmoedigt om resultaten te behalen die overfitted zijn (d.w.z. die specifiek zijn voor de dataset en niet waarschijnlijk zo goed presteren op echte wereldgegevens, op nieuwe academische of originele datasets, of zelfs noodzakelijkerwijs op verschillende datasets in de ‘gouden standaard’).

‘Gezien de waargenomen hoge concentratie van onderzoek op een klein aantal benchmark datasets, geloven we dat het diversifiëren van evaluatievormen, vooral belangrijk is om overfitting op bestaande datasets te voorkomen en de vooruitgang in het veld niet te vertekenen.’

Overheidsinvloed in Computer Vision Onderzoek

Volgens het paper is Computer Vision onderzoek opvallend meer getroffen door het syndroom dat het schetst dan andere sectoren, waarbij de auteurs opmerken dat Natural Language Processing (NLP) onderzoek veel minder wordt beïnvloed. De auteurs suggereren dat dit kan komen omdat NLP-gemeenschappen ‘meer coherent’ zijn en groter in omvang, en omdat NLP-datasets toegankelijker en gemakkelijker te cureren zijn, evenals kleiner en minder bronintensief in termen van dataverzameling.

In Computer Vision, en met name met betrekking tot Facial Recognition (FR) datasets, betogen de auteurs dat corporate, staat en particuliere belangen vaak botsen:

‘Corporate en overheidsinstellingen hebben doelen die in conflict kunnen komen met privacy (bijv. surveillance), en hun weging van deze prioriteiten is waarschijnlijk anders dan die van academici of bredere stakeholders van AI.’

Voor facial recognition taken, vonden de onderzoekers dat het voorkomen van puur academische datasets dramatisch daalt tegen de gemiddelde:

‘[Vier] van de acht datasets (33,69% van het totale gebruik) werden uitsluitend gefinancierd door corporaties, het Amerikaanse leger of de Chinese regering (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M werd uiteindelijk ingetrokken vanwege controverse over de waarde van privacy voor verschillende stakeholders.’

In de bovenstaande grafiek, zoals de auteurs opmerken, zien we ook dat het relatief recente veld van Image Generation (of Image Synthesis) zwaar leunt op bestaande, veel oudere datasets die niet voor dit doel zijn bedoeld.

Feitelijk merkt het paper op dat er een groeiende trend is voor de ‘migratie’ van datasets weg van hun beoogde doel, waardoor vragen rijzen over hun geschiktheid voor de behoeften van nieuwe of outlying onderzoekssectoren, en de mate waarin budgettaire beperkingen de reikwijdte van onderzoekersambities kunnen ‘genericeren’ in het smaller kader dat wordt geboden door de beschikbare materialen en door een cultuur die zo geobsedeerd is door jaar-op-jaar benchmark-ratings dat nieuwe datasets moeite hebben om tractie te krijgen.

‘Onze bevindingen geven ook aan dat datasets regelmatig tussen verschillende taakgemeenschappen worden overgedragen. Aan de meest extreme kant werden de meeste benchmark datasets in omloop voor sommige taakgemeenschappen gemaakt voor andere taken.’

Met betrekking tot de machine learning luminaries (inclusief Andrew Ng) die steeds vaker hebben opgeroepen tot meer diversiteit en curatie van datasets in de afgelopen jaren, ondersteunen de auteurs de gedachte, maar geloven dat dit soort inspanning, zelfs als het succesvol is, potentieel kan worden ondermijnd door de afhankelijkheid van de huidige cultuur van SOTA-resultaten en gevestigde datasets:

‘Ons onderzoek suggereert dat het simpelweg oproepen van ML-onderzoekers om meer datasets te ontwikkelen, en het verschuiven van stimuleringsstructuren zodat datasetontwikkeling gewaardeerd en beloond wordt, mogelijk niet voldoende is om het gebruik van datasets en de perspectieven die uiteindelijk vorm en agenda geven aan MLR-onderzoek te diversifiëren.

‘Naast het stimuleren van datasetontwikkeling, pleiten we voor equity-georiënteerde beleidsinterventies die prioriteit geven aan aanzienlijke financiering voor mensen in minder goed uitgeruste instellingen om hoge kwaliteit datasets te creëren. Dit zou – vanuit een sociaal en cultureel perspectief – de benchmark datasets diversifiëren die worden gebruikt om moderne ML-methoden te evalueren.’

6 december 2021, 16:49 GMT+2 – Correctie van possessief in kop. – MA