Kunstmatige intelligentie

MagicDance: Realistische generatie van menselijke dansvideo’s

Computer vision is een van de meest besproken gebieden in de AI-industrie, dankzij de potentieel toepassingen in een breed scala aan real-time taken. In recente jaren zijn computer vision-frameworks snel geavanceerd, met moderne modellen die nu in staat zijn om gezichtskenmerken, objecten en veel meer in real-time scenario’s te analyseren. Ondanks deze mogelijkheden, blijft menselijke bewegingsoverdracht een formidabele uitdaging voor computer vision-modellen. Deze taak houdt in het retargeten van gezichts- en lichaamsbewegingen van een bronafbeelding of -video naar een doelafbeelding of -video. Menselijke bewegingsoverdracht wordt breed gebruikt in computer vision-modellen voor het stylen van afbeeldingen of video’s, het bewerken van multimediainhoud, digitale mensensynthese en zelfs het genereren van gegevens voor perceptiegebaseerde frameworks.

In dit artikel richten we ons op MagicDance, een diffusiegebaseerd model dat is ontworpen om menselijke bewegingsoverdracht te revolutioneren. Het MagicDance-framework is specifiek gericht op het overdragen van 2D-menselijke gezichtsuitdrukkingen en -bewegingen op uitdagende menselijke dansvideo’s. Het doel is om nieuwe pose-sequentie-gedreven dansvideo’s te genereren voor specifieke doelidentiteiten, terwijl de oorspronkelijke identiteit behouden blijft. Het MagicDance-framework maakt gebruik van een tweestaps trainingsstrategie, met een focus op menselijke bewegingsontkoppeling en verschijningsfactoren zoals huidskleur, gezichtsuitdrukkingen en kleding. We zullen het MagicDance-framework onderzoeken, waarbij we ingaan op de architectuur, functionaliteit en prestaties in vergelijking met andere state-of-the-art menselijke bewegingsoverdrachtsframeworks. Laten we erin duiken.

MagicDance : Realistische menselijke bewegingsoverdracht

Zoals eerder vermeld, is menselijke bewegingsoverdracht een van de meest complexe computer vision-taken vanwege de grote complexiteit die betrokken is bij het overdragen van menselijke bewegingen en uitdrukkingen van de bronafbeelding of -video naar de doelafbeelding of -video. Traditioneel hebben computer vision-frameworks menselijke bewegingsoverdracht bereikt door een taakspecifiek generatief model te trainen, waaronder GAN of Generative Adversarial Networks op doeldatasets voor gezichtsuitdrukkingen en lichaamshoudingen. Hoewel het trainen en gebruiken van generatieve modellen in sommige gevallen bevredigende resultaten oplevert, lijden ze meestal aan twee belangrijke beperkingen.

- Ze zijn sterk afhankelijk van een beeldvervormingscomponent, waardoor ze vaak moeite hebben om lichaamsdelen te interpoleren die onzichtbaar zijn in de bronafbeelding, hetzij vanwege een verandering in perspectief of zelfbedekking.

- Ze kunnen niet generaliseren naar andere afbeeldingen die extern zijnbronnen, waardoor hun toepassingen worden beperkt, vooral in real-time scenario’s in het wild.

Moderne diffusiemodellen hebben uitzonderlijke beeldgeneratiecapaciteiten aangetoond in verschillende omstandigheden, en diffusiemodellen kunnen nu krachtige visuals presenteren in een reeks downstream-taken, zoals videogeneratie en beeldinpainting, door te leren van web-schaalbeelden. Vanwege hun mogelijkheden kunnen diffusiemodellen een ideale keuze zijn voor menselijke bewegingsoverdracht-taken. Hoewel diffusiemodellen kunnen worden geïmplementeerd voor menselijke bewegingsoverdracht, hebben ze enkele beperkingen, hetzij in termen van de kwaliteit van de gegenereerde inhoud, hetzij in termen van identiteitsbehoud of het lijden aan tijdelijke inconsistenties als gevolg van modelontwerp- en trainingsstrategiebeperkingen. Bovendien tonen diffusiegebaseerde modellen geen significante voordelen ten opzichte van GAN-frameworks in termen van generaliseerbaarheid.

Om de hindernissen te overwinnen die diffusie- en GAN-gebaseerde frameworks tegenkomen bij menselijke bewegingsoverdracht-taken, hebben ontwikkelaars MagicDance geïntroduceerd, een nieuw framework dat de potentie van diffusie-frameworks voor menselijke bewegingsoverdracht wil exploiteren, met een ongekend niveau van identiteitsbehoud, superieure visuele kwaliteit en domein-generaliseerbaarheid. In het hart van het MagicDance-framework ligt het fundamentele concept om het probleem op te splitsen in twee fasen: verschijningscontrole en bewegingscontrole, twee capaciteiten die nodig zijn voor beeld_diffusie-frameworks om accurate bewegingsoverdracht-uitvoer te leveren.

De bovenstaande figuur geeft een overzicht van het MagicDance-framework, en zoals te zien is, maakt het framework gebruik van de Stable Diffusion-model, en implementeert het twee extra componenten: Appearance Control Model en Pose ControlNet, waarbij de eerste verschijningsrichtlijnen biedt aan de SD-model vanuit een referentieafbeelding via aandacht, en de laatste expressie/houdingsrichtlijnen biedt aan de diffusiemodel vanuit een voorwaardelijke afbeelding of video. Het framework maakt ook gebruik van een multi-stage trainingsstrategie om deze sub-modules effectief te leren om houdingscontrole en verschijning te ontkoppelen.

In samenvatting is het MagicDance-framework een

- Nieuw en effectief framework bestaande uit verschijningsontkoppelde houdingscontrole en verschijningscontrole-voortraining.

- Het MagicDance-framework is in staat om realistische menselijke gezichtsuitdrukkingen en menselijke beweging te genereren onder controle van houdingsvoorwaarden-invoer en referentieafbeeldingen of video’s.

- Het MagicDance-framework heeft als doel om verschijningsconsistent menselijke inhoud te genereren door een Multi-Source Attention Module in te voeren die nauwkeurige richtlijnen biedt voor het Stable Diffusion UNet-framework.

- Het MagicDance-framework kan ook worden gebruikt als een handige extensie of plug-in voor het Stable Diffusion-framework, en zorgt voor compatibiliteit met bestaande modelgewichten, aangezien het geen additional fine-tuning van de parameters vereist.

Bovendien toont het MagicDance-framework uitzonderlijke generaliseercapaciteiten voor zowel verschijning als beweging.

- Verschijningsgeneralisatie: Het MagicDance-framework toont superieure capaciteiten bij het genereren van diverse verschijningsvormen.

- Bewegingsgeneralisatie: Het MagicDance-framework heeft ook de mogelijkheid om een breed scala aan bewegingen te genereren.

MagicDance : Doelstellingen en Architectuur

Voor een gegeven referentieafbeelding, hetzij van een echte mens of een gestileerde afbeelding, is het primaire doel van het MagicDance-framework om een uitvoerbeeld of -video te genereren die is voorwaardelijk op de invoer en de houdingsinvoer {P, F}, waarbij P de menselijke houdingsskelet en F de gezichtslandmarks vertegenwoordigt. Het gegenereerde uitvoerbeeld of -video moet in staat zijn om de verschijning en identiteit van de betrokken mensen te behouden, evenals de achtergrondinhoud aanwezig in de referentieafbeelding, terwijl het de houding en uitdrukkingen gedefinieerd door de houdingsinvoer behoudt.

Architectuur

Tijdens het trainen wordt het MagicDance-framework getraind als een frame-reconstructietaken om de grondwaarheid te reconstrueren met de referentieafbeelding en houdingsinvoer afkomstig van dezelfde referentievideo. Tijdens het testen om bewegingsoverdracht te bereiken, wordt de houdingsinvoer en de referentieafbeelding afkomstig van verschillende bronnen.

De algehele architectuur van het MagicDance-framework kan worden opgesplitst in vier categorieën: Voorlopige fase, Verschijningscontrole-voortraining, Verschijningsontkoppelde Houdingscontrole en Bewegingsmodule.

Voorlopige Fase

Latente Diffusiemodellen of LDM vertegenwoordigen uniek ontworpen diffusiemodellen om te werken binnen de latente ruimte gefaciliteerd door het gebruik van een auto-encoder, en het Stable Diffusion-framework is een opvallend voorbeeld van LDM’s dat een Vector Quantized-Variational AutoEncoder en tijdelijke U-Net-architectuur gebruikt. Het Stable Diffusion-model gebruikt een CLIP-gebaseerde transformer als tekstencoder om tekstuele invoer te verwerken door tekstuele invoer om te zetten in embeddings. De trainingsfase van het Stable Diffusion-framework exposeert het model aan een tekstuele voorwaarde en een invoerbeeld, met een proces dat de codering van het beeld naar een latenterepresentatie omvat, en onderwerpt het aan een vooraf gedefinieerde reeks diffusiestappen gericht door een Gaussische methode. De resulterende reeks levert een lawaaierige latenterepresentatie op die een standaard normale verdeling biedt, met de primaire leerdoelstelling van het Stable Diffusion-framework het denoiseren van de lawaaierige latenterepresentaties iteratief in latenterepresentaties.

Verschijningscontrole-voortraining

Een groot probleem met het oorspronkelijke ControlNet-framework is zijn onvermogen om verschijning consistent te controleren onder ruimtelijk variabele bewegingen, hoewel het geneigd is om afbeeldingen te genereren met houdingen die sterk lijken op die in het invoerbeeld, met de algehele verschijning die voornamelijk wordt beïnvloed door tekstuele invoer. Hoewel deze methode werkt, is het niet geschikt voor bewegingsoverdracht-taken waarbij het niet de tekstuele invoer is, maar de referentieafbeelding die dient als de primaire bron voor verschijningsinformatie.

De Verschijningscontrole-voortraining-module in het MagicDance-framework is ontworpen als een hulpcomponent om richtlijnen te bieden voor verschijningscontrole in een laag-voor-laag-benadering. In plaats van te vertrouwen op tekstuele invoer, richt de algehele module zich op het benutten van de verschijningsattributen van de referentieafbeelding, met als doel om de capaciteit van het framework te verbeteren om de verschijningskenmerken nauwkeurig te genereren, met name in scenario’s met complexe bewegingsdynamica. Bovendien is alleen de Verschijningscontrole-Model trainbaar tijdens verschijningscontrole-voortraining.

Verschijningsontkoppelde Houdingscontrole

Een naive oplossing om de houding in het uitvoerbeeld te controleren is om het voorgetrainde ControlNet-model rechtstreeks te integreren met het voorgetrainde Verschijningscontrole-Model zonder fine-tuning. Echter, de integratie kan ertoe leiden dat het framework moeite heeft met verschijningsonafhankelijke houdingscontrole, wat kan leiden tot een discrepantie tussen de invoerhoudingen en de gegenereerde houdingen. Om deze discrepantie aan te pakken, fine-tuned het MagicDance-framework het Pose ControlNet-model gezamenlijk met het voorgetrainde Verschijningscontrole-Model.

Bewegingsmodule

Wanneer ze samenwerken, kunnen de Verschijningsontkoppelde HoudingscontroleNet en de Verschijningscontrole-Model accurate en effectieve beeld-naar-bewegingsoverdracht bereiken, hoewel het kan resulteren in tijdelijke inconsistentie. Om tijdelijke consistentie te garanderen, integreert het framework een extra bewegingsmodule in de primaire Stable Diffusion UNet-architectuur.

MagicDance : Voortraining en Datasets

Voor voortraining maakt het MagicDance-framework gebruik van een TikTok-dataset die bestaat uit meer dan 350 dansvideo’s van variabele lengte tussen 10 en 15 seconden, waarop een enkele persoon danst, met de meeste van deze video’s die het gezicht en de bovenlichamen van de mens bevatten. Het MagicDance-framework extrahiert elke individuele video bij 30 FPS en voert OpenPose uit op elk frame om de houdingsskelet, handhoudingen en gezichtslandmarks af te leiden.

Voor voortraining wordt het verschijningscontrole-model voorgetraind met een batchgrootte van 64 op 8 NVIDIA A100-GPU’s voor 10.000 stappen met een beeldgrootte van 512 x 512, gevolgd door het gezamenlijk fine-tunen van de houdingscontrole- en verschijningscontrole-modellen met een batchgrootte van 16 voor 20.000 stappen. Tijdens het trainen selecteert het MagicDance-framework willekeurig twee frames als doel en referentie, respectievelijk, met de afbeeldingen die op dezelfde positie en dezelfde hoogte worden bijgesneden. Tijdens de evaluatie knipt het model het beeld centraal in plaats van het willekeurig bij te snijden.

MagicDance : Resultaten

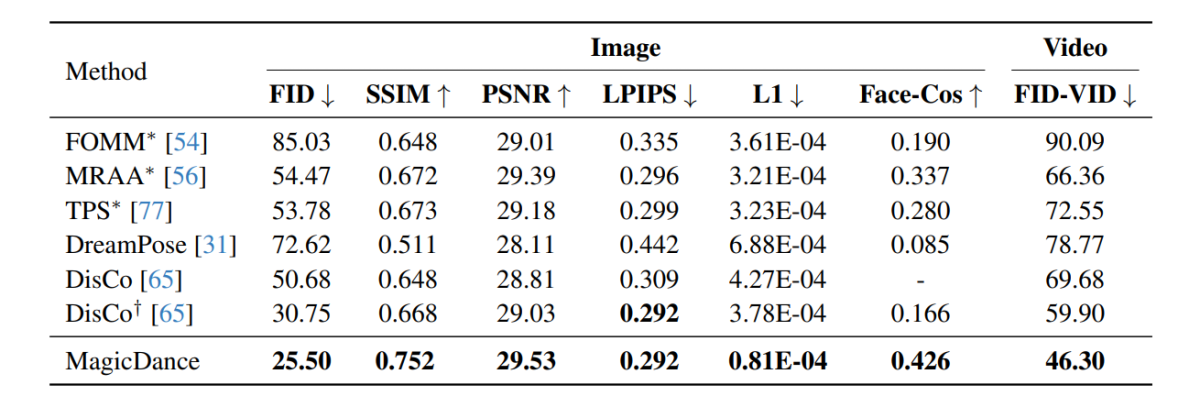

De experimentele resultaten die zijn uitgevoerd op het MagicDance-framework worden getoond in de volgende afbeelding, en zoals te zien is, overtreft het MagicDance-framework bestaande frameworks zoals Disco en DreamPose voor menselijke bewegingsoverdracht over alle metrics. Frameworks met een “*” voor de naam gebruiken het doelbeeld rechtstreeks als invoer en bevatten meer informatie dan de andere frameworks.

Het is interessant om op te merken dat het MagicDance-framework een Face-Cos-score van 0,426 bereikt, een verbetering van 156,62% ten opzichte van het Disco-framework, en bijna een 400% toename in vergelijking met het DreamPose-framework. De resultaten geven de robuuste capaciteit van het MagicDance-framework aan om identiteitsinformatie te behouden, en de zichtbare boost in prestaties geeft de superioriteit van het MagicDance-framework aan ten opzichte van bestaande state-of-the-art-methoden.

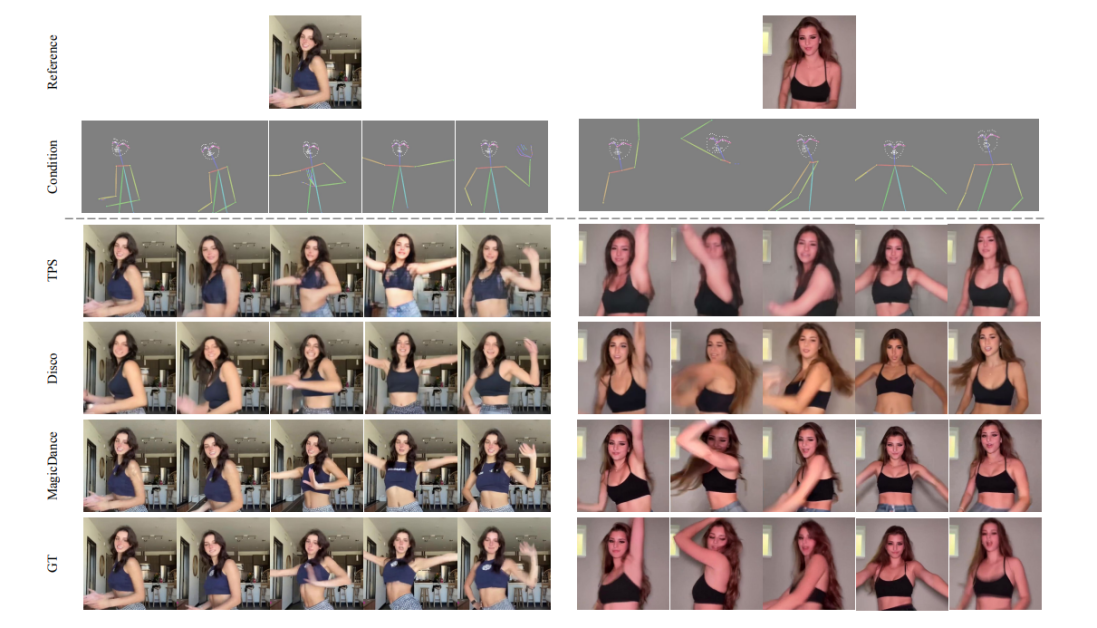

De volgende figuren vergelijken de kwaliteit van menselijke videogeneratie tussen het MagicDance-, Disco- en TPS-frameworks. Zoals te zien is, lijden de resultaten gegenereerd door de GT-, Disco- en TPS-frameworks aan inconsistente menselijke houdingsidentiteit en gezichtsuitdrukkingen.

Bovendien toont de volgende afbeelding de visualisatie van gezichtsuitdrukking en menselijke houdingsoverdracht op de TikTok-dataset, waarbij het MagicDance-framework in staat is om realistische en levendige uitdrukkingen en bewegingen te genereren onder diverse gezichtslandmarks en houdingsskelet-invoer, terwijl het identiteitsinformatie van de referentie-invoerbeeld nauwkeurig behoudt.

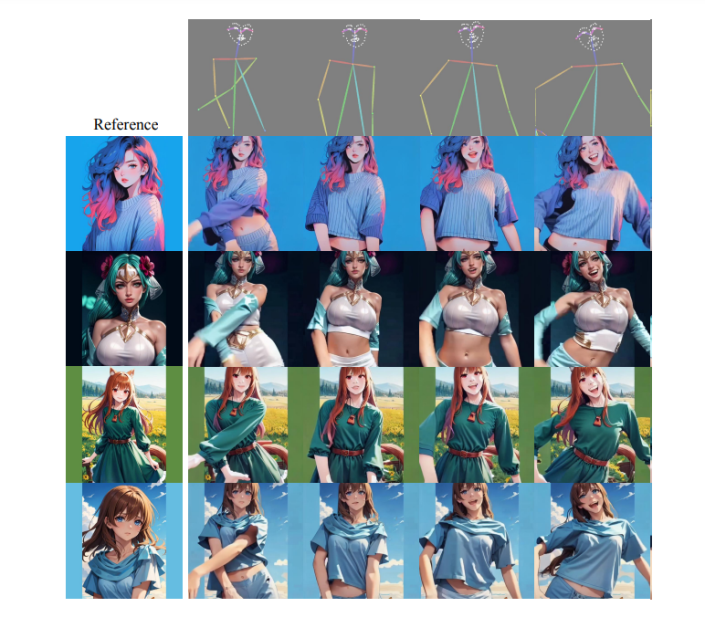

Het is de moeite waard om op te merken dat het MagicDance-framework uitzonderlijke generaliseercapaciteiten heeft voor out-of-domain referentiebeelden van ongezien pose en stijlen, met indrukwekkende verschijningscontrole, zelfs zonder enige additionele fine-tuning op het doeldomein, met resultaten die worden getoond in de volgende afbeelding.

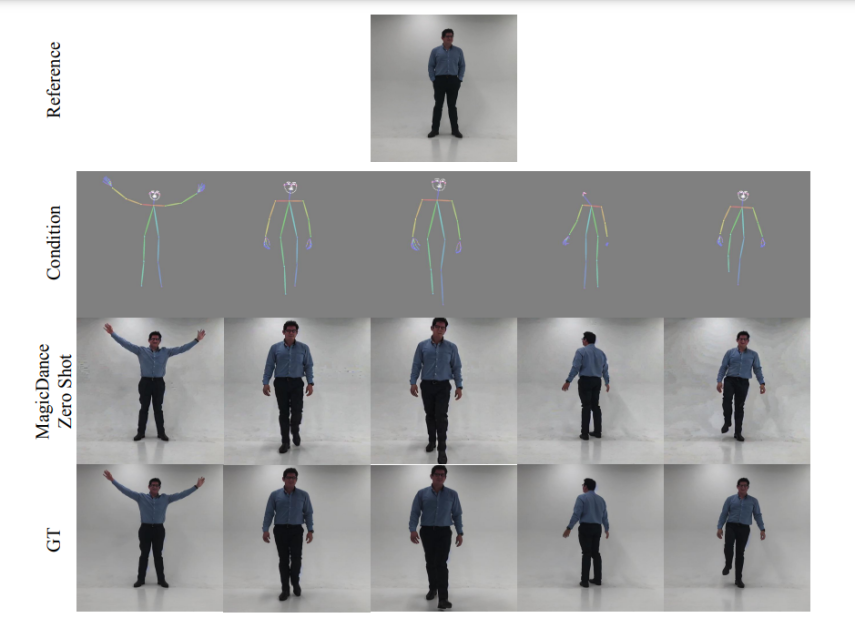

De volgende afbeeldingen demonstreren de visualisatiecapaciteiten van het MagicDance-framework in termen van gezichtsuitdrukkingsoverdracht en zero-shot menselijke beweging. Zoals te zien is, generaliseert het MagicDance-framework perfect naar in-het-wild-menselijke bewegingen.

MagicDance : Beperkingen

OpenPose is een essentieel onderdeel van het MagicDance-framework, aangezien het een cruciale rol speelt bij houdingscontrole, waardoor de kwaliteit en tijdelijke consistentie van de gegenereerde beelden aanzienlijk worden beïnvloed. Echter, het MagicDance-framework vindt het nog steeds een beetje moeilijk om gezichtslandmarks en houdingsskeletten nauwkeurig te detecteren, vooral wanneer de objecten in de afbeeldingen gedeeltelijk zichtbaar zijn of snel bewegen. Deze problemen kunnen leiden tot artefacten in het gegenereerde beeld.

Conclusie

In dit artikel hebben we het over MagicDance gehad, een diffusiegebaseerd model dat menselijke bewegingsoverdracht wil revolutioneren. Het MagicDance-framework probeert 2D-menselijke gezichtsuitdrukkingen en -bewegingen over te dragen op uitdagende menselijke dansvideo’s, met het specifieke doel om nieuwe pose-sequentie-gedreven menselijke dansvideo’s te genereren voor specifieke doelidentiteiten, terwijl de identiteit constant blijft. Het MagicDance-framework is een tweestaps trainingsstrategie voor menselijke bewegingsontkoppeling en verschijning, zoals huidskleur, gezichtsuitdrukkingen en kleding.

MagicDance is een nieuwe benadering om realistische menselijke videogeneratie te faciliteren door gezichts- en bewegingsuitdrukkingsoverdracht te integreren en consistente in-het-wild-animatiegeneratie mogelijk te maken zonder verdere fine-tuning, wat een significante vooruitgang betekent ten opzichte van bestaande methoden. Bovendien toont het MagicDance-framework uitzonderlijke generaliseercapaciteiten voor complexe bewegingssequenties en diverse menselijke identiteiten, waarmee het MagicDance-framework zich vestigt als de leider in het veld van AI-geassisteerde bewegingsoverdracht en videogeneratie.