AGI

현대적 생성형 AI 애플리케이션에서 벡터 데이터베이스의 역할

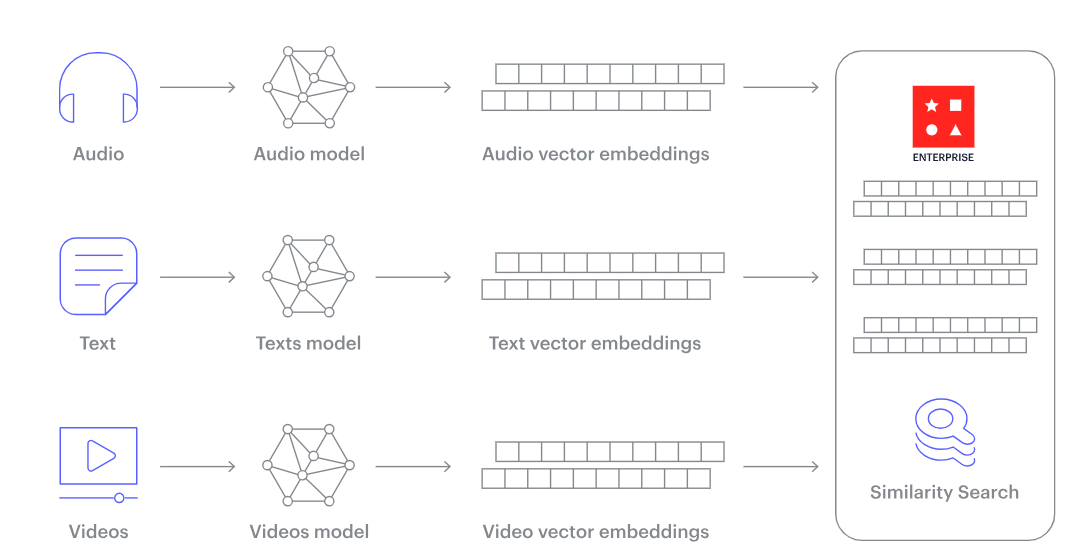

대규모 생성형 AI 애플리케이션이 효과적으로 작동하려면 많은 데이터를 처리할 수 있는 좋은 시스템이 필요합니다. 이러한 시스템 중 하나는 벡터 데이터베이스입니다. 이 데이터베이스가 다른 것을 차별화하는 것은 텍스트, 음성, 이미지, 비디오와 같은 다양한 유형의 데이터를 숫자/벡터 형태로 처리할 수 있는 능력입니다.

벡터 데이터베이스란?

벡터 데이터베이스는 고차원 벡터를 효율적으로 처리하도록 설계된 전문 저장 시스템입니다. 이러한 벡터는 다차원 공간의 점으로 생각할 수 있으며, 이미지, 텍스트 또는 음성과 같은 더 복잡한 데이터의 임베딩 또는 압축된 표현을 나타낼 수 있습니다.

벡터 데이터베이스를 사용하면 이러한 벡터 간의 유사성 검색을 빠르게 수행할 수 있으며, 방대한 데이터 세트에서 가장 유사한 항목을 빠르게 검색할 수 있습니다.

전통적인 데이터베이스 vs. 벡터 데이터베이스

벡터 데이터베이스:

- 고차원 데이터 처리: 벡터 데이터베이스는 고차원 공간의 데이터를 관리하고 저장하도록 설계되었습니다. 이는 기계 학습과 같은 애플리케이션에서 특히 유용합니다. 여기서 데이터 포인트(예: 이미지 또는 텍스트)는 다차원 공간의 벡터로 표현될 수 있습니다.

- 유사성 검색 최적화: 벡터 데이터베이스의 두드러진 기능 중 하나는 유사성 검색을 수행할 수 있는 능력입니다. 정확한 일치를 기반으로 데이터를 쿼리하는 대신, 이러한 데이터베이스를 사용하면 주어진 쿼리와 “유사한” 데이터를 검색할 수 있으므로 이미지 또는 텍스트 검색과 같은 작업에 매우 귀중합니다.

- 대규모 데이터 세트에 대한 확장성: AI 및 기계 학습 애플리케이션이 계속 성장함에 따라 처리하는 데이터의 양도 증가합니다. 벡터 데이터베이스는 성능이 저하되지 않도록 확장할 수 있도록 설계되었습니다.

전통적인 데이터베이스:

- 구조화된 데이터 저장: 전통적인 데이터베이스(예: 관계형 데이터베이스)는 구조화된 데이터를 저장하도록 설계되었습니다. 이는 데이터가 사전 정의된 테이블, 행 및 열로 구성되며, 데이터 무결성 및 일관성을 보장합니다.

- CRUD 작업 최적화: 전통적인 데이터베이스는 주로 CRUD 작업(생성, 읽기, 업데이트, 삭제)을 위해 최적화되었습니다. 이는 웹 서비스에서 기업 소프트웨어에 이르기까지 다양한 애플리케이션에 적합하도록 데이터 항목을 효율적으로 생성, 읽기, 업데이트 및 삭제하도록 설계되었습니다.

- 고정된 스키마: 많은 전통적인 데이터베이스의 특징 중 하나는 고정된 스키마입니다. 데이터베이스 구조가 정의되면 변경하는 것이 복잡하고 시간이 걸릴 수 있습니다. 이剛性은 데이터 일관성을 보장하지만 일부 현대 데이터베이스의 스키마가 없는 또는 동적 스키마 특성보다 덜 유연할 수 있습니다.

전통적인 데이터베이스는 임베딩의 복잡성을 다루는 데 어려움을 겪는 반면, 벡터 데이터베이스는 이러한 문제를 쉽게 해결합니다.

벡터 표현

벡터 데이터베이스의 작동에 핵심적인 개념은 다양한 형태의 데이터를 숫자 벡터를 사용하여 표현하는 것입니다. 예를 들어, 이미지의 경우 사용자는 귀여운 고양이 이미지로 볼 수 있지만, 기계는 고유한 512차원 벡터로 변환할 수 있습니다.

[0.23, 0.54, 0.32, …, 0.12, 0.45, 0.90]

벡터 데이터베이스를 사용하면 생성형 AI 애플리케이션이 더 많은 작업을 수행할 수 있습니다. 의미를 기반으로 정보를 찾고 오랜 시간 동안 기억할 수 있습니다. 흥미롭게도, 이 방법은 이미지에만 제한되지 않습니다. 문맥 및 의미를 포함하는 텍스트 데이터도 벡터 형태로 변환할 수 있습니다.

생성형 AI 및 벡터 데이터베이스의 필요성

생성형 AI는 종종 임베딩을 포함합니다. 예를 들어, 자연어 처리(NLP)에서 단어 임베딩을 고려해 보십시오. 단어 또는 문장은 의미를 캡처하는 벡터로 변환됩니다. 인간과 같은 텍스트를 생성할 때 모델은 관련 임베딩을 빠르게 비교 및 검색해야 하므로 생성된 텍스트가 문맥을 유지합니다.

이미지 또는 음성 생성의 경우에도 임베딩은 패턴 및 특징을 인코딩하는 데 중요한 역할을 합니다. 이러한 모델이 최적으로 작동하려면 유사한 벡터를 즉시 검색할 수 있는 데이터베이스가 필요하므로 벡터 데이터베이스는 생성형 AI 퍼즐의 필수 구성 요소입니다.

자연어 임베딩을 생성하는 데 일반적으로 사용되는 모델에는 다음이 포함됩니다.

- GPT-3 및 GPT-4: OpenAI의 GPT-3(Generative Pre-trained Transformer 3)는 NLP 커뮤니티에서 획기적인 모델이었으며 175억 개의 매개변수가 있습니다. 이후 GPT-4는 더 많은 매개변수를 사용하여 경계를 더욱 확장했습니다. 이러한 모델은 다양한 데이터 세트에서 훈련되어 광범위한 언어적ニュアンス를 캡처하는 임베딩을 생성할 수 있습니다.

- BERT 및 그 변형: BERT(Bidirectional Encoder Representations from Transformers)는 Google에서 개발한 또 다른 중요한 모델로, RoBERTa, DistillBERT와 같은 다양한 업데이트와 반복을 거쳤습니다. BERT의 양방향 훈련은 특히 주변의 컨텍스트를 이해하는 데 유용합니다.

- ELECTRA: 더 최근에 개발된 모델로, GPT-3 및 BERT와 같은 더 큰 모델과 비슷한 성능을 내면서도 더 적은 컴퓨팅 리소스를 필요로 합니다. ELECTRA는 사전 훈련 중에 실제 및 가짜 데이터를 구분하여 더 정교한 임베딩을 생성하는 데 도움이 됩니다.

이 프로세스를 이해하는 데:

임베딩 모델은 원하는 콘텐츠를 벡터 임베딩으로 변환하는 데 사용됩니다. 한 번 생성되면 이러한 임베딩은 벡터 데이터베이스에 저장됩니다. 쉽게 추적하고 관련성을 유지하기 위해 저장된 임베딩은 원래 콘텐츠와 연결되거나 참조를 유지합니다.

나중에 사용자 또는 시스템이 애플리케이션에 질문을 하면 동일한 임베딩 모델이 작동합니다. 쿼리를 해당 임베딩으로 변환합니다. 새로 생성된 임베딩은 벡터 데이터베이스를 검색하여 유사한 벡터 표현을 찾습니다. 일치로 식별된 임베딩은 직접 원래 콘텐츠와 관련이 있으므로 사용자의 쿼리에 정확한 결과가 표시됩니다.

신규 벡터 데이터베이스에 대한 자금 지원 증가

AI의 인기로 인해 많은 회사에서 벡터 데이터베이스를 개선하고 속도를 높이기 위해 더 많은 자금을 투자하고 있습니다. 이는最近 Pinecone, Chroma DB, Weviate와 같은 벡터 데이터베이스 스타트업에 대한 투자에서 볼 수 있습니다.

대기업인 Microsoft도 자체 도구를 보유하고 있습니다. 예를 들어, Azure Cognitive Search를 사용하면 비즈니스에서 벡터 데이터베이스를 사용하여 AI 도구를 만들 수 있습니다.

Oracle도 최근 Database 23c의 새로운 기능을 발표했으며, 통합 벡터 데이터베이스를 도입했습니다. “AI Vector Search”라는 이름의 새로운 데이터 유형, 인덱스 및 검색 도구를 사용하여 문서 및 이미지와 같은 데이터를 벡터를 사용하여 저장하고 검색할 수 있습니다. Retrieval Augmented Generation (RAG)를 지원하며, 이는 대형 언어 모델을 비즈니스 데이터와 결합하여 언어 질문에 대한 더 나은 답변을 제공하고 사적 데이터를 공유하지 않습니다.

주요 고려 사항: 벡터 데이터베이스

거리 측정

유사성 검색의 효과는 선택한 거리 측정에 따라 다릅니다. 일반적인 측정에는 유클리드 거리 및 코사인 유사성이 포함되며, 각 측정은 서로 다른 유형의 벡터 분포에 적합합니다.

인덱싱

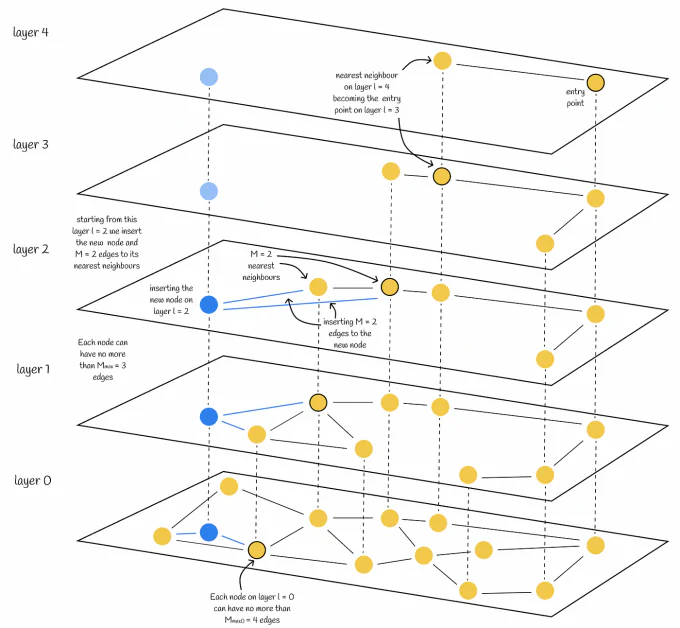

벡터의 고차원성으로 인해 전통적인 인덱싱 방법은 사용할 수 없습니다. 벡터 데이터베이스는 Hierarchical Navigable Small World (HNSW) 그래프 또는 Annoy 트리와 같은 기술을 사용하여 벡터 공간을 효율적으로 분할하고 빠른 근접 이웃 검색을 허용합니다.

Annoy tree (Source)

Annoy는 이진 검색 트리를 사용하는 방법입니다. 데이터 공간을 여러 번 분할하고 근접 이웃을 찾을 때 데이터의 일부만 확인합니다.

Hierarchical Navigable Small World (HNSW) graphs (Source)

HNSW 그래프는另一方面, 네트워크와 같습니다. 데이터 포인트를 특별한 방법으로 연결하여 검색을 더 빠르게 만듭니다. 이러한 그래프는 데이터에서 근접한 포인트를 빠르게 찾는 데 도움이 됩니다.

확장성

데이터 세트가 증가함에 따라 빠른 검색 시간을 유지하는 것이 어려워집니다. 분산 시스템, GPU 가속, 최적화된 메모리 관리와 같은 기술을 사용하여 벡터 데이터베이스는 확장성 문제를 해결합니다.

벡터 데이터베이스의 역할: 의미와 기회

1. 최신 생성형 AI 모델의 훈련 데이터: 생성형 AI 모델, 예를 들어 DALL-E 및 GPT-3,는 방대한 양의 데이터로 훈련됩니다. 이 데이터는 종종 이미지, 텍스트, 코드 및 기타 도메인에서 추출된 벡터로 구성됩니다. 벡터 데이터베이스는 이러한 데이터 세트를 신중하게 관리하여 AI 모델이 벡터 내에서 패턴 및 관계를 식별하여 세계의 지식을 흡수하고 분석할 수 있도록 합니다.

2. 최소 샷 학습의 발전: 최소 샷 학습은 모델이 제한된 데이터로 훈련되는 AI 훈련 기술입니다. 벡터 데이터베이스는 강력한 벡터 인덱스를 유지하여 이 접근 방식을 증폭합니다. 모델이 몇 개의 벡터(예: 몇 개의 이미지)에 노출되면 모델은 이러한 벡터 간의 유사성 및 관계를 인식하여 더广泛한 개념을 빠르게 외연할 수 있습니다.

3. 추천 시스템 개선: 추천 시스템은 사용자의 관심사와 일치하는 콘텐츠를 제안하기 위해 벡터 데이터베이스를 사용합니다. 사용자의 행동, 프로필 및 쿼리를 분석하여 관심사와 일치하는 벡터를 추출합니다. 시스템은 그러면 벡터 데이터베이스를 검색하여 관심사 벡터와密接하게 유사한 콘텐츠 벡터를 찾습니다. 이는 정확한 추천을 보장합니다.

4. 의미 정보 검색: 전통적인 검색 방법은 정확한 키워드 일치를 의존합니다. 그러나 벡터 데이터베이스는 시스템이 쿼리의 기본 의미를 이해하여 검색을 더 직관적으로 만듭니다. 즉, 검색은 단순히 단어를 일치시키는 것이 아니라 쿼리의 의도를 중심으로 수행됩니다. 예를 들어, 사용자가 쿼리를 입력하면 해당 벡터는 데이터베이스의 벡터와 비교하여 쿼리의 의도와 резонانس하는 콘텐츠를 찾습니다.

5. 멀티모달 검색: 멀티모달 검색은 데이터의 여러 소스(예: 텍스트, 이미지, 오디오, 비디오)를 통합하는 기술입니다. 벡터 데이터베이스는 다양한 모달리티의 벡터를 함께 분석할 수 있으므로 이 접근 방식의 백본을 제공합니다. 이는 사용자에게 더 풍부한 정보와 더全面적인 결과를 제공하는 홀리스틱 검색 경험을 제공합니다.

결론

AI 세계는 빠르게 발전하고 있습니다. 다양한 산업에 영향을 미치며, 좋은 것과 새로운 문제를 가져옵니다. 생성형 AI의 빠른 발전은 현대적 AI 애플리케이션에서 벡터 데이터베이스의 중요한 역할을 강조합니다.

이러한 전문 저장 시스템은 이미지, 텍스트 또는 음성과 같은 다양한 데이터 형식에서 고차원 벡터를 처리할 수 있는 능력으로 다른 것을 구별하며, 특히 유사성 검색에서 생성형 AI 애플리케이션의 효과적인 작동에 핵심적인 역할을 합니다.

그들의 중요성은 또한 이 분야에 대한 투자로 강조됩니다. Pinecone 및 Microsoft와 같은 스타트업과 대기업이 모두 발전을 기여하고 있습니다.