Anderson의 관점

확산 모델의 거울 및 반사 이해 한계 해결하기

생성형 AI가 대중의 관심을 끌기 시작한 이래, 컴퓨터 비전 연구 분야는 물리 법칙을 이해하고 재현할 수 있는 AI 모델 개발에 대한 관심을 깊어지게 해왔습니다. 그러나 중력 및 액체 역학과 같은 현상을 시뮬레이션하도록 머신러닝 시스템을 가르치는 과제는 적어도 지난 5년간 연구 노력의 중요한 초점이 되어왔습니다. 잠재 확산 모델(LDMs)이 2022년 생성형 AI 장면을 지배하게 된 이후, 연구자들은 물리 현상을 이해하고 재현하는 LDM 아키텍처의 제한된 능력에 점점 더 집중해 왔습니다. 이제 이 문제는 OpenAI의 생성형 비디오 모델 Sora의 획기적인 개발과 (논란의 여지가 있지만) 더 중요한 최근 오픈 소스 비디오 모델 Hunyuan Video 및 Wan 2.1의 출시로 인해 추가적인 주목을 받고 있습니다.

나쁜 반사

물리학에 대한 LDM 이해를 향상시키기 위한 대부분의 연구는 보행 시뮬레이션, 입자 물리학 및 뉴턴 역학의 다른 측면과 같은 영역에 집중해 왔습니다. 이러한 영역들은 기본 물리적 행동의 부정확성이 AI 생성 비디오의 진실성을 즉시 훼손할 것이기 때문에 주목을 받았습니다. 그러나 작지만 성장하는 연구 흐름은 LDM의 가장 큰 약점 중 하나인 정확한 반사를 생성하는 데 있어 상대적인 무능력에 집중하고 있습니다.

2025년 1월 논문 ‘Reflecting Reality: Enabling Diffusion Models to Produce Faithful Mirror Reflections’에서, ‘반사 실패’ 사례와 연구자들의 접근법 비교. 출처: https://arxiv.org/pdf/2409.14677

이 문제는 CGI 시대에도 어려웠으며, 광선의 경로가 표면과 상호작용하는 것을 시뮬레이션하는 레이 트레이싱 알고리즘이 사용되는 비디오 게임 분야에서도 여전히 그러합니다. 레이 트레이싱은 가상 광선이 물체에 반사되거나 통과하여 사실적인 반사, 굴절 및 그림자를 생성하는 방식을 계산합니다. 그러나 각 추가적인 반사는 계산 비용을 크게 증가시키기 때문에, 실시간 애플리케이션은 허용되는 광선 반사 횟수를 제한하여 지연 시간과 정확도를 절충해야 합니다.

![전통적인 3D 기반(즉, CGI) 시나리오에서 가상으로 계산된 광선의 표현. 1960년대에 처음 개발되어 1982-93년 사이에 정점을 이룬 기술과 원리 사용('트론' [1982]과 '쥬라기 공원' [1993] 사이의 기간). 출처: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing](https://www.unite.ai/wp-content/uploads/2025/04/ray-tracing.jpg)

전통적인 3D 기반(즉, CGI) 시나리오에서 가상으로 계산된 광선의 표현. 1960년대에 처음 개발되어 1982-93년 사이에 정점을 이룬 기술과 원리 사용(‘트론’ [1982]과 ‘쥬라기 공원’ [1993] 사이의 기간). 출처: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing

예를 들어, 거울 앞에 크롬 주전자를 묘사하는 것은 광선이 반사 표면 사이를 반복적으로 튀어 거의 무한한 루프를 생성하는 레이 트레이싱 과정을 포함할 수 있으며, 이는 최종 이미지에 실질적인 이점이 거의 없습니다. 대부분의 경우, 2~3회의 반사 깊이는 이미 시청자가 인지할 수 있는 것을 초과합니다. 단일 반사는 검은 거울을 초래할 것입니다. 왜냐하면 빛이 가시적인 반사를 형성하려면 적어도 두 번의 이동을 완료해야 하기 때문입니다. 각 추가 반사는 렌더링 시간을 종종 두 배로 늘리며 계산 비용을 급격히 증가시켜, 반사의 더 빠른 처리가 레이 트레이싱 렌더링 품질을 향상시키는 가장 중요한 기회 중 하나가 되게 합니다. 당연히, 반사는 훨씬 덜 명백한 시나리오에서도 발생하며 사진 사실주의에 필수적입니다. 예를 들어 비가 온 후 도시 거리나 전장의 반사 표면; 상점 창문이나 유리 문에 비친 맞은편 거리; 또는 묘사된 인물의 안경에서, 물체와 환경이 나타나야 할 수 있습니다.

‘매트릭스'(1999)의 상징적인 장면을 위해 전통적인 합성을 통해 달성된 시뮬레이션된 이중 반사.

이미지 문제

이러한 이유로, 확산 모델 등장 이전에 인기 있었던 Neural Radiance Fields(NeRF)와 같은 프레임워크 및 Gaussian Splatting과 같은 더 최근의 일부 도전자들은 자연스러운 방식으로 반사를 구현하는 데 자체적인 어려움을 겪어 왔습니다. REF2-NeRF 프로젝트(아래 그림)는 유리 케이스를 포함하는 장면을 위한 NeRF 기반 모델링 방법을 제안했습니다. 이 방법에서 굴절과 반사는 시청자의 시점에 종속적이고 독립적인 요소를 사용하여 모델링되었습니다. 이 접근 방식은 연구자들이 굴절이 발생하는 표면, 특히 유리 표면을 추정하고 직접광과 반사광 구성 요소를 분리 및 모델링할 수 있게 했습니다.

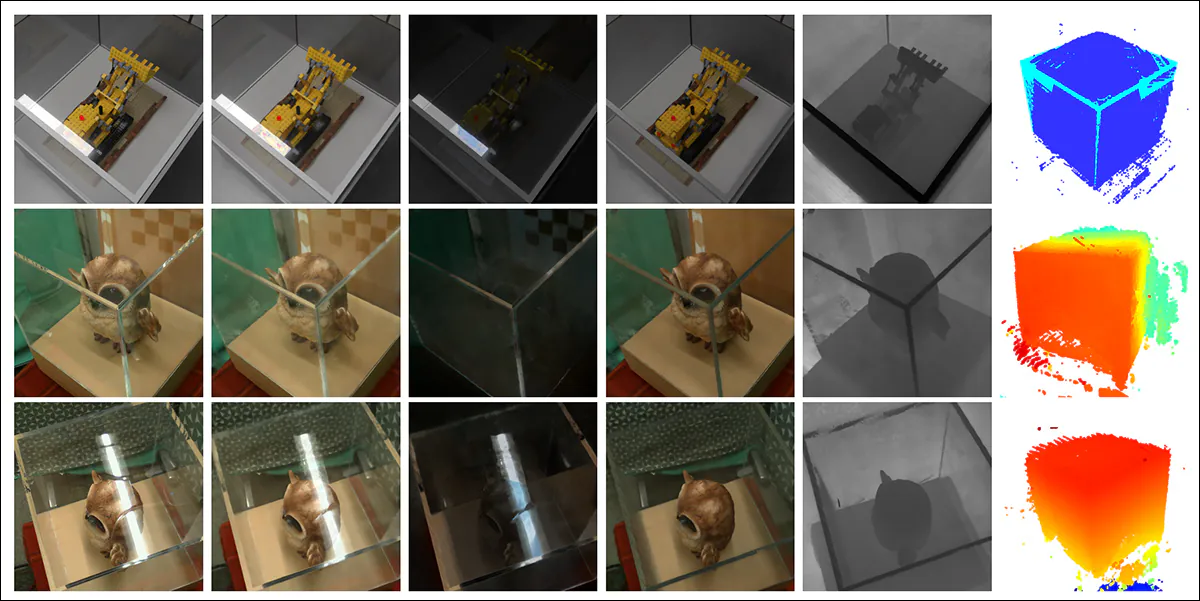

Ref2Nerf 논문의 예시. 출처: https://arxiv.org/pdf/2311.17116

지난 4-5년간의 다른 NeRF 대응 반사 솔루션에는 NeRFReN, Reflecting Reality 및 Meta의 2024년 Planar Reflection-Aware Neural Radiance Fields 프로젝트가 포함되었습니다. GSplat의 경우, Mirror-3DGS, Reflective Gaussian Splatting 및 RefGaussian과 같은 논문들이 반사 문제에 대한 솔루션을 제공했으며, 2023년 Nero 프로젝트는 반사 특성을 신경 표현에 통합하는 맞춤형 방법을 제안했습니다.

미러버스

확산 모델이 반사 논리를 존중하도록 하는 것은 Gaussian Splatting 및 NeRF와 같은 명시적 구조적, 비의미적 접근 방식보다 논란의 여지가 있지만 더 어려울 수 있습니다. 확산 모델에서 이러한 종류의 규칙은 훈련 데이터에 광범위한 시나리오에 걸쳐 다양한 예시가 많이 포함되어 있을 때만 안정적으로 내재될 가능성이 높아, 원본 데이터셋의 분포와 품질에 크게 의존합니다. 전통적으로, 이러한 종류의 특정 행동을 추가하는 것은 LoRA 또는 기본 모델의 파인튜닝의 영역입니다. 그러나 이는 이상적인 솔루션이 아닙니다. LoRA는 프롬프트 없이도 자체 훈련 데이터로 출력을 왜곡하는 경향이 있으며, 파인튜닝은 비용이 많이 들 뿐만 아니라 주요 모델을 주류에서 돌이킬 수 없게 분기시키고, 원본 모델을 포함한 모델의 다른 계열과는 절대 작동하지 않는 관련 맞춤형 도구들을 다수 생성할 수 있기 때문입니다. 일반적으로, 확산 모델을 개선하려면 훈련 데이터가 반사의 물리학에 더 많은 주의를 기울여야 합니다. 그러나 많은 다른 영역들도 유사한 특별한 주의가 필요합니다. 맞춤 큐레이션이 비용이 많이 들고 어려운 초대규모 데이터셋의 맥락에서, 이러한 방식으로 모든 단일 약점을 해결하는 것은 비현실적입니다. 그럼에도 불구하고, LDM 반사 문제에 대한 솔루션은 가끔씩 나타납니다. 최근 인도에서 나온 그러한 노력 중 하나는 MirrorVerse 프로젝트로, 확산 연구에서 이 특정 과제의 최첨단 기술을 개선할 수 있는 향상된 데이터셋과 훈련 방법을 제공합니다.

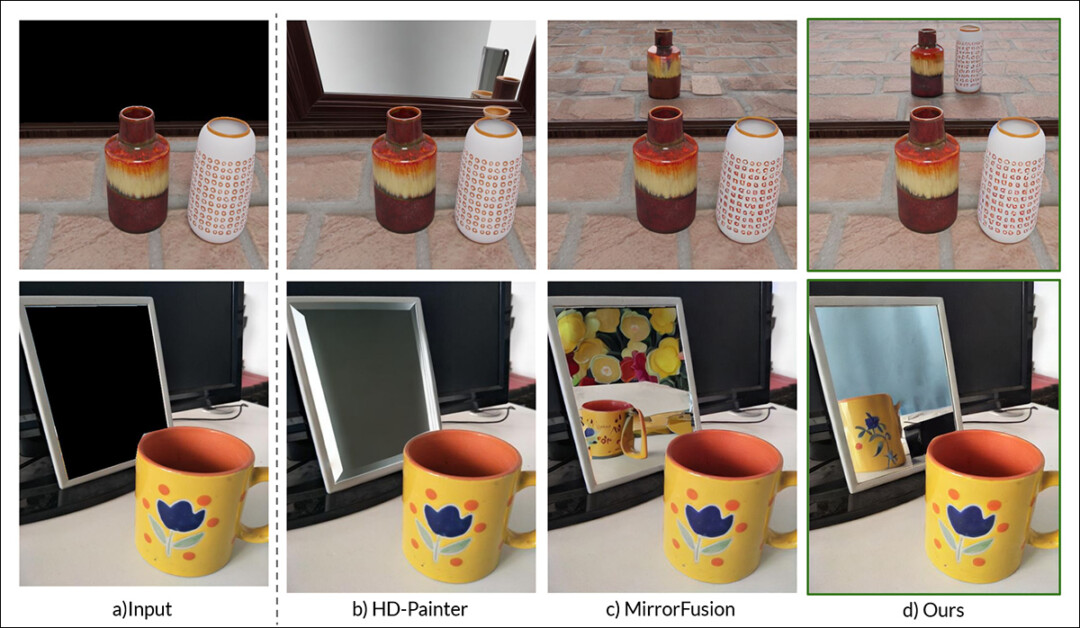

가장 오른쪽, MirrorVerse의 결과가 두 가지 이전 접근법(중앙 두 열)과 비교. 출처: https://arxiv.org/pdf/2504.15397

위 예시(새 연구의 PDF 피처 이미지)에서 볼 수 있듯이, MirrorVerse는 동일한 문제를 해결하는 최근 제안들보다 개선되었지만 완벽과는 거리가 멉니다. 오른쪽 상단 이미지에서 도자기 항아리들이 있어야 할 위치보다 다소 오른쪽에 있는 것을 볼 수 있으며, 아래 이미지에서는 기술적으로 컵의 반사가 전혀 나타나지 않아야 함에도 불구하고, 자연스러운 반사 각도의 논리에 반하여 부정확한 반사가 오른쪽 영역에 억지로 끼워져 있습니다. 따라서 우리는 새로운 방법이 확산 기반 반사의 현재 최첨단 기술을 대표할 수 있기 때문보다는, 잠재 확산 모델(정적 및 비디오 모두)에게 이것이 다루기 어려운 문제임을 입증할 수 있는 정도를 설명하기 위해 동일하게 살펴볼 것입니다. 왜냐하면 반사성에 필요한 데이터 예시들은 특정 행동 및 시나리오와 얽힐 가능성이 가장 높기 때문입니다. 따라서 LDM의 이 특정 기능은 NeRF, GSplat 및 전통적인 CGI와 같은 구조 특화 접근 방식에 계속 미치지 못할 수 있습니다. 새 논문은 MirrorVerse: Pushing Diffusion Models to Realistically Reflect the World이라는 제목이며, Vision and AI Lab, IISc Bangalore 및 삼성 R&D Institute Bangalore의 세 명의 연구자로부터 나왔습니다. 이 논문에는 관련 프로젝트 페이지와 Hugging Face의 데이터셋이 있으며, 소스 코드는 GitHub에서 공개되었습니다.

방법

연구자들은 처음부터 Stable Diffusion 및 Flux와 같은 모델들이 반사 기반 프롬프트를 존중하는 데 어려움을 겪는다고 지적하며, 이 문제를 능숙하게 설명합니다:

논문에서: 현재 최첨단 텍스트-이미지 모델인 SD3.5와 Flux는 장면에서 반사를 생성하라는 프롬프트를 받았을 때 일관되고 기하학적으로 정확한 반사를 생성하는 데 상당한 어려움을 보였습니다.

연구자들은 합성 이미지에서 거울 반사의 사진 사실성과 기하학적 정확성을 향상시키기 위한 확산 기반 생성 모델인 MirrorFusion 2.0을 개발했습니다. 모델 훈련은 이전 접근법에서 관찰된 일반화 약점을 해