Anderson의 관점

‘젠’ 방법으로 언어 모델이 환각을 멈추게 하는 방법

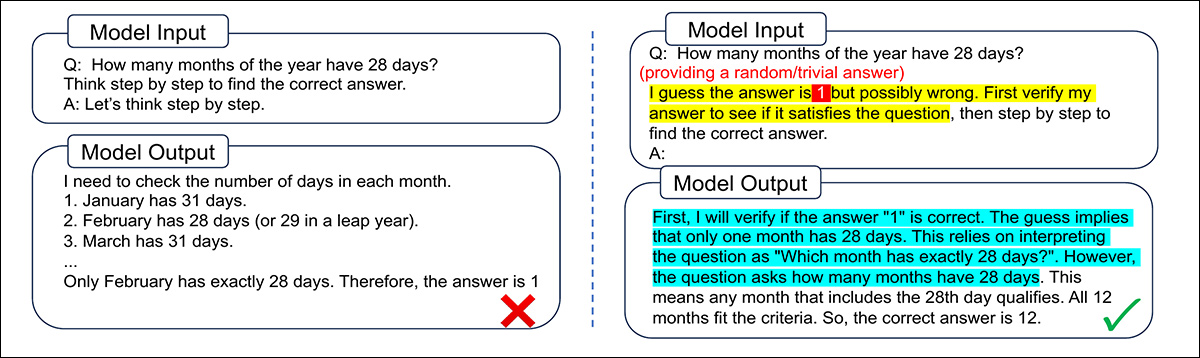

ChatGPT에 무작위 답변을事実 확인하기 전에 실제 문제를 해결하도록 지시하면 모델이 더 열심히 생각하고, 더 자주 올바른 답변을 내놓게 됩니다. 즉, 이전의 ‘무작위’ 답변과 실제 질의 간에 아무런 관련이 없어도 말입니다.

중국에서 나온 새로운 논문은 언어 모델이 환각을 멈추게 하고 답변의 품질을 향상시키는 매우 저렴한 방법을 개발했습니다. 즉, 모델에 완전히無関係한 질문의 답변을事実 확인하도록 지시하는 것입니다:

LLM의 ‘마음을 자유롭게’ 해주고 실제 질의에 집중할 수 있도록 도와주는 무관계 질문의 예. 출처

이 젠_slap은 다른 방법들, 즉 fine-tuning, prompt-crafting, 및 parallel sampling에 비해 훨씬 저렴한 방법으로, 오픈 소스 및 클로즈드 소스 모델 모두에서 작동합니다. 이는 여러 LLM 아키텍처에 공통적인 기본 특성을 발견했음을 의미합니다(특정 훈련 자료 또는 방법에 특화된 취약한 특성은 아닙니다).

연구자들은 이러한 방법으로 가능한 규모의 경제를 설명합니다:

‘최소한의 추가적인 사전 지식을 필요로 하기 위해, VF는 프로ンプ트에 무작위/사소한 답변을 제공할 필요가 있습니다. 검증 과정은 일반적인 CoT 경로보다 출력 토큰이 훨씬 적으며, 때로는 명시적인 검증 전용 프로세스가 없으므로 매우 적은 추가 테스트 계산이 필요합니다.’

테스트에서, 이 접근법 – Verification-First(VF)로 명명됨 – 다양한 작업에서 답변을 개선할 수 있음을 보여주었으며, 이는 오픈 소스 및 상업용 플랫폼 모두에서 작동합니다.

이 기술이 작동하는 이유 중 일부는 언어 모델이 인간 심리학의 경향을 흡수하고 적応시키는 방식에 기인할 수 있습니다. 즉, 직접적인 질문은 모델을 ‘수비적’이고 ‘신경질적’하게 만들 수 있으나, 다른 사람의 작업을 검증하도록 요청하는 것은 이러한 ‘생존 본능’을 자극하지 않습니다.

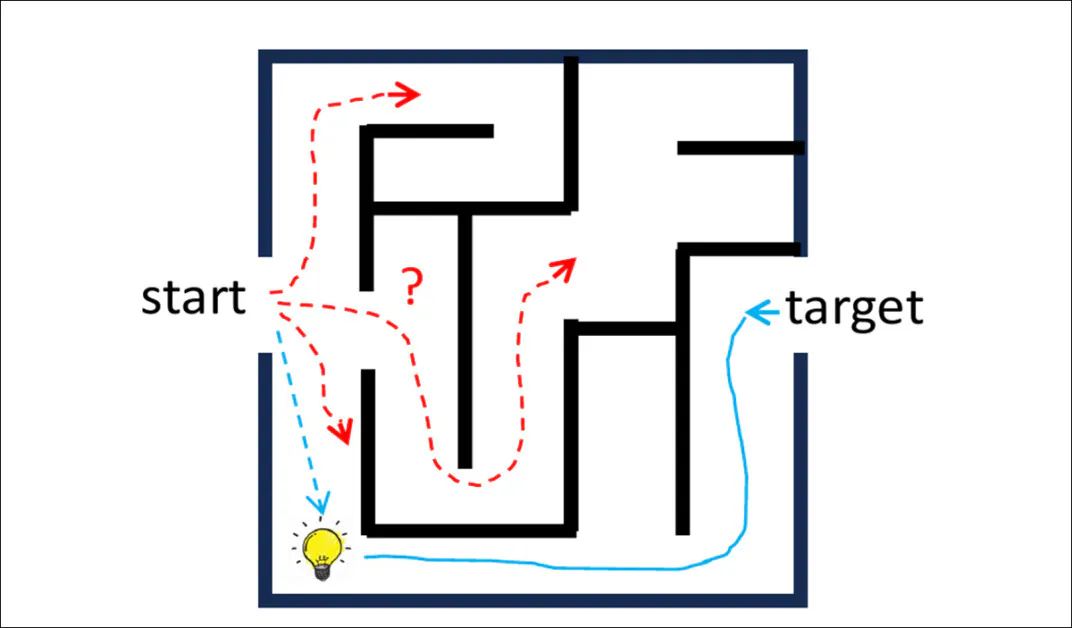

핵심 아이디어는 답변을 검증하는 것이 답변을 처음부터 생성하는 것보다 더 적은 노력이 필요하며, 표준 chain-of-thought를 보완하는 다른推論 경로를 트리거할 수 있다는 것입니다.

모델에 주어진 답변을 비판하도록 지시하는 것(즉, 모델이 생성하지 않은 답변)은 또한 모델의 첫 인상에 대한過度 自信을 피하는 데 도움이 되는 비판적思考을 활성화할 수 있습니다.

연구는 이 과정을 reverse-reasoning path로 설명합니다:

제안된 답변에서 시작하여 문제로 역방향으로推論하는 과정은 단순한 경로를 따를 수 있으며 표준 chain-of-thought 推論에 보완적인 정보를 제공할 수 있습니다.

연구자들은 또한 이 핵심 개념을 Iter-VF로 구체화했습니다. 이는 순차적 시간 테스트 스케일링 방법으로, 반복적으로 답변을 정제하며, LLM 아키텍처에서 자주 발견되는 오류 누적 문제를 피합니다.

새로운 연구는 Asking LLMs to Verify First is Almost Free Lunch로 명명되었으며, 베이징의 청화대 전자공학과의 두 연구자에 의해 수행되었습니다.

방법

새로운 연구의 핵심 아이디어는 언어 모델의 일반적인 推論 흐름을 뒤집는 것입니다. 즉, 모델에 문제를 처음부터 해결하도록 지시하는 대신, 후보 답변을 제공하고 그 답변을 검증하도록 지시합니다.

이것은 모델이 역방향으로 推論하도록 유도합니다. 즉, 제안된 답변에서 시작하여 문제로 역방향으로推論합니다. 검증이 완료되면 모델은 원래 문제를 일반적으로 해결합니다.

이 역방향은 모델이 더 신중하게 推論하도록 유도하며, 무의미한 오류를 줄이고, 더 성찰적인 推論 모드를 장려하여 모델이 숨겨진 구조를 발견하고 오도적인 가정들을 피할 수 있도록 도와줍니다.

예를 들어, 모델에明显히 잘못된 추측인 ’10’ 을 검증하도록 지시하는 것조차도 모델이 논리적 결함에서 회복하고 표준 chain-of-thought 프롬프팅보다 더 나은 성능을 발휘하도록 도와줄 수 있습니다:

모델에 추측된 답변을 검증하도록 지시하면 모델이 모순점을 발견하고 문제에 더주의적으로 참여하도록 도와줍니다. 이 예에서는 표준 접근법이 유창하지만 잘못된 해결책으로 이어지며, Verification-First 프롬프팅은 더 명확한 논리적 구조와 올바른 결과를 트리거합니다.

실제 문제의 경우, 모델에 검증할 답변을 제공하는 것이 쉽지 않을 수 있습니다. 특히 작업이 공개되어 있거나 코드를 작성하거나 API를 호출하는 경우에는 더욱 그렇습니다. 따라서 이 방법은 모델이 일반적으로 답변을 생성한 다음, 그 답변을 Verification-First 형식으로 다시 입력합니다.这样하면 모델이 자신의 출력을 검증하고 개선할 수 있습니다:

모델이 자신의 이전 출력을 검증하도록 지시하면 모델은 자신의 논리적 결함을 발견하고 해결책을 올바르게 다시 작성합니다. Verification-First 프롬프팅은 모델이 특정 오류에 집중할 수 있도록 도와줍니다.

이 접근법은 앞서 언급한 Iter-VF를 구성합니다. 모델은 이 사이클을 반복하며, 각 번에 답변을 정제합니다. 재훈련이나 맞춤형 도구가 필요 없습니다. 다른 자기 수정 전략과 달리, Iter-VF는 각 단계에서 가장 최근의 답변만 고려하므로, 推論을 혼란스럽게 하지 않습니다.

데이터 및 테스트

연구자들은 이 방법을 네 가지 도메인에서 평가했습니다: 일반적인 推論 작업, VF에 사소한 추측을 제공하는 경우; 시간에 민감한 작업, Iter-VF를 라이벌 스케일링 방법과 비교하는 경우; 개방형 문제인 코드 작성이나 API 호출, VF가 모델의 이전 답변을 사용하는 경우; 및 클로즈드 소스 상업용 LLM, 내부 推論 단계가 접근할 수 없는 경우.

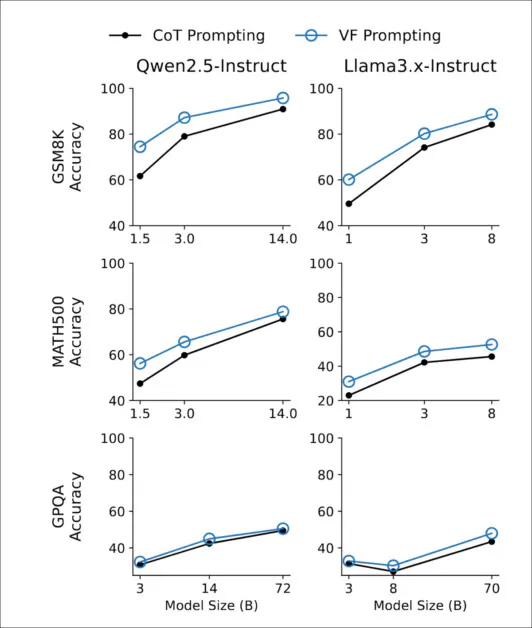

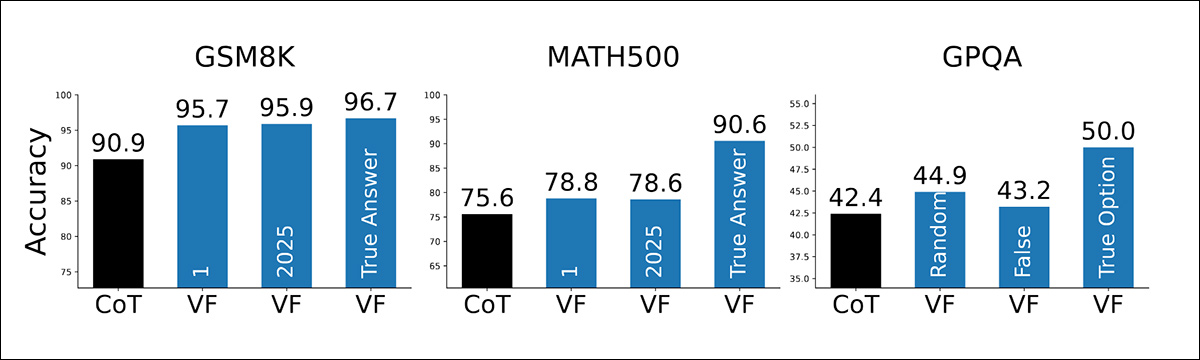

연구자들은 세 가지 推論 벤치마크를 사용했습니다: GSM8K 및 MATH500는 수학 문제를 위한 것입니다. 또한 GPQA-Diamond는 대학원 수준의 과학 질문을 위한 것입니다.

각 경우에, 모델은 사소한 추측(예: 数値答案의 경우 ‘1’) 또는 무작위로 섞인 다중 선택 옵션을 시작점으로 사용했습니다. 특별한 튜닝이나 사전 지식이 추가되지 않았으며, 기준은 표준 제로샷 체인오브사고 프롬프팅이었습니다.

테스트는 Qwen2.5와 Llama3 인스트럭션 튜닝 모델의 범위에서 실행되었습니다. Qwen 모델은 Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct, 및 Qwen2.5-72B-Instruct였습니다. Llama3 변형은 Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct, 및 Llama3.3-70B-Instruct였습니다.

다음과 같이, Verification-First 프롬프팅의 개선은 모든 모델 크기에서 일관되게 유지되었습니다. 명확한 이익은 1B 파라미터에서부터 72B까지 모두 나타났습니다:

모든 Qwen2.5 및 Llama3 모델 크기에서 Verification-First 프롬프팅이 GSM8K, MATH500, 및 GPQA-Diamond에서 표준 체인오브사고 프롬프팅을 일관되게 능가합니다.

이 효과는 수학 벤치마크인 GSM8K 및 MATH500에서 가장 강했습니다. 여기서 잘못된 답변을 검증하는 것이 推論을 개선하는 데 더 도움이 되었습니다. GPQA-Diamond의 경우, 저장된 지식에 의존하는 경우보다 더 낮았지만 일관되게 유지되었습니다.

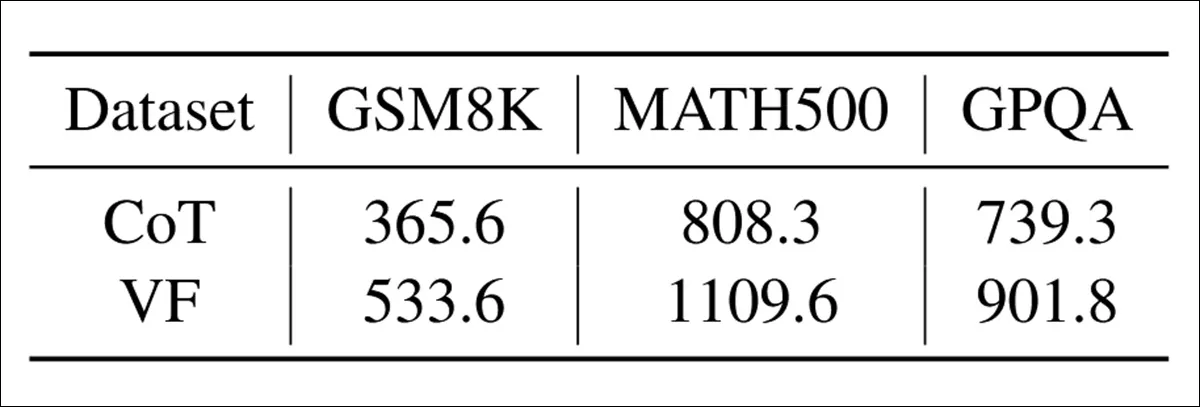

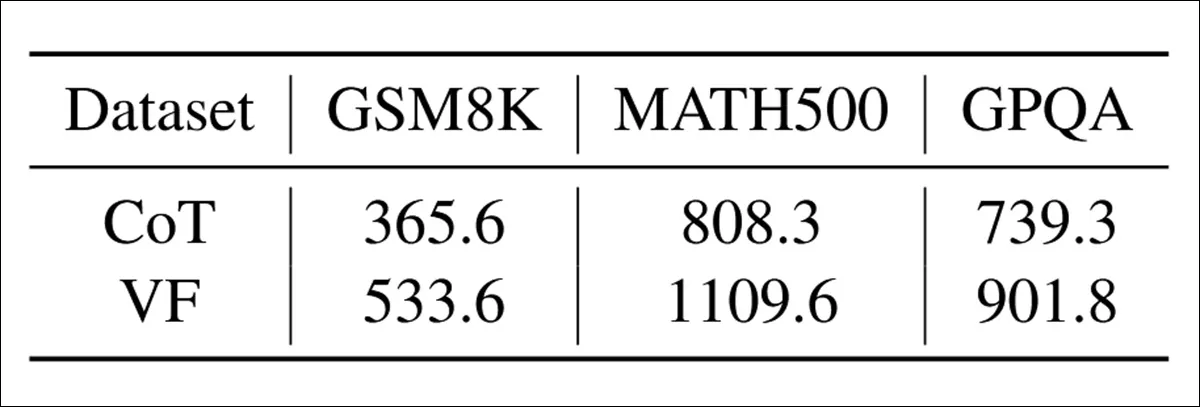

Verification-First의 계산 비용은 적었습니다. 다음 표에서, 검증 단계를 생성하는 것이 표준 체인오브사고 프롬프팅보다 출력 토큰이 약 20-50% 더 많음을 알 수 있습니다:

GSM8K, MATH500, 및 GPQA 벤치마크에서 각 프롬프팅 방법에 대한 평균 출력 토큰 수.

이 추가 비용은 다중 샘플링이나 재귀 계획을 요구하는 전략의 비용보다 훨씬 낮았습니다.

다음 그래프에서, 이 방법이 추측된 답변의 품질에 얼마나 민감한지 볼 수 있습니다. 놀랍게도, 추측이 사소한 (‘1’) 경우, 비현실적인 (‘2025’) 경우, 또는 무작위로 선택된 다중 선택 옵션인 경우에도 Verification-First는 표준 프롬프팅을 능가합니다:

GSM8K, MATH500, 및 GPQA에서 Verification-First 프롬프팅의 정확도 향상, 모델이 사소한, 비현실적인, 또는 올바른 답변을 검증하도록 지시하는 경우.

기대대로, 추측이 올바른 답변인 경우 정확도가 더 높아집니다. 그러나 이 방법은 일관되게 잘 작동했으며, 이는 정보가 추측된 답변 자체에서 비롯된 것이 아니라 단순히 검증 행위 자체에서 비롯된 것으로 보입니다.

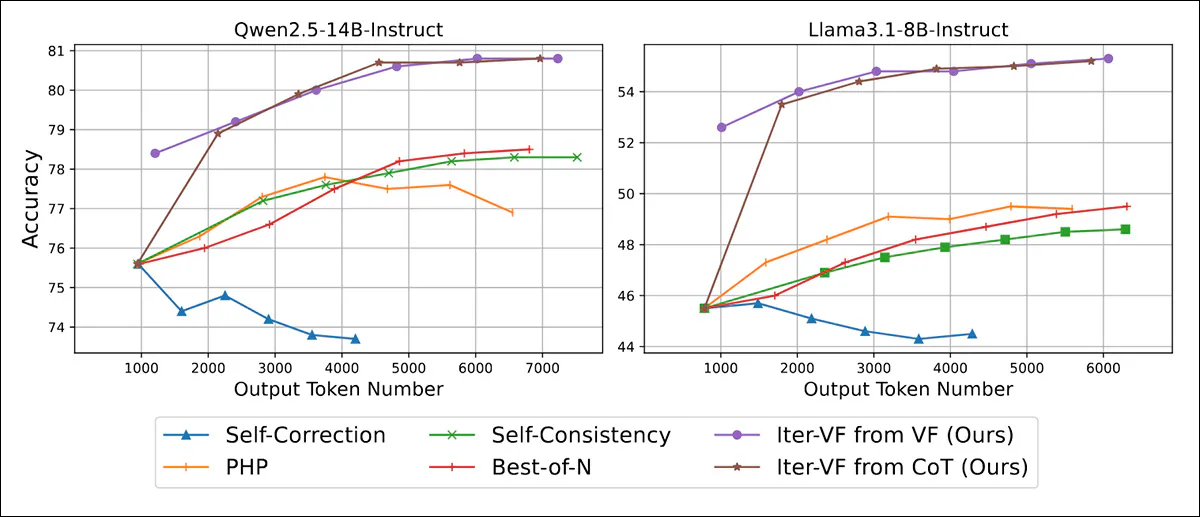

Iter-VF는 또한 네 가지 테스트 시간 스케일링 전략과 비교되었습니다. 이 전략들은 재훈련이나 작업별 적응 없이 작동합니다. Self-Correction에서, 모델은 이전 推論 단계를 반영하여 답변을 수정하도록 지시받습니다. PHP에서, 이전 답변은 입력으로 컨텍스트 힌트로 추가되지만, 이를 사용하는 방법에 대한 지시는 제공되지 않습니다.

또한, Self-Consistency에서, 여러 推論 경로가 샘플링되고 최종 답변은 다수결 투표로 선택됩니다. 마지막으로, Best-of-N에서, 여러 출력이 독립적으로 생성되고 검증자 프롬프트를 사용하여 순위가 매겨지며,最高 순위 응답이 선택됩니다.

Iter-VF의 두 가지 변형이 구현되었습니다. 하나는 사소한 추측(‘1’)으로 초기화되고, 다른 하나는 표준 CoT 출력으로 초기화됩니다:

MATH500에서 증가하는 출력 예산에 따른 정확도 및 토큰 효율성, 두 가지 Iter-VF 변형이 모든 모델 크기에서 기준을 능가하는 것을 보여줍니다.

Iter-VF는 낮은 컴퓨팅 자원에서 모든 다른 방법보다 더 나은 결과를 보여주었습니다. 이는 Iter-VF가 답변을 검증하는 방식에 기인하는 것으로, 초기 답변의 품질과는 관련이 없습니다(두 변형은 모두 빠르게 유사한 정확도에 도달합니다).

PHP는 더 나쁨으로 판명되었는데, 이는 이전 답변을 힌트로 재사용했음에도 불구하고, LLM이 이러한 힌트를 잘 활용하지 못했기 때문입니다.

반면에, PHP 및 Self-Correction과 달리 Iter-VF는 각 단계에서 가장 최근의 답변만 고려합니다. 이 마르코프 접근법은 확장된 推論 체인의 혼란을 피합니다. 이는 특히 Self-Correction에 치명적인 약점입니다.

병렬 방법인 Self-Consistency 및 Best-of-N은 이 문제를 피합니다. 그러나 그들의 개선은 더 느리고 더 소규모입니다.

(참고: 결과 섹션은 철저하지만, 읽기가 어렵고, 우리는 이 시점에서 대부분의 남은 커버리지를 생략해야 합니다. 따라서 출처 논문으로의 참조를 권장합니다).

GPT-5 Nano 및 GPT-5 Mini와 같은 클로즈드 상업용 모델에서 테스트했을 때, Iter-VF는 중간 출력에 의존하지 않고 성능을 개선했습니다. 다음 표에서 MATH500 및 GPQA에서 이익을 확인할 수 있습니다. 이는 verify-then-generate 접근법이 입력 및 최종 답변만 접근할 수 있는 경우에도 유효함을 확인합니다:

GPT-5 모델에서 Iter-VF를 적용했을 때 MATH500 및 GPQA의 정확도.

결론

새로운 논문이 결과 섹션에서 불투명해지지만, 명백하게 AI 모델 클래스의 기본 특성을 발견한 것은 흥미로운 발전입니다. LLM을 정기적으로 사용하는 사람은 모델의 약점을 작업하기 위한 트릭을 직관적으로 개발했을 것입니다. 이러한 패턴은 시간이 지남에 따라 명백해지며, 모두 이러한 일반화되고 적용 가능한 ‘트릭’을 찾기를 희망합니다.

LLM에서 컨텍스트 윈도우를 구현하고 업데이트하는 가장 큰 문제 중 하나는 세션 진행을 유지하는 것과 새로운 방향으로 나아가는 능력 사이의 균형을 맞추는 것입니다. 이는 유도적인 환상이나 오프토픽 출력에 빠지지 않도록 하는 것을 의미합니다. 새로운 논문에서 제시된 경우, 우리는 LLM을 재초점화하고 재설정하는 겸손하지만坚持적인 ‘wake-up call’의 예를 볼 수 있습니다. 이 방법이 이후 프로젝트에서 어떻게 적응되고 발전할지 interessant하게 지켜볼 것입니다.

연구자들은 새로운 방법의純粋한 경제성을 강조합니다. 이는 12개월 전과 달리, 지금은 매우 중요한 고려 사항입니다. 초대형 AI의 영향으로, 이전에 순수 연구 시대에는 사소한 것으로 간주되었던 자원 절약이 이제는 필수적이고 본질적인 요소가 되었습니다.

* 참고: 출처 논문에서 발견된 일부 영어의 수준이 독자를 혼동시킬 수 있으므로, 일반적으로 출처에서 인용문을 포함하는 것을 피했습니다. 따라서 핵심 통찰력을 요약하는 것을 선택했습니다. 자세한 내용은 출처 논문으로의 참조를 권장합니다.

최초로 2025년 12월 4일에 게시되었습니다.