Anderson의 관점

HDR로 생성된 이미지의 광역을 밝히다

AI 이미지와 비디오는 인상적일 수 있지만, 전문가 수준은 아니다. 이러한 문제를 해결하기 위한 새로운 연구 프로젝트가 등장했다.

오디오 비주얼 전문가 커뮤니티에서 가장 빈번하게 등장하는 AI의 침투에 대한 반대는 현재 전문가 수준의 이미지 및 비디오 재생 능력의 부족이다. 이 중 하나는 High Dynamic Range(HDR) 이미지 및 비디오와 함께 작업할 수 있는 능력이다.

HDR 이미지는 19세기/20세기 사진 기술인 브래кет팅의 현대적 대응물이다. 여기서 같은 사진을 여러 번 찍되, 필름 에뮬션에 도달하는 빛의 양을 점점 증가시킨다:

위에, 짧은 브래кет팅 시퀀스. 아래에, 이러한 사진에서 단일 이미지로 외삽할 수 있는 고역역. 소스

전통적인 사진에서 이것은 여러 사진을 생성했으며, 일부 전문 지식과 노력으로 단일 인쇄물로 구성할 수 있었으며, 다양한 노출 범위에 걸쳐 사용 가능한 모든 세부 사항의 이점을 얻을 수 있었다. 그러나 이것은 간단하거나 쉬운 과정은 아니었다.

이adays ‘자동 브래кет팅’ 이미지 시퀀스는 여러 이미지를 생성하거나 단일 HDR 이미지로 결합될 수 있다. 즉, 하나의 이미지에 여러 노출을 효과적으로 결합하여 HDR 이미지 편집 애플리케이션인 Photoshop와 같은 것을 통해 사진가가 이상적인 출력 이미지를 구성할 수 있다.

왜 관심을 가져야 하는지, 또는 이러한 종류의 것이 자신의 사진에 어떤 영향을 미치는지 궁금하다면, 이 기사의 일러스트는 친숙한 방식으로 이를 보여주려고 한다:

위에, 왼쪽에는 일반적인 sRGB(즉, 非HDR) 이미지를 볼 수 있다. 단순히 밝게 하면(오른쪽에 표시됨) 옷장里的 괴물을 보여주지 않는다. 왜냐하면 이러한 세부 사항은 사진을 찍은 사진가와 카메라의 자동 처리 과정에서 사진의 우선순위를 결정할 때 버려졌기 때문이다:

아래는 非HDR 사진에서 전경을 등록하기 위해 전경이 얼마나 ‘밝게’ 있어야 하는지의 표시(왼쪽)와, 전경의 노출이 적절하게 설정될 때 괴물이 어둠에 빠지는 것을 보여준다(오른쪽):

아래에서 볼 수 있듯이, HDR 이미지 또는 이미지 시퀀스에서 ‘구조’할 수 있는 세부 사항의 종류이다. 이 경우, 괴물은 HDR 시퀀스의 매우 낮은 시각적 레지스터에 ‘숨겨’져 있었다. 여기서 다른 콘텐츠는 거의 흰색으로 날아갈 것이었다(위, 왼쪽). 광도 수준의 넓은 범위를 선택적으로 동일한 이미지에 표현하도록 지정함으로써, 이러한 불협화음 요소들을 하나의 합리적인 그림으로 구성할 수 있다:

非HDR 이미지는 디스플레이 참조 이미지로 알려져 있으며, 고감도 HDR 이미지는 장면 참조 이미지로 알려져 있다.

HDR 비디오도 존재하며, 이러한 종류의 톤적 유연성과 연성은 영화 制作자에게 푸트리지와 그레이드를 구분하고 일관된 방식으로 푸트리지와 해석하는 많은 창의적인 방식을 제공한다. 따라서 창의적인 사람들이 대부분의 생성적 AI 프레임워크에서 일반적인 ‘평면’ sRGB 출력과 함께 작업하기를 꺼리는 것은 놀라운 일이 아니다.

HDR in AI

자연스럽게, 연구 현장은 AI 생성 프레임워크를 HDR 시대로 가져오고 있다. 그러나, 이는 어려운 작업이다. 왜냐하면 확산 기반 생성 시스템의 기본 아키텍처와, 良好的 HDR 데이터가 많은 디스크 공간을 차지하여, 처리하기 어렵기 때문이다. 따라서, 이러한 작업에 적합한 데이터셋은 희박하다.

尽管如此, 싱가포르의 한 대학과 Adobe Research의 협력은 이미지 시퀀스의 HDR 생성 방법을 제공하며, 이는 이론적으로 비디오에도 적용될 수 있다:

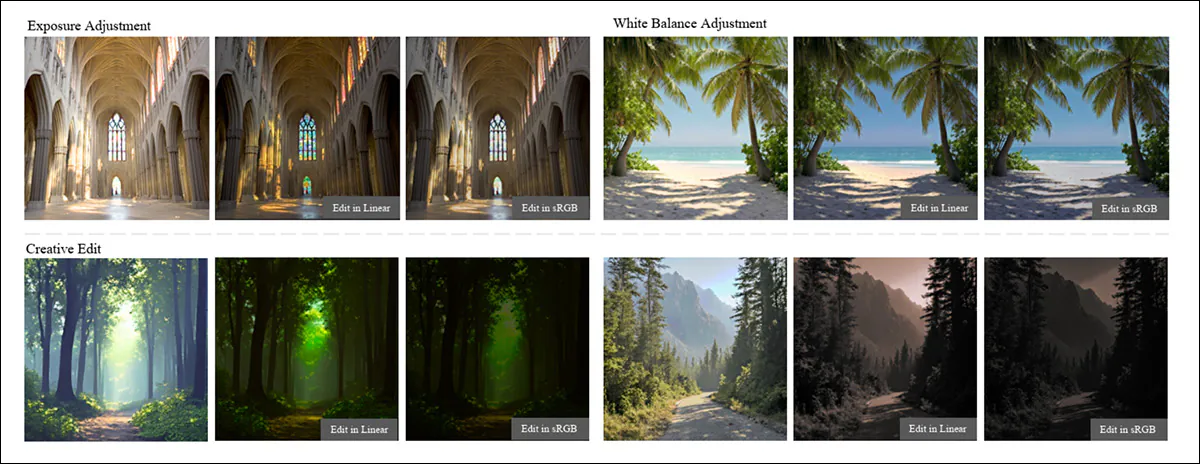

새로운 작업의 프로젝트 사이트에서, 텍스트-이미지 출력의 ‘브래켓팅’ 예시. 소스

새로운 시스템은 동일한 이미지의 여러 버전을 다른 밝기 수준에서 생성하며, 실제 장면이 얼마나 밝았는지 학습한다. 그리고 이러한 이미지를 하나의 결과로 결합하여 그림자와 하이라이트 모두에서 세부 사항을 유지하도록 한다. 이는 후속 편집에서 노출이나 색상 조정을 실제 카메라 캡처에 대한 조정으로 작동하도록 허용한다.

시스템은 Qwen과 Flux의 변형을 포함하여 다양한 모델을 작업에 활용한다:

새로운 논문에서, 동일한 장면의 여러 노출 버전을 생성하는 시스템을 보여주는 예시. 간단한 에지 맵에서 시작하여, 모델은 매우 어두운 곳에서 매우 밝은 곳까지 일관된 이미지를 생성한다. 주제와 구성은 안정적으로 유지되며, 노출이 변경될 때만 освещ이 변경된다. 이 방법은 카메라와 같은 방식으로 밝기를 제어할 수 있다. 소스

저자들은 다음과 같이 말한다:

‘선형 이미지를 생성하는 것은 어려운 작업이다. 왜냐하면 미리 학습된 VAE는 잠재적 확산 모델에서 극단적인 하이라이트와 그림자를同時하게 보존하기 위해 어려움을 겪기 때문이다.’

‘이러한 이유로, 우리는 선형 이미지를 노출 브래кет의 시퀀스로 표현하며, 텍스트 조건 노출 브래켓 생성을 위한 DiT 기반 흐름 매칭 아키텍처를 제안한다.’

‘우리는 또한 텍스트 안내 선형 이미지 편집 및 구조 조건 생성과 같은 하류 응용 프로그램을 보여준다.’

새로운 작업은 Linear Image Generation by Synthesizing Exposure Brackets으로 제목이 붙여졌으며, Nanyang Technological University의 S-Lab, Adobe NextCam, Adobe Research의 4명의 저자에 의해 수행되었다. 언급된 프로젝트 페이지와 함께 제공되는 YouTube 비디오 외에도, 현재는 빈약한 GitHub 리포지토리와 데이터셋 릴리즈의 약속이 있다.

저자들은 시스템의 출력 예시를 많은 수의 제공하지만, 뷰어는 실제로 HDR 출력의 특성을 구별하기 위해 HDR 기능이 있는 모니터가 필요할 것이다. 그렇지 않으면, 이 기사의 끝에 임베드된 연구자의 YouTube 개요를 참조하십시오. 그러나 非HDR 모니터에서는 보여진 예시의 차이를 명확히 구별할 수 없을 것입니다.

Method and Data

저자들은 데이터 수집이 이러한 추구에서 얼마나 어려운지 강조한다:

‘대량의 선형 이미지를 수집하는 것은 실제로 매우 어렵다. 또한, 대부분의 공개 HDR 데이터셋은 전景(대규모 장면 콘텐츠에 거의 집중) 또는 실제 선형 이미지를 제공하지 않기 때문에 우리의 목적에 적합하지 않다.’

‘따라서, 우리는 주로 RAW 이미지 데이터셋을 훈련의 기초로 사용한다.’

연구자들은 사용 가능한 몇 가지 옵션을 창의적으로 사용하여, 실제 훈련 데이터로 RAISE 데이터셋을 사용하고, MIT-Adobe FiveK 데이터셋을 평가 데이터로 사용했다*.

사용 가능한 HDR 훈련 데이터를 구축하기 위해, 연구자들은 RAW 카메라 파일을 표준화된 파이프라인을 통해 카메라 특유의 특성을 제거하고, 이미지를 일관된, 장면 참조 선형 형식으로 변환했다:

저자의 워크플로우 스키마: 시스템은 동일한 장면의 네 가지 노출 수준을 나타내는 노이즈와 함께 텍스트 프롬프트와 밝기 토큰을 처리하며, 스택된 트랜스포머 블록을 통해 노출을 조정하면서 다른 노출을 일치시킨다. 그런 다음 시스템은 노출 이미지 세트와 전체 밝기 스케일을 예측하며, 이후에 이를 하나의 장면 참조 이미지로 결합하여 그림자와 하이라이트 모두에서 세부 사항을 유지한다.

이것은 전처리에서 전처리까지 RGB를 재구성하고, 색상 보정을 적용하고, 화이트 밸런스를 정규화하며,brieflybriefly 감지 노이즈 제거를 위해 지각 색상 공간으로 이동한 후 깨끗한 선형 신호로 돌아가는 것을 포함했다. 실제 장면의 빛은 카메라의 노출 설정을 사용하여 회복되었으므로, 각 픽셀이 실제 밝기를 반영하도록 하였다.

이러한 값은 광범위하게 변할 수 있으므로, 데이터는 각 이미지의 밝기 분포에 따라 스케일링하여 안정화되었으며, 중간 및 하이라이트 통계를 사용하여 과도한 이미지를 피하고, 최终적으로 실제 장면의 밝기 범위를 보존하면서 충분히 안정적인 선형 이미지를 얻었다.

이미지에 대한 텍스트 레이블은 Qwen2.5-VL 7B 모델을 사용하여 생성되었으며, 프롬프트는 생성 시에 사용될 Flux 모델의 특성과 일치하도록 제작되었다.

각 이미지는 노출 ‘슬라이스’로 분할되어 공유된 VAE 인코더를 통해 처리되어 모든 노출을 공통의 잠재 공간으로 변환하여 전체 밝기 범위를 캡처하도록 설계되었다. 잠재 공간은 노이즈에서 정제되었으며, 이미지로 다시 디코딩되어, 어두운 영역과 밝은 영역 모두에서 일관된 재구성을 허용했다.

LoRA fine-tuning은 미리 학습된 Flux 백본을 선형 이미지 데이터에 최소한의 추가 매개변수로 적응시키는 데 사용되어, Single-Diffusion Transformers(Single-DiT) 모델이 밝기가 변하는 동안에도 안정적으로 유지되도록 도왔다.

노출 조절 셀프 어텐션(위의 스키마 그림에서 중앙 열)은 모든 브래킷을 공동으로 처리하도록 도입되어, 노출을 조정하면서 구조와 세부 사항을 일치시킬 수 있도록 허용했다.

3D Rotary Positional Embedding(3D-R[o]PE)는 공간 위치와 노출 身分을 모두 인코딩하는 데 사용되어, 모델이 어느 브래킷에 속하는지 구별하면서 공간 일관성을 유지할 수 있도록 허용했다.

연구에서 사용된 데이터셋의 개요, 이미지의 콘텐츠 유형과 실내 및 실외 장면에 대한 분포, 처리된 데이터의 밝기 값의 분포를 보여준다. 히스토그램은 광도와 방사도 스케일을 로그 공간에서 플로팅하여 실제 세계의 밝기가 얼마나 다양할 수 있는지, 더 높은 방사도 값이 물리적으로 더 밝은 장면을 나타내며 모델이 처리하는 강한 동적 범위를 강조한다.

3D-RoPE는 どこ에 특징이 있는지와 ‘어느 노출에서 왔는지’를 별도의 신호로 분리하여, 밝기 변화를 독립적으로 조정할 수 있도록 허용했다.

Tests

연구자들은 Flux-dev를 생성 프레임워크로 사용했으며, 훈련은 4개의 NVIDIA A100 GPU에서 발생했으며, 각 GPU에는 80GB의 VRAM이 있었다. 배치 크기는 4(각 GPU당)로 설정되었으며, 10,000번의 반복으로 진행되었다.

LoRA fine-tuning은 랭크 64를 사용했다. AdamW 옵티마이저는 노출 조절 부분에서 2×102의 학습률로 사용되었다.

저자들은 두 가지 이전 연구가 범위가 비슷하지만, 테스트 단계에서 명백한 후보는 아니었다고 언급했다. Max Planck가 주도한 2022년 GlowGAN은 특정 이미지 카테고리만 생성할 수 있으며, 2025年的 Bracket Diffusion(또한 Max Planck Institute에서 주도)는 256x256px의 HDR 이미지만 생성할 수 있으며, 이를 수행하는 데 수 분이 걸린다.

원본 GlowGAN 논문에서, 일반적인 저동적 범위(LDR) 이미지는 그림자와 하이라이트에서 세부 사항을 잃어버리지만, 모델은 이러한 세부 사항을 유지하는 고동적 범위(HDR) 버전을 생성한다. 소스

따라서, 선형 이미지 생성을 위한 직접적인 기준이 없는 경우, 저자들은 기존 모델의 적응 버전과 비교했다.

한 실험 세트(‘T2I Fine-Tuning’)는 텍스트-이미지 확산 모델 Flux를 LoRA로 미세 조정하여 선형 이미지를 직접 생성하도록 훈련시키고, 상태-of-the-art T2I 모델이 이 도메인에 어떻게 적응하는지 평가했다.

두 번째 비교(‘T2V fine-tuning’)는 텍스트-비디오 모델 Wan 2.1을 사용했으며, 여기서 VAE는 여러 프레임을 공유 잠재 표현으로 압축했다. 이 설정에서는 4개의 노출 브래킷이 단일 잠재 표현으로 인코딩되었으며, 비디오 스타일 파이프라인이 노출 변화를 모델링할 수 있는지 테스트했다.

세 번째 실험 세트(‘T2I Model Inflation’)는 CameraCtrl와 Generative Photography와 비교했으며, 두 모델은 이미지 확산 모델을 시간 모듈을 통해 확장하여 다중 프레임 출력을 생성한다. 이 모델들도 동일한 데이터로 미세 조정되어 일관된 비교를 수행했다.

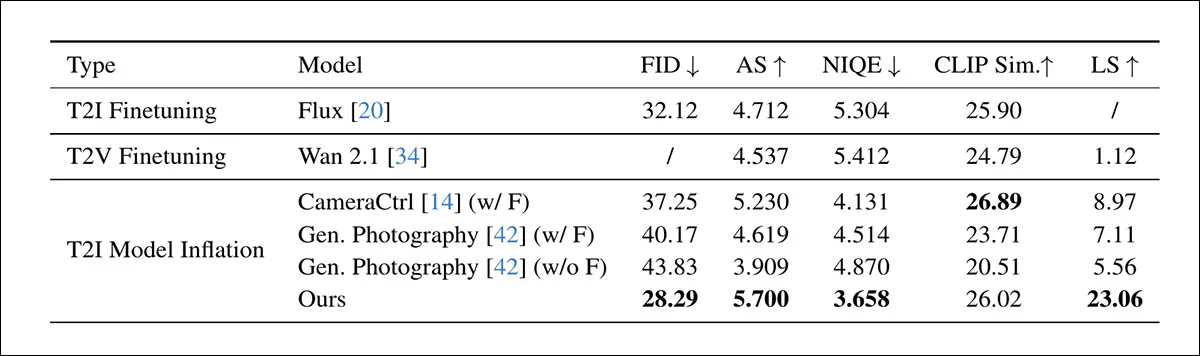

사용된 지표는 Fréchet Inception Distance(FID); 심미적 점수(AS); Naturalness Image Quality Evaluator(NIQUE); CLIP Sim 점수; 및 광도 유사성(LS)이었다:

저자들의 방법과 선형, 장면 참조 이미지 생성을 위한 여러 적응 기준선의 비교. 텍스트-이미지(Flux) 및 텍스트-비디오(Wan 2.1) 모델은 LoRA로 미세 조정되어 기존 생성 시스템이 이 설정을 처리하는 방법을 테스트한다. CameraCtrl 및 Generative Photography는 확산 모델을 시간 구성 요소로 확장한다. 일부 점수는 누락되어 있지만, 이는 일부 모델이 일관된 노출 브래킷을 신뢰성 있게 생성할 수 없기 때문이며, 이는 전체 동적 범위를 회복하는 데 필요하다. 보고된 지표에 걸쳐, 새로운 방법은 이미지 품질 및 정확한 밝기 재구성과 관련된 지표에서 특히 강한 전반적인 결과를 달성한다.

이러한 결과에 대해, 저자들은 다음과 같이 말한다:

‘선형 데이터에서 직접 T2I 모델을 미세 조정하면 그림자와 하이라이트 세부 사항을 균형 있게 하는 것이 어렵다. T2I 모델 인플레이션 방법은 동적 범위가 제한적이며, 미세 조정 후에도 이미지 품질이 크게 저하된다. ‘

‘T2V 미세 조정의 경우, Wan 2.1의 4× 시간적 다운샘플링은 4개의 노출 브래킷을 단일 잠재 표현으로 얽어매므로, 미세 조정만으로 해결할 수 없는 심각한 분포 불일치가 발생한다. ‘

‘노출 브래킷을 사용하여 장면 참조 속성을 직접 모델링함으로써, 우리의 방법은 모든 기준선에서 우수한 시각적 품질과 동적 범위를 달성한다.’

LoRA로 미세 조정된 Flux 및 Wan 2.1과 비교하여, 각 방법이 동일한 장면에서 노출 변경을 처리하는 방법을 보여주는 비교. 경쟁 접근 방식은 매우 어두운 또는 매우 밝은 영역에서 세부 사항을 잃어버리지만, 제안된 방법은 일관된 구조를 유지하고 전체 노출 범위에서 사용 가능한 세부 사항을 회복한다. 더 나은 품질의 결과 예시는 원본 논문 및 프로젝트 사이트를 참조하십시오.

원본 논문의 확장 실험 및 보충 자료 섹션을 참조하여 추가 테스트를 수행하십시오.

Conclusion

미디어 전문가의 경우, 영화 및 TV 제작과 같은 분야에서, 세계를 사로잡았으며(그리고, 점점 더 분노를 불러일으키고 있음에도 불구하고), 거의 모든 파이프라인이某种程度로 HDR 캡처에 의존하기 때문에, 동일한 출력이 그들을 감동시키지 못한다.

따라서, 이 프로젝트는 시의적절한 것으로, 새로운 프레임워크에서 선택적 표준이 되는 시설을 나타낸다. 그러나, 이는 렌더링 시간을 적어도 두 배로 늘릴 것이며, 명백히, 지연 시간을 해결하지 않으면 HDR AI 콘텐츠가 ‘포스트 프로덕션’이 아닌 ‘인-카메라’ 범주로 분류될 수 있다.

* 일반적으로 우리는 예시를 보여주겠지만, 독자가 HDR 기능이 있는 모니터를 갖고 있지 않을 수 있으므로, 이 경우에는省略한다.

최초로 2026년 4월 26일 일요일에 게시됨