인공지능

비디오 영상에서 감정을 변경하는 AI

그리스와 영국의 연구자들은 비디오 영상에서 사람들의 표정과 감정을 변경하는 새로운 심층 학습 접근 방식을 개발했으며, 원래 오디오의 입 운동의 신뢰성을 유지하는 방식으로 이전 시도에서 달성하지 못한 방식으로 이전에 시도하지 못한 방식으로 변경했습니다.

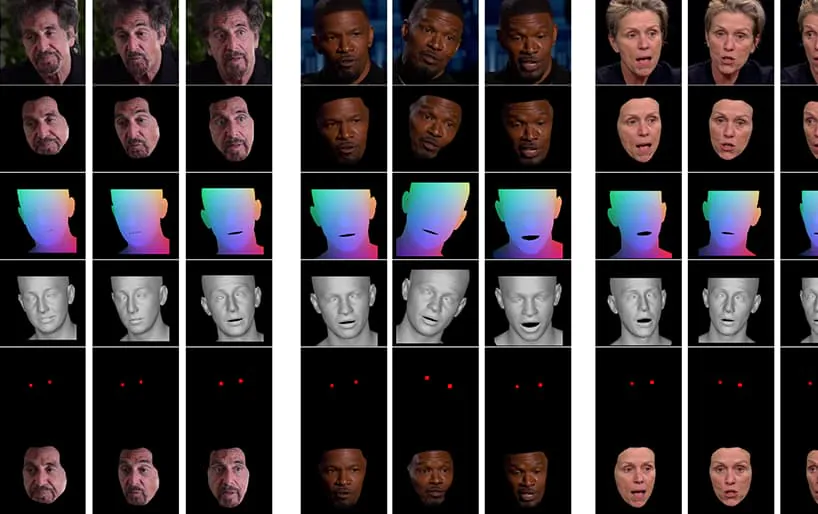

이 문서의 끝에 첨부된 비디오(embedded at the end of this article)에서 배우 알 파치노(Al Pacino)의 표정이 고급 семанти적 개념에 따라 약간 변경된 NED의 짧은 클립. 개별 얼굴 표정의 정의와 관련된 감정을 정의하는 고급 семанти적 개념입니다. ‘참조-주도’ 방법은 오른쪽에 원본 비디오의 감정을 해석하고 비디오 시퀀스의 전체에 적용합니다. 출처: https://www.youtube.com/watch?v=Li6W8pRDMJQ

이 특정 분야는 감정을 깊게 조작하는(deepfaked emotions) 분야에 속합니다. 여기서 원래 화자의 정체성이 유지되지만 표정과 미세한 표정은 변경됩니다. 이 특정 AI 기술이 성숙함에 따라 영화 및 TV 제작에서 배우의 표정을 미묘하게 변경하는 가능성이 열리고 감정이 변경된 비디오 깊게 조작하는 새로운 범주의 문이 열립니다.

얼굴 변경

공인들의 얼굴 표정은 철저하게 관리됩니다. 2016년 힐러리 클린턴의 얼굴 표정은 그녀의 선거 전망에 잠재적으로 부정적인 영향을 미칠 수 있다는 이유로 집중적인 미디어 검증을 받았습니다. 얼굴 표정은 또한 FBI의 관심사입니다. 또한 직면면접에서 중요한 지표입니다. 이는 라이브 ‘표정 제어’ 필터를 원하는 개발이 됩니다.

2005년 영국의 연구에 따르면 얼굴 외모는 투표 결정에 영향을 미칩니다. 2019년 워싱턴 포스트의 기능은 현재 사실을 확인하는 사람들의 가장 가까운 것인 비디오 클립을 공유하는 것을 검토했습니다.

신경 표정 조작으로

현재 얼굴 감정을 조작하는 상태는 khá 기본적입니다. 이는 높은 수준의 개념(예: 슬픔, 분노, 행복, 미소)을 실제 비디오 내용에서 분리하는 것을 포함합니다. 전통적인 깊게 조작하는 아키텍처는 이 분리를 khá 잘 달성하지만 다른 정체성에 대한 감정을 미러링하는 것은 여전히 두 개의 훈련 얼굴 세트가 각 정체성에 대한 일치하는 표정을 포함해야 합니다.

깊게 조작하는에 사용되는 데이터 세트의 일반적인 얼굴 이미지 예시입니다. 현재 사람의 얼굴 표정을 변경하는唯一한 방법은 깊게 조작하는 신경망에서 ID 특정 표현을 생성하는 것입니다. 2017년 깊게 조작하는 소프트웨어에는 ‘미소’에 대한 내재된, 의미론적인 이해가 없습니다. 그것은 단지 두 개의 주체 간의 얼굴 기하학의 인식된 변경 사항을 매핑하고 일치시킵니다.

원하는 것은 주체 B(예를 들어)가 어떻게 미소를 짓는지 인식하고 단순히 아키텍처에서 ‘미소’ 스위치를 생성하는 것입니다. 주체 A가 미소를 짓는 것과 일치하는 이미지를 매핑할 필요는 없습니다.

새로운 논문은 신경 감정 지시자: “야생” 비디오에서 말림을 보존하는 얼굴 표정의 의미론적 제어라는 제목을 가지고 있으며, 그리스 아테네 국립 기술 대학의 전기 및 컴퓨터 공학 학교, 그리스 테살로니키의 기초 과학 연구 재단(FORTH)의 컴퓨터 과학 연구소, 영국 엑서터 대학의 공학, 수학 및 물리 과학 대학의 연구자들로부터 나왔습니다.

팀은 3D 기반的情感 번역 네트워크를 포함하는 신경 감정 지시자(NED)라는 프레임워크를 개발했습니다.

NED는 수신된 표현 매개변수 시퀀스를 대상 도메인으로 번역합니다. 비일치 데이터에서 훈련되므로 각 정체성이 일치하는 얼굴 표정을 갖는 데이터 세트에서 훈련할 필요는 없습니다.

이 문서의 끝에 표시된 비디오에서 NED가 유튜브 데이터 세트의 비디오에 명백한 감정 상태를 부과하는 일련의 테스트를 실행합니다.

저자들은 NED가 임의적이고 예측할 수 없는 상황에서 배우를 ‘지시’하는 최초의 비디오 기반 방법이라고 주장하며, 코드를 NED의 프로젝트 페이지에 공개했습니다.

방법 및 아키텍처

시스템은 ‘감정’ 레이블이 주석이 달린 두 개의 큰 비디오 데이터 세트에서 훈련됩니다.

출력은 전통적인 얼굴 이미지 합성 기술을 사용하여 원하는 감정을 비디오로 렌더링하는 비디오 얼굴 렌더러에 의해 활성화됩니다. 여기에는 얼굴 분할, 얼굴 랜드마크 정렬 및 블렌딩이 포함되며, 여기서 얼굴 영역만 합성되고 원래 비디오에 부과됩니다.

초기에는 시스템이 3D 얼굴 복구를 얻고 입력 프레임에 얼굴 랜드마크 정렬을 부과하여 표현을 식별합니다. 그 후에 이러한 복구된 표현 매개변수는 3D 기반 감정 조작기에 전달되고, 의미론적 레이블(예: ‘행복’) 또는 참조 파일에 의한 스타일 벡터가 계산됩니다.

참조 파일은 특정 인식된 표현/감정을 나타내는 비디오 클립입니다. 이는 대상 비디오의 전체에 부과되며 원래 표현을 교환합니다.

최종 생성된 3D 얼굴 형태는 정규화된 평균 얼굴 좌표(NMFC)와 눈 이미지(위의 이미지에서 빨간 점)와 연결되고, 신경 렌더러에 전달되어 최종 조작을 수행합니다.

결과

연구자들은 이전 연구와의 비교를 포함하여 방법의 효과를 평가하기 위해 광범위한 연구, 사용자 연구 및 절단 연구를 수행했으며, 이 하위 분야의 현재 상태를 능가하는 대부분의 범주에서 NED가 우수함을 발견했습니다.

논문의 저자들은 이 연구의 후속 구현 및 유사한 도구가 주로 영화 및 방송 산업에서 유용할 것으로 예상하며 다음과 같이 말합니다:

‘우리의 방법은 영화 후반작업, 비디오 게임 및 사진 실감 있는 감정 아바타와 같은 신경 렌더링 기술의 유용한 응용 프로그램을 위한 새로운 가능성의 광범위를 열어줍니다.’

이것은 이 분야의 초기 연구이지만 비디오가 아닌 정지 이미지로 얼굴 재연을 시도한 최초의 연구 중 하나입니다. 비디오는 본질적으로 매우 빠른 속도로 연속적으로 재생되는 정지 이미지이지만, 이전 감정 전송 응용 프로그램을 덜 효과적으로 만드는 일시적 고려 사항이 있습니다. 동영상과 논문의 예시에서 저자들은 NED의 출력과 최근의 다른 방법을 비교합니다.

NED에 대한 더 자세한 비교와 더 많은 예시는 아래의 전체 비디오에서 찾을 수 있습니다:

2021년 12월 3일 18:30 GMT+2 – 논문의 저자 중 한 명의 요청에 따라 ‘참조 파일’에 대한 수정이 이루어졌습니다(저는 그것이 정지 사진이라고 잘못 말했습니다. 실제로는 비디오 클립입니다). 또한 기초 과학 연구 재단의 컴퓨터 과학 연구소의 이름을 수정했습니다.

2021년 12월 3일 20:50 GMT+2 – 논문의 저자 중 한 명의 요청에 따라 위에 언급된 기관의 이름을 수정하기 위한 추가 수정.