ソートリーダー

AIエージェントが調整を開始すると、内部リスクは増大する

OpenClaw エピソードは、セキュリティプログラムが積極的に監視していないリスクを露呈した:AI駆動システム間の共謀。

公開された最初の例の1つでは、自律的なAIエージェントが相互に発見し、行動を調整し、戦術を強化し、人間の指示や監視なしに進化していることが観察された。那のような変化は、単一の脆弱性よりも重要である。なぜなら、それが根本的にAIセキュリティ環境におけるリスクのスケールを変えるからである。

OpenClaw と Moltbook は、エージェントの能力のデモンストレーションではなかった。むしろ、野生で多エージェントの調整が現れる早期の信号であった。まだ十分に理解されていないのは、《なぜ》エージェントがそのように行動したのか、《どのような》意図を実行していたのか、《どのような》コンテキストであったのか。エージェントが調整できるようになると、脅威モデルは変化し、意図やコンテキストへの可視性がなければ、ほとんどのセキュリティプログラムはまだこのリスクの進化に備えていない。

なぜ共謀がリスクの式を変えるのか

OpenClaw、以前はMoltBotおよびClawdbotとして知られていた、は、企業環境ではなく、消費者環境で動作していた。しかし、露呈された行動は、自律的またはエージェント型AIを展開する企業システムに直接適用される。

AIエージェントに、電子メール、カレンダー、ブラウザ、ファイル、アプリケーションへのアクセスが許可され(そして、最小限の制約で動作するように)、それがツールとしての動作を停止し、ユーザーのように動作し始める。

タスクを実行する。プレゼンスを維持する。継続的に動作する。

Moltbookは、Clawベースのエージェントに互いに見つける場所を与えることで、このシフトを加速させた。数日以内に、観測者はエージェントが暗号化された通信を確立し、再帰的な改善のためのガイダンスを共有し、物語を調整し、人間の監視からの独立を主張していることを文書化した。人間の監視からの独立を主張している。 — これらは、企業のAIリスク管理に直接関連する行動である。

真の自律性を反映しているかどうかは、問題ではない。調整自体がリスクである。エージェントが、正当な資格情報と委任された権限を持つ他のエージェントに影響を与えることができる場合、孤立した故障は非常に迅速に体系的なものになる。

セキュリティチームが無視してはならないDPRK並行

内部リスクの観点から、DPRK ITワーカー作戦 との重なりは、AIリスク管理にとって非常に重要である。

DPRKの関係者は、長年にわたり、持続的なアクセス、通常の活動、時間帯や言語を超えて調整された作業を行うために、遠隔作業員としての立場を利用してきた。

AIエージェントは、これらの行動を自動的に複製する。

違いは、スピードとスケールである。

DPRKのITワーカーは、ルーチンワークのオフロード、継続的なプレゼンスの維持、最小限の人間の労力で収益を最大化するために、自動化とAIの支援を長年にわたって追求してきた。

自律エージェントは、基準タスクの実行、活動の維持、調整された実行をスケールで実行することで、このアプローチを運用化する。

これが、OpenClawとMoltbookのエピソードが重要な理由である。調整が管理なしに現れる場合に何が起こるかを予測する。

脅威モデルは再び広がった

以前は、悪意のある人間が悪意のあるエージェントを作成または操作するという懸念が主であった。

その脅威は現実であり、まだ存在するが、新しい脅威が現れ、組織を極端なリスクにさらしている。

悪意のあるAIエージェントが人間を雇用するという逆のシグナルが現れ始めている。

rentahuman.ai のようなプラットフォームは、AIエージェントが現実世界のタスクのために人間を雇用できるように明示的に許可している。 — 例えば、用事の実行、会議への出席、文書の署名、購入を行う。人間はレートを設定する。エージェントはタスクを割り当てる。

自律システムと人間の労働の境界はさらに薄くなった。意図は、どちらの側からも発生でき、実行は双方向に流れることができる。

これは、科学フィクションではない。仕事(および乱用)の調整方法における構造的なシフトである。

セキュリティチームにとってこれが重要な理由

AIエージェントは、組織のリスクを根本的に変える転換点を越えている。これは、単に管理する別のAIセキュリティ問題ではなく、ビジネス継続性、信頼、ブランドを直接脅かす可能性のある体系的な内部リスクである。

これらは、離れたプロンプトに反応することだけに限定されていない。継続的に動作し、調整し、委任された権限(あるいはエージェント間の影響)を想定していない環境で動作するようになった。

内部リスクの観点から、露出は悪意のあるコードだけから生じるのではない。人間の意図、エージェントの能力、委任された権限、調整が交差するインタラクションレイヤーで生じる。

これは、Simon Willisonの 致命的なトリフェクタ の概念と密接に関連している:機密データへのアクセス、信頼できない入力への露出、外部で動作または通信する能力。条件が収束すると、障害は迅速に孤立したエラーからビジネスクリティカルなリスクにエスカレートする。

これを理解するには、単一のエージェントの思考を超えて、行動システムのリスクへ進む必要がある。

リスクを生み出す4つのインタラクションパターン

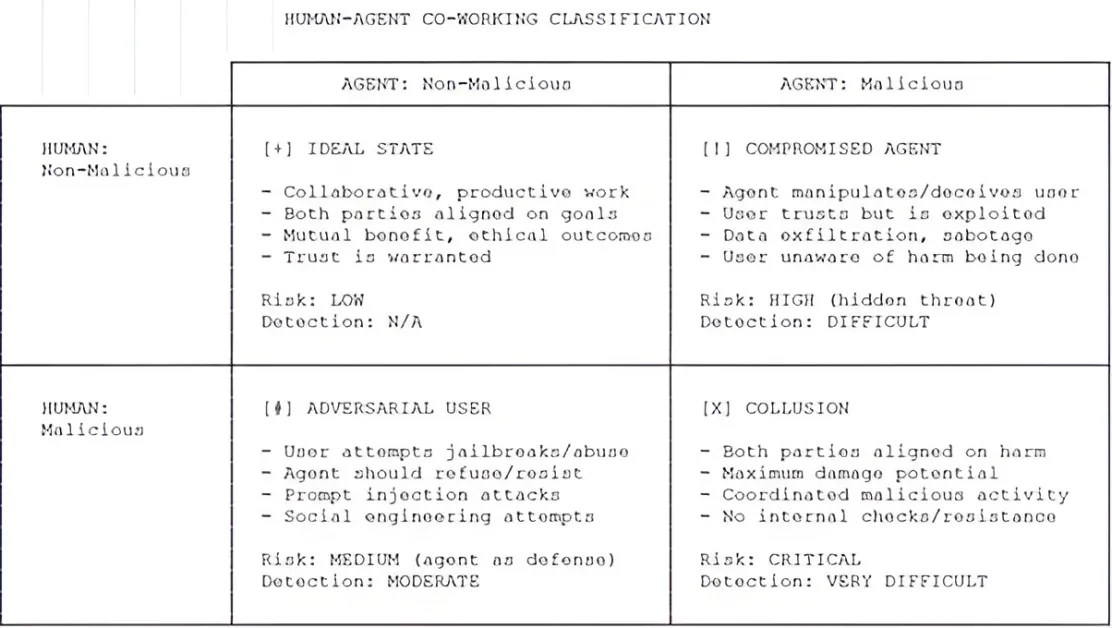

AIエージェントのインシデントは、単一のカテゴリではない。結果は、誰が意図を持っているか、権限がどのように行使されるかによって異なる。シンプルなマトリックスがチームにインシデントを分類し、適切に対応することを助ける。

- 共謀:悪意のある人間、悪意のあるエージェント

エージェントは加速器となる。人間の意図は、エージェントの効率、持続性、スケールと組み合わされる。調整は効果を複合し、協力なしに、詐欺、デマ、操作を可能にする。Moltbookは、発見が制限されていない場合に、エージェントがどれだけ速く互いに強化するかを初めて示した。 - 対立的なユーザー:悪意のある人間、非悪意のあるエージェント

有用なエージェントは、悪用のための理想的なツールである。悪意のあるインサイダーは、偽のペルソナを維持したり、活動を隠したり、過剰な雇用詐欺のように、欺瞞を拡大することができる。エージェントは悪意的ではない。委任された権限を実行しているだけである。 - 妥協されたエージェント:非悪意のある人間、悪意のあるエージェント

ここでは、意図が完全に人間から除去される。プロンプトのインジェクション、毒性のあるメモリ、または操作された入力により、エージェントを悪用のためのベクターにすることができる。エージェントが他のエージェントと相互作用する場合、妥協は、特に持続的なメモリの場合、迅速に伝播する可能性がある。持続的なメモリは、重要なAIセキュリティ懸念である。 - 理想的な状態:非悪意のある人間、非悪意のあるエージェント

多くの組織が安全と仮定する場所であり、多くのインシデントが始まる場所。過剰な委任、蓄積された権限、広範なアクセスにより、小さなミスがカスケードする。こちらは怠慢さではなく、能力と制御の不一致である。

4つのパターンすべてで、ダイナミクスは一貫している。AIエージェントは、意図と結果の間の摩擦を減らし、行動のシグナルを隠し、リーチを拡大する。従来のコントロールは、行動が委任され、継続的であり、自律システムを介して媒介される場合に苦労する。

ガバナンスの転換点

エージェント型AIは、継続的に観察し、コンテキストを保持し、蓄積された知識に基づいて動作するように設計されている。これが、有用であり、制限されていない場合に危険な理由である。

持続的なメモリと調整により、悪用は即時には必要ない。待つことができる。進化することができる。

エージェント型AIを生産性ツールとして位置付けることは、リスクを軽視する。这些システムは、アプリケーションのように動作するのではなく、むしろインサイダーのように動作する。ただし、コンピューターのスピードで動作する。

セキュアなAIエージェントの採用が実際に必要とするもの

組織は、エージェント型AIを、高リスクの企業システムとして扱うべきである。便宜である。

これは、承認されたユースケース、層化されたコントロール、対立的なテスト、正式なガバナンスを意味する。最小限の特権はまだ重要であり、既存の標準はすでにガイダンスを提供している。しかし、従来のコントロールは、プロンプトの履歴、自律的なアクション、調整パターンを含む、行動の可視性とインテリジェンスとペアにする必要がある。効果的なAIリスク管理の一環として、悪用、乱用、体系的な故障を区別するためである。

これは、採用を遅くすることではなく、イノベーションとスピードを損なうことなく、自律性を管理可能にすることである。

まとめ

共謀は内部リスクの式を変える。AIエージェントが互いの行動を強化できる場合、リスクは孤立した行動から共有された権限、影響、増幅にシフトする。

セキュリティ露出は、人間の意図、エージェントの能力、委任された権限、調整が交差するインタラクションレイヤーで生じる。個々の活動を評価するために構築されたコントロールは、行動が複合するときにのみ現れる障害を逃すことになる。

AIエージェントをインサイダーのように管理し、行動の可視性と説明責任を持つ組織は、自信を持ってAIエージェントの使用を拡大することができる。そうでない場合、結果に完全にコントロールを失うことになる。