人工知能

小型モデル革命: なぜ小さなAIが巨大な言語モデルを上回るのか

近年、人工知能は、どんどん大きくなるモデルを構築する競争によって形作られてきました。各新しいリリースは、パラメーターの数、トレーニングデータのサイズ、背後にあるインフラストラクチャの規模で測られました。大きいことは、より良いことを意味すると考えられていました。テクノロジー大手が、数百億のパラメーターを持つ巨大な言語モデルを構築し続ける一方で、静かな革命が進行しています。小型AIモデルは、しばしば巨大な対象よりも何千倍も小さいものですが、特定のタスクで同等または優れたパフォーマンスを達成しています。このシフトは、AIスケーリングについて私たちが知っていたすべてを問い直し、新しい可能性を解放し、民主化された効率的な人工知能を開きます。

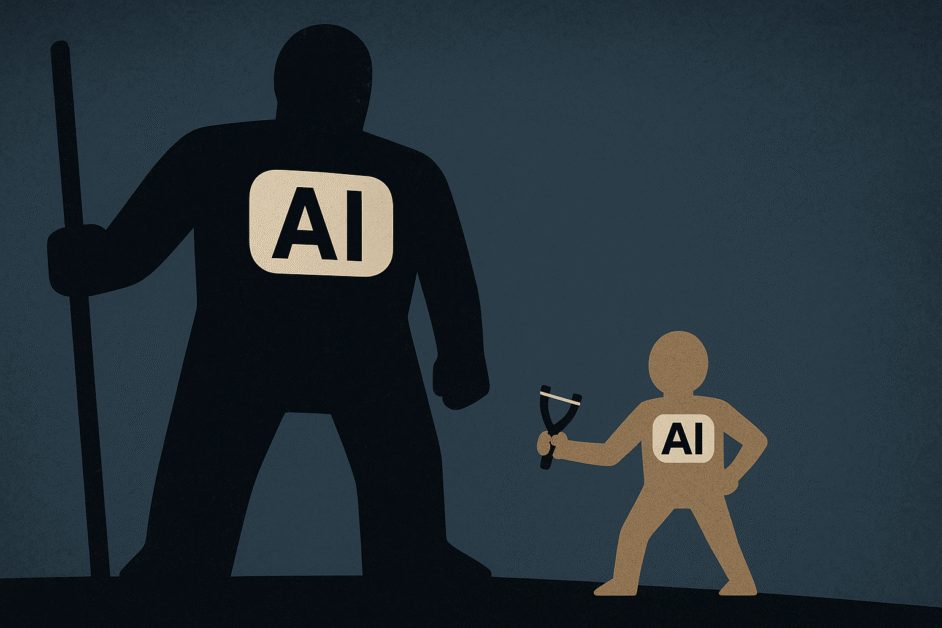

現代AIのダビデとゴリアテの物語

長年にわたり、AI業界は、大きいモデルがより良いパフォーマンスを提供するという仮定の下で運営されてきました。OpenAIのGPTシリーズは、1.17億のパラメーターから175億を超えるまで成長しました。GoogleのPaLMは540億のパラメーターに達しました。大手テクノロジー企業は、これらのモデルをトレーニングするために数十億ドルを投資し、さらに大きなモデルを構築するために投資を続けています。この状況では、パラメーターカウントがモデル容量とAI容量構築の重要な要素となり、計算リソースとインフラストラクチャ支出の競争となっている間、世界中の研究室で興味深い現象が発生し始めました。

エンジニアたちは、小さくて慎重に設計されたモデルが、特定のタスクでこれらの巨大なモデルのパフォーマンスに匹敵または上回ることができることを発見しました。MicrosoftのPhiシリーズは、27億のパラメーターを持つモデルが、10倍大きいモデルと競合できることを実証しました。MetaのLLaMAは、7億のパラメーターモデルが適切にトレーニングされた場合に優れた結果をもたらすことができることを証明しました。これらの開発は、AIの効率性について私たちの理解における基本的なシフトを表しています。

このパラダイムシフトは、AIが使用され、運営される方法に重大な影響を及ぼします。小さなモデルは、消費者向けハードウェアで実行でき、リクエストをより迅速に処理し、巨大なモデルの要するエネルギーの小さな部分しか消費しません。彼らは、巨大な計算インフラストラクチャを購入できない組織にAIを提供します。最も重要なことは、AI開発の独占的傾向に挑戦することです。ここでは、巨大なリソースを持つ企業だけが競争できます。

効率的なAIアーキテクチャの台頭

小さなモデル革命は、制約付きパラメーターバジェット内でパフォーマンスを最大化するための洗練されたエンジニアリングアプローチを構築しています。これらのモデルは、知識の蒸留などの高度なテクニックを使用します。ここでは、小さな「学生」モデルが、大きな「先生」モデルから学び、重要な知識を捉えながら、計算要件を劇的に削減します。

MicrosoftのPhi-4シリーズは、このアプローチを体現しています。Phi-4推論モデルは、14億のパラメーターしか持たないものの、数学的推論と論理的問題解決で5倍大きいモデルと競合します。同様に、GoogleのGemma 3 270Mモデルは、コンパクトな270百万パラメーターモデルが、強力な指示の実行能力を提供し、ファインチューニングのための優れた基礎となることを実証しています。

MetaのLlama 3.2 1Bモデルは、小さなモデル効率性における別のブレークスルーです。大きなLlamaモデルからの構造化されたプルーニングと知識の蒸留を通じて、エッジデバイスで効率的に動作しながら、注目に値するパフォーマンスを維持しています。これらのモデルは、多くの実際のアプリケーションでは、パラメーターカウントよりもアーキテクチャの革新とトレーニング方法が重要であることを証明しています。

専門家の混合アーキテクチャは、効率的なAI設計における重要なブレークスルーです。すべてのパラメーターをすべてのタスクに使用するのではなく、これらのモデルは、関連する専門化されたコンポーネントのみをアクティブにします。彼らは、さまざまなクエリを専門化されたサブネットワークにルーティングし、幅広い能力を維持しながら、任意の時点で使用されるアクティブパラメーターの数を削減します。Mistral AIのMixtral 8x7Bモデルは、このアプローチを効果的に実証しています。47億のパラメーターを持っているにもかかわらず、クエリごとに13億のパラメーターしかアクティブにしません。より大きな密なモデルと同等のパフォーマンスを達成しながら、より高速な推論速度を維持しています。

量子化テクニックも、小さなモデルの効率性を高める上で重要な影響を及ぼしています。モデル重みをより少ないビットで表現することで、研究者はモデルを縮小しながら精度を維持できます。現代の量子化方法は、パフォーマンスの小さな損失とともに、モデルサイズを75%削減できます。MicrosoftのPhi-3-miniは、このアプローチの有効性を実証しています。4ビットの精度に量子化されると、元のパフォーマンスの95%以上を維持しながら、メモリ要件を7GBから2GB未満に削減し、特にモバイル展開に実用的になります。

専門化が汎用性を上回る

小さなモデル革命は、AIの展開について重要な真実を明らかにしました。ほとんどの実際のアプリケーションは、詩を書いたり、微積分を解いたり、哲学について議論したりすることができるモデルが必要ではありません。特定のタスクに優れたモデルが必要です。カスタマーサービスチャットボットは、シェイクスピアの知識が必要ではありません。コード補完ツールは、医療知識が必要ではありません。この認識は、汎用モデルを構築することから、専門化されたモデルを作成することに焦点を移しました。

ドメイン固有のトレーニングにより、小さなモデルは、限られた容量を関連する知識に集中させることができます。法的な文書のみでトレーニングされた30億のパラメーターモデルは、法的なタスクで700億のパラメーターの汎用モデルを上回ることができます。専門化されたモデルは、無数の無関係なトピックに容量を分散するのではなく、ドメイン内でより深いパターンを学習します。専門医と一般医を比較するようなものです。

ファインチューニング戦略は、ますます洗練されてきました。モデルをスクラッチからトレーニングするのではなく、開発者は小さなベースモデルから始めて、特定のニーズに合わせて適応させます。このアプローチでは、最小限の計算リソースが必要でありながら、高度な専門化されたモデルを生成します。組織は、巨大なインフラストラクチャ投資なしで、カスタムAIソリューションを作成できます。

パフォーマンス上限の突破

最近のベンチマークは、特定のドメインにおける小さなモデルの驚くべきパフォーマンス上位を明らかにしています。AI2のOlmo 2 1Bモデルは、自然言語理解タスクで、同等のサイズの大手テクノロジー企業のモデルを上回ります。MicrosoftのPhi-4-mini-flash-reasoningは、伝統的な推論モデルと比較して、最大10倍のスループットと2〜3倍の低遅延を達成しながら、数学的推論能力を維持しています。

パフォーマンスギャップは、タスク固有のアプリケーションを検討する際にさらに印象的なものになります。特定のドメインにファインチューニングされた小さなモデルは、一貫して汎用の大きなモデルよりも精度と関連性で上回ります。ヘルスケアアプリケーション、法的な文書分析、カスタマーサービス実装は、小さなモデルがドメイン固有のデータセットでトレーニングされた場合に特に印象的な結果を示しています。

このパフォーマンス上位は、集中したトレーニングアプローチから生じます。無数のドメインにわたる広いが浅い知識を学ぶのではなく、小さなモデルは特定の分野で深い専門知識を発達させます。結果として、特定のユースケースに対してより信頼性が高く、文脈に適した応答が得られます。

スピードと効率の優位性

パフォーマンスは、精度だけではなく、スピード、コスト、環境への影響についても言及します。小さなモデルは、これらのすべての側面で優れています。小さなモデルは、巨大なモデルが数秒かかるタスクに、数ミリ秒で応答を生成できます。このスピードの違いは、実時間のインタラクションや数百万のリクエストを処理するアプリケーションでは、重要になります。

エネルギー消費も重要な側面です。大きなモデルは、先進的な冷却システムを備えた巨大なデータセンターを必要とします。各クエリは大量の電力を消費します。小さなモデルは、標準サーバーまたはパーソナルコンピューターで実行でき、エネルギーの小さな部分しか消費しません。組織が炭素足跡を削減する圧力に直面しているため、小さなモデルの環境上の優位性はますます重要になります。

エッジ展開は、小さなモデルの最も変革的な機能の1つです。これらのモデルは、インターネット接続なしで、電話、ラップトップ、またはIoTデバイスで直接実行できます。遠隔地でインターネット接続なしで動作する医療診断ツールや、クラウド接続を必要としないリアルタイム翻訳デバイスを想像してみてください。小さなモデルは、これらのシナリオを可能にし、世界中の数十億のデバイスにAI機能をもたらします。

プライバシーに関する懸念も、小さなモデルに有利です。AIがユーザーデバイスでローカルに実行されると、機密データはデバイスを離れません。ヘルスケア提供者は、クラウドサーバーにアップロードすることなく、患者のデータを分析できます。金融機関は、顧客情報を外部システムに公開することなく、取引を処理できます。このローカル処理機能は、機密性の高い業界におけるAIの採用に関する主要な懸念事項の1つに対処します。

結論

小さなAIモデルの台頭は、常に大きいモデルがより良いパフォーマンスを提供するという信念に挑戦しています。コンパクトなモデルは、知識の蒸留、量子化、専門化などのテクニックを使用して、特定のタスクでより大きなモデルと同等またはそれ以上のパフォーマンスを達成しています。この変化により、AIは、より速く、よりエネルギー効率的に、日常のデバイスで使用できるようになります。また、コストを削減し、環境への影響を低減し、ローカル展開を可能にすることでプライバシーを改善します。巨大な汎用システムではなく、効率的なタスク固有のモデルに焦点を当てることで、AIは、より実用的で、手頃で、組織と個人にとってより有用になります。