人工知能

大規模言語モデルを用いたグラフニューラルネットワークの強化: 究極のガイド

グラフは、ソーシャルネットワーク、ナレッジベース、生物システムなど、幅広いドメインで複雑な関係を表現するデータ構造です。これらのグラフでは、エンティティはノードとして表現され、その関係はエッジとして表現されます。

これらの複雑な関係構造を効果的に表現し、推論する能力は、ネットワーク科学、ケミインフォマティクス、レコメンダーシステムなどの分野の進歩を可能にするために不可欠です。

グラフニューラルネットワーク(GNN)は、グラフマシーンラーニングタスクの強力なディープラーニングフレームワークとして登場しました。グラフトポロジーをニューラルネットワークアーキテクチャに組み込むことで、ノードの特徴とその構造的役割の両方をエンコードした低次元ベクトル表現を学習できます。これにより、GNNは、ノード分類、リンク予測、グラフ分類などのタスクで、さまざまなアプリケーション分野で最先端のパフォーマンスを達成できます。

GNNは大きな進歩を遂げましたが、いくつかの重要な課題が残っています。訓練用の高品質なラベル付きデータを取得することは、高価で時間がかかる場合があります。さらに、GNNは、グラフ構造が非一貫的である場合や、グラフの分布が訓練データと大きく異なる場合(訓練外一般化)に苦労することがあります。

一方、GPT-4やLLaMAなどの大規模言語モデル(LLM)は、自然言語の理解と生成能力で世界を驚かせています。数十億のパラメータを持つ巨大なテキストコーパスで訓練されたLLMは、驚くべき少数샷学習能力、タスク間の一般化、共通の推論スキルを示しています。

LLMの驚くべき成功は、グラフマシーンラーニングタスクにその力を利用するための探索を刺激しました。一方では、LLMの知識と推論能力は、従来のGNNモデルを強化する機会を提供します。他方では、グラフに固有の構造化表現と事実の知識は、LLMのいくつかの重要な限界、たとえば妄想や解釈可能性の欠如に対処するのに役立ちます。

グラフニューラルネットワークと自己教師あり学習

必要なコンテキストを提供するために、グラフニューラルネットワークと自己教師ありグラフ表現学習の核心概念と方法を簡単に説明します。

グラフニューラルネットワークアーキテクチャ

グラフニューラルネットワークアーキテクチャ – ソース

従来のディープニューラルネットワークとGNNの主な違いは、グラフ構造化データを直接操作できる能力にあります。GNNは、近傍集約方式に従い、各ノードはその近傍からの特徴ベクトルを集約して自身の表現を計算します。

さまざまなGNNアーキテクチャが、メッセージと更新関数の異なる実装で提案されています。たとえば、グラフ畳み込みネットワーク(GCN)、GraphSAGE、グラフ注意ネットワーク(GAT)、グラフ同型ネットワーク(GIN)などがあります。

最近、グラフトランスフォーマーは、自然言語トランスフォーマーの自己注意メカニズムをグラフ構造化データに適応させ、グラフ全体の長距離依存関係をより良く捉えることができます。たとえば、GraphormerTransformerやGraphFormersがあります。

グラフの自己教師あり学習

GNNは強力な表現モデルですが、そのパフォーマンスは、監督学習に必要な大規模なラベル付きデータセットの不足によって制限されることがよくあります。グラフ構造とノード特徴のみを使用する自己教師あり学習は、GNNを事前訓練するための有望なパラダイムとして登場しました。

自己教師ありグラフ – ソース

GNNの事前訓練に使用される一般的な自己教師ありタスクには、以下のものがあります。

- ノード特性予測: ノードの特性の一部をランダムにマスクまたは破損させ、GNNにそれらを再構築するように課題を与える。

- エッジ/リンク予測: ノードのペア間のエッジの存在を予測することを学習する、通常はランダムなエッジマスクに基づいています。

- 対比学習: 同じグラフサンプルのグラフビュー間の類似性を最大化し、異なるグラフからのビューを押し離す。

- 相互情報量最大化: ローカルノード表現とターゲット表現(グローバルグラフ埋め込みなど)間の相互情報量を最大化する。

これらの自己教師ありタスクにより、GNNはラベル付けされていないグラフデータから有意義な構造的および意味的パターンを抽出できます。事前訓練されたGNNは、比較的小規模なラベル付きサブセットでファインチューニングされ、ノード分類、リンク予測、グラフ分類などのさまざまなダウンストリームタスクで優れたパフォーマンスを発揮できます。

自己教師あり学習を利用することで、GNNは大規模なラベル付けされていないデータセットで事前訓練され、より優れた一般化、ロバスト性、効率性を示します。しかし、従来のGNNベースの自己教師あり方法には、いくつかの重要な限界が残っています。これらの限界をLLMを利用して解決する方法を次に説明します。

グラフマシーンラーニングのLLMによる強化

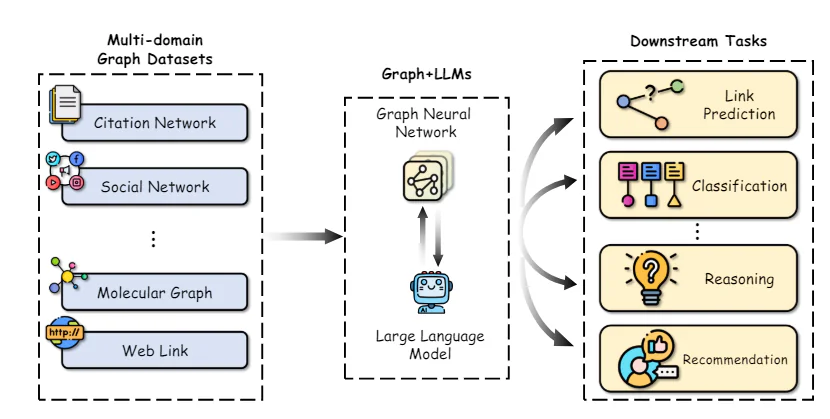

グラフとLLMの統合 – ソース

LLMの自然言語の理解、推論、少数샷学習能力は、グラフマシーンラーニングパイプラインのさまざまな側面を強化する機会を提供します。以下にいくつかの重要な研究方向を示します。

GNNを適用する上で重要な課題は、ノードとエッジの高品質な特徴表現を取得することです。特に、ノードが豊富なテキスト属性(説明、タイトル、要約など)を含む場合にそうです。従来、単純なバッグオブワーズまたは事前訓練済みのワードエンベッディングモデルが使用されていましたが、これらは繊細な意味を捉えることができません。

最近の研究では、LLMをテキストエンコーダーとして利用して、GNNに渡す前にノード/エッジの特徴表現を改善することを示しています。たとえば、Chen et al.は、LLM(GPT-3など)をテキストノード属性をエンコードするために使用し、伝統的なワードエンベッディングよりもノード分類タスクで大幅なパフォーマンスの向上を示しています。

テキストエンコーダーを改善するだけでなく、LLMは元のテキスト属性から増強情報を生成するために使用できます。たとえば、TAPEは、LLMを使用してノードの潜在的なラベル/説明を生成し、これらを追加の増強特徴として使用します。KEAは、LLMを使用してテキスト属性から用語を抽出し、これらの用語の詳細な説明を取得して特徴を増強します。

入力特徴の品質と表現力を向上させることで、LLMは自然言語の理解能力をGNNに提供し、ダウンストリームタスクのパフォーマンスを向上させます。