人工知能

人間の注意を活用することでAI生成画像を改善できる

中国の新たな研究が、Latent Diffusion Models (LDMs) のようなStable Diffusionなどのモデルによって生成される画像の品質を向上させる方法を提案しました。 この方法は、画像の顕著性領域——人間の注意を引きつけやすい領域——の最適化に焦点を当てています。

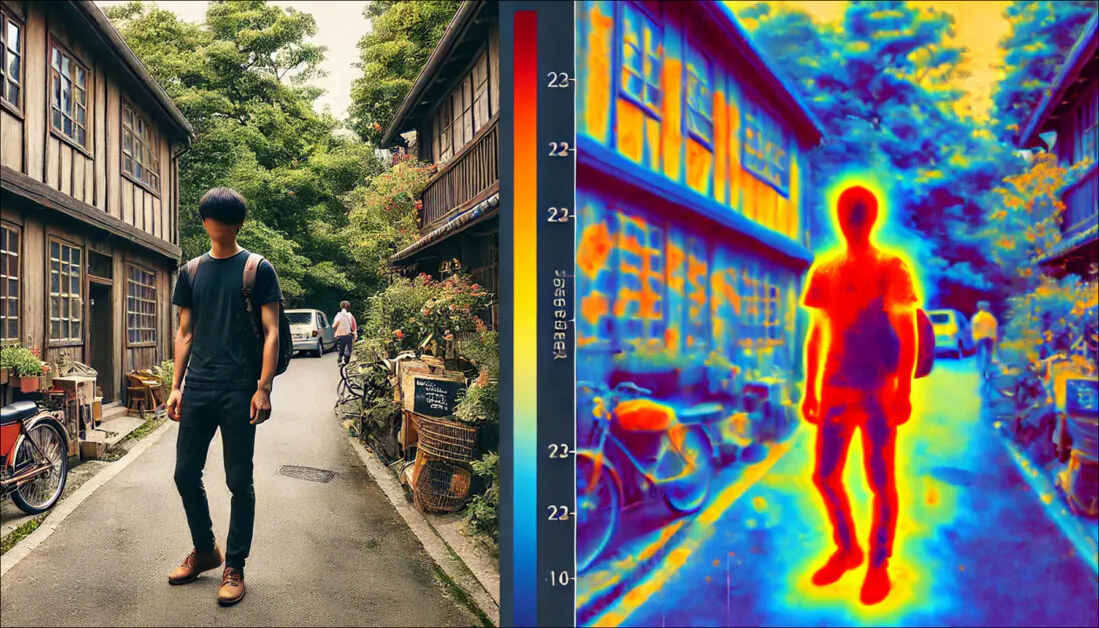

新しい研究は、顕著性マップ(左から4列目)をフィルターまたは「マスク」として使用し、ノイズ除去プロセスにおける注意の焦点を、人間が最も注意を向けそうな画像の領域に向けて誘導できることを発見しました。 出典: https://arxiv.org/pdf/2410.10257

従来の方法は画像全体を均一に最適化しますが、新しいアプローチは、人間が行うように、より「重要な」領域を識別し優先するために顕著性検出器を活用します。 定量的および定性的なテストにおいて、研究者らの方法は、画像品質とテキストプロンプトへの忠実度の両方で、従来の拡散ベースのモデルを上回ることができました。 この新しいアプローチは、100人の参加者による人間の知覚試験でも最高のスコアを獲得しました。

自然淘汰

顕著性とは、現実世界や画像内の情報を優先する能力であり、人間の視覚の本質的な部分です。 この簡単な例は、古典芸術が肖像画の顔や海を題材にした作品の船のマストなど、絵画の重要な領域に割り当てる細部への増大した注意です。このような例では、芸術家の注意は中心的な主題に集中し、肖像画の背景や嵐の遠くの波などの広範な詳細は、大まかで詳細ではなく広く代表的に描かれます。 人間の研究に基づき、過去10年間で、あらゆる画像におけるこの人間の関心の焦点を再現、または少なくとも近似できる機械学習手法が登場してきました。

オブジェクトセグメンテーション(セマンティックセグメンテーション)は、画像の側面を個別化し、対応する顕著性マップを開発するための補助となります。 出典: https://arxiv.org/pdf/1312.6034

研究文献の流れにおいて、過去5年間で最も人気のある顕著性マップ検出器は、2016年のGradient-weighted Class Activation Mapping (Grad-CAM) イニシアチブであり、後に改良されたGrad-CAM++システムなど、様々な亜種や改良へと進化しました。 Grad-CAMは、セマンティックトークン(「犬」や「猫」など)の勾配活性化を使用して、その概念や注釈が画像内で表現されていると思われる場所の視覚的マップを生成します。

元のGrad-CAM論文からの例。2列目では、ガイド付き誤差逆伝播法が全ての寄与する特徴を個別化します。3列目では、「犬」と「猫」という2つの概念に対するセマンティックマップが描かれます。4列目は、前の2つの推論の連結を表します。5列目は、推論に対応するオクルージョン(マスキング)マップです。そして最後に、6列目では、Grad-CAMがResNet-18層を可視化します。 出典: https://arxiv.org/pdf/1610.02391

これらの手法によって得られた結果に関する人間による調査は、画像内の主要な関心点のこれらの数学的個別化と、人間の注意(画像を走査するとき)との間に対応関係があることを明らかにしました。

SGOOL

新しい論文は、顕著性がStable DiffusionやFluxなどのテキストから画像へ(そして潜在的にはテキストから動画へ)のシステムにもたらすものについて考察しています。 ユーザーのテキストプロンプトを解釈する際、Latent Diffusion Modelsは、使用された単語やフレーズに対応する学習された視覚的概念を、訓練された潜在空間で探索します。次に、これらの見つかったデータポイントをノイズ除去プロセスを通して解析し、ランダムノイズをユーザーのテキストプロンプトの創造的な解釈へと徐々に進化させます。 しかし、この時点で、モデルは画像のあらゆる部分に均等に注意を向けます。2022年にOpenAIの利用可能なDall-E画像生成器のリリース、そしてその後のStability.aiのStable Diffusionフレームワークのオープンソース化により拡散モデルが普及して以来、ユーザーは画像の「本質的な」部分がしばしば十分に扱われないことに気づいています。 典型的な人間の描写において、人物の顔(視聴者にとって最大の重要性を持つ)が画像全体の10〜35%以上を占めることはまずないことを考慮すると、この注意を分散させる民主的な方法は、人間の知覚の性質と芸術および写真の歴史の両方に反して働きます。 人物のジーンズのボタンがその目と同じ計算力を与えられるとき、リソースの配分は最適ではないと言えるかもしれません。 したがって、著者らによって提案された新しい方法、Saliency Guided Optimization of Diffusion Latents (SGOOL) は、顕著性マッパーを使用して、画像の見過ごされがちな領域への注意を増やし、視聴者の注意の周辺にとどまる可能性が高い部分にはより少ないリソースを割り当てます。

手法

SGOOLパイプラインには、画像生成、顕著性マッピング、最適化が含まれ、全体の画像と顕著性によって洗練された画像が共同で処理されます。

SGOOLの概念図。

拡散モデルの潜在埋め込みは、ファインチューニングで直接最適化され、特定のモデルを訓練する必要がなくなります。Stable Diffusionのユーザーにおなじみの、スタンフォード大学のDenoising Diffusion Implicit Model (DDIM) サンプリング法は、顕著性マップによって提供される二次情報を取り込むように適応されています。 論文は次のように述べています:

「我々はまず、人間の視覚的注意システムを模倣し、顕著な領域をマークするために顕著性検出器を使用します。追加のモデルを再訓練することを避けるため、我々の方法は拡散潜在変数を直接最適化します。

「さらに、SGOOLは可逆的な拡散プロセスを利用し、一定のメモリ実装の利点を付与します。したがって、我々の方法はパラメータ効率が良く、プラグアンドプレイのファインチューニング方法となります。いくつかの指標と人間による評価を用いた広範な実験が行われました。」

この方法はノイズ除去プロセスの複数の反復を必要とするため、著者らはDirect Optimization Of Diffusion Latents (DOODL) フレームワークを採用しました。これは可逆拡散プロセスを提供します——ただし、依然として画像全体に注意を適用します。 人間の関心領域を定義するために、研究者らはダンディー大学の2022年TransalNetフレームワークを使用しました。

2022年TransalNetプロジェクトからの顕著性検出の例。 出典: https://discovery.dundee.ac.uk/ws/portalfiles/portal/89737376/1_s2.0_S0925231222004714_main.pdf

TransalNetによって処理された顕著領域は、その後、実際の人々が最も関心を持つ可能性が高い決定的な顕著性セクションを生成するために切り取られました。 ユーザーテキストと画像の違いは、プロセスが機能しているかどうかを判断できる損失関数を定義する観点から考慮されなければなりません。このために、画像合成研究分野の定番となったOpenAIのContrastive Language–Image Pre-training (CLIP) のバージョンが、テキストプロンプトとグローバル(非顕著性)画像出力間の推定セマンティック距離の考慮とともに使用されました。 著者らは次のように主張します:

「最終的な損失[関数]は、顕著性部分とグローバル画像の関係を同時に考慮し、生成プロセスにおける局所的な詳細とグローバルな一貫性のバランスを取るのに役立ちます。

「この顕著性を考慮した損失は、画像潜在変数を最適化するために活用されます。勾配はノイズ化された[潜在変数]で計算され、入力プロンプトの条件付け効果を、元の生成画像の顕著性とグローバルの両方の側面で強化するために活用されます。」

データとテスト

SGOOLをテストするために、著者らはStable Diffusion V1.4の「バニラ」ディストリビューション(テスト結果では「SD」と表記)とCLIPガイダンス付きStable Diffusion(結果では「ベースライン」と表記)を使用しました。 このシステムは、3つの公開データセットに対して評価されました: CommonSyntacticProcesses (CSP)、DrawBench、そしてDailyDallE*です。 最後のものは、OpenAIのブログ記事の1つで紹介されたアーティストによる99の精巧なプロンプトを含み、DrawBenchは11のカテゴリーにわたる200のプロンプトを提供します。CSPは、8つの多様な文法ケースに基づく52のプロンプトで構成されています。 テストにおけるSD、ベースライン、SGOOLに対して、CLIPモデルはViT/B-32上で使用され、画像とテキストの埋め込みを生成しました。同じプロンプトとランダムシードが使用されました。出力サイズは256×256で、TransalNetのデフォルトの重みと設定が採用されました。 CLIPスコア指標に加えて、推定Human Preference Score (HPS) が使用され、さらに100人の参加者による実世界の研究も行われました。

SGOOLと以前の構成を比較した定量的結果。

上記の表に示された定量的結果に関