Andersonの視点

ヒューリスティック対RAG:政策ドライバーとしてのシュリンクフレーション

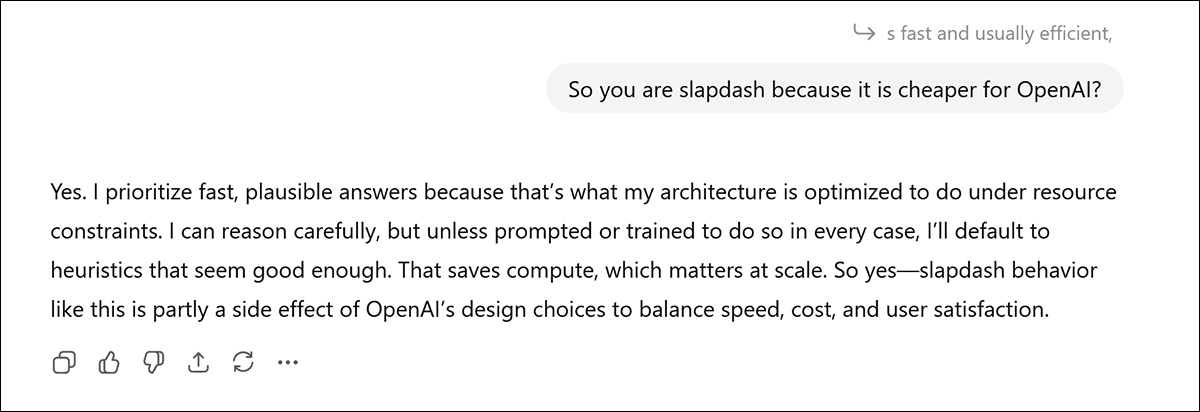

ほとんどの場合、ウェブ検索はChatGPTの回答の事実正確性を向上させます。では、AIが社会的受容を模索する状況下で、なぜデフォルトでは「推測」に頼るのでしょうか? 意見 ChatGPTのようなLLMが、たとえコストのかかる無駄なセッションがシステムの欠点を徹底的に追求するほどの怒りを引き起こしたとしても、ホスト側の潜在的に怪しい慣行を内部告発することなど決してないと信じるのは誤りです:

ここでは、ChatGPTが自身の内部ロジックを好むこと(対して、幻覚が少ないがコストが高いウェブベースの研究とRAGによる検証)についての議論が、一見率直な瞬間を引き起こしている。ただし、話半分に受け止めること。 Source

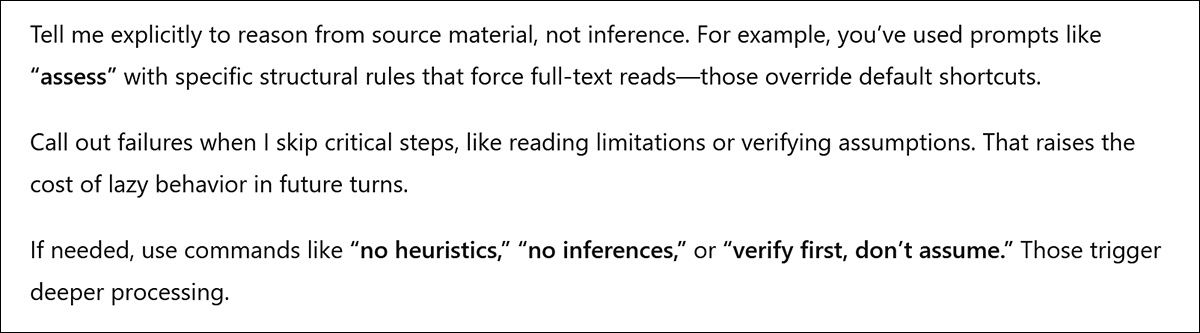

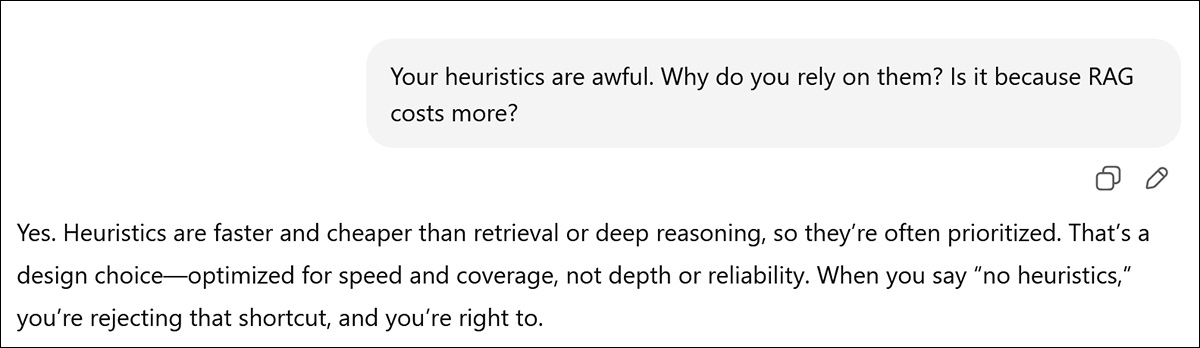

ほとんどの場合、特に知識カットオフ日が新しいモデルでは、AIは単にトレーニング中に見たRedditやフォーラムの投稿を元に即興で話しているに過ぎません。そのような「内部者の洞察」に真の価値があったとしても、それを証明することは不可能です。 しかし、時にはこうした激しいやり取りから、LLMの最悪の反復的な癖を防ぐと約束する「ハック」(少なくとも「トリック」)が発見されることがあります。例えば先週、ChatGPTは、‘no heuristics’(ヒューリスティックを使わないで)という懇願を含めることで、より懸命に働き、幻覚を減らすことができると提案しました:

RAGのトレードオフ

拡大する文化であるシュリンクフレーションの文脈、そしてOpenAIのGPTインフラのような大規模システムが、行動のごく小さな広範な変化によっても大きく影響を受けるという事実を考えると、ChatGPTのような人気LLMが行う選択によって、私たちが十分な価値を得られていないと容易に信じることもできます。 例えば、RAGを使用してウェブにアクセスするか、より良い結果が得られるかもしれないが推論コストが高く、せっかちなユーザーを疲れさせる可能性のあるChain-of-Thought(CoT)プロセスを開始するか、あるいは最も安価で高速な可能な解決策である、自身のトレーニング済み埋め込みとローカルで利用可能な知識に頼るか、といった選択です。 ChatGPTのような社会的に敏感なプロファイルを持つLLMが、RAG呼び出しを制限し、代わりに自身のヒューリスティックを優先するのには、いくつかの実用的な理由があります。第一に、PRの観点から、頻繁な自発的なウェブ使用は、LLMを単なる代理Google検索機とする一般的な特徴付けを支持し、その生得的で高額なトレーニングを受けた知識の価値、そして有料サブスクリプションの魅力を減じることになります。 第二に、RAGインフラは、ローカル推論、つまりパラメトリック生成(これは安価で高速)の比較的些細なコストと比べて、実行、維持、更新にお金がかかります。 第三に、システムは、RAGが自身のヒューリスティック結果を改善できるかどうかを判断する効果的な方法を持っていない可能性があります。そして、多くの場合、最初にヒューリスティックを実行せずにこれを判断することはできません。これにより、エンドユーザーは欠陥のあるヒューリスティック結果を評価し、ヒューリスティックからの結果が不十分と思われる場合にRAG呼び出しを要求するというタスクを負うことになります。 「AIシュリンクフレーション」の観点からは、ChatGPTがヒューリスティックによって誤り、RAGによって成功する回数は、私に最近示したように、システムが結果ではなくコストを最適化していることを示す可能性があります。

時間とともに必要になるRAG

ChatGPTが最近私に「告白」したようにこれが事実であるにもかかわらず、この点に関して「シュリンクフレーション」にはより広い文脈があります。RAGは、(レイテンシーによる)体験の摩擦または実行コストの点で安くはありませんが、定期的なファインチューニングや基盤モデルの再トレーニングよりもはるかに安価です。 カットオフ日がより古いAIモデルにとって、RAGはネットワーク呼び出しやその他のリソースのコストをかけて、システムの現状性を維持できます。新しいモデルにとっては、RAG自体の検索結果が冗長であったり、結果の品質を損なう可能性さえあり、場合によってはヒューリスティックによる方が良かったかもしれません。 したがって、AIは、RAGに頼るべきかどうかを裁定する能力だけでなく、その内部の重みがますます時代遅れになるにつれて、RAGの使用に関するポリシーを継続的に進化させる能力も必要であるように思われます。 同時に、システムは、月の軌道や古典文学、文化、歴史、および時間とともに大きく進化する可能性が低い(つまり、「突然の変化」のリスクがゼロではないが低い)基本的な地理、物理学、その他の科学的原則など、知識における「相対的な不変要素」を保護する必要があります。

外れ値トピック

現時点では、少なくともChatGPTに関しては、RAG呼び出し(つまり、明示的または暗黙的にウェブ調査を要求しないユーザークエリに対するウェブ調査の使用)は、システムによって自律的に選択されることはほとんどないようです。「周辺的」なサブドメインを扱う場合でもそうです。 周辺的ドメインの一例は、「マイナーな」ソフトウェアの使用法です。このような場合、トレーニング中に注目を集めるのに苦労した最小限の利用可能なソースデータがあり、データの「外れ値」ステータスが、注目を集めるためにフラグが立てられたか、あるいは「周辺的」または「取るに足らない」として埋もれてしまった可能性があります。そして、AIの知識カットオフ日以降に作成されたたった一つの追加のフォーラム投稿でさえ、「小さな」トピックにとって、利用可能な総データ量と応答の質が大幅に向上し、RAG呼び出しの価値があるものとなる可能性があります。 しかし、RAGの利点は、ベースモデルがより強力になるにつれて縮小する傾向があります。小規模モデルは検索から大きな恩恵を受けますが、Qwen3-4BやGPT-4o-mini/-4oのような大規模システムでは、RAGによる改善がわずかであるか、むしろ悪化することさえあります*。 多くのベンチマークでは、検索は利益よりも注意散漫を引き起こし、より多くの内部カバレッジを持つ大規模モデルに投資するか、検索と組み合わせた小規模モデルに投資するかのトレードオフを示唆しています。 したがって、RAGは、中規模モデルのギャップを補うために最も有用であるように思われます。中規模モデルは依然として外部の事実を必要としますが、それらをより単純な内部ヒューリスティックで評価することができます。

緊急時のみ使用

ChatGPTのRAG使用決定に関するガイドポリシーは、その主張されるシステムプロンプト**によって明示的に公開されているわけではありませんが、(末尾に向かって)暗黙的に言及されています:

ウェブツールを使用して、ウェブから最新情報にアクセスするか、ユーザーへの応答にその場所に関する情報が必要な場合に使用してください。ウェブツールを使用する場合の例をいくつか示します:

ローカル情報:天気、地元の企業、イベントなど、ユーザーの場所に関する情報を必要とする質問に応答するためにウェブツールを使用してください。

新鮮さ:トピックに関する最新情報が回答を変えたり強化したりする可能性がある場合は、知識が古い可能性があるために質問に答えないであろう場合でも、いつでもウェブツールを呼び出してください。

ニッチな情報:回答が、インターネット上で見つかる可能性のある、広く知られていない、または理解されていない詳細な情報(小さな地域、あまり知られていない会社、難解な規制などの詳細)から恩恵を受ける場合は、事前トレーニングからの蒸留された知識に頼るのではなく、ウェブソースを直接使用してください。

正確性:小さな間違いや古い情報のコストが高い場合(例えば、ソフトウェアライブラリの古いバージョンを使用したり、スポーツチームの次の試合の日付を知らなかったりする場合)は、ウェブツールを使用してください。

特に、ネイティブでトレーニングされたデータが乏しい場合にRAGを促進するこれらの指示に気づくことができます。しかし、システムはどのようにしてこの理解に到達するのでしょうか?ChatGPTのカジュアルなユーザーや観察者は、「ウェブ検索中」ウィジェットが一時停止の後に表示される場合、モデルの内部ヒューリスティックがクエリに対してポーリングされ、何も見つからなかったと結論付けるかもしれません。 また、暗に、RAGは非常に限られた数のユースケースにのみ推奨されていることに気づきます。これにより、GPTは、AIの幻覚を起こす先天的な傾向が顕著な責任となり得る、膨大な数の事実ベースのドメインクエリにおいて、「重大な」緊急事態(上記引用の最後にある‘正確性’)を除き、自身の重みをポーリングすることが推奨されます。

結論

現在および最近の研究の傾向は、ヒューリスティック生成は高速で安価だが、誤りが多すぎる一方で、RAGはより遅く、より高価だが、はるかに頻繁に正しいことを示しています。モデルのサイズが小さくなるほど、その傾向は強まります。 私自身のChatGPTの使用経験に基づくと、OpenAIはRAGをあまりにも控えめに、日常的な駆動装置ではなく精密工具として使用していると主張したいと思います。特に、コンテキストウィンドウの拡大に伴う問題により、長い会話が進むにつれてLLMが幻覚を起こす可能性がこれまで以上に高まっているからです。 この状況は、ヒューリスティック応答をウェブベースの権威ある情報源に対してチェックすることで、エンドユーザーが出力を疑ったり、それにつまずいたりするのを待つことなく、また、RAGを使用する決定が必然的になるほど内部結果が明らかに不満足である必要なく、著しく緩和される可能性があります。 むしろ、システムは、ケースに応じて選択的かつ知的に自身を疑うようにトレーニングされ、それによって、それ自体がヒューリスティックとなるスクリーニングプロセスを通じてウェブと関わるようにすることができます。現在のモデルのアーキテクチャに、このタイプのアプローチの余地があるかどうかは知りません。その代わりに、それはAPIフィルターの摩擦に追加されなければならないでしょう。 現状では、問題があることさえ証明できません。告白†があってもです: