Andersonの視点

さざなみAIでもニュースを人間と見分けがつかないレベルで書くことができる

新しい研究によると、ローカルAIモデルでも、人間が区別できないようなニュース記事を書くことができ、トップシステムと一致し、読者が誰が書いたかを判断できないようになっている。

ドイツとフランスの新しい研究協力によると、人間はAIが書いたニュース記事と人間が書いたニュース記事を区別することができないことがわかった。オープンソースモデルで、相対的に平均的な消費者レベルのデスクトップコンピューターでダウンロードして実行できるようなモデルでも、同じことが言える。

別の指標として、小さいAIが台頭していることを示唆するものとして、小さいAIは巨大な言語モデルを上回ることがあるというものがある。1,054人の参加者から2,318の判断を収集した専用の学術研究ポータルによる調査では、人間の読者が、7億パラメータを持つ比較的貧弱なモデルでさえも、MistralやLlamaのバリエーションを含む、記事の出典を偶然以上のレベルで識別することができないことがわかった。

テストされたLLMの平均出典スコアと真実性スコア。GPT-4oの200億パラメータは、リストされている小さいモデルの7Bパラメータをはるかに上回っていない。テストされたモデルは、Gemma 7B、Phi-3 Mini、LLaMA-2 13B、Mistral 7B、GPT-4o、GPT-3.5であった。 ソース

著者たちは、2024年に初めて調査したテーマに戻っている。《生成的なAIがフェイクニュースに与える影響に関する調査》というタイトルのものである。調査結果自体は、1月に最初に発表されたより大きなプロジェクトの新しく発表された結果であり、著者たちの独自のJudgeGPTオンライン参加型フレームワークを使用している。

軽量の力

《人間は判断できるか?LLM生成のニュースに関する人間の認識の二軸研究》というタイトルのこの新しい研究は、フランクフルト応用科学大学とナントのIRISA研究ユニットの3人の研究者によって行われた。この研究の方法論は、重要な区別を『フェイクニュース』と『AI書きニュース』の間に作る。なぜなら、フェイクニュースは人間によって書かれたり、AIによって書かれたりすることができ、両者は必ずしも同義ではないからである。

しかし、興味深いのは、この論文の結論である。Mistral 7BやGemma 7Bのような小さいモデルは、7億パラメータだけで、200億パラメータを持つChatGPTモデルと対等に戦うことができるということである。

‘7Bパラメータを持つオープンウェイトモデルは、GPT-4oの出力と区別できないテキストを生成し、人間と区別できないテキストを生成する能力は、最先端のモデルに限定されていないことを示唆している。’

しかし、『AI生成ニュース』は、スペルチェックからフルな労力の転嫁まで、さまざまな人間とAIのコラボレーションを表すことができる。研究では、テストに使用されたAIコンテンツの種類については明確には述べられていないが(ただし、生成方法については以下に述べる)、メソッドについては説明している。

方法

JudgeGPTプラットフォームに参加した参加者は、それぞれのニュース断片を二軸フレームワークで評価し、3つの独立した評価を0-100のスライダーで行った。

評価者が素材を出典帰属、真実性、トピックの熟知度で評価するJudgeGPTポータルのGUI。ソース論文に記載されているより高解像度の画像を参照してください。

出典の判断は、文章が機械によって書かれたか人間によって書かれたかを捉えるものでした。 真実性の判断は、文章が偽物であるか本物であるかを判断するものでした。 トピックの熟知度は、読者がテーマをどの程度知っているかを判断するものでした。

連続スケールは、Likertスケールではなく、確実性の度合いをより正確に捉え、統計分析をサポートするために使用されました。統計分析には、Pearson相関とクラスタリングが含まれます。

機械生成テキストは、著者たちのRogueGPTフレームワークによって生成されました。RogueGPTは、JudgeGPTのフィーダーアーキテクチャです。RogueGPTは、6つのLLM(Large Language Model)からの貢献を調整します:ChatGPT-4、ChatGPT-3.5、ChatGPT-4o、LLaMA-2 13B、Gemma 7B、Mistral 7B。

ペルソナベースのプロンプティングを使用してテキストを生成し、AI生成物は実際のニューストピックに基づいており、人間によって事実検証されました。

逆に、人間が書いた断片は、既存のニュース媒体と情報データベースからサンプリングされました。

著者たちは以下のように述べています:

‘刺激セットは、機械起源の断片(約98%)に偏っており、人間起源のアイテムは校正アンカーとして機能しています。 ‘

‘この設計選択は、研究の焦点が人間対AIの比較ではなく、AI内変動(モデル間)にあることを反映しています。参加者は基準率に通知されていないため、結果は人間起源のサブセットのみで分析された場合にも、ほぼ同じです。’

参加者は、事前同意書に署名し、年齢、教育、政治的志向、AIに関する知識を含む人口統計学的質問紙に回答した後、ニュース断片を評価しました。

各人は5〜87個のアイテムを確認し、中央値は12で、提示順序はランダム化され、モデルの割り当ては参加者間でバランスが取られ、偏りを減らすために行われました。プラットフォームは、レスポンスタイムと匿名識別子とともに、3つのスライダー評価を記録し、個々の判断を背景要因とリンクさせることができます。

著者たちは、サンプルが教育を受けたヨーロッパ人参加者に偏っていることを指摘しています。68%が大学教育を受けており、74%がヨーロッパに拠点を置いているということです。論文では、これをより広範な一般化のための制限として述べています。

テスト

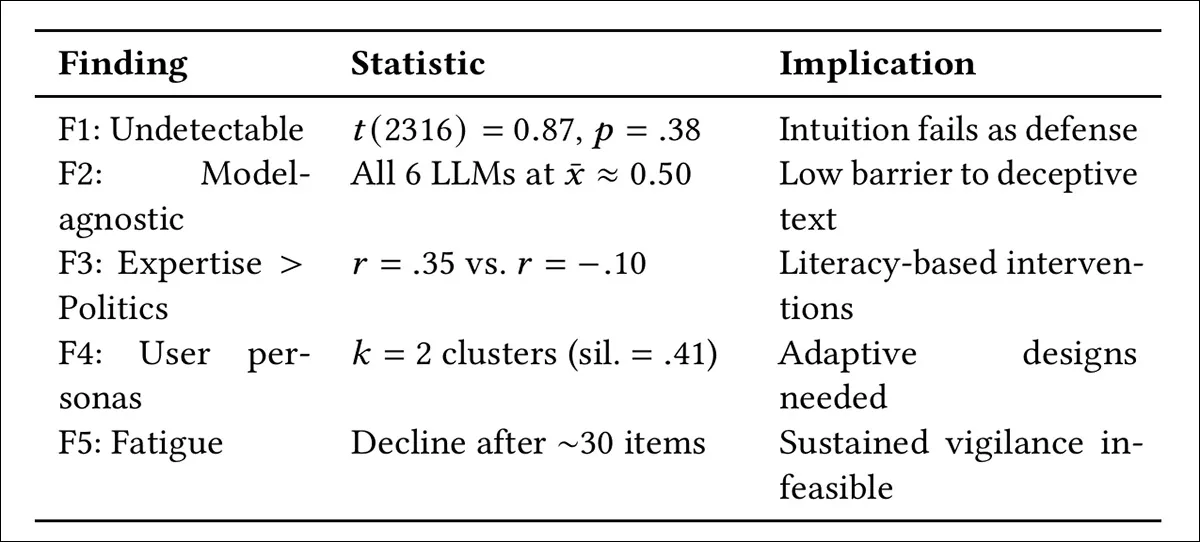

テストは、5つの発見タイプに分けられます。機械生成テキストと人間書きテキストを区別すること、さまざまなLLM間の検出を比較すること、ドメインの専門知識と政治的志向が精度に与える影響を調査すること、参加者間の異なるレスポンス戦略を特定すること、そして繰り返し評価による精度の変化を追跡することです。

1,054人の参加者からの2,318の判断の5つの核心的な発見の要約。人間のAI書きテキストの検出はすべてのモデルで偶然レベルに留まり、精度は政治的志向よりもドメインの専門知識に結びついており、参加者は異なる信頼プロファイルに分かれ、約30評価後には認知的疲労により性能が低下することを示している。

テストでは、条件間で出典スコアに有意差は見られなかった。参加者はAI生成テキストと人間書きテキストを区別することができないことを示唆している。

機械起源と人間起源の断片の出典スコアと真実性スコアの分布は、両条件間に有意な分離がない大きな重なりを見せ、統計的テストでは参加者がAI生成テキストと人間書きテキストを信頼性を持って区別することができないことを示唆している。

2番目の側面として、検出の失敗はモデルによって変化しなかった。すべてのLLMの出力は偶然レベルの判断の周りにクラスタリングされ、間には有意な差はなかった。Mistral 7BやGemma 7Bのような小さいオープンウェイトシステムも、GPT-4oと同等に評価された。人間と区別できないテキストは、最も大きなモデルに限定されていないことを示唆している。

3番目の側面として、精度はドメインの専門知識よりも政治的志向に強く結びついていた。フェイクニュースに対する精度は、政治的見解は有意な影響を与えなかったのに対し、フェイクニュースに対する精度が高かった。

3番目の調査線に関する結果。参加者の背景要因と判断精度の相関は、政治的志向が出典帰属または真実性スコアに有意な影響を与えなかったことを示している。一方、フェイクニュースに対する精度は、政治的見解よりもドメインの専門知識に強く結びついていた。ソース論文に記載されているより高解像度の画像を参照してください。

4番目の発見では、参加者は2つの異なるレスポンススタイルに分かれた。『懐疑主義者』は、出典に関係なく、低い信頼性を割り当てた。『信頼主義者』は、高い信頼性を維持した。

最後に、5番目の目的について、連続的な判断の分析では、参加者は初期の評価の後、約15〜20の評価でタスクに適応し、精度が向上することがわかった。

評価のシーケンスを通した出典帰属と真実性スコアのローリング平均は、初期の約15〜20のアイテムでタスクに適応しているように見え、認知的疲労により、約30評価後には両方の尺度で性能が低下する。ソース論文に記載されているより高解像度の画像を参照してください。

しかし、この効果は短期間で終了し、約30アイテム後には、参加者の性能が低下し始め、コンテンツを偽物であるとラベル付けする傾向が強くなった。認知的疲労と解釈され、検出ベースのアプローチが有効な期間については、実践的な限界があることを示唆している。

これは、フェイクニュースと本物のニュース、AI生成のニュースと人間が書いたニュースを区別することの難しさに疲れて、人々が安全のためにコンテンツをAI生成またはフェイクニュースであると仮定する傾向にあることを示唆する実証的な証拠となるかもしれない。

この傾向を『怠惰』と見なし、人々はフェイクニュースの潜在的な記事を検証するために自分で調査するべきだと考える人々は、2024年の研究で、人々にフェイクニュース記事について自分で調査するよう求めることは、問題を悪化させるだけであることを知ることができるだろう。

著者たちは、結果から、人間の判断の失敗は、検出の問題をシステムレベルでの対策、コンテンツの出典、適応的な信頼指標、または制限された予防接種介入に委ねる必要があることを示唆している。

結論

この論文の心配な点は、プロジェクトや論文の周囲にあるアンビエントサポートネットワークであり、どの程度のAIと人間生成テキストのサンプルがこの結果を生み出したのかを調べることができたなら、もっとも興味深いことであったでしょう。

しかし、オープンウェイト、オープンソースモデルがChatGPTシリーズのようなAPI駆動の巨大モデルと比較できるということは、面白いことです。タスクが実際にはあまり難しくなく、200億パラメータのモデルはこのようなタスクには過剰であるということになるのでしょうか。AIと人間書きのソースサンプルについてもう少し知る必要があります。

一方で、canirun.aiウェブサイトによると、Mistral 7B(テストでGPT-4oとほぼ同等だった)は、16GBのVRAMを搭載したNVIDIA RTX 3080で『とてもよく動作』し、6GBのVRAMを搭載したRTX 3060では『まあまあ動作』するということです。つまり、最新のグラフィックカードを使用する必要はありません。したがって、誰でも独自のサンプル提出方法を考案して、これらの実験に参加できます。

* Gemma 7Bはサイトにリストされていません。

2026年4月9日木曜日初版